Giới thiệu

LeNet-5, mạng thần kinh tích chập (CNN) tiên phong được phát triển bởi Yann LeCun và nhóm của ông vào những năm 1990, là nhân tố thay đổi cuộc chơi trong lĩnh vực thị giác máy tính và học sâu. Kiến trúc mang tính đột phá này được tạo ra một cách rõ ràng nhằm cách mạng hóa việc nhận dạng các ký tự viết tay và in bằng máy. Không giống như các phương pháp truyền thống, LeNet-5 đã giới thiệu một cách tiếp cận mới giúp loại bỏ nhu cầu kỹ thuật tính năng thủ công, xử lý trực tiếp hình ảnh pixel thông qua các lớp chập, lấy mẫu con và các lớp được kết nối đầy đủ. Thành công của nó vượt ra ngoài khả năng nhận dạng ký tự, đóng vai trò là nền tảng cho các mô hình học sâu hiện đại và ảnh hưởng đến các kiến trúc tiếp theo trong thị giác máy tính, nhận dạng đối tượng và phân loại hình ảnh.

Ứng dụng ban đầu của thuật toán lan truyền ngược của Yann LeCun vào các vấn đề thực tế đã đặt nền móng cho LeNet-5, được thiết kế để đọc các ký tự viết tay và xuất sắc trong việc xác định số mã zip do Bưu điện Hoa Kỳ cung cấp. Các phiên bản và ứng dụng kế tiếp của nó, chẳng hạn như khả năng đọc hàng triệu tờ séc mỗi ngày, đã thu hút sự quan tâm ngày càng tăng của các nhà nghiên cứu, định hình bối cảnh của mạng lưới thần kinh và truyền cảm hứng cho sự phát triển của học sâu.

Sự thành công của LeNet-5 và các ứng dụng tiếp theo, chẳng hạn như hệ thống có khả năng đọc hàng triệu tờ séc mỗi ngày, đã thu hút sự quan tâm rộng rãi của các nhà nghiên cứu về mạng lưới thần kinh. Mặc dù các kiến trúc mạng nơ-ron hiệu suất cao nhất hiện nay đã phát triển vượt ra ngoài LeNet-5, nhưng thiết kế đột phá và những thành tựu của nó đã đặt nền tảng cho nhiều mô hình tiếp theo, định hình và truyền cảm hứng đáng kể cho việc học sâu. LeNet-5 vẫn là minh chứng cho sự đổi mới và là biểu tượng lâu dài cho sự phát triển của học máy và nhận dạng hình ảnh.

Mục tiêu học tập

- Khám phá ý nghĩa lịch sử và tác động của LeNet-5 đối với sự phát triển của học sâu và thị giác máy tính.

- So sánh LeNet-5 với các kiến trúc mạng thần kinh hiện đại, xem xét ảnh hưởng nền tảng của nó đối với các mô hình hiện tại trong học sâu.

- Hiểu kiến trúc của LeNet-5, bao gồm các lớp tích chập, lấy mẫu con và các lớp được kết nối đầy đủ.

- Phân tích các ứng dụng thực tế và nghiên cứu điển hình cho thấy tính hiệu quả của LeNet-5 trong các nhiệm vụ nhận dạng hình ảnh.

Bài báo này đã được xuất bản như một phần của Blogathon Khoa học Dữ liệu.

Mục lục

Hiểu LeNet

LeNet, còn được gọi là LeNet-5, là kiến trúc mạng thần kinh tích chập (CNN) tiên phong được phát triển bởi Yann LeCun và nhóm của ông vào những năm 1990. Nó được thiết kế rõ ràng cho các nhiệm vụ nhận dạng ký tự viết tay và in bằng máy. Tầm quan trọng của LeNet-5 nằm ở việc thể hiện thành công việc học tính năng phân cấp và tính hiệu quả của nó trong nhận dạng ký tự. Tác động của nó vượt ra ngoài mục đích ban đầu, ảnh hưởng đến sự phát triển của các mô hình học sâu hiện đại và đóng vai trò là kiến trúc nền tảng cho những tiến bộ tiếp theo trong thị giác máy tính, nhận dạng hình ảnh và các ứng dụng học máy khác nhau.

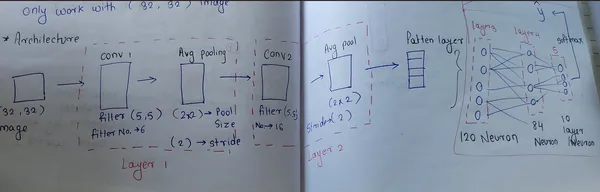

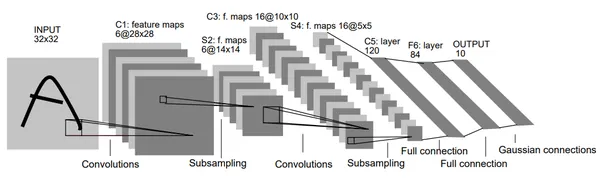

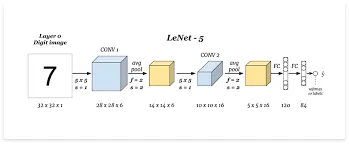

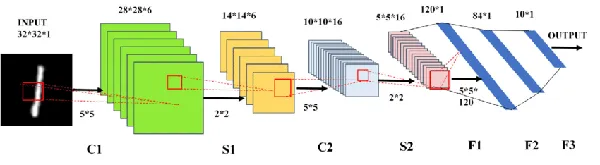

Kiến trúc của LeNet

LeNet-5 là Mạng thần kinh chuyển đổi (CNN) với kiến trúc cụ thể được sử dụng trong các nhiệm vụ nhận dạng ký tự. Nó bao gồm nhiều lớp, ngoại trừ lớp đầu vào, chứa các tham số có thể huấn luyện được. Đáng chú ý, nó xử lý hình ảnh 32×32 pixel, quan trọng hơn các ký tự trong cơ sở dữ liệu của nó, tập trung vào việc căn giữa các tính năng có khả năng phân biệt. Giá trị pixel đầu vào được chuẩn hóa để có hiệu quả học tập tốt hơn.

Kiến trúc của LeNet kết hợp các lớp chập, lấy mẫu con và kết nối đầy đủ với các mẫu kết nối cụ thể. Nó sử dụng tính năng chuẩn hóa cho các pixel đầu vào và một loạt các lớp để trích xuất các tính năng đặc biệt từ dữ liệu nhằm phục vụ việc học hiệu quả. Ngoài ra, nó còn thực hiện các chiến lược độc đáo để ngăn chặn sự bão hòa của các hàm kích hoạt và sử dụng các hàm mất mát cụ thể để đào tạo hiệu quả.

Các chiến lược độc đáo để ngăn chặn sự bão hòa

- Lớp đầu vào: LeNet xử lý hình ảnh 32×32 pixel, quan trọng hơn các ký tự trong cơ sở dữ liệu, nhằm mục đích nắm bắt các đặc điểm nổi bật tiềm ẩn ở trung tâm của hình ảnh.

- Lớp tích chập và lấy mẫu con: lớp tích chập chủ yếu trích xuất các tính năng từ dữ liệu đầu vào bằng cách sử dụng các bộ lọc hoặc hạt nhân có thể học được. Mỗi lớp bao gồm nhiều bộ lọc trượt trên dữ liệu đầu vào (hình ảnh) và thực hiện phép nhân theo từng phần tử để tạo ra bản đồ đặc trưng. Lớp ban đầu chứa 6 bộ lọc có kích thước 5×5, được kích hoạt bằng chức năng tanh, dẫn đến các bản đồ đặc trưng có kích thước 28x28x6. Các lớp tiếp theo sử dụng 16 bộ lọc có cùng kích thước, tạo ra các bản đồ đặc trưng 10x10x16.

- Lớp lấy mẫu con, còn được gọi là các lớp gộp, tập trung vào việc giảm tính chiều của các bản đồ đặc trưng thu được từ các lớp tích chập. Việc gộp chung bao gồm việc hợp nhất hoặc giảm mẫu các bản đồ đối tượng, thường bằng cách lấy giá trị tối đa (MaxPooling) hoặc giá trị trung bình (AveragePooling) trong các vùng được xác định. Với kích thước bộ lọc 2×2 và các biến thể sải bước, các lớp này tạo ra các kích thước bản đồ đặc trưng lần lượt là 14x14x6 và 5x5x16.

- Các lớp được kết nối đầy đủ: Kiến trúc bao gồm các lớp được kết nối đầy đủ có nhãn Fx, xử lý phân loại cuối cùng dựa trên các tính năng được trích xuất. Một lớp được kết nối đầy đủ với 84 nơ-ron và lớp đầu ra cuối cùng có 10 nơ-ron, sử dụng chức năng kích hoạt tanh ở lớp trước và Softmax ở lớp sau. Hàm Softmax gán xác suất cho từng lớp, với xác suất cao nhất xác định dự đoán.

- Lớp đầu ra: LeNet sử dụng các đơn vị Hàm cơ sở xuyên tâm để phân loại, với các cách thể hiện ký tự riêng biệt để nhận dạng và sửa lỗi.

Quy trình làm việc từng bước

[Input: 28x28x1]

|

[Conv2D: 6 filters, 5x5, tanh]

|

[Average Pooling: 2x2, stride 2]

|

[Conv2D: 16 filters, 5x5, tanh]

|

[Average Pooling: 2x2, stride 2]

|

[Flatten]

|

[Dense: 120, tanh]

|

[Dense: 84, tanh]

|

[Dense: 10, softmax (output)]

Lớp chập 1:

- Số lượng bộ lọc: 6

- Kích thước hạt nhân: 5×5

- Chức năng kích hoạt: Tính

- Hình dạng đầu vào: 28x28x1

Lớp gộp trung bình 1:

- Kích thước bể bơi: 2×2

- Sải bước: 2

Lớp chập 2:

- Số lượng bộ lọc: 16

- Kích thước hạt nhân: 5×5

- Chức năng kích hoạt: Tính

Lớp gộp trung bình 2:

- Kích thước bể bơi: 2×2

- Sải bước: 2

Các lớp được kết nối đầy đủ:

- Lớp dày đặc với 120 đơn vị và kích hoạt Tánh.

- Lớp dày với 84 đơn vị và tính chất kích hoạt.

- Lớp đầu ra với 10 đơn vị và kích hoạt Softmax để phân loại nhiều lớp (bộ dữ liệu MNIST).

Tính năng chính của LeNet

- Kiến trúc CNN: LeNet-5 là Mạng thần kinh chuyển đổi tiên phong có kiến trúc có cấu trúc với các lớp chập và gộp.

- Nhận dạng mẫu ở chữ số viết tay: Được phát triển ban đầu để nhận dạng chữ số viết tay, cho thấy độ chính xác cao trong việc xác định và phân loại các ký tự viết tay.

- Lớp chập và gộp: Giới thiệu các lớp tích chập để trích xuất tính năng và các lớp gộp để lấy mẫu xuống, cho phép mạng tìm hiểu các biểu diễn phân cấp dần dần.

- Kích hoạt phi tuyến tính: Đã sử dụng các hàm kích hoạt tiếp tuyến hyperbol (tanh), cung cấp cho mạng các khả năng phi tuyến tính cần thiết để nắm bắt các mối quan hệ phức tạp trong dữ liệu.

- Ảnh hưởng đến học sâu: Thành công của LeNet-5 đã đặt nền móng cho các mô hình học sâu hiện đại và ảnh hưởng đáng kể đến sự phát triển của mạng lưới thần kinh để nhận dạng và phân loại hình ảnh.

Triển khai thực tế LeNet:

Nhập thư viện

Bắt đầu với mã để triển khai LeNet-5 trong TensorFlow bằng API Keras. Đây là một khởi đầu tốt để làm việc với tập dữ liệu MNIST.

import tensorflow as tf

from tensorflow import keras

from keras.datasets import mnist

from keras.layers import Dense, Flatten, Conv2D, AveragePooling2D

from keras.models import Sequential

from tensorflow.keras.utils import plot_modelTải tập dữ liệu

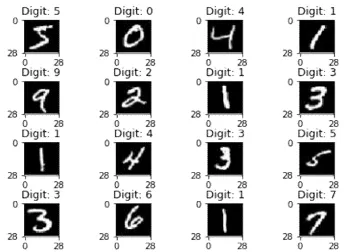

Tải tập dữ liệu MNIST để đào tạo và kiểm tra hình ảnh. Hàm này tải tập dữ liệu, bao gồm các hình ảnh chữ số viết tay và nhãn tương ứng của chúng. Dữ liệu được chia thành các tập huấn luyện và kiểm tra.

(X_train, y_train), (X_test,y_test) = mnist.load_data()

Đầu ra:

Định hình lại

Chức năng định hình lại trong ngữ cảnh này đang điều chỉnh hình dạng của hình ảnh để làm cho chúng phù hợp để xử lý trong CNN. Hình dạng (28, 28, 1) biểu thị rằng hình ảnh có kích thước 28×28 pixel và có một kênh duy nhất (hình ảnh thang độ xám). Việc chuyển đổi này là cần thiết vì hầu hết các CNN đều mong muốn hình ảnh có hình dạng cụ thể, thường được biểu thị dưới dạng (chiều rộng, chiều cao, kênh).

#perfoming reshape

X_train = X_train.reshape(X_train.shape[0],28,28,1)

X_test = X_test.reshape(X_test.shape[0],28,28,1)

# Check the shape of data

X_train.shapeBình thường hóa

Đoạn mã bạn đã cung cấp sẽ chuẩn hóa các giá trị pixel hình ảnh trong tập dữ liệu huấn luyện và kiểm tra. Việc chia mỗi giá trị pixel cho 255 đảm bảo rằng các giá trị pixel nằm trong khoảng từ 0 đến 1.

# Normalization ---> convert 0 to 1

X_train = X_train/255

X_test = X_test/255

Một mã hóa nóng

Các lớp của tập dữ liệu MNIST được chuyển đổi thành dữ liệu phân loại với 10 lớp. Mỗi nhãn được chuyển đổi thành một vectơ trong đó mỗi phần tử đại diện cho một lớp, với 1 trong chỉ mục tương ứng với lớp đó và 0 ở nơi khác.

# One hot encoding

y_train = keras.utils.to_categorical(y_train,10)

y_test = keras.utils.to_categorical(y_test,10)Xây dựng mô hình

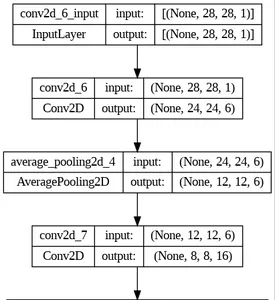

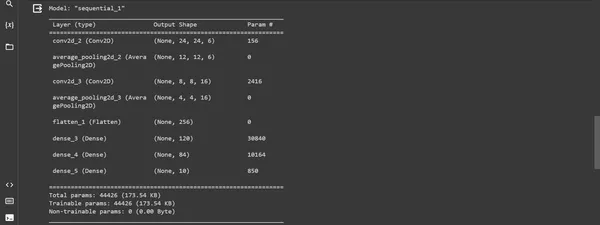

Đoạn mã này minh họa việc xây dựng mô hình LeNet-5 bằng API tuần tự Keras trong TensorFlow. Nó xác định các lớp cũng như cấu hình của chúng và biên dịch mô hình với trình tối ưu hóa, hàm mất mát và số liệu để đánh giá.

model = Sequential()

# first layer

model.add(Conv2D(6, kernel_size=(5,5), padding="valid", activation="tanh", input_shape =(28,28,1)))

model.add(AveragePooling2D(pool_size=(2,2),strides=2, padding='valid'))

#second layer

model.add(Conv2D(16, kernel_size=(5,5), padding="valid", activation="tanh"))

model.add(AveragePooling2D(pool_size=(2,2),strides=2, padding='valid'))

# flatten layer

model.add(Flatten())

# ANN

model.add(Dense(120, activation='tanh'))

model.add(Dense(84, activation='tanh'))

model.add(Dense(10, activation='softmax'))

model.summary()Đầu ra:

Biên dịch mô hình

Sản phẩm “biên dịch” chuẩn bị cho mô hình đào tạo bằng cách xác định phương pháp tối ưu hóa, hàm mất mát và các số liệu cần theo dõi.

model.compile(loss= keras.metrics.categorical_crossentropy, optimizer =keras.optimizers.Adam(),

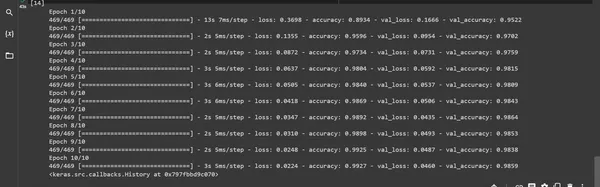

metrics= ['accuracy'])Đào tạo mô hình: "phù hợp với ” huấn luyện mô hình bằng cách sử dụng dữ liệu huấn luyện được cung cấp và xác thực nó bằng dữ liệu thử nghiệm.

model.fit(X_train,y_train, batch_size=128,epochs=10 , verbose=1, validation_data=(X_test,y_test))đầu ra:

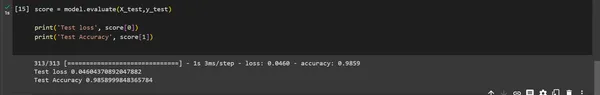

Đánh giá mô hình

Ngươi mâu "đánh giá()" được sử dụng để đánh giá hiệu suất của mô hình trên tập dữ liệu thử nghiệm. Kết quả cung cấp độ mất kiểm tra và độ chính xác kiểm tra.

score = model.evaluate(X_test,y_test)

print('Test loss', score[0])

print('Test Accuracy', score[1])

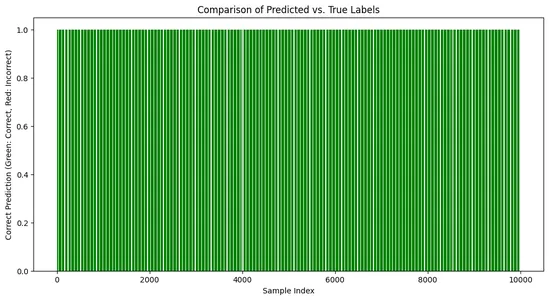

Hình dung:

# Create a bar chart to visualize the comparison

import matplotlib.pyplot as plt

predicted_labels = np.argmax(predictions, axis=1)

# Compare predicted labels with true labels

correct_predictions = np.equal(predicted_labels, np.argmax(y_test, axis=1))

plt.figure(figsize=(12, 6))

plt.bar(range(len(y_test)), correct_predictions,

color=['green' if c else 'red' for c in correct_predictions])

plt.title('Comparison of Predicted vs. True Labels')

plt.xlabel('Sample Index')

plt.ylabel('Correct Prediction (Green: Correct, Red: Incorrect)')

plt.show()Đầu ra:

Tác động và ý nghĩa của LeNet

Ảnh hưởng của LeNet vượt xa nhiệm vụ ban đầu của nó. Thành công của nó đã mở đường cho việc khám phá sâu hơn về mạng lưới thần kinh tích chập (CNN). Thiết kế và hiệu suất hiệu quả của nó đối với các tác vụ nhận dạng chữ số đã tạo tiền đề cho những tiến bộ trong các ứng dụng thị giác máy tính khác nhau, bao gồm phân loại hình ảnh, phát hiện đối tượng và nhận dạng khuôn mặt.

- Cuộc cách mạng trong nhận dạng ký tự viết tay: Thành công của LeNet-5 trong việc nhận dạng các chữ số và ký tự viết tay đã dẫn đến sự chuyển đổi trong nhiều ứng dụng thực tế khác nhau, đặc biệt là trong việc nhận dạng mã zip và séc bưu chính. Khả năng nhận dạng chính xác các ký tự của nó đã góp phần giúp các ứng dụng này áp dụng rộng rãi mạng lưới thần kinh.

- Ảnh hưởng đến kiến trúc tương lai: Nguyên tắc thiết kế kiến trúc của LeNet đã đặt nền móng cho nhiều mô hình CNN tiếp theo. Việc sử dụng sáng tạo tích chập, lấy mẫu con và các lớp được kết nối đầy đủ đã truyền cảm hứng cho sự phát triển các kiến trúc mạng thần kinh phức tạp và phức tạp hơn cho các tác vụ dựa trên hình ảnh khác nhau.

- Thúc đẩy học tập sâu: Thành công của LeNet-5 đã chứng minh tiềm năng của mạng học sâu trong nhận dạng hình ảnh, truyền cảm hứng cho nghiên cứu và phát triển sâu hơn trong lĩnh vực này. Tác động của nó đối với cộng đồng nghiên cứu đã dẫn đến sự thay đổi mô hình theo hướng sử dụng mạng lưới thần kinh sâu cho các nhiệm vụ dựa trên tầm nhìn khác nhau và đặt nền móng cho những tiến bộ tiếp theo trong lĩnh vực này.

Ứng dụng của LeNet

Tác động của LeNet mở rộng đến nhiều ứng dụng trong thế giới thực. Từ nhận dạng chữ số viết tay trong dịch vụ bưu chính đến cách mạng hóa hoạt động chăm sóc sức khỏe bằng cách hỗ trợ phân tích hình ảnh y tế, các khái niệm nền tảng của LeNet đã ảnh hưởng đến vô số lĩnh vực.

- Xử lý văn bản: Khả năng của LeNet đã được sử dụng trong việc quét và phân tích tài liệu, phân tích cú pháp và xử lý các loại thông tin khác nhau, trích xuất dữ liệu từ tài liệu và tự động hóa các tác vụ nhập dữ liệu trong các ngành khác nhau.

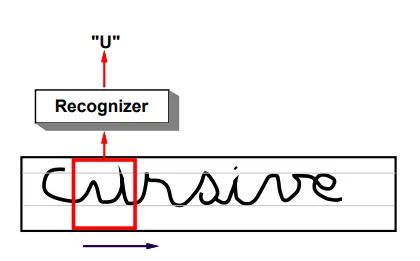

- Nhận dang chu Viet: Thành công của LeNet trong việc nhận dạng các ký tự và chữ số viết tay vẫn là nền tảng trong hệ thống Nhận dạng Ký tự Quang học (OCR) được sử dụng để xử lý văn bản viết tay trong séc ngân hàng, dịch vụ bưu chính và biểu mẫu. Nó có thể áp dụng trong việc số hóa các tài liệu lịch sử và nhận dạng thông tin viết tay ở nhiều định dạng khác nhau.

- Xác thực sinh trắc học: Khả năng nhận dạng chữ viết tay của LeNet đã được áp dụng để phân tích chữ ký và dấu vân tay, cho phép thực hiện các phương pháp xác thực sinh trắc học và tăng cường hệ thống bảo mật.

- Phân tích video thời gian thực: Các khái niệm nền tảng trong LeNet làm cơ sở cho việc phân tích video theo thời gian thực, chẳng hạn như theo dõi đối tượng, hệ thống giám sát, nhận dạng khuôn mặt và xe tự hành.

- Phân loại hình ảnh: Nguyên tắc của LeNet ảnh hưởng đến hệ thống phân loại hình ảnh hiện đại. Các ứng dụng bao gồm phân loại và phân loại các đối tượng trong hình ảnh cho nhiều lĩnh vực, chẳng hạn như xác định đối tượng trong ảnh, kiểm soát chất lượng trong sản xuất, phân tích hình ảnh y tế và hệ thống bảo mật để nhận dạng đối tượng.

Những thách thức và hạn chế của LeNet

- Hiệu quả trích xuất tính năng: Với sự phát triển của kiến trúc mạng thần kinh, các mô hình mới hơn có cách trích xuất tính năng hiệu quả hơn, khiến LeNet tương đối kém hiệu quả hơn trong việc xác định các mẫu và tính năng phức tạp.

- Khả năng thích ứng hạn chế: Kiến trúc của nó, được thiết kế cho các tác vụ cụ thể như nhận dạng ký tự viết tay, có thể không được chuyển trực tiếp sang các miền khác nếu không có những sửa đổi đáng kể.

- khả năng mở rộng: Mặc dù là mô hình tiên phong, LeNet có thể thiếu khả năng mở rộng để thích ứng với nhu cầu xử lý dữ liệu hiện đại và học sâu.

- Trang bị quá mức: LeNet có thể gặp phải tình trạng trang bị quá mức khi xử lý các bộ dữ liệu phức tạp hơn, đòi hỏi các kỹ thuật chính quy hóa bổ sung để giảm thiểu vấn đề này.

Các nhà nghiên cứu đã phát triển các kiến trúc CNN phức tạp hơn để khắc phục những hạn chế này, kết hợp các kỹ thuật phức tạp để giải quyết những thách thức này đồng thời cải thiện hiệu suất của nhiều nhiệm vụ khác nhau.

Kết luận

LeNet, với tư cách là mạng nơ-ron tích chập ban đầu, là một cột mốc quan trọng trong lĩnh vực học sâu. Sự khởi đầu của Yann LeCun và nhóm nghiên cứu đã đánh dấu một bước đột phá, đặc biệt là trong lĩnh vực nhận dạng ký tự viết tay và phân tích hình ảnh. LeNet phải đối mặt với những thách thức trong việc thích ứng với các nhiệm vụ phức tạp hiện đại và bộ dữ liệu đa dạng do tính đơn giản về kiến trúc và khả năng trang bị quá mức. Di sản của nó vẫn còn quan trọng, truyền cảm hứng cho các kiến trúc tiên tiến hơn và đóng vai trò quan trọng trong việc phát triển các mô hình học sâu.

Sự ra đời của LeNet đánh dấu một thời điểm quan trọng trong lịch sử học sâu. Thành công của nó trong các nhiệm vụ và nguyên tắc nhận dạng hình ảnh đã tạo tiền đề cho sự phát triển của mạng lưới thần kinh tích chập hiện đại. Di sản lâu dài của nó tiếp tục định hình bối cảnh thị giác máy tính và trí tuệ nhân tạo.

Chìa khóa chính

- Nó giới thiệu khái niệm về các lớp tích chập và lấy mẫu con, đặt nền tảng cho các kiến trúc học sâu hiện đại.

- Mặc dù LeNet đã đạt được những tiến bộ đáng kể vào thời điểm đó nhưng những hạn chế của nó trong việc xử lý các bộ dữ liệu đa dạng và phức tạp đã trở nên rõ ràng.

- Giới thiệu các lớp tích chập và lấy mẫu con, cách mạng hóa việc học sâu.

Những câu hỏi thường gặp

Trả lời: LeNet là mạng nơ-ron tích chập (CNN) được thiết kế bởi Yann LeCun và nhóm của ông vào những năm 1990. Nó được phát triển để nhận dạng ký tự viết tay và phân tích hình ảnh.

Trả lời: Các ứng dụng của LeNet là nhận dạng ký tự quang học, nhận dạng chữ số và chữ cái cũng như các nhiệm vụ phân loại hình ảnh trong hệ thống bảo mật và chăm sóc sức khỏe.

Trả lời: LeNet đóng vai trò quan trọng như một trong những ứng dụng thành công sớm nhất của CNN. Nó đóng vai trò là nền tảng trong việc phát triển mạng lưới thần kinh cho các nhiệm vụ nhận dạng hình ảnh.

Đáp: Thành công của LeNet đã dẫn đến một làn sóng quan tâm đến mạng lưới thần kinh, những tiến bộ tiếp theo trong lĩnh vực thị giác máy tính và học sâu. Nguyên tắc thiết kế và kiến trúc của nó đã ảnh hưởng đến sự phát triển của nhiều mô hình AI hiện đại.

Trả lời: Kiến trúc của LeNet đã giới thiệu khái niệm trích xuất tính năng phân cấp thông qua các lớp tích chập. Cho phép nhận dạng mẫu hiệu quả, vốn đã trở thành tiêu chuẩn trong các mô hình học sâu hiện đại.

Phương tiện hiển thị trong bài viết này không thuộc sở hữu của Analytics Vidhya và được sử dụng theo quyết định riêng của Tác giả.

Sản phẩm liên quan

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoData.Network Vertical Generative Ai. Trao quyền cho chính mình. Truy cập Tại đây.

- PlatoAiStream. Thông minh Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Trung tâmESG. Than đá, công nghệ sạch, Năng lượng, Môi trường Hệ mặt trời, Quản lý chất thải. Truy cập Tại đây.

- PlatoSức khỏe. Tình báo thử nghiệm lâm sàng và công nghệ sinh học. Truy cập Tại đây.

- nguồn: https://www.analyticsvidhya.com/blog/2023/11/lenet-architectural-insights-and-practical-implementation/