Giới thiệu

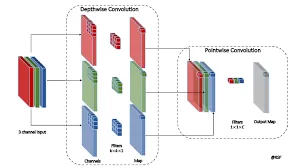

Mạng thần kinh tích chập (CNN) đã đóng vai trò quan trọng trong việc hiểu hình ảnh và mô hình, thay đổi bối cảnh của deep learning. Hành trình bắt đầu với việc Yan giới thiệu kiến trúc LeNet và ngày nay, chúng tôi có nhiều CNN để lựa chọn. Theo truyền thống, các mạng này phụ thuộc rất nhiều vào các lớp được kết nối đầy đủ, đặc biệt là khi sắp xếp mọi thứ thành các danh mục khác nhau. Nhưng chờ đã, có một sự thay đổi trong không khí. Chúng tôi đang khám phá một kiến trúc khác sử dụng Pointwise Convolution—một phương pháp mới và cải tiến dành cho CNN. Nó giống như đi một con đường mới. Cách tiếp cận này thách thức việc sử dụng thông thường các lớp được kết nối đầy đủ, mang lại một số lợi ích thú vị giúp mạng của chúng ta thông minh hơn và nhanh hơn. Hãy cùng tham gia khám phá này với chúng tôi khi chúng tôi đi sâu tìm hiểu về Phép biến đổi theo chiều và khám phá cách nó giúp mạng của chúng tôi hoạt động hiệu quả hơn và hoạt động tốt hơn.

Mục tiêu học tập

- Hiểu hành trình của Mạng thần kinh chuyển đổi (CNN) từ các mô hình ban đầu như LeNet đến các kiến trúc đa dạng được sử dụng ngày nay.

- Khám phá các vấn đề liên quan đến cường độ tính toán và mất thông tin không gian liên quan đến các lớp được kết nối đầy đủ truyền thống trong CNN.

- Khám phá cách thay thế trích xuất tính năng hiệu quả trong CNN

- Phát triển các kỹ năng thực tế triển khai Pointwise Convolution trong CNN, bao gồm các nhiệm vụ như sửa đổi mạng và điều chỉnh siêu tham số.

Bài báo này đã được xuất bản như một phần của Blogathon Khoa học Dữ liệu.

Mục lục

Hiểu các lớp được kết nối đầy đủ

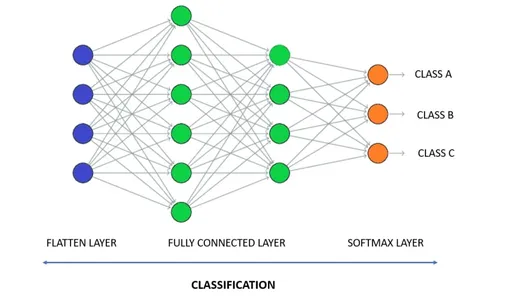

Trong Mạng thần kinh chuyển đổi truyền thống (CNN), các lớp được kết nối đầy đủ đóng vai trò quan trọng trong việc kết nối tất cả các nơ-ron từ lớp này sang lớp khác, tạo thành cấu trúc kết nối dày đặc. Sử dụng các lớp này trong các tác vụ như phân loại hình ảnh, trong đó mạng học cách liên kết các tính năng cụ thể với các lớp cụ thể.

Những điểm chính

- Kết nối toàn cầu: Các lớp được kết nối đầy đủ tạo ra một kết nối toàn cầu, cho phép mỗi nơ-ron trong một lớp được kết nối với mọi nơ-ron ở lớp tiếp theo.

- Cường độ tham số: Số lượng tham số tuyệt đối trong các lớp được kết nối đầy đủ có thể làm tăng đáng kể số lượng tham số của mô hình.

- Mất thông tin không gian: Việc làm phẳng dữ liệu đầu vào trong các lớp được kết nối đầy đủ có thể dẫn đến mất thông tin không gian từ ảnh gốc, đây có thể là một nhược điểm trong các ứng dụng cụ thể.

- Cường độ tính toán: Tải tính toán liên quan đến các lớp được kết nối đầy đủ có thể rất đáng kể, đặc biệt khi mạng có quy mô lớn.

Cách sử dụng trong thực tế

- Sau các lớp chập: Các lớp được kết nối đầy đủ thường được sử dụng sau các lớp tích chập trong kiến trúc CNN, trong đó các lớp tích chập trích xuất các tính năng từ dữ liệu đầu vào.

- Lớp dày đặc: Trong một số trường hợp, các lớp được kết nối đầy đủ được gọi là các lớp “dày đặc”, nêu bật vai trò của chúng trong việc kết nối tất cả các nơ-ron.

Nhu cầu thay đổi là gì?

Bây giờ chúng ta đã hiểu cơ bản về các lớp được kết nối đầy đủ trong Mạng thần kinh chuyển đổi thông thường (CNN), hãy nói về lý do tại sao một số người lại tìm kiếm thứ gì đó khác biệt. Mặc dù các lớp được kết hợp đầy đủ thực hiện tốt công việc của chúng nhưng chúng cũng có một số thách thức. Chúng có thể hơi nặng trên máy tính, sử dụng nhiều thông số và đôi khi làm mất đi những chi tiết cần thiết trong bức ảnh.

Tại sao chúng tôi khám phá điều gì đó mới:

- Trục trặc được kết nối đầy đủ: Hãy nghĩ về các lớp được kết nối đầy đủ giống như một người làm việc chăm chỉ với một vài trục trặc – chúng có hiệu quả nhưng cũng có nhiều thách thức.

- Tìm kiếm những cách thông minh hơn: Mọi người tìm kiếm những cách sáng tạo và hiệu quả hơn để xây dựng những mạng lưới này mà không gặp phải những trục trặc này.

- Làm mọi thứ tốt hơn: Mục tiêu là làm cho các mạng này hoạt động tốt hơn nữa – nhanh hơn, thông minh hơn và sử dụng ít sức mạnh tính toán hơn.

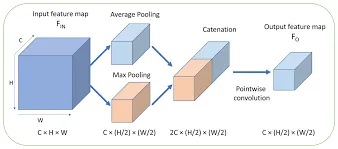

Hiểu về phép chập theo chiều điểm

Bây giờ chúng ta đang quan tâm đến việc làm cho mạng của mình thông minh hơn và hiệu quả hơn, hãy tìm hiểu về Pointwise Convolution, một công cụ thay đổi cuộc chơi trong thế giới Mạng thần kinh chuyển đổi (CNN).

Làm quen với phép tích chập theo điểm

- Tích chập theo điểm là gì? Nó giống như một công cụ mới trong bộ công cụ của chúng tôi để xây dựng CNN. Thay vì kết nối mọi thứ trên toàn cầu như các lớp được kết nối đầy đủ, nó tập trung hơn một chút.

- Thay đổi lộ trình: Nếu các lớp được kết nối đầy đủ giống như đường cao tốc chính thì Pointwise Convolution giống như tìm một lối tắt gọn gàng—nó giúp chúng ta đến nơi mình muốn nhanh hơn.

- Nâng ít nặng hơn: Một điều thú vị về Pointwise Convolution là nó có thể thực hiện công việc của mình mà không cần sử dụng nhiều sức mạnh máy tính như các lớp được kết nối đầy đủ.

Tích chập theo chiều hoạt động như thế nào?

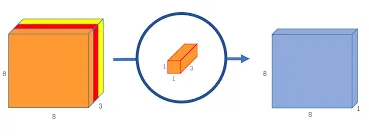

- Tính toán tập trung: Pointwise Convolution giống như thực hiện một phép tính nhỏ tại mỗi điểm cụ thể trong dữ liệu của chúng tôi. Nó tập trung hơn, nhìn vào từng điểm riêng lẻ hơn là toàn bộ bức tranh.

- Kí hiệu: Chúng tôi thường biểu thị phép chập theo chiều điểm bằng thuật ngữ tích chập 1×11×1 vì nó giống như xem xét một điểm duy nhất trong dữ liệu của chúng tôi tại một thời điểm, do đó “1×1.”

Ưu điểm của phép tích chập theo chiều điểm

Bây giờ chúng ta đã nắm rõ về Pointwise Convolution, hãy tìm hiểu lý do tại sao nó lại thu hút được sự chú ý như một giải pháp thay thế thú vị trong Mạng thần kinh chuyển đổi (CNN).

Điều gì làm cho sự tích chập theo chiều nổi bật:

- Giảm tải tính toán: Không giống như các lớp được kết nối đầy đủ đòi hỏi tính toán nặng nề, Pointwise Convolution tập trung vào các điểm cụ thể, giúp quy trình tổng thể hiệu quả hơn.

- Hiệu suất tham số: Với ký hiệu 1×11×1, Pointwise Convolution không cần nhiều tham số, giúp mạng của chúng ta bớt phức tạp hơn và dễ quản lý hơn.

- Bảo tồn thông tin không gian: Hãy nhớ rằng các thông tin về vũ trụ đôi khi chúng ta thua? Pointwise Convolution giúp giữ nguyên vẹn, điều này cực kỳ tiện dụng trong các tác vụ như xử lý hình ảnh.

Ví dụ về tích chập theo chiều đang hoạt động:

Bây giờ chúng ta đã giải thích lý do tại sao Pointwise Convolution là một cách tiếp cận đầy hứa hẹn, hãy cùng đi sâu vào một số ví dụ thực tế về Mạng thần kinh chuyển đổi (CNN) trong đó Pointwise Convolution đã được triển khai thành công.

1. Mạng di động

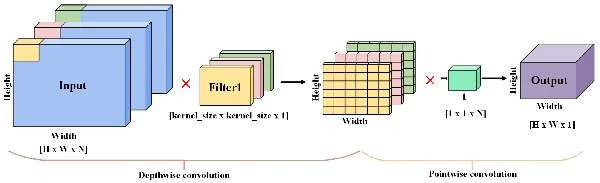

- MobileNet là gì? MobileNet là kiến trúc CNN chuyên dụng được thiết kế cho thiết bị di động và thiết bị biên, nơi tài nguyên tính toán có thể bị hạn chế.

- Vai trò của phép chập theo chiều điểm: Pointwise Convolution là nhân tố chủ chốt trong MobileNet, đặc biệt là trong kiến trúc thắt cổ chai. Nó giúp giảm số lượng tính toán và tham số, giúp MobileNet hoạt động hiệu quả trên các thiết bị có hạn chế về tài nguyên.

- Va chạm: Bằng cách tận dụng Pointwise Convolution, MobileNet cân bằng độ chính xác và hiệu quả tính toán, khiến nó trở thành lựa chọn phổ biến cho các ứng dụng đang di chuyển.

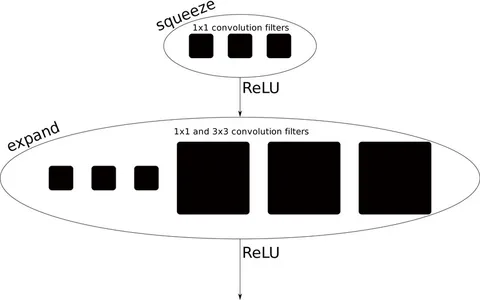

2. BópNet

- SqueezeNet là gì? SqueezeNet là kiến trúc CNN nhấn mạnh vào việc nén mô hình—đạt được độ chính xác cao với ít tham số hơn.

- Vai trò của phép chập theo chiều điểm: Pointwise Convolution là một phần không thể thiếu cho sự thành công của SqueezeNet. Nó thay thế các bộ lọc tích chập lớn hơn, giảm số lượng tham số và cho phép đào tạo và triển khai mô hình hiệu quả.

- Ưu điểm: Việc sử dụng Pointwise Convolution của SqueezeNet cho thấy cách tiếp cận này có thể giảm đáng kể kích thước mô hình mà không làm giảm hiệu suất, khiến nó phù hợp với các môi trường có nguồn lực hạn chế.

3. Mạng hiệu quả

- Giới thiệu chung: Hiệu quảNet là một nhóm kiến trúc CNN nổi tiếng với việc đạt được hiệu suất tiên tiến trong khi vẫn duy trì hiệu quả.

- Vai trò của phép chập theo chiều điểm: Pointwise Convolution được sử dụng một cách chiến lược trong EffielNet để cân bằng độ phức tạp của mô hình và hiệu quả tính toán trên các quy mô mạng khác nhau (B0 đến B7).

- Tầm quan trọng: Việc kết hợp Pointwise Convolution góp phần nâng cao khả năng của EfficiencyNet đạt được độ chính xác cao với ít thông số hơn.

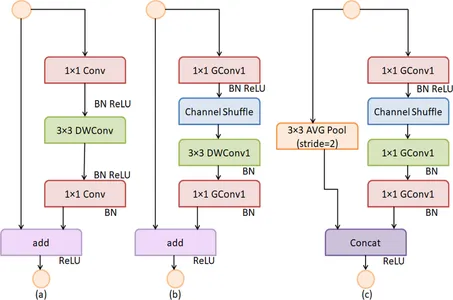

4. ShuffleNet

- Giới thiệu về ShuffleNet: ShuffleNet được thiết kế để cải thiện hiệu quả tính toán bằng cách giới thiệu tính năng xáo trộn kênh và tích chập nhóm theo điểm.

- Vai trò của phép chập theo chiều điểm: Pointwise Convolution là thành phần cơ bản trong thiết kế của ShuffleNet, giúp giảm số lượng tham số và tính toán.

- Va chạm: Sự kết hợp giữa xáo trộn kênh và Pointwise Convolution cho phép ShuffleNet cân bằng độ chính xác của mô hình và hiệu quả tính toán, khiến nó phù hợp để triển khai trên các thiết bị có giới hạn tài nguyên.

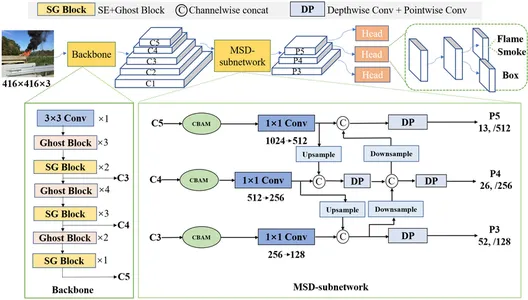

5. GhostNet:

- Tổng quan về GhostNet: GhostNet là kiến trúc CNN nhẹ được thiết kế để đào tạo và triển khai hiệu quả, tập trung vào việc giảm yêu cầu về bộ nhớ và tính toán.

- Vai trò của phép chập theo chiều điểm: Pointwise Convolution được sử dụng trong GhostNet để giảm số lượng tham số và nâng cao hiệu quả tính toán.

- Lợi ích: Sử dụng Pointwise Convolution, GhostNet đạt được độ chính xác cạnh tranh với nhu cầu tính toán thấp hơn, khiến nó phù hợp với các ứng dụng có nguồn lực hạn chế.

6. MnasNet:

- Giới thiệu MnasNet: MnasNet là kiến trúc CNN hướng đến thiết bị di động được phát triển đặc biệt nhấn mạnh đến hiệu suất và hiệu suất trong các thiết bị di động và thiết bị biên.

- Vai trò của phép chập theo chiều điểm: Pointwise Convolution là thành phần chính trong MnasNet, góp phần tạo nên hiệu quả và thiết kế gọn nhẹ của mô hình.

- Hiệu suất: MnasNet giới thiệu cách Pointwise Convolution cho phép tạo ra các mô hình nhỏ gọn nhưng mạnh mẽ phù hợp với các ứng dụng di động.

7. Ngoại lệ:

- Tổng quan về Xception: Xception (Extreme Inception) là kiến trúc CNN lấy cảm hứng từ kiến trúc Inception, nhấn mạnh vào các tích chập có thể phân tách theo chiều sâu.

- Vai trò của phép chập theo chiều điểm: Pointwise Convolution được sử dụng trong giai đoạn cuối cùng của Xception, hỗ trợ tích hợp tính năng và giảm kích thước.

- Ưu điểm: Việc tích hợp Pointwise Convolution góp phần vào khả năng của Xception trong việc nắm bắt các tính năng phức tạp trong khi vẫn duy trì hiệu quả tính toán.

8. Khởi đầuV3:

- Tổng quan: InceptionV3 là kiến trúc CNN được sử dụng rộng rãi thuộc dòng Inception. Nó được biết đến với sự thành công trong nhiệm vụ phân loại hình ảnh và phát hiện đối tượng.

- Vai trò của phép chập theo chiều điểm: Pointwise Convolution là thành phần cơ bản trong kiến trúc InceptionV3, góp phần xử lý hiệu quả các tính năng trên các độ phân giải không gian khác nhau.

- Ứng dụng: Được áp dụng trên nhiều lĩnh vực khác nhau, InceptionV3 thể hiện hiệu suất mạnh mẽ trong phân tích hình ảnh y tế trong lĩnh vực chăm sóc sức khỏe.

9. MobileNetV2:

- Giới thiệu về MobileNetV2: MobileNetV2 là phiên bản tiếp theo của MobileNet, được thiết kế cho thiết bị di động và thiết bị biên. Nó tập trung vào việc đạt được độ chính xác cao hơn và hiệu quả được cải thiện.

- Vai trò của phép chập theo chiều điểm: MobileNetV2 sử dụng rộng rãi Pointwise Convolution để hợp lý hóa và nâng cao kiến trúc bằng cách giảm tính toán và tham số.

- Tầm quan trọng: MobileNetV2 đã trở nên phổ biến để xử lý trên thiết bị do thiết kế gọn nhẹ, khiến nó phù hợp với các ứng dụng như nhận dạng hình ảnh trên thiết bị di động.

10. Phản hồi:

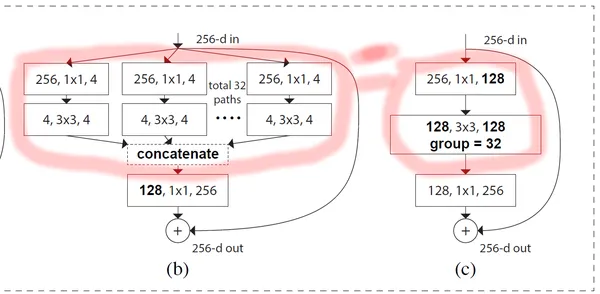

- Tổng quan về ResNeXt: ResNeXt, một biến thể của kiến trúc ResNet, nhấn mạnh tham số lượng số, cho phép mô hình nắm bắt được các biểu diễn tính năng phong phú hơn.

- Vai trò của phép chập theo chiều điểm: ResNeXt sử dụng Pointwise Convolution để nâng cao khả năng của mạng trong việc nắm bắt các tính năng đa dạng thông qua việc kết hợp tính năng linh hoạt.

- Va chạm: Việc sử dụng Pointwise Convolution trong ResNeXt góp phần mang lại thành công cho nó trong các nhiệm vụ phân loại hình ảnh, đặc biệt trong các tình huống mà các tính năng đa dạng là rất quan trọng.

Nghiên cứu trường hợp và so sánh

Bây giờ chúng ta đã khám phá một số Mạng thần kinh chuyển đổi (CNN) phổ biến tận dụng Chuyển đổi theo chiều kim đồng hồ. Hãy cùng điều tra các nghiên cứu trường hợp cụ thể và so sánh để hiểu cách các mạng này hoạt động trong các tình huống thực tế.

1. Phân loại hình ảnh: MobileNet so với VGG16

- Kịch bản: So sánh hiệu suất của MobileNet (sử dụng Pointwise Convolution để đạt hiệu quả) và VGG16 (kiến trúc truyền thống với các lớp được kết nối đầy đủ) trong các tác vụ phân loại hình ảnh.

- Các quan sát: Đánh giá độ chính xác, tốc độ tính toán và kích thước mô hình để thể hiện những ưu điểm của Pointwise Convolution về mặt hiệu quả mà không ảnh hưởng đến độ chính xác.

2. Triển khai thiết bị biên: MobileNetV2 so với InceptionV3

- Kịch bản: Kiểm tra tính hiệu quả và sự phù hợp của MobileNetV2 (tận dụng Pointwise Convolution) và InceptionV3 (kiến trúc truyền thống) để triển khai trên các thiết bị biên có tài nguyên tính toán hạn chế.

- Kết quả: Đánh giá sự cân bằng giữa độ chính xác của mô hình và nhu cầu tính toán, nêu bật những lợi ích của Tích chập theo chiều trong môi trường hạn chế về tài nguyên.

3. Phân đoạn ngữ nghĩa: U-Net so với GhostNet

- Kịch bản: Điều tra hiệu suất của U-Net (kiến trúc truyền thống để phân đoạn theo ngữ nghĩa) và GhostNet (kết hợp Pointwise Convolution để đạt hiệu quả) trong các nhiệm vụ phân đoạn hình ảnh y tế.

- Kết quả: Phân tích độ chính xác của phân đoạn, hiệu quả tính toán và các yêu cầu về bộ nhớ để cho thấy cách Convolution theo chiều hỗ trợ trong việc tối ưu hóa các mô hình cho các tác vụ phân đoạn.

Thực hiện tích chập theo chiều điểm

Bây giờ, hãy đi sâu vào các bước thực tế của việc tích hợp Pointwise Convolution vào kiến trúc Mạng thần kinh chuyển đổi (CNN). Chúng ta sẽ tập trung vào một ví dụ đơn giản để minh họa quá trình triển khai.

1. Sửa đổi mạng

- Xác định các lớp được kết nối đầy đủ trong kiến trúc CNN hiện tại mà bạn muốn thay thế bằng Pointwise Convolution.

# Original fully connected layer

model.add(Dense(units=256, activation='relu'))Thay thế bằng:

# Pointwise Convolution layer

model.add(Conv2D(filters=256, kernel_size=(1, 1), activation='relu'))2. Điều chỉnh kiến trúc

- Hãy xem xét vị trí của Pointwise Convolution trong mạng của bạn. Nó thường được sử dụng sau các lớp tích chập khác để nắm bắt và tinh chỉnh các tính năng một cách hiệu quả.

# Add Pointwise Convolution after a convolutional layer

model.add(Conv2D(filters=128, kernel_size=(3, 3), activation='relu'))

model.add(Conv2D(filters=256, kernel_size=(1, 1), activation='relu'))

# Pointwise Convolution3. Điều chỉnh siêu tham số

- Thử nghiệm kích thước hạt nhân và bước tiến dựa trên yêu cầu nhiệm vụ cụ thể của bạn.

# Fine-tune kernel size and stride

model.add(Conv2D(filters=256, kernel_size=(3, 3), strides=(1, 1), activation='relu'))

model.add(Conv2D(filters=512, kernel_size=(1, 1), strides=(1, 1), activation='relu'))

# Pointwise Convolution4. Kỹ thuật chính quy hóa

- Tăng cường tính ổn định và hội tụ bằng cách kết hợp chuẩn hóa hàng loạt.

# Batch normalization with Pointwise Convolution

model.add(Conv2D(filters=512, kernel_size=(1, 1), activation=None))

model.add(BatchNormalization())

model.add(Activation('relu'))5. Đánh giá mô hình

- So sánh hiệu suất của mạng đã sửa đổi với kiến trúc ban đầu.

# Original fully connected layer for comparison

model.add(Dense(units=512, activation='relu'))

Kết luận

Pointwise Convolution cải thiện đáng kể cách chúng tôi thiết kế Mạng thần kinh chuyển đổi (CNN). Nó cung cấp một tùy chọn tập trung và hiệu quả so với các lớp được kết nối đầy đủ thông thường. Đề xuất thử nghiệm để đánh giá khả năng ứng dụng và hiệu quả của Pointwise Convolution vì nó thay đổi tùy theo kiến trúc và nhiệm vụ cụ thể. Để Pointwise Convolution hoạt động trong mạng đòi hỏi phải có những thay đổi thông minh về kiến trúc và giải quyết một số thách thức. Nhìn về phía trước, việc sử dụng Pointwise Convolution gợi ý một sự thay đổi trong cách chúng ta thiết kế CNN, dẫn chúng ta tới các mạng hiệu quả hơn và dễ điều chỉnh hơn, tạo tiền đề cho nhiều tiến bộ hơn trong học sâu.

Chìa khóa chính

- Sự phát triển của CNN: Chứng kiến sự phát triển đáng kể từ LeNet đến các CNN đa dạng ngày nay.

- Những thách thức của các lớp được kết nối đầy đủ: Các lớp truyền thống phải đối mặt với các vấn đề như cường độ tính toán và mất thông tin không gian.

- Tích chập theo chiều điểm: Giải pháp thay thế đầy hứa hẹn với cách tiếp cận tập trung và hiệu quả để trích xuất đặc điểm.

- Ưu điểm: Giảm tải tính toán, cải thiện hiệu quả tham số và bảo toàn thông tin không gian.

- Impac trong thế giới thựct: Vai trò quan trọng trong việc tối ưu hóa hiệu suất mạng, được thấy trong các mô hình như MobileNet và SqueezeNet.

- Triển khai thực tế: Các bước bao gồm sửa đổi mạng, điều chỉnh kiến trúc, điều chỉnh siêu tham số và đánh giá mô hình.

Những câu hỏi thường gặp

A. Pointwise Convolution là một kỹ thuật Mạng thần kinh chuyển đổi (CNN) tập trung vào các điểm riêng lẻ, cung cấp giải pháp thay thế hiệu quả hơn cho các lớp được kết nối đầy đủ truyền thống.

A. Không giống như các lớp được kết nối đầy đủ, Pointwise Convolution hoạt động tại các điểm cụ thể trong đầu vào, giảm tải tính toán và lưu giữ thông tin không gian.

A. Tích chập theo chiều mang lại những ưu điểm như giảm tải tính toán, cải thiện hiệu suất tham số và bảo toàn thông tin không gian trong kiến trúc CNN.

A. Thử nghiệm xác định khả năng ứng dụng và hiệu quả của Pointwise Convolution, có thể thay đổi tùy theo kiến trúc và nhiệm vụ cụ thể.

A. Việc triển khai bao gồm sửa đổi mạng, điều chỉnh kiến trúc, điều chỉnh siêu tham số và xem xét các thách thức như trang bị quá mức để cải thiện hiệu quả.

Phương tiện hiển thị trong bài viết này không thuộc sở hữu của Analytics Vidhya và được sử dụng theo quyết định riêng của Tác giả.

Sản phẩm liên quan

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoData.Network Vertical Generative Ai. Trao quyền cho chính mình. Truy cập Tại đây.

- PlatoAiStream. Thông minh Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Trung tâmESG. Than đá, công nghệ sạch, Năng lượng, Môi trường Hệ mặt trời, Quản lý chất thải. Truy cập Tại đây.

- PlatoSức khỏe. Tình báo thử nghiệm lâm sàng và công nghệ sinh học. Truy cập Tại đây.

- nguồn: https://www.analyticsvidhya.com/blog/2023/11/exploring-pointwise-convolution-in-cnns-replacing-fully-connected-layers/