Hôm nay, chúng tôi vui mừng thông báo rằng mô hình nền tảng Falcon 180B do Viện Đổi mới Công nghệ (TII) phát triển và đào tạo trên Amazon SageMaker đã có sẵn cho khách hàng thông qua Khởi động Amazon SageMaker để triển khai chỉ bằng một cú nhấp chuột để chạy suy luận. Với kích thước 180 tỷ tham số và được đào tạo trên bộ dữ liệu khổng lồ 3.5 nghìn tỷ mã thông báo, Falcon 180B là mô hình lớn nhất và là một trong những mô hình hoạt động hiệu quả nhất với trọng số có thể truy cập công khai. Bạn có thể dùng thử mô hình này với SageMaker JumpStart, một trung tâm máy học (ML) cung cấp quyền truy cập vào các thuật toán, mô hình và giải pháp ML để bạn có thể nhanh chóng bắt đầu với ML. Trong bài đăng này, chúng tôi hướng dẫn cách khám phá và triển khai mô hình Falcon 180B thông qua SageMaker JumpStart.

Falcon 180B là gì

Falcon 180B là mẫu xe được phát hành bởi IIT tiếp theo các phiên bản trước đó trong gia đình Falcon. Đây là phiên bản mở rộng của Falcon 40B và sử dụng tính năng chú ý nhiều truy vấn để có khả năng mở rộng tốt hơn. Đó là mô hình ngôn ngữ tự động hồi quy sử dụng kiến trúc biến áp được tối ưu hóa. Nó được đào tạo trên 3.5 nghìn tỷ mã thông báo dữ liệu, chủ yếu bao gồm dữ liệu web từ Web tinh tế (khoảng 85%). Model có 180 phiên bản: 180B và 180B-Chat. 180B là mô hình thô, được đào tạo trước, cần được tinh chỉnh thêm cho hầu hết các trường hợp sử dụng. XNUMXB-Chat phù hợp hơn với việc thực hiện các hướng dẫn chung chung. Mô hình Trò chuyện đã được tinh chỉnh trên các tập dữ liệu trò chuyện và hướng dẫn cùng với một số tập dữ liệu hội thoại quy mô lớn.

Mô hình này được cung cấp theo Giấy phép Falcon-180B TII và Sự cho phép của chính trị.

Falcon 180B được TII huấn luyện trên Amazon SageMaker, trên một cụm GPU khoảng 4K A100. Nó sử dụng một cơ sở mã đào tạo phân tán tùy chỉnh có tên Gigatron, sử dụng tính song song 3D với ZeRO và các hạt nhân Triton hiệu suất cao, tùy chỉnh. Kiến trúc đào tạo phân tán được sử dụng Dịch vụ lưu trữ đơn giản của Amazon (Amazon S3) là dịch vụ hợp nhất duy nhất để tải dữ liệu cũng như ghi và đọc điểm kiểm tra, góp phần đặc biệt vào độ tin cậy của khối lượng công việc và tính đơn giản trong vận hành.

Khởi động SageMaker là gì

Với SageMaker JumpStart, những người thực hành ML có thể chọn từ danh sách ngày càng nhiều các mô hình nền tảng hoạt động tốt nhất. Người thực hành ML có thể triển khai các mô hình nền tảng cho các phiên bản SageMaker chuyên dụng trong môi trường mạng cách ly và tùy chỉnh các mô hình bằng cách sử dụng Amazon SageMaker để đào tạo và triển khai mô hình.

Bây giờ bạn có thể khám phá và triển khai Falcon 180B chỉ bằng vài cú nhấp chuột trong Xưởng sản xuất Amazon SageMaker hoặc lập trình thông qua SageMaker Python SDK, cho phép bạn lấy được hiệu suất mô hình và các điều khiển MLOps bằng các tính năng của SageMaker như Đường ống Amazon SageMaker, Trình gỡ lỗi Amazon SageMakerhoặc nhật ký vùng chứa. Mô hình này được triển khai trong môi trường bảo mật AWS và dưới sự kiểm soát VPC của bạn, giúp đảm bảo tính bảo mật dữ liệu. Falcon 180B có thể được khám phá và có thể được triển khai ở các Khu vực có sẵn các phiên bản cần thiết. Hiện tại, các phiên bản ml.p4de có sẵn ở Miền Đông Hoa Kỳ (Bắc Virginia) và Miền Tây Hoa Kỳ (Oregon).

Khám phá các mô hình

Bạn có thể truy cập các mô hình nền tảng thông qua SageMaker JumpStart trong giao diện người dùng SageMaker Studio và SageMaker Python SDK. Trong phần này, chúng ta sẽ tìm hiểu cách khám phá các mô hình trong SageMaker Studio.

SageMaker Studio là một môi trường phát triển tích hợp (IDE) cung cấp một giao diện trực quan dựa trên web duy nhất, nơi bạn có thể truy cập các công cụ chuyên dụng để thực hiện tất cả các bước phát triển ML, từ chuẩn bị dữ liệu đến xây dựng, đào tạo và triển khai các mô hình ML của bạn. Để biết thêm chi tiết về cách bắt đầu và thiết lập SageMaker Studio, hãy tham khảo Xưởng sản xuất Amazon SageMaker.

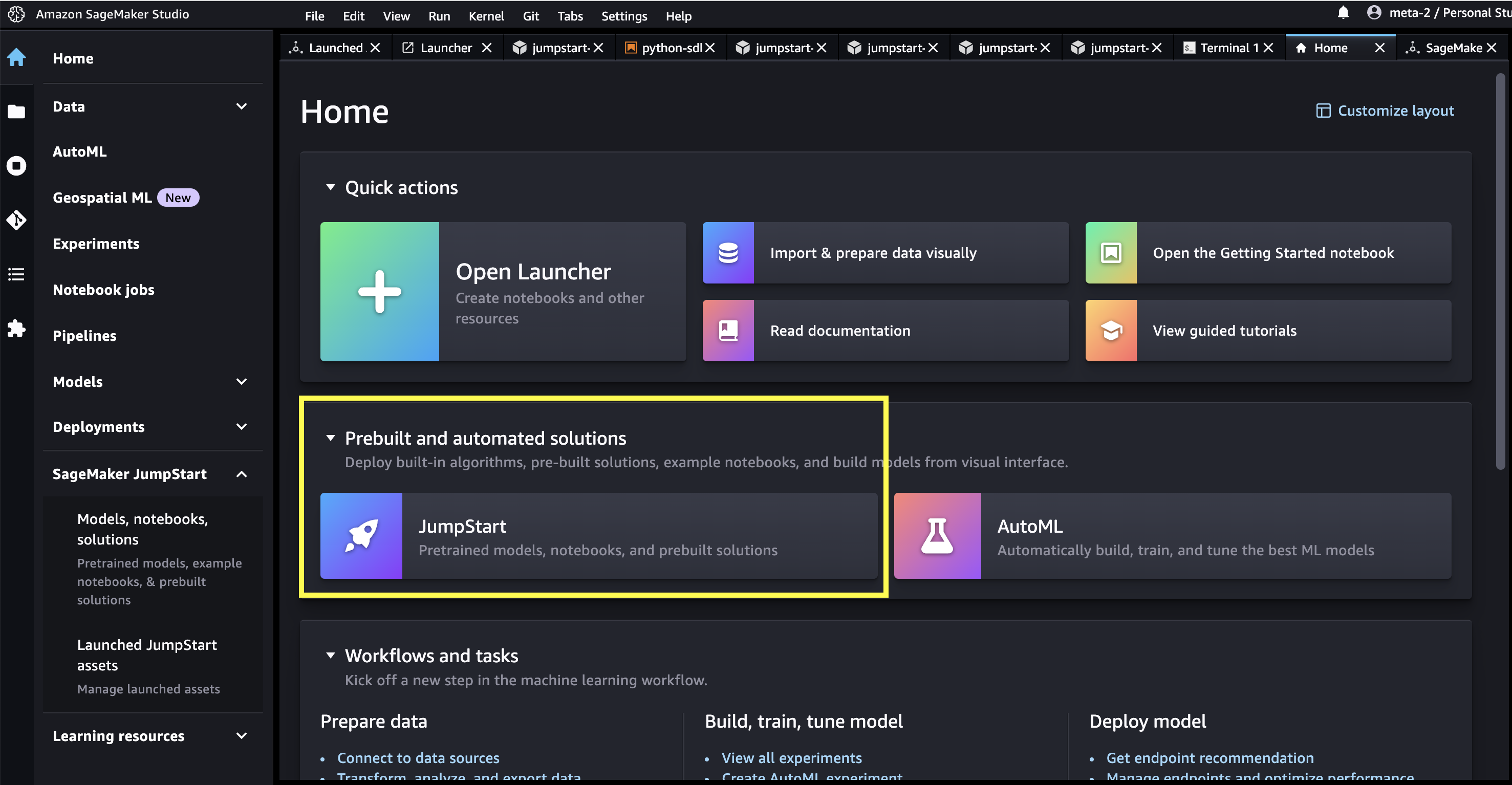

Trong SageMaker Studio, bạn có thể truy cập SageMaker JumpStart, nơi chứa các mô hình, sổ ghi chép và giải pháp dựng sẵn được đào tạo trước, trong Các giải pháp dựng sẵn và tự động.

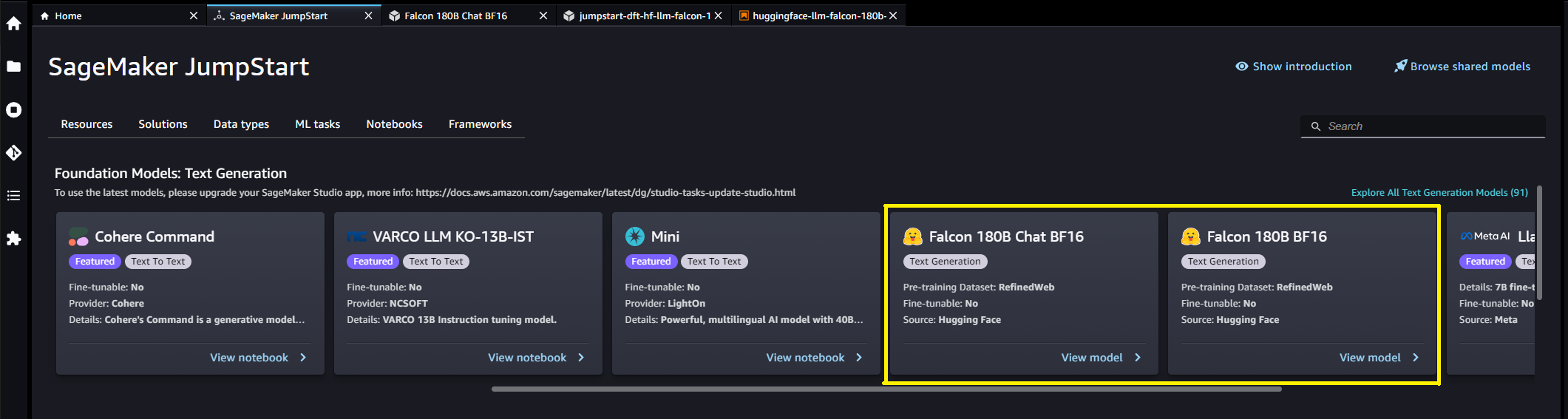

Từ trang đích SageMaker JumpStart, bạn có thể duyệt tìm giải pháp, mô hình, sổ ghi chép và các tài nguyên khác. Bạn có thể tìm thấy Falcon 180B trong Mô hình nền tảng: Tạo văn bản băng chuyền.

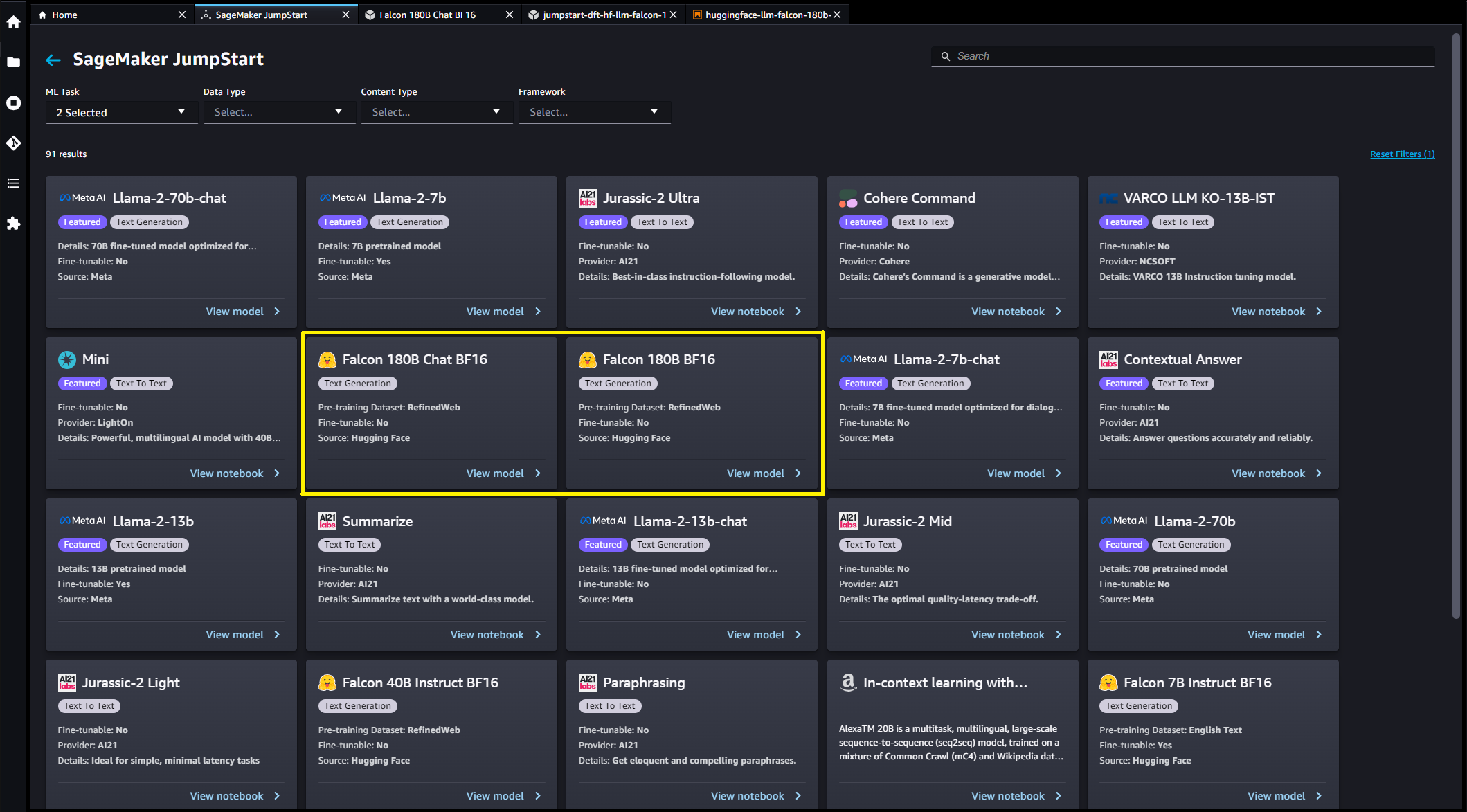

Bạn cũng có thể tìm thấy các biến thể mô hình khác bằng cách chọn Khám phá tất cả các Mô hình tạo văn bản hoặc tìm kiếm Falcon.

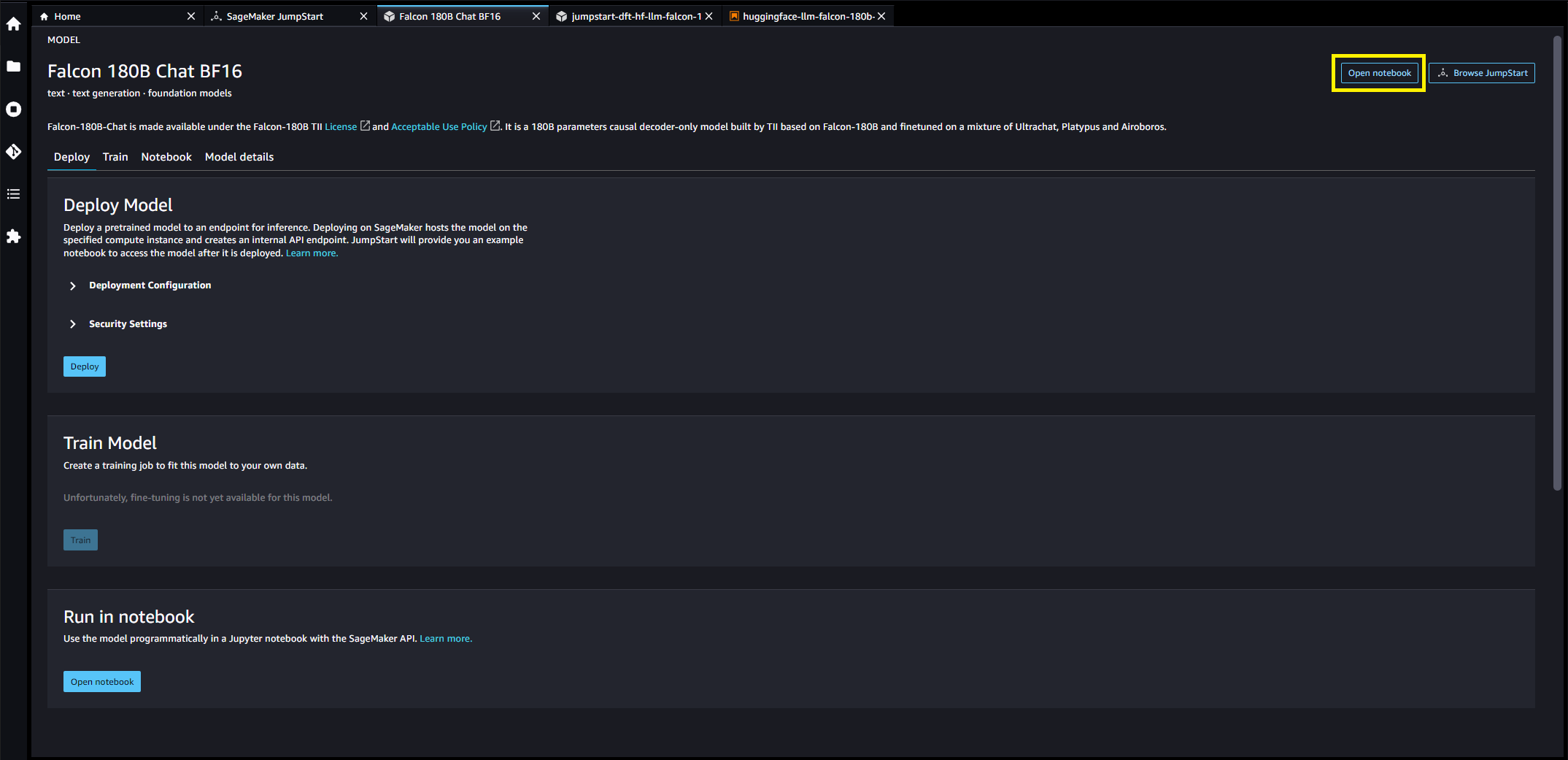

Bạn có thể chọn thẻ mô hình để xem thông tin chi tiết về mô hình như giấy phép, dữ liệu dùng để đào tạo và cách sử dụng. Bạn cũng sẽ tìm thấy hai nút, Triển khai và Mở Notebook, điều này sẽ giúp bạn sử dụng mô hình (ảnh chụp màn hình sau đây hiển thị Triển khai Tùy chọn).

Triển khai mô hình

Khi bạn chọn Triển khai, quá trình triển khai mô hình sẽ bắt đầu. Ngoài ra, bạn có thể triển khai thông qua sổ ghi chép mẫu hiển thị bằng cách chọn Mở Notebook. Sổ ghi chép ví dụ cung cấp hướng dẫn từ đầu đến cuối về cách triển khai mô hình để suy luận và dọn sạch tài nguyên.

Để triển khai bằng sổ ghi chép, chúng tôi bắt đầu bằng cách chọn một mô hình thích hợp, được chỉ định bởi model_id. Bạn có thể triển khai bất kỳ mô hình đã chọn nào trên SageMaker bằng mã sau:

Việc này sẽ triển khai mô hình trên SageMaker với các cấu hình mặc định, bao gồm loại phiên bản mặc định và cấu hình VPC mặc định. Bạn có thể thay đổi các cấu hình này bằng cách chỉ định các giá trị không mặc định trong JumpStartModel. Để tìm hiểu thêm, hãy tham khảo Tài liệu API. Sau khi triển khai, bạn có thể chạy suy luận dựa trên điểm cuối đã triển khai thông qua công cụ dự đoán SageMaker. Xem đoạn mã sau:

Các tham số suy luận kiểm soát quá trình tạo văn bản ở điểm cuối. Kiểm soát mã thông báo mới tối đa đề cập đến kích thước của đầu ra do mô hình tạo ra. Lưu ý rằng con số này không giống với số lượng từ vì từ vựng của mô hình không giống với từ vựng tiếng Anh và mỗi mã thông báo có thể không phải là một từ tiếng Anh. Nhiệt độ kiểm soát tính ngẫu nhiên ở đầu ra. Nhiệt độ cao hơn dẫn đến kết quả đầu ra sáng tạo và ảo giác hơn. Tất cả các tham số suy luận là tùy chọn.

Mô hình tham số 180B này có dung lượng 335GB và yêu cầu nhiều bộ nhớ GPU hơn để thực hiện đủ khả năng suy luận ở độ chính xác 16 bit. Hiện tại, JumpStart chỉ hỗ trợ mô hình này trên các phiên bản ml.p4de.24xlarge. Có thể triển khai mô hình lượng tử hóa 8 bit trên phiên bản ml.p4d.24xlarge bằng cách cung cấp env={"HF_MODEL_QUANTIZE": "bitsandbytes"} đối số từ khóa cho JumpStartModel hàm tạo và chỉ định instance_type="ml.p4d.24xlarge" đến phương pháp triển khai. Tuy nhiên, xin lưu ý rằng độ trễ trên mỗi mã thông báo chậm hơn khoảng 5 lần đối với cấu hình lượng tử hóa này.

Bảng sau liệt kê tất cả các mô hình Falcon có sẵn trong SageMaker JumpStart cùng với ID mô hình, loại phiên bản mặc định, tổng số mã thông báo tối đa (tổng số mã thông báo đầu vào và số lượng mã thông báo được tạo) được hỗ trợ và độ trễ phản hồi thông thường trên mỗi mã thông báo cho mỗi mô hình này.

| Tên Model | ID mô hình | Loại phiên bản mặc định | Tổng số mã thông báo tối đa | Độ trễ trên mỗi mã thông báo* |

| Chim Ưng 7B | huggingface-llm-falcon-7b-bf16 |

ml.g5.2xlarge | 2048 | 34 ms |

| Falcon 7B Hướng dẫn | huggingface-llm-falcon-7b-instruct-bf16 |

ml.g5.2xlarge | 2048 | 34 ms |

| Chim Ưng 40B | huggingface-llm-falcon-40b-bf16 |

ml.g5.12xlarge | 2048 | 57 ms |

| Falcon 40B Hướng dẫn | huggingface-llm-falcon-40b-instruct-bf16 |

ml.g5.12xlarge | 2048 | 57 ms |

| Chim Ưng 180B | huggingface-llm-falcon-180b-bf16 |

ml.p4de.24xlarge | 2048 | 45 ms |

| Trò chuyện Falcon 180B | huggingface-llm-falcon-180b-chat-bf16 |

ml.p4de.24xlarge | 2048 | 45 ms |

*độ trễ trên mỗi mã thông báo được cung cấp cho thời gian phản hồi trung bình của các lời nhắc ví dụ được cung cấp trong blog này; giá trị này sẽ thay đổi dựa trên độ dài của chuỗi đầu vào và đầu ra.

Suy luận và gợi ý ví dụ cho Falcon 180B

Mô hình Falcon có thể được sử dụng để hoàn thiện văn bản cho bất kỳ đoạn văn bản nào. Thông qua việc tạo văn bản, bạn có thể thực hiện nhiều nhiệm vụ khác nhau, chẳng hạn như trả lời câu hỏi, dịch ngôn ngữ, phân tích cảm xúc, v.v. Điểm cuối chấp nhận lược đồ tải trọng đầu vào sau:

Bạn có thể khám phá định nghĩa của những điều này thông số khách hàng và các giá trị mặc định của chúng trong kho lưu trữ suy luận tạo văn bản.

Sau đây là một số lời nhắc ví dụ mẫu và văn bản do mô hình tạo ra. Tất cả các kết quả đầu ra ở đây được tạo ra với các tham số suy luận {"max_new_tokens": 768, "stop": ["<|endoftext|>", "###"]}.

Xây dựng một trang web có thể được thực hiện trong 10 bước đơn giản:

Bạn có thể nhận thấy mô hình được huấn luyện trước này tạo ra các chuỗi văn bản dài không nhất thiết phải lý tưởng cho các trường hợp sử dụng hộp thoại. Trước khi chúng tôi trình bày cách hoạt động của mô hình trò chuyện được tinh chỉnh đối với một tập hợp lớn hơn các lời nhắc dựa trên hộp thoại, hai ví dụ tiếp theo minh họa cách sử dụng mô hình Falcon với phương pháp học tập trong ngữ cảnh ít lần, trong đó chúng tôi cung cấp các mẫu đào tạo có sẵn cho mô hình. Lưu ý rằng "học vài lần" không điều chỉnh trọng số mô hình - chúng tôi chỉ thực hiện suy luận về mô hình đã triển khai trong quá trình này đồng thời cung cấp một số ví dụ trong ngữ cảnh đầu vào để hỗ trợ đầu ra của mô hình bang hội.

Lời nhắc suy luận và ví dụ cho Falcon 180B-Chat

Với các mô hình Falcon 180B-Chat, được tối ưu hóa cho các trường hợp sử dụng đối thoại, đầu vào của điểm cuối mô hình trò chuyện có thể chứa lịch sử trước đó giữa trợ lý trò chuyện và người dùng. Bạn có thể đặt câu hỏi theo ngữ cảnh của cuộc trò chuyện đã diễn ra cho đến nay. Bạn cũng có thể cung cấp cấu hình hệ thống, chẳng hạn như cá tính, xác định hành vi của trợ lý trò chuyện. Tải trọng đầu vào đến điểm cuối giống như mẫu Falcon 180B ngoại trừ inputs giá trị chuỗi nên sử dụng định dạng sau:

Sau đây là một số lời nhắc ví dụ mẫu và văn bản do mô hình tạo ra. Tất cả các đầu ra được tạo với các tham số suy luận {"max_new_tokens":256, "stop": ["nUser:", "<|endoftext|>", " User:", "###"]}.

Trong ví dụ sau, người dùng đã trò chuyện với trợ lý về các địa điểm du lịch ở Paris. Tiếp theo, người dùng đang hỏi về tùy chọn đầu tiên được trợ lý trò chuyện đề xuất.

Làm sạch

Sau khi bạn chạy xong sổ ghi chép, hãy đảm bảo xóa tất cả tài nguyên mà bạn đã tạo trong quy trình để dừng thanh toán. Sử dụng mã sau đây:

Kết luận

Trong bài đăng này, chúng tôi đã hướng dẫn bạn cách bắt đầu với Falcon 180B trong SageMaker Studio và triển khai mô hình để suy luận. Vì các mô hình nền tảng được đào tạo trước nên chúng có thể giúp giảm chi phí đào tạo và cơ sở hạ tầng, đồng thời cho phép tùy chỉnh cho trường hợp sử dụng của bạn. Hãy truy cập SageMaker JumpStart trong SageMaker Studio ngay bây giờ để bắt đầu.

Thông tin

Về các tác giả

Tiến sĩ Kyle Ulrich là Nhà khoa học ứng dụng của nhóm Amazon SageMaker JumpStart. Lĩnh vực nghiên cứu của ông bao gồm các thuật toán học máy có thể mở rộng, thị giác máy tính, chuỗi thời gian, phi tham số Bayesian và quy trình Gaussian. Tiến sĩ của anh ấy đến từ Đại học Duke và anh ấy đã xuất bản các bài báo trên NeurIPS, Cell và Neuron.

Tiến sĩ Kyle Ulrich là Nhà khoa học ứng dụng của nhóm Amazon SageMaker JumpStart. Lĩnh vực nghiên cứu của ông bao gồm các thuật toán học máy có thể mở rộng, thị giác máy tính, chuỗi thời gian, phi tham số Bayesian và quy trình Gaussian. Tiến sĩ của anh ấy đến từ Đại học Duke và anh ấy đã xuất bản các bài báo trên NeurIPS, Cell và Neuron.

Tiến sĩ Ashish Khetan là Nhà khoa học ứng dụng cấp cao của Amazon SageMaker JumpStart và giúp phát triển các thuật toán máy học. Ông lấy bằng Tiến sĩ tại Đại học Illinois Urbana-Champaign. Ông là một nhà nghiên cứu tích cực về học máy và suy luận thống kê, đồng thời đã xuất bản nhiều bài báo tại các hội nghị NeurIPS, ICML, ICLR, JMLR, ACL và EMNLP.

Tiến sĩ Ashish Khetan là Nhà khoa học ứng dụng cấp cao của Amazon SageMaker JumpStart và giúp phát triển các thuật toán máy học. Ông lấy bằng Tiến sĩ tại Đại học Illinois Urbana-Champaign. Ông là một nhà nghiên cứu tích cực về học máy và suy luận thống kê, đồng thời đã xuất bản nhiều bài báo tại các hội nghị NeurIPS, ICML, ICLR, JMLR, ACL và EMNLP.

Olivier Cruchant là Kiến trúc sư giải pháp chuyên gia học máy chính tại AWS, có trụ sở tại Pháp. Olivier giúp khách hàng của AWS – từ các công ty khởi nghiệp nhỏ đến doanh nghiệp lớn – phát triển và triển khai các ứng dụng machine learning cấp sản xuất. Trong thời gian rảnh rỗi, anh thích đọc các tài liệu nghiên cứu và khám phá vùng hoang dã cùng bạn bè và gia đình.

Olivier Cruchant là Kiến trúc sư giải pháp chuyên gia học máy chính tại AWS, có trụ sở tại Pháp. Olivier giúp khách hàng của AWS – từ các công ty khởi nghiệp nhỏ đến doanh nghiệp lớn – phát triển và triển khai các ứng dụng machine learning cấp sản xuất. Trong thời gian rảnh rỗi, anh thích đọc các tài liệu nghiên cứu và khám phá vùng hoang dã cùng bạn bè và gia đình.

Karl Albertsen lãnh đạo trung tâm mô hình nền tảng, thuật toán và nhóm đối tác của Amazon SageMaker.

Karl Albertsen lãnh đạo trung tâm mô hình nền tảng, thuật toán và nhóm đối tác của Amazon SageMaker.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoData.Network Vertical Generative Ai. Trao quyền cho chính mình. Truy cập Tại đây.

- PlatoAiStream. Thông minh Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Trung tâmESG. Ô tô / Xe điện, Than đá, công nghệ sạch, Năng lượng, Môi trường Hệ mặt trời, Quản lý chất thải. Truy cập Tại đây.

- PlatoSức khỏe. Tình báo thử nghiệm lâm sàng và công nghệ sinh học. Truy cập Tại đây.

- ChartPrime. Nâng cao trò chơi giao dịch của bạn với ChartPrime. Truy cập Tại đây.

- BlockOffsets. Hiện đại hóa quyền sở hữu bù đắp môi trường. Truy cập Tại đây.

- nguồn: https://aws.amazon.com/blogs/machine-learning/falcon-180b-foundation-model-from-tii-is-now-available-via-amazon-sagemaker-jumpstart/