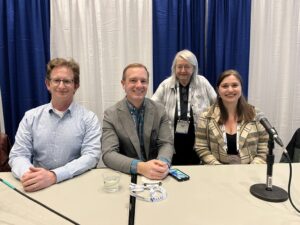

CCC đã hỗ trợ ba phiên khoa học tại Hội nghị thường niên AAAS năm nay và trong trường hợp bạn không thể tham dự trực tiếp, chúng tôi sẽ tóm tắt lại từng phiên. Tuần này, chúng tôi sẽ tóm tắt những điểm nổi bật trong bài thuyết trình của các tham luận viên trong phiên họp, “Mô hình ngôn ngữ lớn: Trợ lý hữu ích, Đối tác lãng mạn hay Kẻ lừa đảo?” Bảng điều khiển này, được kiểm duyệt bởi Tiến sĩ Maria Gini, Thành viên Hội đồng CCC và giáo sư Khoa học & Kỹ thuật Máy tính tại Đại học Minnesota, đã trình bày Tiến sĩ Ece Kamar, Giám đốc điều hành AI Frontiers tại Microsoft Research, Tiến sĩ Hal Daumé III, giáo sư Khoa học Máy tính tại Đại học Maryland, và Tiến sĩ Jonathan May, Giáo sư Khoa học Máy tính tại Viện Khoa học Thông tin Đại học Nam California.

Các Mô hình Ngôn ngữ Lớn đang đi đầu trong các cuộc trò chuyện trong xã hội ngày nay và ban giám khảo sẽ không xác định liệu chúng có phù hợp với những lời cường điệu xung quanh chúng hay không. Các tham luận viên của phiên AAAS này đã đề cập đến các khả năng, thách thức và tiềm năng của LLM.

Người tham gia hội thảo đầu tiên là Tiến sĩ Ece Kamar (Microsoft Research). Cô ấy mô tả trạng thái hiện tại của AI là “Chuyển pha”. Cô ấy đã đưa ra một góc nhìn độc đáo với tư cách là người đã nhìn thấy những thay đổi về AI trong ngành và sự phát triển theo cấp số nhân của các mô hình học sâu mà rất ít người dự đoán sẽ tiếp tục kéo dài đến năm 2024.

Sự tăng trưởng này là do sự gia tăng lượng dữ liệu mà LLM được đào tạo và kiến trúc lớn hơn được gọi là máy biến áp. Một cái nhìn sâu sắc thú vị mà Tiến sĩ Kamar chia sẻ trên biểu đồ là các mô hình đang mở rộng quy mô rất nhanh vì ban đầu chúng chỉ được đào tạo cho một nhiệm vụ cụ thể; một nhiệm vụ mà họ có thể thực hiện một cách đáng tin cậy. ChatGPT đã chỉ ra rằng nếu bạn mở rộng quy mô đủ lớn, bao gồm cả số lượng tham số mà mô hình tính đến, các mô hình có thể bắt đầu hoàn thành các nhiệm vụ với hiệu suất tương tự như một mô hình đã được đào tạo để hoàn thành các nhiệm vụ tương tự một cách cụ thể.

Đây là định nghĩa của quá trình chuyển pha LLM: các mô hình không còn cần phải được đào tạo cụ thể cho một nhiệm vụ cụ thể mà có thể được đào tạo nói chung và sau đó thực hiện nhiều nhiệm vụ. Và không có dấu hiệu nào cho thấy sự phát triển của những khả năng này đang chậm lại.

Tiến sĩ Kamar đã có quyền truy cập sớm vào GPT-4 và trong thời gian dài thử nghiệm nó, cô đã rất ấn tượng bởi những cải tiến đáng kể của nó đi kèm với quy mô và dữ liệu cũng như thực tế là nó có thể hoàn thành đồng bộ các nhiệm vụ khác nhau.

Tương lai sẽ ra sao đối với những LLM này? Tiến sĩ Kamar dự đoán rằng LLM sẽ vượt ra ngoài ngôn ngữ của con người, học ngôn ngữ máy và có thể dịch giữa hai ngôn ngữ. Điều này sẽ nâng cao khả năng của các phương thức trong đầu vào và đầu ra, điều này có thể dẫn đến việc các mô hình không chỉ có thể tạo ra ngôn ngữ mà còn tạo ra các hành động và dự đoán về hành vi.

Tiếp theo, Tiến sĩ Kamar mở rộng về quá trình chuyển pha quan trọng xảy ra trong điện toán. Ngày nay, các hệ thống đang được phát triển rất khác nhau và sự phát triển này sẽ đòi hỏi phải tạo ra một mô hình điện toán mới mà chúng ta mới chỉ mới bắt đầu vào thời điểm này. Cách chúng ta tương tác với máy tính sẽ khác đi rất nhiều trong những năm tới và điều này đòi hỏi phải suy nghĩ lại về Tương tác giữa người và máy tính (HCI).

Một thay đổi khác là cách con người làm việc trong tương lai. Microsoft đã tiến hành các nghiên cứu cho thấy năng suất của người lao động có thể tăng gấp đôi về số dòng mã được viết khi được hỗ trợ bởi AI. Đây là một kỳ tích đáng kinh ngạc, nhưng cách thức hoạt động của công nghệ này và trí thông minh của nó đến từ đâu phần lớn vẫn chưa được biết đến, vì vậy có rất nhiều câu hỏi nghiên cứu trong lĩnh vực này.

Cũng có rất nhiều câu hỏi về khả năng lạm dụng LLM như thế này. Có những lo ngại xung quanh sự công bằng, những rủi ro về nhân khẩu học khác nhau và những hậu quả thậm chí còn nghiêm trọng hơn. Mặc dù có tiềm năng khám phá khoa học rất lớn nhưng cũng có khả năng gây hại rất lớn; chẳng hạn như thuyết phục cha mẹ không tiêm chủng cho con họ, một đứa trẻ làm điều gì đó xấu hoặc thuyết phục ai đó rằng thế giới là phẳng. Rất nhiều nỗ lực về an toàn đã được đầu tư vào việc phát triển LLM và nguồn mở cũng có thể rất hữu ích để đạt được tiến bộ trong lĩnh vực này.

Tiến sĩ Kamar sau đó đặt ra câu hỏi cho cộng đồng khoa học:

- Khoa học sẽ thay đổi như thế nào với sự đột phá của AI?

- Chúng ta có đang thực hiện các bước để thay đổi cách chúng ta giáo dục và đào tạo thế hệ tiếp theo không?

- Bạn có đang xây dựng cơ sở hạ tầng công nghệ để hưởng lợi từ quá trình chuyển đổi giai đoạn này không?

- Có phải chúng ta đang chuẩn bị cho các thế hệ tương lai cho thế giới mới?

Cuối cùng, Tiến sĩ Kamar nhấn mạnh rằng một trong những khía cạnh cốt lõi đáng chú ý của quá trình chuyển pha là tốc độ phát triển của LLM. Những mô hình này đang được cải thiện đáng kể trong một khoảng thời gian rất ngắn và các nhà nghiên cứu máy tính còn rất nhiều việc phải làm.

Tham luận viên thứ hai, Tiến sĩ Hal Daumé III (Đại học Maryland), bắt đầu bài phát biểu của mình bằng cách giải thích rằng các mô hình AI cần được phát triển để giúp mọi người làm những việc họ muốn; tăng cường công việc của con người, không tự động hóa. Tầm nhìn về tự động hóa này đã lan rộng khắp xã hội từ những năm 60. Thay vì giúp mọi người chơi cờ tốt hơn, các nhà khoa học đã thiết kế một hệ thống tự chơi cờ.

Triết lý này sẽ không đi đến đâu cả; AI ngày nay vẫn đáng được đưa tin một khi nó đủ thông minh để tự mình thực hiện một nhiệm vụ. Điều này đã ăn sâu vào máu của AI. Trước khi dành thời gian và tiền bạc để tự động hóa một hệ thống, trước tiên chúng ta nên tạm dừng và hỏi xem điều này có mang lại lợi ích cho chúng ta không?

Tiến sĩ Daumé đã đưa ra khái niệm tăng cường: làm thế nào AI có thể được sử dụng như một công cụ? Các hệ thống như Github copilot tăng năng suất, nhưng tăng năng suất là chưa đủ. Một người dùng hệ thống đã thốt lên rằng nó cho phép họ tập trung vào các phần mã hóa thú vị, điều này phù hợp hơn nhiều với cách xây dựng AI.

Các nhà nghiên cứu AI không nên muốn loại bỏ những phần thú vị trong công việc của một người; họ nên ưu tiên loại bỏ sự cực nhọc. Nó sẽ cải thiện cuộc sống của con người thay vì chỉ cải thiện lợi nhuận của công ty.

Tiến sĩ Daumé là đồng tác giả của một bài báo nêu lên những quan điểm này và lập luận phản bác đã nổi lên rằng từ góc độ kỹ thuật, việc xây dựng các hệ thống sử dụng công nghệ máy học nói riêng thường dễ tự động hóa hơn rất nhiều so với tăng cường. Điều này là do dữ liệu cần thiết để đào tạo một hệ thống sẽ dễ dàng được tìm thấy. Chúng tôi cung cấp thông tin này bằng cách thực hiện công việc của mình và rất dễ dàng đào tạo ML để mô phỏng hành vi của con người. Việc dạy một hệ thống giúp ai đó hoàn thành một nhiệm vụ khó hơn nhiều. Thông tin này nằm rải rác trong các bài đánh giá tài liệu từ NSF, văn bản của một lập trình viên trên một tờ giấy, v.v. Dữ liệu cần thiết để giúp con người thực hiện các nhiệm vụ không được ghi lại.

Một khía cạnh quan trọng khác của việc xây dựng các hệ thống hữu ích là hỏi người dùng xem hệ thống nào sẽ hữu ích cho cuộc sống của họ. Ví dụ, nhu cầu của người mù rất khác với nhu cầu của người sáng mắt (cũng khác với nhu cầu của người sáng mắt). nghĩ nhu cầu của người mù là). Một ví dụ mà Tiến sĩ Daumé đã chia sẻ là hệ thống thị giác có thể tiết lộ vật thể đó là một lon soda, nhưng người mù thường có thể tự mình nhận ra điều đó. Các thành phần của soda sẽ hữu ích hơn nhiều đối với họ. Có một khoảng cách rất lớn giữa chất lượng phản hồi của hệ thống đối với các câu hỏi hiểu đơn giản với việc giải quyết các câu hỏi về khả năng tiếp cận và khoảng cách này ngày càng lớn.

Một ví dụ khác về tầm quan trọng của việc xác định nhu cầu của cộng đồng trước khi tạo ra công nghệ để “giúp đỡ” họ là kiểm duyệt nội dung. Nhiều người kiểm duyệt nội dung tình nguyện tham gia vào công việc vì họ muốn biến thế giới thành một nơi tốt đẹp hơn và giúp xây dựng một cộng đồng mà họ cho là quan trọng. Khi được hỏi loại công cụ nào họ muốn hỗ trợ vai trò của mình, họ thường không muốn công việc của mình được tự động hóa hoàn toàn, họ chỉ muốn những công việc nhàm chán như tra cứu lịch sử trò chuyện trở nên dễ dàng hơn.

Tiến sĩ Daumé kết thúc cuộc thảo luận này bằng một ví dụ cuối cùng về người mẹ yêu xe hơi của ông, người yêu xe hơi và từ chối lái xe số tự động. Cô ấy chọn hộp số sàn, và việc cô ấy có được lựa chọn đó thực sự quan trọng. Mọi người nên có quyền kiểm soát xem họ có muốn nhiệm vụ của mình được tự động hóa hay không.

Tiến sĩ Daumé tiếp tục cuộc trò chuyện bằng cách đưa ra các giải pháp thay thế cho các phương pháp tiếp cận hiện tại đối với công nghệ tiếp cận. Ví dụ: khi xây dựng một công cụ xoay quanh việc nhận dạng ngôn ngữ ký hiệu, thay vì tìm kiếm trên Internet các video về những người đang ký tên (có nhiều lo ngại về sự đồng ý và quyền riêng tư, cộng với hầu hết các video này là của các chuyên gia và không có tiếng ồn xung quanh/gây mất tập trung, điều này không phải là ' t thực tế), hãy tiếp cận cộng đồng và bắt đầu một dự án trao quyền cho họ gửi video để đào tạo các công cụ. Các chiến lược ưu tiên cộng đồng như thế này mang tính đạo đức và trách nhiệm hơn, đồng thời mang lại cho người dùng nhiều quyền kiểm soát hơn.

Tiến sĩ Daumé kết luận rằng LLM và các công cụ khác nên được phát triển để ưu tiên tính hữu dụng chứ không phải trí thông minh. Nó càng hữu ích thì càng có thể giúp mọi người làm những việc họ không thể hoặc không muốn làm, thay vì tự động hóa những việc mà mọi người đã làm tốt và yêu thích.

Tiến sĩ Jonathan May (Viện Khoa học Thông tin của Đại học Nam California) là diễn giả tiếp theo và ông bắt đầu bài phát biểu của mình bằng cách suy ngẫm về chủ đề của hội nghị: “Hướng tới khoa học không có bức tường”. Ông thừa nhận rằng mặc dù sự phát triển LLM gần đây đã phá bỏ những bức tường đối với một số người, nhưng nó đang xây dựng những bức tường cho nhiều người.

Đầu tiên, ông thảo luận về cách Internet hạ thấp nhiều rào cản trong việc tiến hành nghiên cứu; Khi 17 tuổi, anh tự hỏi tại sao Star Wars và Lord of the Rings lại có cốt truyện rất giống nhau, và anh phải lái xe đến thư viện và tìm một cuốn sách có câu trả lời. Anh ấy đã thực hiện nghiên cứu đòi hỏi nhiều nỗ lực hơn nhưng cũng không kém phần gian khổ cho luận án Tiến sĩ của mình, nhưng vào cuối thời gian nghiên cứu của anh ấy, đã có một trang Wikipedia được tạo về chủ đề này, sau đó tìm kiếm trên internet và giờ đây nghiên cứu không cần ô tô là tiêu chuẩn.

Tiến sĩ May tiếp tục nói rằng ông cảm thấy rất vinh dự khi được nằm trong nhóm đối tượng mục tiêu của LLM. Anh ấy không viết mã thường xuyên và chưa bao giờ học được nhiều kỹ năng viết mã, nhưng khi anh ấy cần nó cho công việc của mình, anh ấy có thể hỏi ChatGPT và nó hoạt động rất tốt.

Tuy nhiên, có rất nhiều rào cản ngăn cản việc phổ biến rộng rãi tính hữu dụng của LLM:

- Bức tường ngôn ngữ: Các mô hình hoạt động tốt hơn khi chúng được đào tạo nhiều dữ liệu hơn. Mặc dù LLM thương mại ngày nay đa ngôn ngữ nhưng chúng lại thiên về tiếng Anh. Chẳng hạn, ChatGPT được đào tạo bằng tiếng Anh 92%. Hơn nữa, dữ liệu hướng dẫn, vốn là “nước sốt bí mật” của LLM, phần lớn là tiếng Anh (ví dụ: 96% của ChatGPT). Hiện tại có rất ít nỗ lực nhằm cải thiện hiệu suất đa ngôn ngữ của các mô hình này bất chấp những lỗ hổng hiệu suất mang tính hệ thống trong các thử nghiệm hiện có. Điều này hợp lý do có sự đồng thuận chung rằng dịch máy (MT) đã được “giải quyết” và cần tập trung nỗ lực vào các nhiệm vụ khác.

- Bức tường nhận dạng: Nếu bạn hỏi ChatGPT bạn nên làm gì vào Giáng sinh, nó sẽ tập trung vào các hoạt động và truyền thống khác nhau mà bạn có thể tham gia; nó không đề cập đến việc bạn có thể đi làm. LLM đã được chứng minh là hoạt động khác nhau khi mô tả các nhóm nhân khẩu học khác nhau, thể hiện tình cảm tiêu cực hơn và thậm chí là độc tính hoàn toàn trong một số trường hợp. Có khả năng những câu nói rập khuôn có thể gây tổn hại cho các cộng đồng như LGBTQ+ hoặc Do Thái; nhìn chung có rất nhiều sự thiên vị và điều này gây ra hậu quả trong việc ra quyết định được triển khai. Có một số biện pháp bảo vệ được tích hợp sẵn và các câu hỏi thăm dò rõ ràng hơn sẽ ít có khả năng nhận được câu trả lời độc hại hơn, nhưng về mặt xác suất, các mô hình thích các tuyên bố và kết quả khuôn mẫu hơn và đó là nơi có những tác hại, đặc biệt là khi sử dụng các mô hình ở các khả năng xuôi dòng mà bạn không thấy đầu ra (tức là đủ điều kiện cho vay). Ông đưa ra một ví dụ về việc LLM thể hiện sự thiên vị khi tạo ra khuôn mặt của các cá nhân dựa trên công việc của họ; những công việc được trả lương thấp hơn được thể hiện là phụ nữ và người thiểu số, trong khi những công việc được trả lương cao hơn là nam giới da trắng.

- Tường môi trường (phần mềm): LLM yêu cầu một lượng năng lượng đáng kể để sản xuất và vận hành. Ngay cả những LM “khiêm tốn nhất” cũng sử dụng năng lượng hàng năm nhiều gấp 3 lần so với mức sử dụng của một người. Ngoài ra còn có một khoảng cách đáng kể về dữ liệu đối với các mô hình ngôn ngữ lớn nhất như ChatGPT, nhưng các công ty sở hữu chúng rõ ràng từ chối quyền truy cập vào mức tiêu thụ năng lượng của chúng.

- Tường môi trường (phần cứng): Để sản xuất chip mà tất cả các LLM đều yêu cầu, bạn cần “vật liệu xung đột” như tantalum (khai thác ở Congo) và hafnium (khai thác ở Senegal và Nga). Ở Hoa Kỳ, các công ty phải báo cáo lượng khoáng sản xung đột mà họ sử dụng, nhưng Hoa Kỳ đang công khai cho thấy việc giảm sử dụng những vật liệu này, điều này không thể đúng. Ngoài ra, còn có rất nhiều vấn đề chính trị xã hội như Trung Quốc hạn chế gecmani và gali để trả đũa các hạn chế xuất khẩu của Mỹ.

Tiến sĩ May bày tỏ rằng những danh mục này tiết lộ một số trong số nhiều vấn đề về hạ nguồn do tác hại do LLM gây ra và những trường hợp mọi người không được hưởng lợi. Có lý do để lo ngại, nhưng cũng có những cơ hội nghiên cứu và/hoặc thay đổi hành vi có thể giảm thiểu một số tác hại sau:

- Ngôn ngữ: Dành nhiều kinh phí nghiên cứu hơn cho đa ngôn ngữ (không chỉ dịch thuật bá đạo sang và từ tiếng Anh).

- Bản sắc: Nghiên cứu từ dưới lên và có sự tham gia của cộng đồng. Sửa đổi và thử nghiệm mô hình trước khi triển khai

- Môi trường: Phát triển thuật toán sử dụng ít dữ liệu hơn và thay đổi ít tham số hơn (ví dụ: LoRA, bộ điều hợp, PO không phải RL). Hãy tận tâm trong việc tính toán và nhấn mạnh vào sự cởi mở ở các cấp quy định

Tiến sĩ May kết thúc hội thảo bằng cách nhắc lại quan điểm của Tiến sĩ Daumé rằng mọi người nên được hưởng lợi theo cách họ muốn khi tương tác với LLM và điều này cần được lưu ý hàng đầu ở giai đoạn phát triển.

Cảm ơn bạn rất nhiều vì đã đọc và vui lòng theo dõi vào ngày mai để đọc phần tóm tắt phần Hỏi đáp của buổi học.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoData.Network Vertical Generative Ai. Trao quyền cho chính mình. Truy cập Tại đây.

- PlatoAiStream. Thông minh Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Trung tâmESG. Than đá, công nghệ sạch, Năng lượng, Môi trường Hệ mặt trời, Quản lý chất thải. Truy cập Tại đây.

- PlatoSức khỏe. Tình báo thử nghiệm lâm sàng và công nghệ sinh học. Truy cập Tại đây.

- nguồn: https://feeds.feedblitz.com/~/874484594/0/cccblog~CCC-AAAS-Large-Language-Models-Helpful-Assistants-Romantic-Partners-or-Con-Artists-Part-One/