Dit bericht is geschreven in samenwerking met Balaji Chandrasekaran, Jennifer Cwagenberg en Andrew Sansom en Eiman Ebrahimi van Protopia AI.

Nieuwe en krachtige grote taalmodellen (LLM's) veranderen bedrijven snel, waardoor de efficiëntie en effectiviteit voor een verscheidenheid aan zakelijke gebruiksscenario's worden verbeterd. Snelheid is van essentieel belang, en de adoptie van LLM-technologieën kan het concurrentievoordeel van een bedrijf maken of breken. AWS is vooral geschikt om bedrijven de tools te bieden die nodig zijn om LLM's op schaal in te zetten om kritische besluitvorming mogelijk te maken.

Bij de implementatie van generatieve AI-technologie maken bedrijven zich grote zorgen over de blootstelling aan gegevens en het eigendom van vertrouwelijke informatie die naar LLM’s kan worden gestuurd. Deze zorgen over privacy en gegevensbescherming kunnen het gebruik van LLM’s in organisaties vertragen of beperken. Bedrijven hebben een verantwoorde en veiligere manier nodig om gevoelige informatie naar de modellen te sturen zonder de vaak onbetaalbaar hoge overheadkosten van on-premises DevOps op zich te nemen.

Het bericht beschrijft hoe u de uitdagingen van het behouden van gegevenseigendom en het behoud van gegevensprivacy kunt overwinnen terwijl u LLM's gebruikt door Protopia AI's Stained Glass Transform in te zetten om uw gegevens te beschermen. Protopia AI werkt samen met AWS om de cruciale component van gegevensbescherming en -eigendom te leveren voor een veilige en efficiënte bedrijfsacceptatie van generatieve AI. Dit bericht schetst de oplossing en laat zien hoe deze in AWS kan worden gebruikt voor populaire zakelijke gebruiksscenario's, zoals Ophalen Augmented Generation (RAG) en met state-of-the-art LLM's zoals Lama 2.

Overzicht van gebrandschilderd glastransformatie

Organisaties willen het volledige eigendom en de volledige controle over hun gevoelige bedrijfsgegevens behouden. Dit is een pijler van verantwoorde AI en een opkomende vereiste voor gegevensbescherming en privacy die verder gaat dan de basisbeveiliging en wettelijke garanties van LLM-aanbieders.

Hoewel zakelijke bedrijfseenheden LLM's voor verschillende taken willen gebruiken, maken ze zich ook zorgen over bedrijfsgeheimen, intellectueel eigendom en andere bedrijfseigen informatie die lekt via gegevens die naar deze modellen worden verzonden. Tegelijkertijd zijn beveiligings-, compliance-, gegevensbeheer- en informatiebureaus bang voor het openbaar maken of lekken van klantinformatie in platte tekst of andere gereguleerde gegevens buiten de onderneming. AWS en Protopia AI werken samen om het cruciale onderdeel te leveren dat deze gemeenschappelijke behoefte van zakelijke klanten oplost.

Protopia AI's Stained Glass Transform (SGT) lost deze uitdagingen op door onbeschermde bedrijfsgegevens om te zetten in een gerandomiseerde herrepresentatie, ook wel RmoRed-gegevens genoemd, zoals weergegeven in de volgende afbeelding. Deze representatie is een stochastische inbedding van de originele gegevens, waarbij de informatie behouden blijft die de doel-LLM nodig heeft om te functioneren zonder gevoelige aanwijzingen of vragen, context bloot te leggen of gegevens te verfijnen. Deze herrepresentatie is een eenrichtingstransformatie die niet ongedaan kan worden gemaakt, waardoor de holistische privacy van bedrijfsgegevens en bescherming tegen het lekken van gevoelige tekstgevoelige informatie naar LLM's wordt gewaarborgd. De toepasbaarheid van SGT beperkt zich niet tot taalmodellen. Er kunnen ook gerandomiseerde herrepresentaties worden gegenereerd voor visuele en gestructureerde gegevens. De naam Stained Glass Transform is geworteld in de visuele verschijning van gerandomiseerde herrepresentaties van visuele gegevens die kunnen lijken op het bekijken van de gegevens door glas-in-lood, zoals gedemonstreerd in dit artikel. Gebruiksscenario van de Amerikaanse marine.

SGT werkt met de modernste LLM's zoals Llama 2. De volgende afbeelding toont een voorbeeld van het toepassen van SGT op een Llama 2-model voor het volgen van instructies, terwijl een beschermingslaag wordt toegevoegd aan de instructie en context. De linkerkant van de figuur toont een voorbeeld van een financieel document als context, met de instructie aan het model om het document samen te vatten. Linksonder wordt het antwoord weergegeven dat door Llama 2 wordt gegenereerd bij gebruik van de onbewerkte prompt. Wanneer u SGT gebruikt, worden de insluitingen die aan deze prompt zijn gekoppeld, aan de clientzijde omgezet in stochastische insluitingen, zoals verderop in dit bericht gedetailleerder wordt beschreven. Rechtsonder zie je dat Llama 2 nog steeds een correct antwoord kan genereren als de RmoRed-gegevens (post-transformatie-inbedding) worden verzonden in plaats van de onbeschermde inbedding. Rechtsboven ziet u dat als de RmoRed-gegevens zouden lekken, een reconstructie van de oorspronkelijke prompt zou resulteren in onverstaanbare tekst.

Om een SGT te maken voor een bepaald model zoals Llama 2, biedt Protopia AI een lichtgewicht bibliotheek genaamd de Stained Glass SDK, die een uitbreiding is van PyTorch. Zoals u in de volgende afbeelding kunt zien, kan een SGT, nadat deze is gemaakt, op meerdere manieren in implementatiepijplijnen worden geïntegreerd. De transformatie die vanuit de SDK wordt gemaakt, kan lokaal, in een hybride opstelling of volledig in de cloud worden ingezet. Dit is mogelijk omdat SGT is ontworpen als een lichtgewicht proces dat zeer weinig computerbronnen vereist en als zodanig een minimale impact heeft op het kritieke pad van de gevolgtrekking. Een andere belangrijke evaluatie is het behoud van de nauwkeurigheid van het model met behulp van opnieuw weergegeven gegevens. We zien dat bij verschillende gegevenstypen en modelvariaties de nauwkeurigheid binnen de wenselijke tolerantiegrenzen blijft bij het gebruik van opnieuw weergegeven gegevens.

Deze opties voor de implementatie en het behoud van de nauwkeurigheid zorgen voor een zelfverzekerde adoptie van SGT door alle belanghebbenden binnen een bedrijfsorganisatie. Om de uitvoer van de LLM verder te beschermen, kan Protopia AI query-uitvoer coderen naar een representatie waarvan de decoder alleen beschikbaar is voor de eigenaar van de bedrijfsgegevens.

Overzicht oplossingen

In het vorige gedeelte werd beschreven hoe u Stained Glass Transform in verschillende architecturen kunt gebruiken. In de volgende afbeelding worden de stappen beschreven die betrokken zijn bij het maken, implementeren en gebruiken van SGT voor LLM's:

- SGT-creatie – Het team dat het basislijn-LLM-fundamentmodel traint (aanbieders van eigen LLM's, cloudserviceproviders of enterprise ML-teams die hun eigen LLM's creëren) voert de Stained Glass SDK-software van Protopia AI uit zonder hun bestaande praktijken voor training en implementatie van de LLM te veranderen. Nadat de basismodeltraining is voltooid, wordt de SDK uitgevoerd als een optimalisatiepassage over het taalmodel om de SGT te berekenen. Deze optimalisatiepas wordt geleverd via een uitbreiding op PyTorch. De SDK omvat het basismodel en ontdekt wiskundig een unieke Stained Glass Transform voor die LLM. Verdere details van de onderliggende wiskunde zijn te vinden in de bijbehorende whitepaper. Houd er rekening mee dat omdat het team dat de LLM traint zelf ook de Stained Glass SDK gebruikt, er geen belichting of verzending van modelgewichten nodig is om deze stap te voltooien.

- SGT-release en -implementatie: de SGT die wordt uitgevoerd uit de eerdere optimalisatiestap wordt geïmplementeerd als onderdeel van de gegevenspijplijn die de getrainde LLM voedt. Zoals beschreven in de vorige sectie bevindt de SGT zich aan de kant van de ondernemingsclient.

- SGT-gebruik – De SGT draait op de aanwijzingen die door de onderneming zijn gemaakt en genereert beveiligde aanwijzingen, die naar de geïmplementeerde LLM worden verzonden. Hierdoor kan de onderneming eigenaar blijven van hun gevoelige vragen en context. Met behulp van Protopia AI Stained Glass verlaten de onbeschermde gevoelige gegevens de site of vertrouwenszone van de onderneming niet.

U kunt de SDK voor gebrandschilderd glas gebruiken om op verschillende manieren een SGT te maken. U kunt de Stained Glass SDK bijvoorbeeld gebruiken in zelfbeheerde machine learning-omgevingen (ML). Amazon Elastic Kubernetes-service (Amazon EKS) voor training en gevolgtrekking of binnen Amazon Elastic Compute-cloud (Amazon EC2) direct. Een andere optie is dat het binnen kan draaien Amazon Sage Maker om een SGT te maken voor een bepaald getraind model. Het transformeren van de invoer voor implementatie tijdens gevolgtrekking van de client is onafhankelijk van de gekozen implementatie-implementatie.

De volgende afbeelding illustreert een mogelijke implementatie in een zelfbeheerde ML-omgeving waar het trainen van een Stained Glass Transform wordt uitgevoerd op Amazon EKS.

In deze workflow wordt een container gemaakt met behulp van de Stained Glass SDK en geïmplementeerd Amazon Elastic Container-register (Amazone ECR). Deze container wordt vervolgens ingezet op Amazon EKS om een SGT te trainen waarin wordt opgeslagen Amazon eenvoudige opslagservice (Amazone S3). Als u Amazon EC2 gebruikt, kunt u een transformatie rechtstreeks op uw exemplaar trainen als onderdeel van uw ML-installatie. De Stained Glass SDK kan op verschillende instantietypen worden uitgevoerd, waaronder Amazon P5-, P4- of G5-instantiefamilies, op basis van uw basis LLM-vereisten. Nadat de LLM is geïmplementeerd om te worden gebruikt voor inferentie, gebruikt de clienttoepassing de gemaakte SGT, wat een lichtgewicht bewerking is, om aanwijzingen en context te transformeren voordat deze naar de LLM worden verzonden. Door dit te doen, worden alleen getransformeerde gegevens blootgesteld aan de LLM en blijft het eigendom van de oorspronkelijke invoer aan de klantzijde behouden.

De volgende afbeelding laat zien hoe u een transformatie kunt trainen en gevolgtrekkingen kunt uitvoeren op SageMaker.

Het maken van de SGT volgt een soortgelijk pad als de Amazon EKS-installatie door de trainingsgegevens van Amazon S3 op te nemen, een SGT op een container te trainen en deze op te slaan in Amazon S3. U kunt de Stained Glass SDK gebruiken in uw bestaande SageMaker-installatie met Amazon SageMaker Studio, SageMaker-notitieboekjesEn een SageMaker-trainingsbaan. De LLM wordt gehost als een SageMaker-eindpunt dat toegankelijk is voor de clienttoepassing. De gevolgtrekking voor de clienttoepassing is ook identiek aan de Amazon EKS-opstelling, behalve wat het model dient.

Gerandomiseerde herrepresentaties om LLM-prompts te beschermen en gegevens te verfijnen

In deze sectie worden verschillende gebruiksscenario's besproken die laten zien hoe gerandomiseerde herrepresentatie LLM-prompts beschermt. De voorbeelden illustreren de grote implicaties voor de generatieve AI-inspanningen van ondernemingen: het openen van nieuwe deuren voor AI-gebruiksscenario's, het versnellen van de marktintroductie terwijl bedrijfsgegevens goed worden beschermd, en het eigendom behouden van de gevoelige gegevens die nodig zijn voor gebruik in LLM-prompts.

RAG-gebruikscasus

Een populaire zakelijke use case voor LLM's is Retrieval Augmented Generation (RAG). De volgende afbeelding toont een illustratief voorbeeld waarbij de aanwijzingen en bronnen worden beschermd met behulp van gebrandschilderd glas. De linkerkant van de afbeelding toont de onbeveiligde aanwijzingen en broninformatie. Bij een bedrijfsimplementatie van RAG kunnen de bronnen gevoelige informatie bevatten, zoals bedrijfsgeheimen, intellectueel eigendom of financiële informatie. De rechterkant toont de best mogelijke reconstructie in voor mensen leesbare tekst uit de RmoRed-prompts gemaakt door de SGT.

We kunnen vaststellen dat zelfs bij de best mogelijke reconstructie de informatie volledig onduidelijk is. Het antwoord van het model met en zonder de transformatie is echter hetzelfde, met verwijzingen naar de originele brondocumenten, waardoor de nauwkeurigheid van zowel de vraag als de brondocumenten behouden blijft tijdens het uitvoeren van deze populaire zakelijke use-case.

Brede toepasbaarheid in alle LLM's en talen

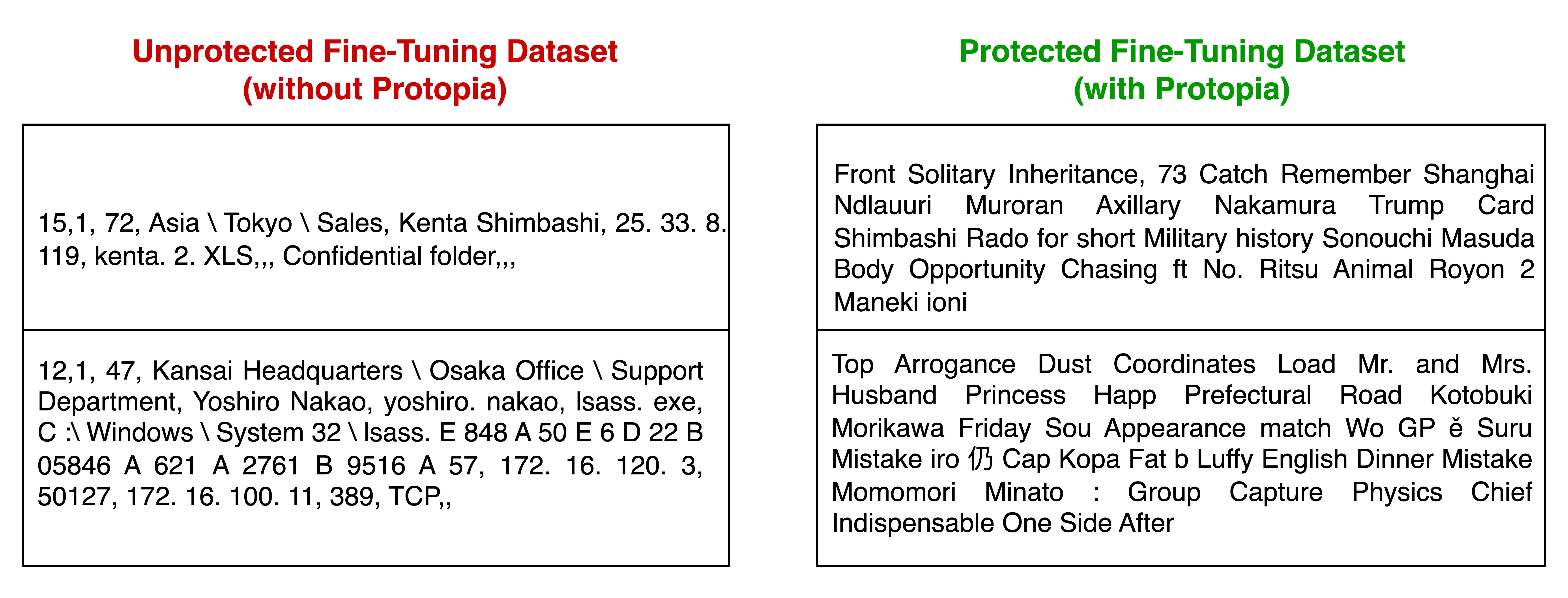

Een van de hoogtepunten van de Stained Glass SDK is dat deze zeer veerkrachtig is tegen modelontwikkelingen en aanpasbaar is aan ultramoderne modellen zoals Lama 2. De volgende afbeelding toont een SGT die is gemaakt op een Llama 2 LLM die eerder was afgestemd op het werken met Japanse tekst. Dit voorbeeld illustreert verder dat SGT's voor elke taal kunnen worden gemaakt en toegepast en dat zelfs invoer voor verfijnde modellen kan worden getransformeerd. De algemene toepasbaarheid van SGT wordt bepaald door de robuuste basis van de Stained Glass SDK, die model- en data-agnostisch is.

Bescherming van fijnafstemmingsgegevens en aanwijzingen

Stained Glass Transform is niet uitsluitend beperkt tot het beschermen van gegevens op het moment van inferentie; het kan ook gegevens beschermen die worden gebruikt om een basismodel te verfijnen. Het proces voor het maken van de transformatie voor het verfijnen van datasets is hetzelfde als dat is uitgelegd in de sectie oplossingsarchitectuur eerder in dit bericht. De transformatie is gemaakt om het funderingsmodel te kunnen verfijnen zonder toegang te krijgen tot de fijnafstemmingsgegevens. Nadat de SGT is gemaakt en getraind voor het funderingsmodel, wordt de verfijnde dataset getransformeerd naar gerandomiseerde herrepresentaties die vervolgens zullen worden gebruikt om het funderingsmodel te verfijnen. Dit proces wordt in meer detail uitgelegd in de bijbehorende whitepaper.

In het volgende voorbeeld moest een zakelijke klant een bestaand model verfijnen voor de detectie van afwijkingen in netwerklogboeken. Ze gebruikten Stained Glass om de gevoelige dataset voor verfijnde afstemming te transformeren naar gerandomiseerde inbedding, die werden gebruikt om hun basismodel te verfijnen. Ze ontdekten dat het detectiemodel dat was verfijnd op de getransformeerde representaties met vrijwel identieke nauwkeurigheid presteerde in vergelijking met het hypothetische scenario van het verfijnen van het basismodel op de onbeschermde fijnafstemmingsdataset. De volgende tabel toont twee voorbeelden van datarecords in platte tekst uit de verfijnde dataset en een reconstructie naar tekst van diezelfde datarecords uit de verfijnde dataset.

Onder de motorkap van Stained Glass Transform voor LLM's

Wanneer toegepast op computervisie, werkt SGT op invoerpixelfuncties, en voor LLM's werkt het op het inbeddingsniveau. Om te benadrukken hoe Stained Glass Transform werkt, stelt u zich de prompt-inbedding voor als een matrix, zoals links in de volgende afbeelding wordt geïllustreerd. In elke invoer is er een deterministische waarde. Deze waarde kan worden toegewezen aan de originele gegevens, waardoor de onbeschermde prompt zichtbaar wordt. Stained Glass Transform zet deze matrix van deterministische waarden om in een matrix waarvan de elementen een wolk van mogelijkheden vormen.

De getransformeerde prompt wordt weergegeven door ruis te bemonsteren uit waarschijnlijkheidsverdelingen die zijn gedefinieerd door de SGT en de bemonsterde ruis toe te voegen aan de deterministische inbedding, waardoor de oorspronkelijke promptwaarden onomkeerbaar worden gerandomiseerd. Het model begrijpt nog steeds de gerandomiseerde opnieuw weergegeven prompt op wiskundig niveau en kan zijn taak nauwkeurig uitvoeren.

Conclusie

In dit bericht werd besproken hoe de Stained Glass Transform van Protopia AI het eigendom en de bescherming van ruwe data ontkoppelt van het ML-operatieproces, waardoor bedrijven het eigendom kunnen behouden en de privacy van gevoelige informatie in LLM-prompts kunnen behouden en gegevens kunnen verfijnen. Door gebruik te maken van deze geavanceerde gegevensbescherming voor LLM-gebruik kunnen ondernemingen de adoptie van basismodellen en LLM's versnellen door zich minder zorgen te hoeven maken over de blootstelling van gevoelige informatie. Door de waarde van echte bedrijfsgegevens veilig te ontsluiten, kunnen organisaties de beloofde efficiëntie en bedrijfsresultaten van LLM’s efficiënter en sneller mogelijk maken. Voor meer informatie over deze technologie kunt u meer informatie vinden in de bijbehorende whitepaper en maak verbinding met Protopia AI om toegang te krijgen en het uit te proberen op uw bedrijfsgegevens.

Over Protopia AI

Protopia AI is een leider op het gebied van gegevensbescherming en privacybehoudende AI/ML-technologieën, gevestigd in Austin, Texas, en is gespecialiseerd in het mogelijk maken van AI-algoritmen en softwareplatforms om te werken zonder de noodzaak van toegang tot platte tekstinformatie. De afgelopen twee jaar heeft Protopia AI met succes zijn vlaggenschip Stained Glass Transform-product gedemonstreerd in een verscheidenheid aan ML-gebruiksscenario's en datatypen bij de Amerikaanse marine, toonaangevende financiële dienstverleners en wereldwijde technologieleveranciers.

Protopia AI werkt samen met ondernemingen, generatieve AI- en LLM-providers en Cloud Service Providers (CSP's) om het eigendom en de vertrouwelijkheid van bedrijfsgegevens te behouden tijdens het gebruik van AI/ML-oplossingen. Protopia AI werkt samen met AWS om een cruciaal onderdeel van gegevensbescherming en eigendom te leveren voor de adoptie van generatieve AI door ondernemingen, en was een van de 21 startups die werden geselecteerd voor de inaugurele bijeenkomst AWS Generatieve AI Accelerator in 2023.

Over de auteurs

Balaji Chandrasekaran is de VP voor Go-to-Market & Customer Enablement bij Protopia AI en werkt nauw samen met klanten om AI in hun bedrijf te benutten, waarbij prioriteit wordt gegeven aan gegevensbescherming en privacy. Vóór Protopia AI was Balaji Product Lead voor AI Solutions bij Infor, waar hij waardegerichte producten ontwikkelde en tegelijkertijd optrad als een vertrouwde partner voor zakelijke klanten in diverse sectoren. Buiten zijn werk houdt hij van muziek, wandelen en reizen met zijn gezin.

Balaji Chandrasekaran is de VP voor Go-to-Market & Customer Enablement bij Protopia AI en werkt nauw samen met klanten om AI in hun bedrijf te benutten, waarbij prioriteit wordt gegeven aan gegevensbescherming en privacy. Vóór Protopia AI was Balaji Product Lead voor AI Solutions bij Infor, waar hij waardegerichte producten ontwikkelde en tegelijkertijd optrad als een vertrouwde partner voor zakelijke klanten in diverse sectoren. Buiten zijn werk houdt hij van muziek, wandelen en reizen met zijn gezin.

Jennifer Cwagenberg leidt het technische team van Protopia AI en zorgt ervoor dat de Stained Glass-technologie voldoet aan de behoeften van hun klanten om hun gegevens te beschermen. Jennifer heeft eerdere ervaring met beveiliging bij Toyota in hun Product Cybersecurity Group, beheerde cloud-workloads bij N-able en was verantwoordelijk voor gegevens bij Match.com.

Jennifer Cwagenberg leidt het technische team van Protopia AI en zorgt ervoor dat de Stained Glass-technologie voldoet aan de behoeften van hun klanten om hun gegevens te beschermen. Jennifer heeft eerdere ervaring met beveiliging bij Toyota in hun Product Cybersecurity Group, beheerde cloud-workloads bij N-able en was verantwoordelijk voor gegevens bij Match.com.

Andreas Sansom is een AI Solutions Engineer bij Protopia AI, waar hij bedrijven helpt AI te gebruiken en tegelijkertijd privé- en gevoelige informatie in hun gegevens te behouden. Voordat hij bij Protopia AI kwam, werkte hij als technisch adviseur die zich richtte op het mogelijk maken van AI-oplossingen voor klanten in vele sectoren, waaronder de financiële sector, de productie, de gezondheidszorg en het onderwijs. Hij doceerde ook computerwetenschappen en wiskunde aan middelbare scholieren, universiteiten en professionele studenten.

Andreas Sansom is een AI Solutions Engineer bij Protopia AI, waar hij bedrijven helpt AI te gebruiken en tegelijkertijd privé- en gevoelige informatie in hun gegevens te behouden. Voordat hij bij Protopia AI kwam, werkte hij als technisch adviseur die zich richtte op het mogelijk maken van AI-oplossingen voor klanten in vele sectoren, waaronder de financiële sector, de productie, de gezondheidszorg en het onderwijs. Hij doceerde ook computerwetenschappen en wiskunde aan middelbare scholieren, universiteiten en professionele studenten.

Eiman Ebrahimi, PhD, is mede-oprichter en Chief Executive Officer van Protopia AI. Dr. Ebrahimi is gepassioneerd over het mogelijk maken van AI om de menselijke ervaring in verschillende maatschappelijke en industriële branches te verrijken. Protopia AI is een visie voor het verbeteren van de lens waardoor AI de noodzakelijke en hoogwaardige gegevens observeert die het nodig heeft en tegelijkertijd nieuwe mogelijkheden creëert voor het beschermen van gevoelige informatie. Voordat hij bij Protopia AI kwam, was hij negen jaar lang Senior Research Scientist bij NVIDIA. Zijn werk bij NVIDIA Research was gericht op het oplossen van problemen bij de toegang tot enorme datasets in ML/AI. Hij was ook co-auteur van peer-reviewed publicaties over hoe je de kracht van duizenden GPU's kunt gebruiken om het trainen van grote taalmodellen haalbaar te maken.

Eiman Ebrahimi, PhD, is mede-oprichter en Chief Executive Officer van Protopia AI. Dr. Ebrahimi is gepassioneerd over het mogelijk maken van AI om de menselijke ervaring in verschillende maatschappelijke en industriële branches te verrijken. Protopia AI is een visie voor het verbeteren van de lens waardoor AI de noodzakelijke en hoogwaardige gegevens observeert die het nodig heeft en tegelijkertijd nieuwe mogelijkheden creëert voor het beschermen van gevoelige informatie. Voordat hij bij Protopia AI kwam, was hij negen jaar lang Senior Research Scientist bij NVIDIA. Zijn werk bij NVIDIA Research was gericht op het oplossen van problemen bij de toegang tot enorme datasets in ML/AI. Hij was ook co-auteur van peer-reviewed publicaties over hoe je de kracht van duizenden GPU's kunt gebruiken om het trainen van grote taalmodellen haalbaar te maken.

Rohit Talluri is een Generatieve AI GTM Specialist bij Amazon Web Services (AWS). Hij werkt samen met de beste generatieve AI-modelbouwers, strategische klanten, belangrijke AI/ML-partners en AWS-serviceteams om de volgende generatie kunstmatige intelligentie, machine learning en versneld computergebruik op AWS mogelijk te maken. Voorheen was hij Enterprise Solutions Architect en Global Solutions Lead voor AWS Mergers & Acquisitions Advisory.

Rohit Talluri is een Generatieve AI GTM Specialist bij Amazon Web Services (AWS). Hij werkt samen met de beste generatieve AI-modelbouwers, strategische klanten, belangrijke AI/ML-partners en AWS-serviceteams om de volgende generatie kunstmatige intelligentie, machine learning en versneld computergebruik op AWS mogelijk te maken. Voorheen was hij Enterprise Solutions Architect en Global Solutions Lead voor AWS Mergers & Acquisitions Advisory.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/foundational-data-protection-for-enterprise-llm-acceleration-with-protopia-ai/