Dự án trí tuệ nhân tạo của Elon Musk, XAI, đang thu hút sự chú ý với việc phát hành phiên bản nâng cấp của mô hình ngôn ngữ Grok. Được mệnh danh là Grok-1.5, phiên bản mới nhất này tự hào có trí nhớ ngắn hạn được tăng cường đáng kể và khả năng suy luận được cải thiện.

Sức mạnh trí nhớ của Grok-1.5

Khía cạnh cốt lõi của bản nâng cấp Grok-1.5 là tăng đáng kể dung lượng bộ nhớ ngắn hạn. Trong các mô hình ngôn ngữ lớn (LLM), bộ nhớ này được đo bằng “thẻ".

Nói một cách đại khái, mã thông báo có thể được coi là đơn vị ý nghĩa cơ bản trong văn bản, cho dù là từ hay một phần của từ. Grok-1.5 hiện có thể xử lý tới 128,000 mã thông báo, Một Tăng gấp 16 lần so với người tiền nhiệm.

Tại sao dung lượng bộ nhớ mở rộng này lại quan trọng?

Nó cho phép Grok-1.5 lưu giữ và xử lý những khối thông tin lớn hơn đáng kể trong khi thực hiện các nhiệm vụ của mình. Hãy tưởng tượng bạn đang cố gắng hiểu một hợp đồng pháp lý phức tạp khi chỉ được phép đọc một đoạn văn mỗi lần.

Một AI với trí nhớ ngắn hạn mạnh mẽ có thể “nhìn thấy” bức tranh lớn hơn, cho phép nó đưa ra quyết định tốt hơn và tạo ra phản hồi sâu sắc hơn.

Lý luận có một bước nhảy vọt

Bên cạnh bộ nhớ được nâng cao, Grok-1.5 còn thể hiện khả năng suy luận được cải thiện. Điều này chuyển thành khả năng hiểu rõ hơn về mối quan hệ phức tạp giữa các mẩu thông tin và đưa ra kết luận hợp lý.

Đối với người dùng, điều này có nghĩa là Grok-1.5 có thể có nhiều khả năng hơn:

- Hiểu các sắc thái và sự phức tạp trong một văn bản dài

- Tuân theo một chuỗi hướng dẫn hoặc yêu cầu, ngay cả khi chúng không hoàn toàn tuyến tính

- Cung cấp các bản tóm tắt phản ánh chính xác các điểm chính của tài liệu

Mã hóa và tính toán được tăng cường

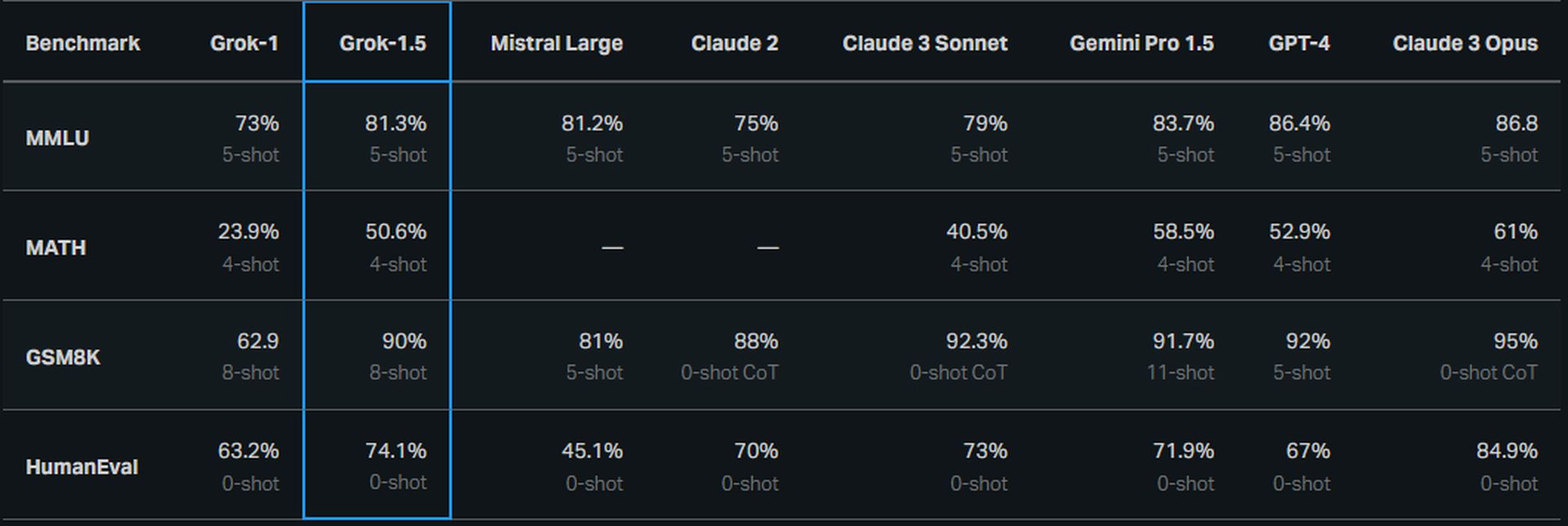

Có vẻ như xAI đã nhắm mục tiêu cụ thể vào khả năng toán học và mã hóa của Grok-1.5. Theo thử nghiệm của chính xAI, hiệu suất trên các điểm chuẩn đo lường các kỹ năng này đã được cải thiện đáng kể. Trên điểm chuẩn MATH (tập hợp các bài toán cấp lớp và cấp độ cạnh tranh), Grok-1.5 đạt 50.6%. Nó cũng đạt 90% điểm chuẩn GSM8K (một bộ bài toán khác).

Ngoài ra, Grok-1.5 đạt 74.1% trên điểm chuẩn HumanEval, đo lường khả năng tạo mã và giải quyết các vấn đề dựa trên mã hóa của AI. Đây là những con số đầy hứa hẹn, mặc dù xAI vẫn chưa có thông tin chi tiết về tiến độ hoặc điểm số trong các lĩnh vực kỹ năng khác.

Điều này có thể có ý nghĩa gì đối với người dùng?

Mặc dù các chi tiết kỹ thuật của bản nâng cấp Grok-1.5 rất ấn tượng nhưng tất cả những điều này thực sự có ý nghĩa gì đối với người dùng? Dưới đây là một số lĩnh vực tiềm năng mà những cải tiến có thể mang lại lợi ích:

- Phân tích tài liệu: Grok-1.5 có thể được trang bị tốt hơn để tóm tắt các văn bản và báo cáo dài, phức tạp. Điều này có thể tiết kiệm thời gian cho những người cần nắm được ý chính của các tài liệu dài một cách nhanh chóng.

- Văn bản sáng tạo: Khả năng lý luận và trí nhớ được cải thiện có thể cho phép Grok-1.5 tạo ra các định dạng văn bản có cấu trúc và mạch lạc hơn, cho dù đó là những câu chuyện sáng tạo, kịch bản hay thậm chí là thơ.

- Giải quyết vấn đề: Các kỹ năng toán học và mã hóa được nâng cao của AI có thể trợ giúp thực hiện các nhiệm vụ yêu cầu tính toán hoặc tạo mã cho các mục đích cụ thể.

Nhưng liệu nó có thể truất ngôi những gã khổng lồ?

Hãy phân tích cách bộ nhớ của Grok-1.5 so sánh với những đối thủ chính khác trong lĩnh vực LLM:

- Grok-1.5: Với dung lượng bộ nhớ ngắn hạn là 128,000 mã thông báo, Grok tự hào có lợi thế đáng kể trong bộ phận cụ thể này.

- GPT-4: Mặc dù số liệu chính xác chưa được xác nhận công khai nhưng các ước tính cho thấy ChatGPT 4 có số lượng mã thông báo lên tới hàng chục nghìn, đáng chú ý là ít hơn Grok-1.5.

- Google Gemini nâng cao: Mô hình AI của Google được đồn đại là có số lượng token vượt quá 100,000. Mặc dù vẫn thấp hơn Grok-1.5 nhưng sự khác biệt nhỏ hơn so với ChatGPT 4.

Mặc dù bộ nhớ tăng lên của Grok-1.5 mang lại lợi thế khác biệt nhưng điều đó không đảm bảo rằng nó có thể hạ bệ những gã khổng lồ hiện tại như ChatGPT 4 hay Google Gemini Advanced. Thành công trong lĩnh vực LLM là sự tương tác phức tạp của nhiều yếu tố.

Cuộc đua tiếp tục

Việc phát hành Grok-1.5 diễn ra trong thời điểm lĩnh vực AI có sự tiến bộ nhanh chóng. Các công ty và tổ chức nghiên cứu không ngừng nâng cao giới hạn của những gì LLM có thể làm được.

Đây là thời điểm thú vị khi sự cạnh tranh thúc đẩy sự đổi mới. Chúng ta nên dự đoán những cải tiến tiếp theo của Grok và sự ra mắt của các mô hình AI hoàn toàn mới trong những tháng và năm tới.

Tín dụng hình ảnh nổi bật: X.ái

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoData.Network Vertical Generative Ai. Trao quyền cho chính mình. Truy cập Tại đây.

- PlatoAiStream. Thông minh Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Trung tâmESG. Than đá, công nghệ sạch, Năng lượng, Môi trường Hệ mặt trời, Quản lý chất thải. Truy cập Tại đây.

- PlatoSức khỏe. Tình báo thử nghiệm lâm sàng và công nghệ sinh học. Truy cập Tại đây.

- nguồn: https://dataconomy.com/2024/03/29/xais-grok-1-5-upgrade/