Hiệp hội các chuyên gia về quyền riêng tư quốc tế cho biết tiềm năng của AI đang phát triển, nhưng công nghệ dựa trên dữ liệu cá nhân thực tế đòi hỏi phải sử dụng công nghệ đó một cách có trách nhiệm. Các sử dụng AI được dự đoán sẽ tăng hơn 25% mỗi năm trong XNUMX năm tới, theo PricewaterhouseCoopers.

“Rõ ràng các khuôn khổ cho phép tính nhất quán, tiêu chuẩn hóa và sử dụng có trách nhiệm là những yếu tố then chốt dẫn đến thành công của AI,” IAPP đã viết trong gần đây của nó Báo cáo về quyền riêng tư và quản trị AI.

AI có trách nhiệm là một hoạt động công nghệ tập trung vào quyền riêng tư, sự giám sát của con người, tính mạnh mẽ, trách nhiệm giải trình, tính bảo mật, khả năng giải thích và sự công bằng. Tuy nhiên, 80% tổ chức được khảo sát vẫn chưa chính thức hóa việc lựa chọn công cụ để đánh giá việc sử dụng AI có trách nhiệm. IAPP viết trong báo cáo rằng các tổ chức gặp khó khăn trong việc mua các công cụ kỹ thuật phù hợp để giải quyết các rủi ro về quyền riêng tư và đạo đức bắt nguồn từ AI.

Mặc dù các tổ chức có ý định tốt nhưng họ không có bức tranh rõ ràng về những công nghệ nào sẽ giúp họ tiếp cận AI có trách nhiệm. IAPP cho biết, trong 80% tổ chức được khảo sát, các hướng dẫn về AI có đạo đức hầu như luôn giới hạn ở các tuyên bố chính sách cấp cao và mục tiêu chiến lược.

“Nếu không hiểu rõ về các loại công cụ có sẵn cần thiết để vận hành AI có trách nhiệm, những người ra quyết định cá nhân tuân theo các yêu cầu pháp lý hoặc thực hiện các biện pháp cụ thể để tránh sai lệch hoặc hộp đen không thể và không đưa ra quyết định của họ dựa trên cùng một cơ sở,” báo cáo cho biết.

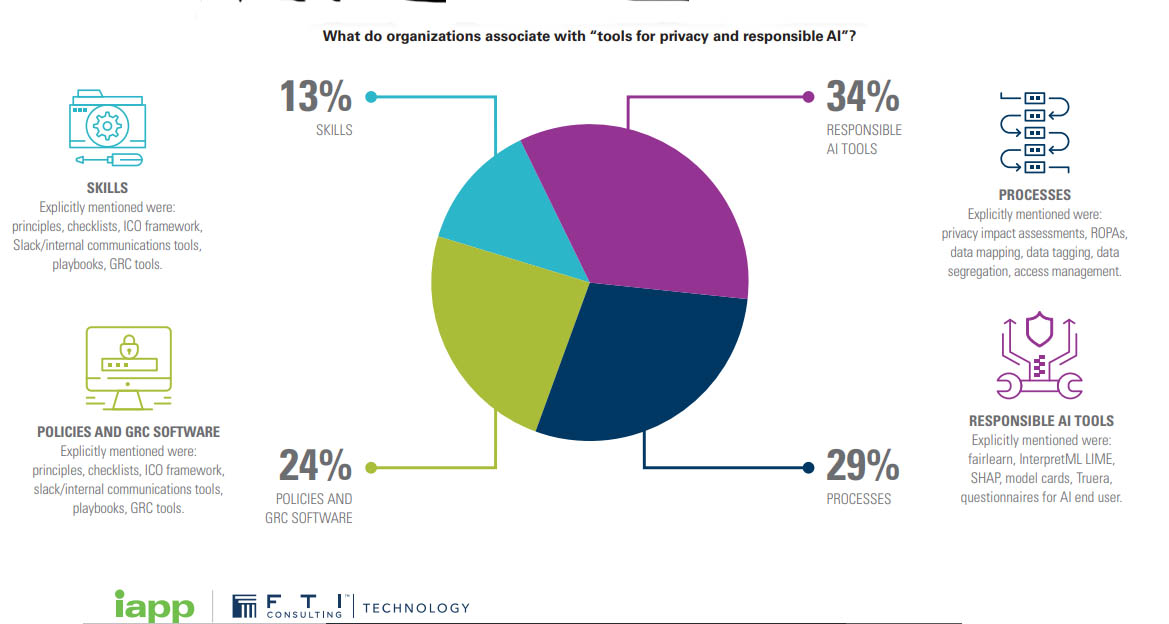

Khi được yêu cầu chỉ định “các công cụ dành cho quyền riêng tư và AI có trách nhiệm”, 34% đề cập đến các công cụ AI có trách nhiệm, 29% đề cập đến quy trình, 24% chính sách được liệt kê và 13% kỹ năng được trích dẫn.

- Các kỹ năng và chính sách bao gồm danh sách kiểm tra, sử dụng khung ICO, phát triển và tuân theo các cẩm nang cũng như sử dụng Slack và các công cụ giao tiếp nội bộ khác. Các công cụ GRC cũng được đề cập trong hai loại này.

- Các quy trình bao gồm đánh giá tác động đến quyền riêng tư, ánh xạ/gắn thẻ/phân tách dữ liệu, quản lý quyền truy cập và ghi lại các hoạt động xử lý (RoPA).

- Các công cụ AI có trách nhiệm bao gồm fairlearn, InterpreML LIME, SHAP, thẻ mô hình, Truera và bảng câu hỏi do người dùng điền vào.

Theo IAPP, mặc dù các tổ chức đã biết đến các công nghệ mới như công nghệ nâng cao quyền riêng tư nhưng có thể họ vẫn chưa triển khai chúng. PET mang đến những cơ hội mới cho việc phân tích dữ liệu cộng tác và bảo mật theo thiết kế để đảm bảo quyền riêng tư. Tuy nhiên, 80% tổ chức cho biết họ không triển khai PET trong tổ chức của mình vì lo ngại rủi ro khi triển khai.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- Platoblockchain. Web3 Metaverse Intelligence. Khuếch đại kiến thức. Truy cập Tại đây.

- nguồn: https://www.darkreading.com/tech-trends/enterprises-don-t-know-what-to-buy-for-responsible-ai