Bir veri ambarında, bir boyut kullanıcıların işle ilgili soruları yanıtlayabilmelerini sağlamak için gerçekleri ve ölçüleri kategorize eden bir yapıdır. Bir örnek vermek gerekirse, tipik bir satış alanında müşteri, zaman veya ürün boyutlardır ve satış işlemleri bir olgudur. Boyut içindeki öznitelikler zaman içinde değişebilir; bir müşteri adresini değiştirebilir, bir çalışan yüklenici pozisyonundan tam zamanlı bir pozisyona geçebilir veya bir üründe birden çok revizyon olabilir. A Yavaş yavaş değişen boyut (SCD), belirli bir süre içinde yavaşça değişebilen nispeten statik verileri içeren bir veri ambarı konseptidir. Veri ambarında tutulan üç ana SCD türü vardır: Tip 1 (geçmiş yok), Tip 2 (tam geçmiş) ve Tip 3 (sınırlı geçmiş). Değişiklik verisi yakalama (CDC), değişen veriler üzerinde bir işlem gerçekleştirilebilmesi için iki veritabanı yüklemesi arasında değişen verileri belirleme yeteneği sağlayan bir veritabanı özelliğidir.

Dünyanın dört bir yanındaki kuruluşlar veri platformlarını veri gölleriyle modernize ederken Amazon Basit Depolama Hizmeti (Amazon S3), veri göllerinde SCD'leri işlemek zor olabilir. Kaynak sistemler, veri gölü içinde işlenmek üzere değiştirilen verileri tanımlayan bir mekanizma sağlamadığında ve veri kaynağı bir veritabanı yerine yarı yapılandırılmışsa veri işlemeyi oldukça karmaşık hale getirdiğinde durum daha da zorlaşır. Tip 2 SCD'leri işlerken temel amaç, veri gölü içindeki değişiklikleri izlemek için veri kümesinin başlangıç ve bitiş tarihlerini doğru bir şekilde tanımlamaktır çünkü bu, tüketen uygulamalar için belirli bir noktada raporlama yeteneği sağlar.

Bu gönderide, yarı yapılandırılmış bir kaynak (JSON) için değişen verilerin nasıl tanımlanacağını göstermeye ve tüm geçmiş veri değişikliklerini (SCD Tip 2) yakalayıp bunları kullanarak bir S3 veri gölünde depolamaya odaklanacağız. AWS Tutkal ve açık veri gölü formatı delta.io. Bu uygulama aşağıdaki kullanım durumlarını destekler:

- Mevcut ve tam geçmiş kayıtları tanımlamak için başlangıç ve bitiş tarihleri ve veri gölündeki silinen kayıtları (mantıksal silmeler) tanımlamak için bir işaret ile İzleme Tipi 2 SCD'ler

- gibi tüketim araçlarını kullanın. Amazon Atina tarihsel kayıtları sorunsuz bir şekilde sorgulamak için

Çözüme genel bakış

Bu gönderi, örnek bir çalışan veri kümesi kullanan uçtan uca bir kullanım durumuyla çözümü gösterir. Veri kümesi, kimlik, ad, adres, telefon numarası, yüklenici olup olmadığı ve daha fazlası gibi çalışan ayrıntılarını temsil eder. SCD uygulamasını göstermek için aşağıdaki varsayımları göz önünde bulundurun:

- Veri mühendisliği ekibi, kayıtların tam anlık görüntüleri olan ve kaynak kayıt değişikliklerini belirleyecek herhangi bir mekanizma içermeyen günlük dosyalar alır.

- Ekip, kaynaktan yeni, güncellenmiş ve silinmiş kayıtları belirlemek ve veri gölündeki geçmiş değişiklikleri korumak için SCD Tip 2 işlevselliğini uygulamakla görevlendirilmiştir.

- Kaynak sistemler CDC yeteneğini sağlamadığından, yeni, güncellenmiş ve silinmiş kayıtları tanımlamak ve bunları veri gölü katmanında kalıcı kılmak için bir mekanizmanın geliştirilmesi gerekir.

Mimari şu şekilde uygulanır:

- Kaynak sistemler, S3 iniş grubundaki dosyaları alır (bu adım, sağlanan veriler kullanılarak örnek kayıtlar oluşturularak taklit edilir) AWS Lambda iniş kovasına işlev)

- Bir AWS Glue işi (Delta işi), kaynak veri dosyasını seçer ve önceki dosya yüklemesindeki değiştirilen verileri (yeni ekler, mevcut kayıtlarda yapılan güncellemeler ve kaynaktan silinen kayıtlar) S3 veri gölüne (işlenmiş katman grubu) işler.

- Mimari, açık veri gölü biçimini (Delta) kullanır ve S3 veri gölünü, yeni değişiklikler güncellenebildiği, yeni ekler eklenebildiği ve kaynak silme işlemleri doğru bir şekilde tanımlanıp işaretlenebildiği için değiştirilebilir bir Delta Gölü olarak oluşturur. Birlikte

delete_flagdeğer - Bir AWS Glue gezgini, Athena tarafından sorgulanabilen verileri kataloglar

Aşağıdaki şema mimarimizi göstermektedir.

Önkoşullar

Başlamadan önce, aşağıdaki ön koşullara sahip olduğunuzdan emin olun:

Çözümü dağıtın

Bu çözüm için, tekrarlanabilir konuşlandırmalara olanak sağlamak üzere mimaride yer alan hizmetleri ayarlayan bir CloudFormation şablonu sağlıyoruz. Bu şablon aşağıdaki kaynakları oluşturur:

- İki S3 grubu: örnek çalışan verilerini depolamak için bir iniş grubu ve değişken veri gölü (Delta Gölü) için işlenmiş bir katman grubu

- Örnek kayıtlar oluşturmak için bir Lambda işlevi

- Kaynak verileri iniş grubundan işlenen kovaya kadar işlemek için bir AWS Glue ayıklama, dönüştürme ve yükleme (ETL) işi

Çözümü dağıtmak için aşağıdaki adımları tamamlayın:

- Klinik Yığını Başlat CloudFormation yığınını başlatmak için:

- Bir yığın adı girin.

- seç AWS CloudFormation'ın özel adlarla IAM kaynakları oluşturabileceğini kabul ediyorum.

- Klinik Yığın oluştur.

CloudFormation yığın dağıtımı tamamlandıktan sonra, aşağıdaki kaynakları not etmek için AWS CloudFormation konsoluna gidin. Çıkışlar sekmesi:

- Veri gölü kaynakları – S3 kovaları

scd-blog-landing-xxxxvescd-blog-processed-xxxx(olarak adlandırılırscd-blog-landingvescd-blog-processedbu yazının sonraki bölümlerinde) - Örnek kayıt oluşturucu Lambda işlevi -

SampleDataGenaratorLambda-<CloudFormation Stack Name>(olarak adlandırılırSampleDataGeneratorLambda) - AWS Tutkal Veri Kataloğu veritabanı -

deltalake_xxxxxx(olarak adlandırılırdeltalake) - AWS Glue Delta işi -

<CloudFormation-Stack-Name>-src-to-processed(olarak adlandırılırsrc-to-processed)

Hesabınızda CloudFormation yığınını dağıtmanın AWS kullanım ücretlerine tabi olduğunu unutmayın.

SCD Tip 2 uygulamasını test edin

Altyapı hazır olduğunda, genel çözüm tasarımını test etmeye ve çalışan veri kümesinden geçmiş kayıtları sorgulamaya hazırsınız. Bu gönderi, günlük olarak tam anlık görüntü verileri aldığınız gerçek bir müşteri kullanım durumu için uygulanmak üzere tasarlanmıştır. SCD uygulamasının aşağıdaki yönlerini test ediyoruz:

- İlk yükleme için bir AWS Glue işi çalıştırın

- Kaynakta herhangi bir değişikliğin olmadığı bir senaryoyu simüle edin

- Yeni kayıtlar ekleyerek ve mevcut kayıtları değiştirerek ve silerek ekleme, güncelleme ve silme senaryolarını simüle edin

- Silinen kaydın yeni bir ek olarak geri geldiği bir senaryoyu simüle edin

Örnek bir çalışan veri kümesi oluşturun

Çözümü test etmek için ve ilk veri alımınıza başlamadan önce veri kaynağının tanımlanması gerekir. Bu adımı basitleştirmek için az önce devreye aldığınız CloudFormation yığınında bir Lambda işlevi devreye alındı.

İşlevi açın ve varsayılan değerle bir test olayı yapılandırın. hello-world Aşağıdaki ekran görüntüsünde görüldüğü gibi şablon olayı JSON. Şablonda herhangi bir değişiklik yapmadan bir olay adı girin ve test olayını kaydedin.

Klinik test örnek kayıtları oluşturmak için Lambda işlevini çağıran bir test olayını çağırmak için.

Lambda işlevi başlatmayı tamamladığında, aşağıdaki örnek çalışan veri kümesini açılış paketinde görebileceksiniz.

AWS Glue işini çalıştırın

Yolda çalışan veri kümesini görüp görmediğinizi onaylayın s3://scd-blog-landing/dataset/employee/. Veri setini indirebilir ve VS Code gibi bir kod düzenleyicide açabilirsiniz. Aşağıda veri kümesinin bir örneği verilmiştir:

Veri kümesini indirin ve hazır tutun, çünkü veri kümesini eklemeleri, güncellemeleri ve silmeleri simüle etmek için gelecekteki kullanım durumları için değiştireceksiniz. Sizin için oluşturulan örnek veri kümesi, önceki örnekte gördüğünüzden tamamen farklı olacaktır.

İşi çalıştırmak için aşağıdaki adımları tamamlayın:

- AWS Glue konsolunda seçin Mesleki Öğretiler Gezinti bölmesinde.

- işi seç

src-to-processed. - Üzerinde Runs sekmesini seçin koşmak.

AWS Glue işi ilk kez çalıştırıldığında, iş çalışan veri kümesini iniş grubu yolundan okur ve verileri bir Delta tablosu olarak işlenen gruba alır.

İş tamamlandığında, ilk veri yüklemesini görmek için bir tarayıcı oluşturabilirsiniz. Aşağıdaki ekran görüntüsü, üzerinde bulunan veritabanını göstermektedir. veritabanları gidin.

- Klinik Tarayıcıları Gezinti bölmesinde.

- Klinik tarayıcı oluştur.

- Tarayıcınıza bir ad verin

delta-lake-crawler, Daha sonra seçmek Sonraki.

- seç Henüz değil AWS Glue tablolarına zaten eşlenmiş veriler için.

- Klinik Veri kaynağı ekle.

- Üzerinde Veri kaynağı açılır menüden Delta Gölü.

- Delta tablosunun yolunu girin.

- seç Yerel tablolar oluşturma.

- Klinik Delta Lake veri kaynağı ekleme.

- Klinik Sonraki.

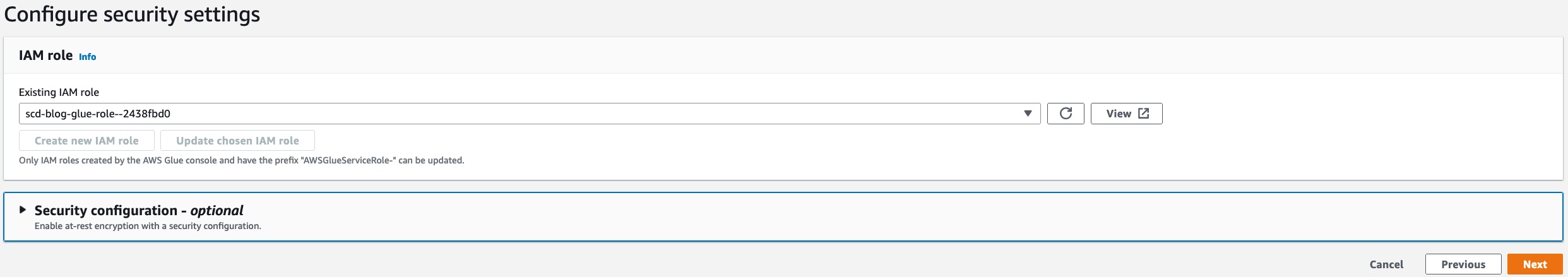

- CloudFormation şablonu tarafından oluşturulan rolü seçin, ardından Sonraki.

- CloudFormation şablonu tarafından oluşturulan veritabanını seçin, ardından Sonraki.

- Klinik tarayıcı oluştur.

- Tarayıcınızı seçin ve seçin koşmak.

Verileri sorgula

Tarayıcı tamamlandıktan sonra oluşturduğu tabloyu görebilirsiniz.

Verileri sorgulamak için aşağıdaki adımları tamamlayın:

- Çalışan tablosunu seçin ve İşlemler menü seç Veriyi gör.

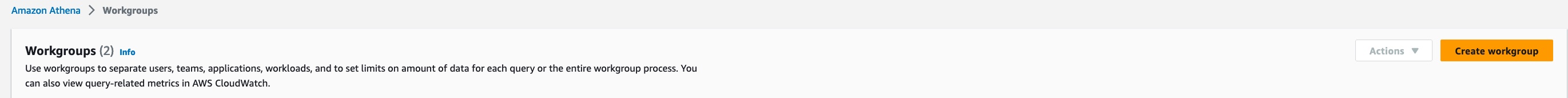

Athena konsoluna yönlendirilirsiniz. En son Athena motoruna sahip değilseniz, en son Athena motoruyla yeni bir Athena çalışma grubu oluşturun.

- Altında Yönetim gezinme bölmesinde öğesini seçin. Çalışma Grupları.

- Klinik Çalışma grubu oluştur.

- Çalışma grubu için aşağıdaki gibi bir ad girin:

DeltaWorkgroup. - seç Athena SQL'i motor olarak ve seçin Athena motor versiyonu 3 için Sorgu motoru sürümü.

- Klinik Çalışma grubu oluştur.

- Çalışma grubunu oluşturduktan sonra, çalışma grubunu seçin (

DeltaWorkgroup) Athena sorgu düzenleyicisindeki açılır menüde.

- Aşağıdaki sorguyu üzerinde çalıştırın

employeetablosu:

Not: Yukarıdaki sorguyu çalıştırmadan önce CloudFormation çıktılarından doğru veritabanı adını güncelleyin.

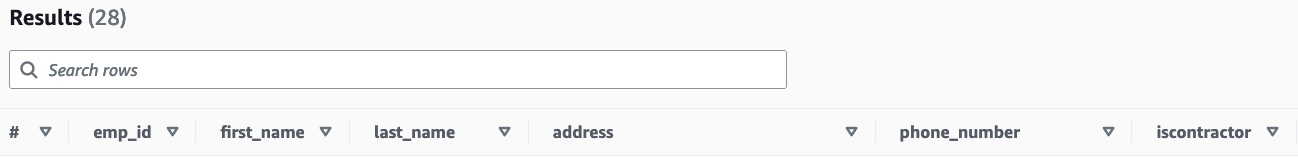

gözlemleyebilirsiniz ki, employee tabloda 25 kayıt var. Aşağıdaki ekran görüntüsü, bazı örnek kayıtlarla birlikte toplam çalışan kayıtlarını göstermektedir.

Delta tablosu bir emp_key, her değişikliğe özeldir ve değişiklikleri izlemek için kullanılır. bu emp_key her ekleme, güncelleme ve silme işlemi için oluşturulur ve tek bir dosyaya ait tüm değişiklikleri bulmak için kullanılabilir. emp_id.

The emp_key aşağıdaki kodda gösterildiği gibi SHA256 karma algoritması kullanılarak oluşturulur:

Eklemeler, güncellemeler ve silmeler gerçekleştirin

Veri setinde değişiklik yapmadan önce aynı işi bir kez daha çalıştıralım. Kaynaktan gelen mevcut yükün ilk yük ile aynı olduğu ve hiçbir değişiklik olmadığı varsayıldığında, AWS Glue işi veri kümesinde herhangi bir değişiklik yapmamalıdır. İş tamamlandıktan sonra, öncekini çalıştırın Select Athena sorgu düzenleyicisinde sorgulayın ve aşağıdaki değerlere sahip 25 aktif kayıt olduğunu onaylayın:

- Sütun içeren 25 kaydın tümü

isCurrent=true - Sütun içeren 25 kaydın tümü

end_date=Null - Sütun içeren 25 kaydın tümü

delete_flag=false

Önceki işin bu değerlerle çalıştığını onayladıktan sonra, ilk veri setimizi aşağıdaki değişikliklerle değiştirelim:

- Değiştir

isContractorbayrakfalse(Şuna değiştirtrueveri kümeniz zaten gösteriyorsafalse) Içinemp_id=12. - Tüm satırı sil

emp_id=8(kaydı bir metin düzenleyicide kaydettiğinizden emin olun, çünkü bu kaydı başka bir kullanım durumunda kullanıyoruz). - için satırı kopyala

emp_id=25ve yeni bir satır ekleyin. Değiştiremp_idolduğu26ve diğer sütunların değerlerini de değiştirdiğinizden emin olun.

Bu değişiklikleri yaptıktan sonra, çalışan kaynak veri kümesi aşağıdaki koda benzer (okunabilirlik için, önceki üç adımda açıklandığı gibi yalnızca değiştirilen kayıtları dahil ettik):

- Şimdi, değiştirilenleri yükleyin

fake_emp_data.jsonaynı kaynak önekine dosya.

- Değiştirilen çalışan veri kümesini Amazon S3'e yükledikten sonra AWS Glue konsoluna gidin ve işi çalıştırın.

- İş tamamlandığında, Athena sorgu düzenleyicisinde aşağıdaki sorguyu çalıştırın ve aşağıdaki değerlere sahip toplam 27 kayıt olduğunu onaylayın:

Not: Yukarıdaki sorguyu çalıştırmadan önce CloudFormation çıktısından doğru veritabanı adını güncelleyin.

- Athena sorgu düzenleyicisinde başka bir sorgu çalıştırın ve aşağıdaki değerlerle döndürülen 4 kayıt olduğunu doğrulayın:

Not: Yukarıdaki sorguyu çalıştırmadan önce CloudFormation çıktısından doğru veritabanı adını güncelleyin.

için iki kayıt göreceksiniz. emp_id=12:

- Bir

emp_id=12aşağıdaki değerlerle kayıt yapın (ilk yükün bir parçası olarak alınan kayıt için):emp_key=44cebb094ef289670e2c9325d5f3e4ca18fdd53850b7ccd98d18c7a57cb6d4b4isCurrent=falsedelete_flag=falseend_date=’2023-03-02’

- Bir ikinci

emp_id=12aşağıdaki değerlerle kayıt yapın (kaynağa yapılan değişikliğin bir parçası olarak alınan kayıt için):emp_key=b60547d769e8757c3ebf9f5a1002d472dbebebc366bfbc119227220fb3a3b108isCurrent=truedelete_flag=falseend_date=Null(veya boş dize)

İçin rekor emp_id=8 bu çalıştırmanın bir parçası olarak kaynakta silinmiş olanlar, değerlerde aşağıdaki değişikliklerle birlikte var olmaya devam edecek:

isCurrent=falseend_date=’2023-03-02’delete_flag=true

Yeni çalışan kaydı aşağıdaki değerlerle eklenecektir:

emp_id=26isCurrent=trueend_date=NULL(veya boş dize)delete_flag=false

Unutmayın emp_key gerçek tablonuzdaki değerler burada örnek olarak verilenlerden farklı olabilir.

- Silme işlemleri için, yeni kaynak dosya ve emp_key ile iç birleştirme ile birlikte temel tablodan emp_id'yi kontrol ederiz.

- Koşul doğru olarak değerlendirilirse, emp_key çalışan temel tablosunun yeni emp_key güncellemelerine eşit olup olmadığını kontrol ederiz ve geçerli, silinmemiş kaydı alırız (isCurrent=true ve delete_flag=false).

- Yeni dosyadaki silme değişikliklerini, eşleşen tüm silme koşulu satırları için temel tabloyla birleştiriyoruz ve aşağıdakileri güncelliyoruz:

isCurrent=falsedelete_flag=trueend_date=current_date

Aşağıdaki koda bakın:

- Hem güncellemeler hem de ekler için, temel tablonun şu koşulu kontrol ederiz:

employee.emp_ideşittirnew changes.emp_idveemployee.emp_keyeşittirnew changes.emp_key, yalnızca mevcut kayıtları alırken. - Bu koşul şu şekilde değerlendirilirse

true, daha sonra mevcut kaydı alırız (isCurrent=truevedelete_flag=false). - Aşağıdakileri güncelleyerek değişiklikleri birleştiriyoruz:

- İkinci koşul olarak değerlendirilirse

true:isCurrent=falseend_date=current_date

- Veya ikinci koşul şu şekilde değerlendirilirse tüm satırı aşağıdaki gibi ekleriz:

false:emp_id=new record’s emp_keyemp_key=new record’s emp_keyfirst_name=new record’s first_namelast_name=new record’s last_nameaddress=new record’s addressphone_number=new record’s phone_numberisContractor=new record’s isContractorstart_date=current_dateend_date=NULL(veya boş dize)isCurrent=truedelete_flag=false

- İkinci koşul olarak değerlendirilirse

Aşağıdaki koda bakın:

Son adım olarak, önceki değişiklikten silinen kaydı kaynak veri setine geri getirelim ve tekrar veri setine nasıl girdiğini görelim. employee veri gölündeki tabloyu inceleyin ve tüm geçmişin nasıl korunduğunu gözlemleyin.

Önceki adımda değiştirdiğimiz veri setimizi değiştirelim ve aşağıdaki değişiklikleri yapalım.

- silinenleri ekle

emp_id=8veri kümesine geri dön.

Bu değişiklikleri yaptıktan sonra, çalışan kaynak veri kümem aşağıdaki koda benziyor (okunabilirlik için, önceki adımda açıklandığı gibi yalnızca eklenen kaydı dahil ettik):

{"emp_id":8,"first_name":"Teresa","last_name":"Estrada","Address":"339 Scott ValleynGonzalesfort, PA 18212","phone_number":"435-600-3162","isContractor":false}

- Değiştirilen çalışan veri kümesi dosyasını aynı kaynak önekine yükleyin.

- Değiştirilenleri yükledikten sonra

fake_emp_data.jsonveri kümesini Amazon S3'e aktarın, AWS Glue konsoluna gidin ve işi yeniden çalıştırın. - İş tamamlandığında, Athena sorgu düzenleyicisinde aşağıdaki sorguyu çalıştırın ve aşağıdaki değerlere sahip toplam 28 kayıt olduğunu onaylayın:

Not: Yukarıdaki sorguyu çalıştırmadan önce CloudFormation çıktısından doğru veritabanı adını güncelleyin.

- Aşağıdaki sorguyu çalıştırın ve 5 kayıt olduğunu doğrulayın:

için iki kayıt göreceksiniz. emp_id=8:

- Bir

emp_id=8aşağıdaki değerlerle kayıt yapın (silinmiş olan eski kayıt):emp_key=536ba1ba5961da07863c6d19b7481310e64b58b4c02a89c30c0137a535dbf94disCurrent=falsedeleted_flag=trueend_date=’2023-03-02’

- Başka

emp_id=8aşağıdaki değerlerle kayıt yapın (son çalıştırmada eklenen yeni kayıt):emp_key=536ba1ba5961da07863c6d19b7481310e64b58b4c02a89c30c0137a535dbf94disCurrent=truedeleted_flag=falseend_date=NULL(veya boş dize)

The emp_key gerçek tablonuzdaki değerler burada örnek olarak verilenlerden farklı olabilir. Ayrıca, bu, sonraki yüklemede herhangi bir değişiklik yapılmadan yeniden eklenen aynı silinmiş kayıt olduğundan, kayıtta herhangi bir değişiklik olmayacağını unutmayın. emp_key.

Son kullanıcı örnek sorguları

Aşağıda, çalışan değişiklik verileri geçmişinin raporlama için nasıl geçilebileceğini gösteren bazı örnek son kullanıcı sorguları yer almaktadır:

- Sorgu 1 – Geçerli ayda kuruluştan ayrılan tüm çalışanların bir listesini alın (örneğin, Mart 2023).

Önceki sorgu, kuruluştan ayrılan iki çalışan kaydı döndürür.

- Sorgu 2 – Geçerli ayda (örneğin, Mart 2023) kuruluşa katılan yeni çalışanların bir listesini alın.

Not: Yukarıdaki sorguyu çalıştırmadan önce CloudFormation çıktısından doğru veritabanı adını güncelleyin.

Önceki sorgu, kuruluşa katılan 23 aktif çalışan kaydını döndürür.

- Sorgu 3 – Kuruluştaki herhangi bir çalışanın geçmişini bulun (bu durumda çalışan 18).

Not: Yukarıdaki sorguyu çalıştırmadan önce CloudFormation çıktısından doğru veritabanı adını güncelleyin.

Önceki sorguda, çalışan 18'in kuruluştan ayrılmadan önce çalışan kayıtlarında iki değişiklik olduğunu gözlemleyebiliriz.

Bu örnekte sağlanan veri sonuçlarının, Lambda işlevi tarafından oluşturulan örnek verilere dayalı olarak belirli kayıtlarınızda göreceğinizden farklı olduğunu unutmayın.

Temizlemek

Bu çözümü denemeyi bitirdiğinizde, AWS ücretlerinin tahakkuk etmesini önlemek için kaynaklarınızı temizleyin:

- S3 kaplarını boşaltın.

- AWS CloudFormation konsolundan yığını silin.

Sonuç

Bu gönderide, kaynak sistemlerin AWS ile değişiklik verisi yakalama yeteneği sağlayamadığı durumlarda S2 Delta Lake'te yarı yapılandırılmış bir veri kaynağı için değişen verilerin nasıl tanımlanacağını ve geçmiş değişikliklerin (SCD Tip 3) nasıl korunacağını gösterdik. Zamk. Aşağı akış uygulamalarının veri gölünde yakalanan CDC verilerinden ek özelleştirmeler oluşturmasını sağlamak için bu çözümü daha da genişletebilirsiniz.

Ek olarak, bu çözümü kullanarak bir orkestrasyonun parçası olarak genişletebilirsiniz. AWS Basamak İşlevleri veya kuruluşunuzun aşina olduğu diğer yaygın olarak kullanılan düzenleyiciler. Ayrıca, uygun olan yerlerde bölümler ekleyerek bu çözümü genişletebilirsiniz. Delta tablosunu şu şekilde de koruyabilirsiniz: sıkıştırma küçük dosyalar.

yazarlar hakkında

Nith Govindasivan, AWS Profesyonel Hizmetlerine sahip bir Veri Gölü Mimarıdır ve burada Büyük Veri ve Analitik çözümlerini uygulayarak müşterilerin modern veri mimarisi yolculuklarına katılmalarına yardımcı olur. İş dışında, Nith hevesli bir Kriket hayranıdır, boş zamanlarında neredeyse tüm kriketleri izler ve uzun yolculuklardan ve uluslararası seyahatlerden hoşlanır.

Nith Govindasivan, AWS Profesyonel Hizmetlerine sahip bir Veri Gölü Mimarıdır ve burada Büyük Veri ve Analitik çözümlerini uygulayarak müşterilerin modern veri mimarisi yolculuklarına katılmalarına yardımcı olur. İş dışında, Nith hevesli bir Kriket hayranıdır, boş zamanlarında neredeyse tüm kriketleri izler ve uzun yolculuklardan ve uluslararası seyahatlerden hoşlanır.

Vijay Velpula AWS Profesyonel Hizmetlerine sahip bir Veri Mimarıdır. Müşterilerin Büyük Veri ve Analitik Çözümlerini uygulamalarına yardımcı olur. İş dışında ailesiyle vakit geçirmekten, seyahat etmekten, yürüyüş yapmaktan ve bisiklete binmekten hoşlanır.

Vijay Velpula AWS Profesyonel Hizmetlerine sahip bir Veri Mimarıdır. Müşterilerin Büyük Veri ve Analitik Çözümlerini uygulamalarına yardımcı olur. İş dışında ailesiyle vakit geçirmekten, seyahat etmekten, yürüyüş yapmaktan ve bisiklete binmekten hoşlanır.

Sriharsh Adari Amazon Web Services'de (AWS) Kıdemli Çözüm Mimarıdır ve müşterilerin AWS'de yenilikçi çözümler geliştirmek için iş sonuçlarından geriye doğru çalışmasına yardımcı olur. Yıllar boyunca, endüstri sektörlerinde veri platformu dönüşümlerinde birden fazla müşteriye yardımcı oldu. Temel uzmanlık alanları arasında Teknoloji Stratejisi, Veri Analitiği ve Veri Bilimi bulunmaktadır. Boş zamanlarında spor yapmaktan, aşırı derecede TV şovları izlemekten ve Tabla oynamaktan hoşlanır.

Sriharsh Adari Amazon Web Services'de (AWS) Kıdemli Çözüm Mimarıdır ve müşterilerin AWS'de yenilikçi çözümler geliştirmek için iş sonuçlarından geriye doğru çalışmasına yardımcı olur. Yıllar boyunca, endüstri sektörlerinde veri platformu dönüşümlerinde birden fazla müşteriye yardımcı oldu. Temel uzmanlık alanları arasında Teknoloji Stratejisi, Veri Analitiği ve Veri Bilimi bulunmaktadır. Boş zamanlarında spor yapmaktan, aşırı derecede TV şovları izlemekten ve Tabla oynamaktan hoşlanır.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- Plato blok zinciri. Web3 Metaverse Zekası. Bilgi Güçlendirildi. Buradan Erişin.

- Kaynak: https://aws.amazon.com/blogs/big-data/implement-slowly-changing-dimensions-in-a-data-lake-using-aws-glue-and-delta/