Dit bericht is geschreven in samenwerking met Marc Neumann, Amor Steinberg en Marinus Krommenhoek van BMW Group.

De BMW Group – met hoofdkantoor in München, Duitsland – wordt aangestuurd door 149,000 werknemers wereldwijd en produceert in meer dan 30 productie- en assemblagefaciliteiten in 15 landen. Tegenwoordig is de BMW Group 's werelds toonaangevende fabrikant van premium auto's en motorfietsen, en leverancier van premium financiële en mobiliteitsdiensten. De BMW Group zet trends op het gebied van productietechnologie en duurzaamheid als innovatieleider met een intelligente materiaalmix, een technologische verschuiving richting digitalisering en hulpbronnenefficiënte productie.

In een steeds digitalere en snel veranderende wereld zijn de bedrijfs- en productontwikkelingsstrategieën van BMW Group sterk afhankelijk van datagestuurde besluitvorming. Daarmee is de behoefte aan datawetenschappers en machine learning (ML)-ingenieurs aanzienlijk gegroeid. Deze bekwame professionals hebben de taak om modellen te bouwen en in te zetten die de kwaliteit en efficiëntie van de bedrijfsprocessen van BMW verbeteren en weloverwogen leiderschapsbeslissingen mogelijk maken.

Datawetenschappers en ML-ingenieurs hebben capabele tools en voldoende rekenkracht nodig voor hun werk. Daarom heeft BMW een aantal jaren geleden een gecentraliseerde ML/deep learning-infrastructuur op locatie opgezet en deze voortdurend geüpgraded. Om de weg vrij te maken voor de groei van AI moest BMW Group een sprong maken op het gebied van schaalbaarheid en elasticiteit en tegelijkertijd de operationele overhead, softwarelicenties en hardwarebeheer verminderen.

In dit bericht zullen we praten over hoe BMW Group, in samenwerking met AWS Professional Services, zijn Jupyter Managed (JuMa) -service heeft gebouwd om deze uitdagingen aan te pakken. JuMa is een dienst van het AI-platform van BMW Group voor zijn data-analisten, ML-ingenieurs en datawetenschappers die een gebruiksvriendelijke werkruimte biedt met een geïntegreerde ontwikkelomgeving (IDE). Het wordt aangedreven door Amazon SageMaker Studio en biedt JupyterLab voor Python en Posit Workbench voor R. Dit aanbod stelt BMW ML-ingenieurs in staat code-centrische data-analyses en ML uit te voeren, verhoogt de productiviteit van ontwikkelaars door het bieden van zelfbedieningsmogelijkheden en infrastructuurautomatisering, en integreert nauw met BMW's gecentraliseerde IT-toolinglandschap.

JuMa is nu beschikbaar voor alle datawetenschappers, ML-ingenieurs en data-analisten bij BMW Group. De service stroomlijnt ML-ontwikkelings- en productieworkflows (MLOps) binnen BMW door een kostenefficiënte en schaalbare ontwikkelomgeving te bieden die naadloze samenwerking tussen datawetenschaps- en engineeringteams wereldwijd mogelijk maakt. Dit resulteert in snellere experimenten en kortere validatiecycli voor ideeën. Bovendien is de JuMa-infrastructuur, die daarop is gebaseerd AWS serverloos en beheerde services, helpt de operationele overhead voor DevOps-teams te verminderen en stelt hen in staat zich te concentreren op het mogelijk maken van gebruiksscenario's en het versnellen van AI-innovatie bij BMW Group.

Uitdagingen bij het laten groeien van een lokaal AI-platform

Voordat de JuMa-service werd geïntroduceerd, gebruikten BMW-teams wereldwijd twee on-premise platforms die de teams JupyterHub- en RStudio-omgevingen boden. Deze platforms waren te beperkt wat betreft CPU, GPU en geheugen om de schaalbaarheid van AI bij BMW Group mogelijk te maken. Het opschalen van deze platforms met het beheer van meer hardware op locatie, meer softwarelicenties en ondersteuningskosten zou aanzienlijke investeringen vooraf en grote inspanningen voor het onderhoud ervan vergen. Bovendien waren er beperkte zelfservicemogelijkheden beschikbaar, wat een hoge operationele inspanning vergde voor de DevOps-teams. Belangrijker nog was dat het gebruik van deze platforms niet in overeenstemming was met de IT-cloud-first-strategie van BMW Group. Teams die deze platforms gebruikten, misten bijvoorbeeld een gemakkelijke migratie van hun AI/ML-prototypes naar de industrialisatie van de oplossing die op AWS draait. Daarentegen moesten de datawetenschaps- en analyseteams die AWS al rechtstreeks gebruikten voor experimenten ook zorg dragen voor het bouwen en exploiteren van hun AWS-infrastructuur en tegelijkertijd zorgen voor naleving van het interne beleid van BMW Group, lokale wet- en regelgeving. Dit omvatte een reeks configuratie- en beheeractiviteiten, van het bestellen van AWS-accounts, het beperken van internettoegang, het gebruik van toegestane pakketten tot het up-to-date houden van hun Docker-images.

Overzicht van de oplossing

JuMa is een volledig beheerde multi-tenant, beveiligde AI-platformservice gebouwd op AWS SageMaker Studio in de kern. Door te vertrouwen op serverloze en beheerde AWS-services als de belangrijkste bouwstenen van de infrastructuur, hoeft het JuMa DevOps-team zich geen zorgen te maken over het patchen van servers, het upgraden van opslag of het beheren van andere infrastructuurcomponenten. De dienst verwerkt al deze processen automatisch en biedt een krachtig technisch platform dat over het algemeen up-to-date en klaar voor gebruik is.

JuMa-gebruikers kunnen moeiteloos een werkruimte bestellen via een selfserviceportaal om zo een veilige en geïsoleerde ontwikkel- en experimentomgeving voor hun teams te creëren. Nadat een JuMa-werkruimte is ingericht, kunnen gebruikers met slechts een paar klikken JupyterLab- of Posit-werkbankomgevingen in SageMaker Studio starten en onmiddellijk beginnen met de ontwikkeling, met behulp van de tools en frameworks waarmee ze het meest vertrouwd zijn. JuMa is nauw geïntegreerd met een reeks BMW Central IT-diensten, waaronder identiteits- en toegangsbeheer, rollen- en rechtenbeheer, BMW Cloud-gegevenshub (BMW's datameer op AWS) en lokale databases. Dit laatste helpt AI/ML-teams naadloos toegang te krijgen tot de vereiste gegevens, op voorwaarde dat ze daartoe bevoegd zijn, zonder dat ze datapijplijnen hoeven te bouwen. Bovendien kunnen de notebooks worden geïntegreerd in de zakelijke Git-repository's om samen te werken met behulp van versiebeheer.

De oplossing abstraheert alle technische complexiteiten die gepaard gaan met AWS-accountbeheer, configuratie en maatwerk voor AI/ML-teams, waardoor ze zich volledig kunnen concentreren op AI-innovatie. Het platform zorgt ervoor dat de werkruimteconfiguratie out-of-the-box voldoet aan de beveiligings- en compliance-eisen van BMW.

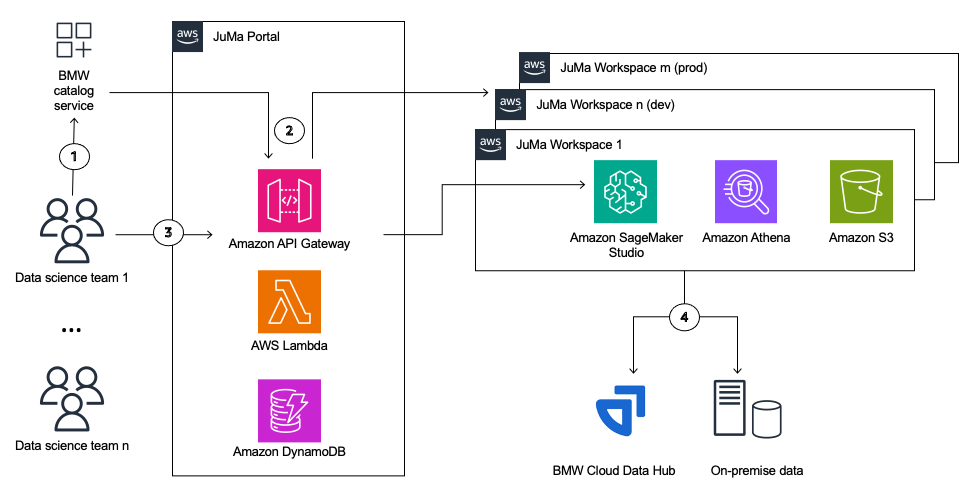

Het volgende diagram beschrijft de contextweergave op hoog niveau van de architectuur.

Gebruikersreis

BMW AI/ML-teamleden kunnen hun JuMa-werkruimte bestellen via de standaardcatalogusservice van BMW. Na goedkeuring door de lijnmanager wordt de bestelde JuMa-werkruimte volledig geautomatiseerd door het platform ingericht. De workflow voor het inrichten van de werkruimte omvat de volgende stappen (zoals genummerd in het architectuurdiagram).

- Een team van datawetenschappers bestelt een nieuwe JuMa-werkruimte in de BMW-catalogus. JuMa voorziet automatisch een nieuw AWS-account voor de werkruimte. Dit zorgt voor volledige isolatie tussen de werkruimten volgens de federatieve modelaccountstructuur die wordt genoemd in Best practices voor SageMaker Studio-beheer.

- JuMa configureert een werkruimte (dat is een Sagemaker-domein) dat alleen vooraf gedefinieerd toestaat Amazon Sage Maker functies die nodig zijn voor experimenten en ontwikkeling, specifieke aangepaste kernels en levenscyclusconfiguraties. Het stelt ook de vereiste subnetten en beveiligingsgroepen in die ervoor zorgen dat de notebooks in een veilige omgeving werken.

- Nadat de werkruimten zijn ingericht, loggen de geautoriseerde gebruikers in op het JuMa-portaal en krijgen ze toegang tot de SageMaker Studio IDE binnen hun werkruimte met behulp van een vooraf door SageMaker ondertekende URL. Gebruikers kunnen kiezen tussen het openen van een privéruimte in SageMaker Studio of een gedeelde ruimte. Gedeelde ruimtes moedigen samenwerking aan tussen verschillende leden van een team die parallel aan dezelfde notebooks kunnen werken, terwijl privéruimtes een ontwikkelomgeving voor afzonderlijke werklasten mogelijk maken.

- Met behulp van het BMW-dataportaal kunnen gebruikers toegang vragen tot lokale databases of gegevens die zijn opgeslagen in BMW's Cloud Data Hub, waardoor deze beschikbaar worden in hun werkruimte voor ontwikkeling en experimenten, van gegevensvoorbereiding en -analyse tot modeltraining en validatie.

Nadat een AI-model is ontwikkeld en gevalideerd in JuMa, kunnen AI-teams de MLOPs-service van het BMW AI-platform gebruiken om het snel en moeiteloos in productie te nemen. Deze service biedt gebruikers een ML-infrastructuur en pijplijnen op productieniveau op AWS met behulp van SageMaker, die met slechts een paar klikken binnen enkele minuten kan worden ingesteld. Gebruikers hoeven alleen maar hun model op de ingerichte infrastructuur te hosten en de pijplijn aan te passen aan hun specifieke gebruiksbehoeften. Op deze manier bestrijkt het AI-platform de gehele AI-levenscyclus bij BMW Group.

JuMa-functies

Na best practice architectuur op AWS werd de JuMa-service ontworpen en geïmplementeerd volgens de AWS goed ontworpen raamwerk. Architecturale beslissingen van elke goed ontworpen pijler worden in detail beschreven in de volgende paragrafen.

Beveiliging en naleving

Om volledige isolatie tussen de tenants te garanderen, krijgt elke werkruimte een eigen AWS-account, waar de geautoriseerde gebruikers gezamenlijk kunnen samenwerken aan analysetaken en aan het ontwikkelen en experimenteren met AI/ML-modellen. Het JuMa-portaal zelf dwingt isolatie tijdens runtime af met behulp van op beleid gebaseerde isolatie met AWS Identiteits- en toegangsbeheer (IAM) en de context van de JuMa-gebruiker. Voor meer informatie over deze strategie, zie Runtime, op beleid gebaseerde isolatie met IAM.

Datawetenschappers hebben alleen toegang tot hun domein via het BMW-netwerk via vooraf ondertekende URL's die door de portal worden gegenereerd. Directe internettoegang is binnen hun domein uitgeschakeld. Hun Sagemaker-domeinrechten zijn gebouwd met behulp van Amazon SageMaker-rolmanager persona's om toegang met de minste privileges te garanderen tot AWS-services die nodig zijn voor de ontwikkeling, zoals SageMaker, Amazone Athene, Amazon eenvoudige opslagservice (Amazon S3), en AWS lijm. Deze rol implementeert ML-vangrails (zoals beschreven in Bestuur en controle), inclusief het afdwingen van ML-training in beide Amazon virtuele privécloud (Amazon VPC) of zonder internet en alleen het gebruik van JuMa's op maat gemaakte en up-to-date SageMaker-afbeeldingen toestaan.

Omdat JuMa is ontworpen voor ontwikkeling, experimenteren en ad-hocanalyse, implementeert het een bewaarbeleid om gegevens na 30 dagen te verwijderen. Om toegang te krijgen tot gegevens wanneer dat nodig is en deze voor de lange termijn op te slaan, integreert JuMa naadloos met de BMW Cloud Data Hub en BMW on-premise databases.

Ten slotte ondersteunt JuMa meerdere regio's om te voldoen aan speciale lokale wettelijke situaties die bijvoorbeeld vereisen dat gegevens lokaal worden verwerkt om de gegevenssoevereiniteit van BMW mogelijk te maken.

Operationele uitmuntendheid

Zowel de backend als de werkruimten van het JuMa-platform zijn geïmplementeerd met AWS serverloos en beheerde diensten. Door deze services te gebruiken, wordt de inspanning van het BMW-platformteam bij het onderhouden en exploiteren van de end-to-end-oplossing geminimaliseerd, waarbij ernaar wordt gestreefd een no-ops-service te zijn. Zowel de werkruimte als het portaal worden gemonitord met behulp van Amazon Cloud Watch logboeken, statistieken en alarmen om Key Performance Indicators (KPI's) te controleren en het platformteam proactief op de hoogte te stellen van eventuele problemen. Bovendien is de AWS-röntgenfoto Het gedistribueerde traceringssysteem wordt gebruikt om verzoeken in meerdere componenten te traceren en CloudWatch-logboeken te annoteren met voor de werkruimte relevante context.

Alle wijzigingen aan de JuMa-infrastructuur worden beheerd en geïmplementeerd door middel van automatisering met behulp van infrastructuur als code (IaC). Dit helpt handmatige inspanningen en menselijke fouten te verminderen, de consistentie te vergroten en reproduceerbare en versiegestuurde wijzigingen te garanderen in de backend-werkruimten van beide JuMa-platforms. Concreet worden alle werkruimten ingericht en bijgewerkt via een daarop gebouwd onboardingproces AWS Stap Functies, AWS CodeBuilden Terraform. Daarom is er geen handmatige configuratie vereist om nieuwe werkruimten op het JuMa-platform te integreren.

Kosten optimalisatie

Door serverloze AWS-services te gebruiken, zorgt JuMa voor schaalbaarheid op aanvraag, vooraf goedgekeurde instantiegroottes en een pay-as-you-go-model voor de bronnen die worden gebruikt tijdens de ontwikkelings- en experimentactiviteiten, afhankelijk van de behoeften van de AI/ML-teams. Om de kosten verder te optimaliseren, monitort en identificeert het JuMa-platform inactieve bronnen binnen SageMaker Studio en schakelt ze automatisch uit om kosten voor niet-gebruikte bronnen te voorkomen.

Duurzaamheid

JuMa vervangt de twee on-premise platforms van BMW voor analyse- en deep learning-workloads die een aanzienlijke hoeveelheid elektriciteit verbruiken en CO2-uitstoot produceren, zelfs als ze niet worden gebruikt. Door AI/ML-workloads van on-premises naar AWS te migreren, zal BMW zijn impact op het milieu verkleinen door de on-premises platforms buiten gebruik te stellen.

Bovendien helpen het in JuMa geïmplementeerde mechanisme voor het automatisch afsluiten van inactieve bronnen, het beleid voor het bewaren van gegevens en de rapporten over het gebruik van de werkruimte aan de eigenaren, geïmplementeerd in JuMa, de ecologische voetafdruk van het uitvoeren van AI/ML-workloads op AWS verder te minimaliseren.

Prestatie-efficiëntie

Door SageMaker Studio te gebruiken profiteren BMW-teams van een gemakkelijke adoptie van de nieuwste SageMaker-functies die hun experimenten kunnen helpen versnellen. Ze kunnen bijvoorbeeld gebruiken Amazon SageMaker JumpStart mogelijkheden om de nieuwste, vooraf getrainde, open source-modellen te gebruiken. Bovendien helpt het de inspanningen van het AI/ML-team te verminderen bij de overgang van experimenteren naar industrialisatie van oplossingen, omdat de ontwikkelomgeving dezelfde AWS-kerndiensten biedt, maar beperkt is tot ontwikkelingsmogelijkheden.

Betrouwbaarheid

SageMaker Studio-domeinen worden geïmplementeerd in een VPC-only-modus om de internettoegang te beheren en alleen toegang tot de beoogde AWS-services toe te staan. Het netwerk wordt geïmplementeerd in twee beschikbaarheidszones om te beschermen tegen één enkel storingspunt, waardoor een grotere veerkracht en beschikbaarheid van het platform voor zijn gebruikers wordt bereikt.

Wijzigingen in JuMa-werkruimten worden automatisch geïmplementeerd en getest in ontwikkelings- en integratieomgevingen, met behulp van IaC- en CI/CD-pijplijnen, voordat klantomgevingen worden geüpgraded.

Ten slotte worden gegevens opgeslagen in Amazon elastisch bestandssysteem (Amazon EFS) voor SageMaker Studio-domeinen wordt bewaard nadat volumes zijn verwijderd voor back-updoeleinden.

Conclusie

In dit bericht hebben we beschreven hoe BMW Group in samenwerking met AWS ProServe een volledig beheerde AI-platformservice op AWS ontwikkelde met behulp van SageMaker Studio en andere serverloze en beheerde AWS-services.

Met JuMa krijgen de AI/ML-teams van BMW de mogelijkheid om nieuwe bedrijfswaarde te ontsluiten door het versnellen van experimenten en door de time-to-market voor disruptieve AI-oplossingen te versnellen. Bovendien kan BMW, door te migreren van zijn on-premise platform, de algehele operationele inspanningen en kosten verlagen en tegelijkertijd de duurzaamheid en de algehele beveiligingspositie vergroten.

Ga voor meer informatie over het uitvoeren van uw AI/ML-experimenten en ontwikkelingsworkloads op AWS naar Amazon SageMaker Studio.

Over de auteurs

Marc Neumann is hoofd van het centrale AI Platform bij BMP Group. Hij is verantwoordelijk voor het ontwikkelen en implementeren van strategieën om AI-technologie te gebruiken voor het creëren van bedrijfswaarde binnen de BMW Group. Zijn primaire doel is ervoor te zorgen dat het gebruik van AI duurzaam en schaalbaar is, wat betekent dat het consistent kan worden toegepast in de hele organisatie om groei en innovatie op de lange termijn te stimuleren. Via zijn leiderschap wil Neumann de BMW Group positioneren als leider in AI-gedreven innovatie en waardecreatie in de auto-industrie en daarbuiten.

Marc Neumann is hoofd van het centrale AI Platform bij BMP Group. Hij is verantwoordelijk voor het ontwikkelen en implementeren van strategieën om AI-technologie te gebruiken voor het creëren van bedrijfswaarde binnen de BMW Group. Zijn primaire doel is ervoor te zorgen dat het gebruik van AI duurzaam en schaalbaar is, wat betekent dat het consistent kan worden toegepast in de hele organisatie om groei en innovatie op de lange termijn te stimuleren. Via zijn leiderschap wil Neumann de BMW Group positioneren als leider in AI-gedreven innovatie en waardecreatie in de auto-industrie en daarbuiten.

Amor Steinberg is een Machine Learning Engineer bij BMW Group en de serviceleider van Jupyter Managed, een nieuwe dienst die tot doel heeft een codecentrische analyse- en machine learning-werkbank te bieden voor ingenieurs en datawetenschappers bij de BMW Group. Zijn eerdere ervaring als DevOps Engineer bij financiële instellingen stelde hem in staat een uniek inzicht te verwerven in de uitdagingen waarmee banken in de Europese Unie worden geconfronteerd en de balans te bewaren tussen het streven naar technologische innovatie, het naleven van wet- en regelgeving en het maximaliseren van de veiligheid voor klanten.

Amor Steinberg is een Machine Learning Engineer bij BMW Group en de serviceleider van Jupyter Managed, een nieuwe dienst die tot doel heeft een codecentrische analyse- en machine learning-werkbank te bieden voor ingenieurs en datawetenschappers bij de BMW Group. Zijn eerdere ervaring als DevOps Engineer bij financiële instellingen stelde hem in staat een uniek inzicht te verwerven in de uitdagingen waarmee banken in de Europese Unie worden geconfronteerd en de balans te bewaren tussen het streven naar technologische innovatie, het naleven van wet- en regelgeving en het maximaliseren van de veiligheid voor klanten.

Marinus Krommenhoek is een Senior Cloud Solution Architect en een softwareontwikkelaar bij BMW Group. Hij is enthousiast over het moderniseren van het IT-landschap met state-of-the-art diensten die hoge waarde toevoegen en gemakkelijk te onderhouden en te bedienen zijn. Marinus is een groot voorstander van microservices, serverloze architecturen en agile werken. Hij heeft ervaring met het werken met gedistribueerde teams over de hele wereld binnen grote ondernemingen.

Marinus Krommenhoek is een Senior Cloud Solution Architect en een softwareontwikkelaar bij BMW Group. Hij is enthousiast over het moderniseren van het IT-landschap met state-of-the-art diensten die hoge waarde toevoegen en gemakkelijk te onderhouden en te bedienen zijn. Marinus is een groot voorstander van microservices, serverloze architecturen en agile werken. Hij heeft ervaring met het werken met gedistribueerde teams over de hele wereld binnen grote ondernemingen.

Nicolaas Jacob Baer is een Principal Cloud Application Architect bij AWS ProServe met een sterke focus op data-engineering en machine learning, gevestigd in Zwitserland. Hij werkt nauw samen met zakelijke klanten om dataplatforms te ontwerpen en geavanceerde analytics en ML-use cases te bouwen.

Nicolaas Jacob Baer is een Principal Cloud Application Architect bij AWS ProServe met een sterke focus op data-engineering en machine learning, gevestigd in Zwitserland. Hij werkt nauw samen met zakelijke klanten om dataplatforms te ontwerpen en geavanceerde analytics en ML-use cases te bouwen.

Joaquin Rinaudo is een hoofdbeveiligingsarchitect bij AWS ProServe. Hij heeft een passie voor het bouwen van oplossingen die ontwikkelaars helpen hun softwarekwaliteit te verbeteren. Voordat hij bij AWS kwam, werkte hij in meerdere domeinen in de beveiligingsindustrie, van mobiele beveiliging tot cloud- en compliance-gerelateerde onderwerpen. In zijn vrije tijd brengt Joaquin graag tijd door met familie en leest hij graag sciencefictionromans.

Joaquin Rinaudo is een hoofdbeveiligingsarchitect bij AWS ProServe. Hij heeft een passie voor het bouwen van oplossingen die ontwikkelaars helpen hun softwarekwaliteit te verbeteren. Voordat hij bij AWS kwam, werkte hij in meerdere domeinen in de beveiligingsindustrie, van mobiele beveiliging tot cloud- en compliance-gerelateerde onderwerpen. In zijn vrije tijd brengt Joaquin graag tijd door met familie en leest hij graag sciencefictionromans.

Sjoechrat Khodjaev is een Senior Global Engagement Manager bij AWS ProServe. Hij is gespecialiseerd in het leveren van impactvolle big data- en AI/ML-oplossingen waarmee AWS-klanten hun bedrijfswaarde kunnen maximaliseren door middel van datagebruik.

Sjoechrat Khodjaev is een Senior Global Engagement Manager bij AWS ProServe. Hij is gespecialiseerd in het leveren van impactvolle big data- en AI/ML-oplossingen waarmee AWS-klanten hun bedrijfswaarde kunnen maximaliseren door middel van datagebruik.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/accelerating-ai-ml-development-at-bmw-group-with-amazon-sagemaker-studio/