Imagem do autor

Assistente de IA conversacional da Anthropic, Cláudia 2, é a versão mais recente que vem com melhorias significativas no desempenho, duração da resposta e disponibilidade em comparação com sua iteração anterior. A versão mais recente do modelo pode ser acessada por meio de nossa API e de um novo site beta público em claude.ai.

Claude 2 é conhecido por ser fácil de conversar, explicar claramente seu raciocínio, evitar saídas prejudiciais e ter uma memória robusta. Possui capacidades de raciocínio aprimoradas.

Claude 2 apresentou uma melhoria significativa na seção de múltipla escolha do exame da Ordem, pontuando 76.5% em comparação com 1.3% de Claude 73.0. Além disso, Claude 2 supera mais de 90% dos participantes humanos em testes de leitura e escrita do GRE. Em avaliações de codificação como HumanEval, Claude 2 alcançou 71.2% de precisão, o que representa um aumento considerável em relação aos 56.0% do passado.

A API Claude 2 está sendo oferecida aos nossos milhares de clientes empresariais pelo mesmo preço da Claude 1.3. Você pode usá-lo facilmente por meio da API da web, bem como de clientes Python e Typescript. Este tutorial irá guiá-lo através da configuração e uso da API Claude 2 Python e ajudá-lo a aprender sobre as diversas funcionalidades que ela oferece.

Antes de começarmos a acessar a API, precisamos primeiro solicitar a API Early Access. Você preencherá o formulário e aguardará a confirmação. Certifique-se de usar seu endereço de e-mail comercial. eu estava usando @kdnuggets.com.

Após receber o e-mail de confirmação, você terá acesso ao console. A partir daí, você pode gerar chaves de API acessando Configurações de conta.

Instale o cliente Antrópico Python usando PiP. Certifique-se de estar usando a versão mais recente do Python.

pip install anthropic

Configure o cliente antrópico usando a chave API.

client = anthropic.Anthropic(api_key=os.environ["API_KEY"])

Em vez de fornecer a chave de API para criar o objeto cliente, você pode definir ANTHROPIC_API_KEY variável de ambiente e forneça a chave.

Aqui está a versão básica de sincronização para gerar respostas usando o prompt.

- Importe todos os módulos necessários.

- Inicialize o cliente usando a chave API.

- Para gerar uma resposta, você deve fornecer um nome de modelo, número máximo de toques e prompt.

- Seu prompt geralmente tem

HUMAN_PROMPT('nnHumano:') eAI_PROMPT('nnAssistente:'). - Imprima a resposta.

from anthropic import Anthropic, HUMAN_PROMPT, AI_PROMPT

import os anthropic = Anthropic( api_key= os.environ["ANTHROPIC_API_KEY"],

) completion = anthropic.completions.create( model="claude-2", max_tokens_to_sample=300, prompt=f"{HUMAN_PROMPT} How do I find soul mate?{AI_PROMPT}",

)

print(completion.completion)

Saída:

Como podemos ver, obtivemos resultados bastante bons. Acho que é ainda melhor que o GPT-4.

Here are some tips for finding your soulmate: - Focus on becoming your best self. Pursue your passions and interests, grow as a person, and work on developing yourself into someone you admire. When you are living your best life, you will attract the right person for you. - Put yourself out there and meet new people. Expand your social circles by trying new activities, joining clubs, volunteering, or using dating apps. The more people you meet, the more likely you are to encounter someone special.........

Você também pode chamar a API Claude 2 usando solicitações assíncronas.

APIs síncronas executam solicitações sequencialmente, bloqueando até que uma resposta seja recebida antes de invocar a próxima chamada, enquanto APIs assíncronas permitem múltiplas solicitações simultâneas sem bloqueio, manipulando as respostas conforme elas são concluídas por meio de retornos de chamada, promessas ou eventos; isso fornece às APIs assíncronas maior eficiência e escalabilidade.

- Importe AsyncAnthropic em vez de Anthropic

- Defina uma função com sintaxe assíncrona.

- Use

awaitcom cada chamada de API

from anthropic import AsyncAnthropic anthropic = AsyncAnthropic() async def main(): completion = await anthropic.completions.create( model="claude-2", max_tokens_to_sample=300, prompt=f"{HUMAN_PROMPT} What percentage of nitrogen is present in the air?{AI_PROMPT}", ) print(completion.completion) await main()

Saída:

Obtivemos resultados precisos.

About 78% of the air is nitrogen. Specifically:

- Nitrogen makes up approximately 78.09% of the air by volume.

- Oxygen makes up approximately 20.95% of air. - The remaining 0.96% is made up of other gases like argon, carbon dioxide, neon, helium, and hydrogen.

Observação: Se você estiver usando a função assíncrona no Jupyter Notebook, use

await main(). Caso contrário, useasyncio.run(main()).

O streaming tornou-se cada vez mais popular para grandes modelos de linguagem. Em vez de esperar pela resposta completa, você pode começar a processar a saída assim que ela estiver disponível. Essa abordagem ajuda a reduzir a latência percebida, retornando a saída do token do modelo de linguagem por token, em vez de tudo de uma vez.

Você só precisa definir um novo argumento stream para True em função de conclusão. Caude 2 usa Server Side Events (SSE) para suportar o streaming de resposta.

stream = anthropic.completions.create( prompt=f"{HUMAN_PROMPT} Could you please write a Python code to analyze a loan dataset?{AI_PROMPT}", max_tokens_to_sample=300, model="claude-2", stream=True,

)

for completion in stream: print(completion.completion, end="", flush=True)

Saída:

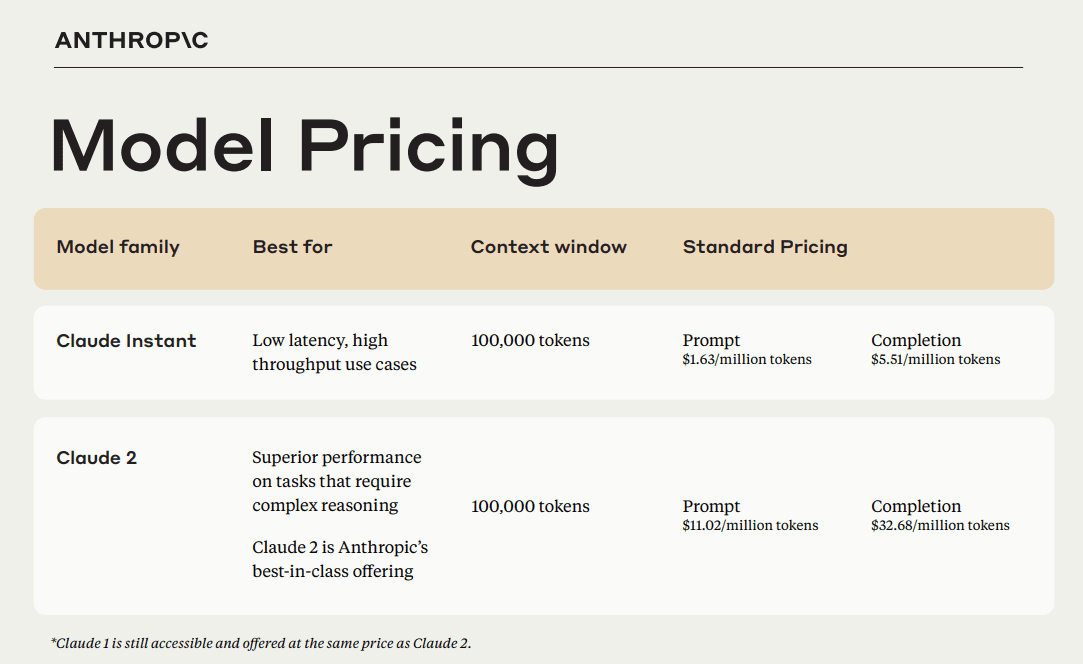

O faturamento é o aspecto mais importante da integração da API em seu aplicativo. Isso o ajudará a planejar o orçamento e cobrar de seus clientes. Apenas as APIs LLMs são cobradas com base no token. Você pode verificar a tabela abaixo para entender a estrutura de preços.

Imagem da Antrópica

Uma maneira fácil de contar o número de tokens é fornecer um prompt ou resposta ao count_tokens função.

client = Anthropic()

client.count_tokens('What percentage of nitrogen is present in the air?')

Além da geração básica de respostas, você pode usar a API para integração total ao seu aplicativo.

- Usando tipos: As solicitações e respostas usam os modelos TypedDicts e Pydantic respectivamente para verificação de tipo e preenchimento automático.

- Tratamento de erros: Os erros gerados incluem APIConnectionError para problemas de conexão e APIStatusError para erros HTTP.

- Cabeçalhos padrão: O cabeçalho anthropic-version é adicionado automaticamente. Isso pode ser personalizado.

- Exploração madeireira: O registro em log pode ser ativado configurando a variável de ambiente ANTHROPIC_LOG.

- Configurando o cliente HTTP: O cliente HTTPx pode ser customizado para proxies, transportes etc.

- Gerenciando recursos HTTP: O cliente pode ser fechado manualmente ou usado em um gerenciador de contexto.

- Controle de versão: Segue as convenções de versionamento semântico, mas algumas alterações incompatíveis com versões anteriores podem ser lançadas como versões secundárias.

A API Anthropic Python fornece acesso fácil ao modelo de IA conversacional de última geração do Claude 2, permitindo que os desenvolvedores integrem os recursos avançados de linguagem natural do Claude em seus aplicativos. A API oferece chamadas síncronas e assíncronas, streaming, cobrança baseada no uso de token e outros recursos para aproveitar totalmente as melhorias do Claude 2 em relação às versões anteriores.

O Claude 2 é meu favorito até agora, e acho que construir aplicativos usando a API Anthropic ajudará você a construir um produto que supere os outros.

Deixe-me saber se você gostaria de ler um tutorial mais avançado. Talvez eu possa criar um aplicativo usando a API Antrópica.

Abid Ali Awan (@ 1abidaliawan) é um profissional de cientista de dados certificado que adora criar modelos de aprendizado de máquina. Atualmente, ele está se concentrando na criação de conteúdo e escrevendo blogs técnicos sobre tecnologias de aprendizado de máquina e ciência de dados. Abid é mestre em Gestão de Tecnologia e bacharel em Engenharia de Telecomunicações. Sua visão é construir um produto de IA usando uma rede neural gráfica para estudantes que lutam contra doenças mentais.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://www.kdnuggets.com/getting-started-with-claude-2-api?utm_source=rss&utm_medium=rss&utm_campaign=getting-started-with-claude-2-api