Mistral AI による Mixtral 8x7B について学びましょう。ビッグデータの処理に非常に優れており、言語の翻訳やコードの生成などのタスクに役立ちます。世界中の開発者は、プロジェクトを合理化し、効率を向上させるその可能性に興奮しています。ユーザーフレンドリーなデザインと優れた機能により、Mixtral 8x7B は急速に AI 開発の頼りになるツールになりつつあります。

また、これについては興味深い事実があります。 GPT-3.5 & ラマ2!

ミクストラル 8x7B とは何ですか?

Mixtral 8x7B は、Mistral AI によって開発された高度な人工知能モデルです。 SMoE (Sparse Mixed of Experts) と呼ばれる独自のアーキテクチャを使用して、大量のデータを効率的に処理します。その複雑さにもかかわらず、Mixtral は使いやすく、言語翻訳やコード生成などのさまざまなタスクに適応できるように設計されています。速度と精度の点で他のモデルよりも優れており、開発者にとって貴重なツールとなっています。さらに、Apache 2.0 ライセンスの下で利用できるため、誰でも自由に使用および変更できます。

さらに詳しい情報をご希望の方はこちらへ 本質的に、Mixtral 8x7B はデコーダー専用モデルとして動作し、フィードフォワード ブロックが「エキスパート」と呼ばれる XNUMX つの異なるパラメーター グループから選択するという独自のアプローチを活用しています。これらのエキスパートはルーター ネットワークによって動的に選択されて各トークンを処理し、計算オーバーヘッドを最小限に抑えながら効率とパフォーマンスを向上させます。

Mixtral の主な強みの 32,000 つは、その適応性と拡張性にあります。 Capable は最大 XNUMX トークンのコンテキストを処理でき、英語、フランス語、イタリア語、ドイツ語、スペイン語などの複数の言語をサポートします。 Mixtral を使用すると、開発者はさまざまなタスクに簡単かつ正確に取り組むことができます。

Mixtral を本当に際立たせているのは、そのパフォーマンスとコストの比率です。合計 46.7 億という驚異的なパラメーターを備えた Mixtral は、トークンごとにこれらのパラメーターの一部のみを利用することで顕著な効率を実現し、その結果、推論時間が短縮され、計算コストが削減されます。

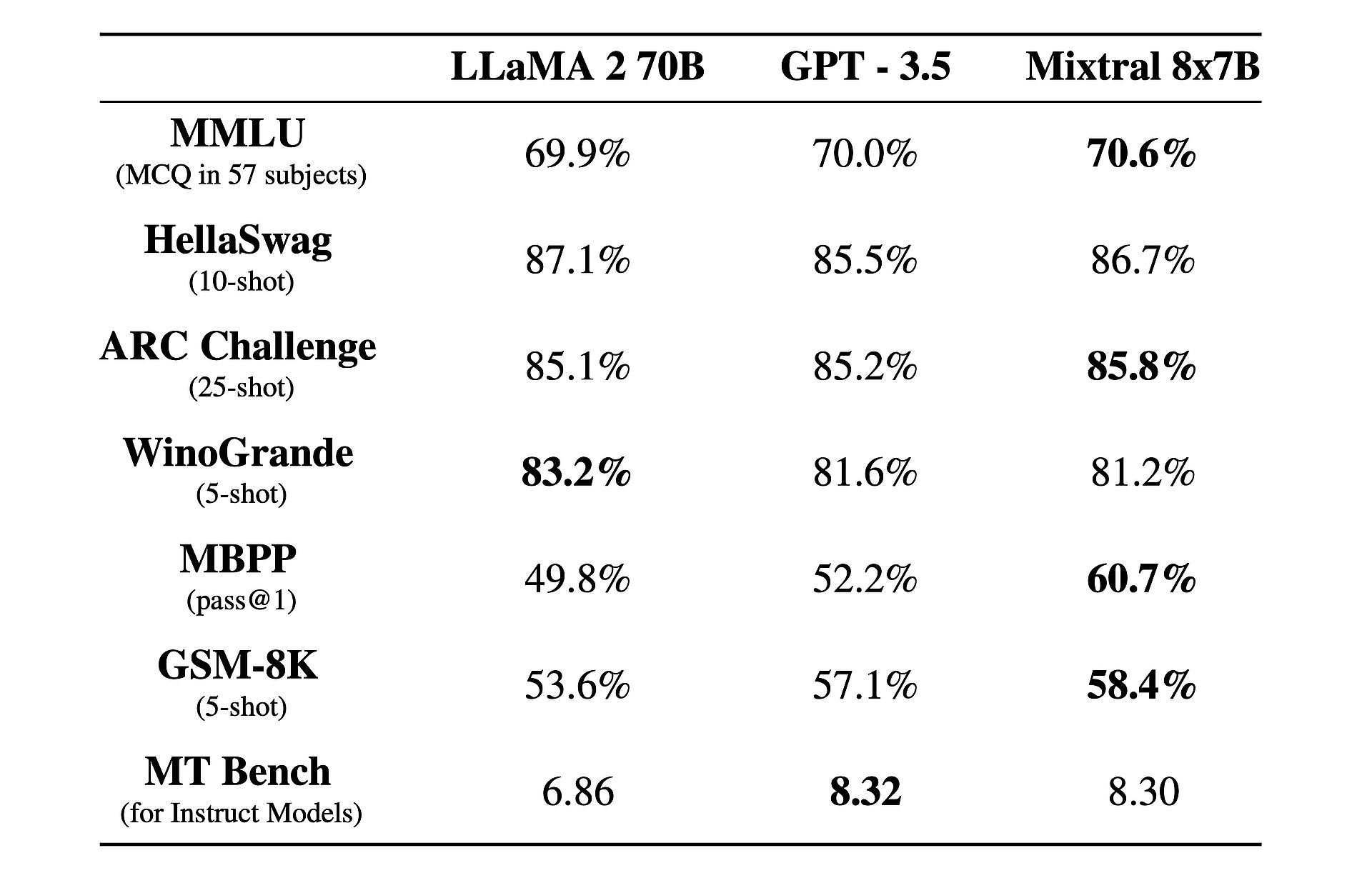

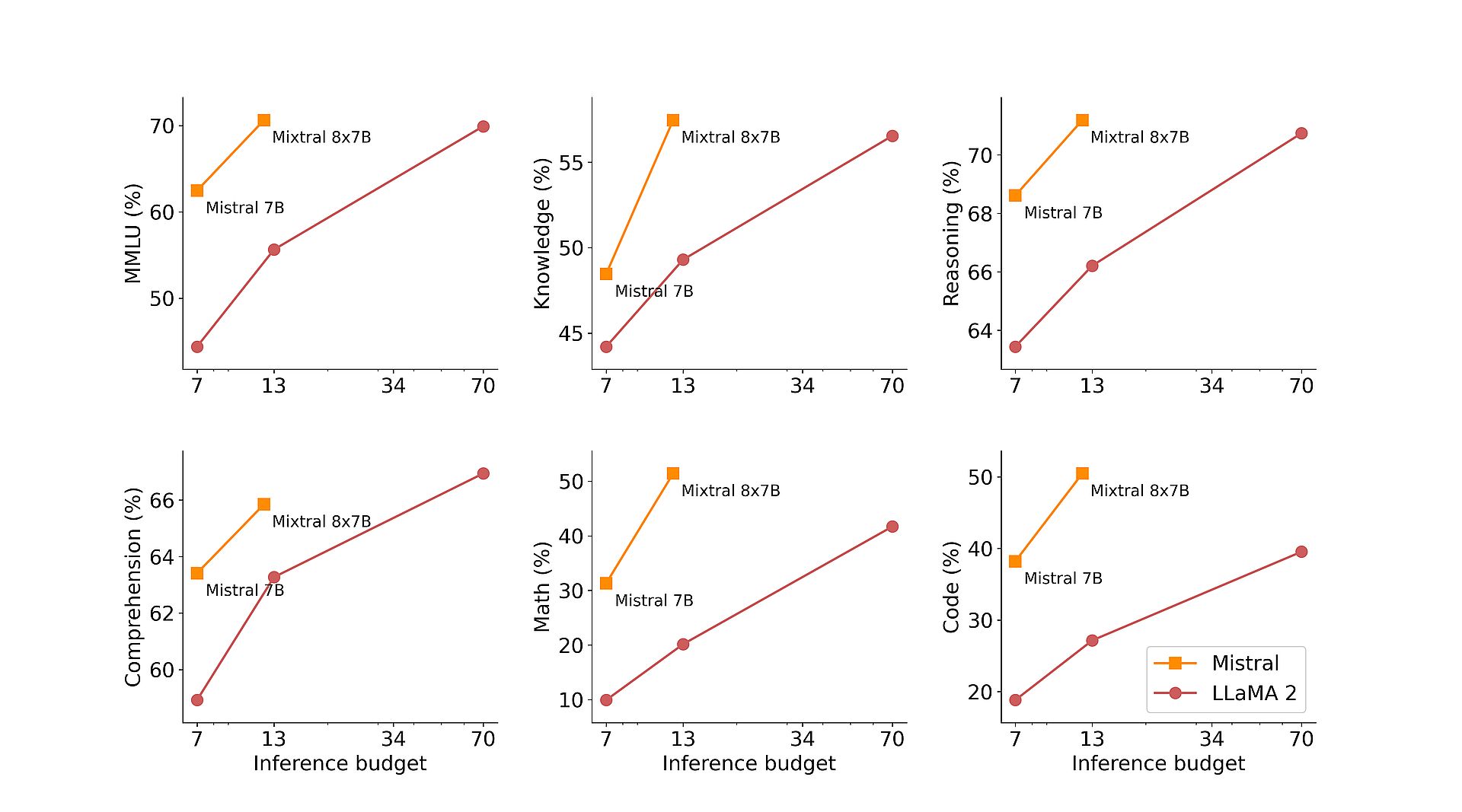

さらに、オープン Web から抽出された広範なデータセットに対する Mixtral の事前トレーニングにより、現実世界のアプリケーションにおける堅牢性と多用途性が保証されます。コード生成、言語翻訳、センチメント分析のいずれであっても、Mixtral はさまざまなベンチマークで優れた結果をもたらし、Llama 2 などの従来のモデルを上回り、多くの場合 GPT3.5 を上回るパフォーマンスを示します。

その機能をさらに強化するために、Mistral AI は、命令に従うタスク用に最適化された特殊なバリアントである Mixtral 8x7B Instruct を導入しました。 MT ベンチで 8.30 という素晴らしいスコアを達成した Mixtral 8x7B Instruct は、監視付き微調整と設定の最適化のための主要なオープンソース モデルとしての地位を確固たるものにしました。

Mistral AI は、その技術的能力に加えて、vLLM プロジェクトに貢献することで Mixtral へのアクセスを民主化し、オープンソース ツールとのシームレスな統合と展開を可能にすることに尽力しています。これにより、開発者は幅広いアプリケーションやプラットフォームにわたって Mixtral の力を活用し、人工知能の分野でのイノベーションと進歩を推進できるようになります。

グロクAIGrok ではなく、「最速の LLM」でイーロン・マスクをロースト

Mixtral 8x7B の使用方法

Mixtral 8x7B には、Mistral のエンドポイント mistral-small を通じてアクセスできます。 ベータテスト段階e. Mistral のすべての生成および埋め込みエンドポイントへの早期アクセスに興味がある場合は、次のことができます。 登録 今。登録すると、Mixtral 8x7B の全機能をいち早く体験し、その革新的なソリューションを探索できるようになります。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://dataconomy.com/2024/02/21/mistral-ai-mixtral-8x7b/