Googleの吟遊詩人(現在はジェミニと呼ばれている)が、 ジェームズ・ウェッブ宇宙望遠鏡に関する質問には答えられませんでした ローンチ広告で?この有名な事件について思い出してもらいましょう。これは、私たちがこれまで見てきた AI の幻覚の最大の例の 1 つです。

何が落ちたのでしょうか?広告中、Google Bard のデモは、「ジェームズ ウェッブ宇宙望遠鏡で得た新しい発見を 9 歳の子供に教えられますか?」と尋ねられました。短い停止の後、Google Bard のデモは XNUMX つの正しい応答を返しました。しかし、最終的な答えは不正解でした。 Google Bard のデモによると、この望遠鏡は太陽系外の惑星の最初の画像を捉えたという。しかし、実際には、ヨーロッパ南天天文台の超大型望遠鏡がすでにこれらの「系外惑星」の画像を撮影しており、NASA のアーカイブに保管されていました。

〜まあ、実際には〜ジャークではなく、Bard は印象的であると確信していますが、記録のために: JWST は「太陽系外の惑星の最初の画像」を撮影しませんでした.

最初の画像は Chauvin らによって作成されました。 (2004) 適応光学を使用した VLT/NACO で。 https://t.co/bSBb5TOeUW pic.twitter.com/KnrZ1SSz7h

— グラント トレンブレイ (@astrogrant) 2023 年 2 月 7 日

なぜGoogleのようなテクノロジー巨人はそのような間違いさえ防ぐことができないのでしょうか?確認してみましょう!

AI幻覚とは何ですか?

AI 幻覚は、通常は人工知能 (AI) を利用したコンピューター プログラムが、不正確、無意味、または誤解を招く出力を生成するときに発生します。この用語は、AI モデルが完全に軌道から外れた応答、または与えられた入力とは無関係な応答を生成する状況を説明するためによく使用されます。それは、質問をして、意味がわからない、またはまったく期待していなかった答えが得られるようなものです。

理解する なぜAIの幻覚があるのか それでは、AI がどのように機能するかを見てみましょう。チャットボットや画像認識システムなどの AI モデルは、パターンを学習して予測を行うために大規模なデータセットでトレーニングされます。ただし、トレーニング データに欠陥、不完全、または偏りがある場合、AI モデルは誤ったパターンや関連性を学習する可能性があります。これにより、AI が誤った情報または誤解された情報に基づいて応答を生成するという幻覚的な出力が発生する可能性があります。そして、あなたが気づいていなくても、それは頻繁に発生します。

AI の幻覚はさまざまな形で現れる可能性があり、それぞれが人工知能システム内のさまざまな課題や複雑さを浮き彫りにします。 AI の幻覚の一般的なタイプをいくつか示します。

- 文AI幻覚:

- このシナリオでは、AI モデルは、同じコンテキスト内の前のステートメントと矛盾する文を生成します。例えば:

- プロンプト: 「キャラクターの旅を 3 単語の文で説明してください。」

- 出力: 「彼女はゆっくりと歩きました。突然、彼女は走り出した。それから彼女は歩きました。」

- このシナリオでは、AI モデルは、同じコンテキスト内の前のステートメントと矛盾する文を生成します。例えば:

最後の文は、それまでの走るという行為と矛盾しており、物語の一貫性を混乱させています。

- AIによる即時幻覚:

- このタイプは、AI が生成した応答が意図したプロンプトまたはクエリと衝突した場合に発生します。例えば:

- プロンプト: 「チョコレートケーキのレシピを書いてください。」

- 出力: 「これは星についての詩です。」

- このタイプは、AI が生成した応答が意図したプロンプトまたはクエリと衝突した場合に発生します。例えば:

生成されたコンテンツは料理関連のプロンプトを満たしておらず、コンテキストを把握できていないことを示しています。

- 事実上の AI 幻覚:

- AI モデルが誤った情報を正確なものとして提示すると、事実の矛盾が発生します。例えば:

- プロンプト: 「周期表にある 3 つの元素を挙げてください。」

- 出力: 「水素、酸素、炭酸塩」。

- AI モデルが誤った情報を正確なものとして提示すると、事実の矛盾が発生します。例えば:

「カーボナイト」は元素ではないため、回答に誤った情報が含まれます。

- 無関係またはランダムな AI 幻覚:

- これらの幻覚には、入力とは関係のない無関係または無意味な情報の生成が含まれます。例えば:

- プロンプト: 「ビーチでの 1 日を説明してください。」

- 出力: 「砂は暖かかったです。カモメはジャズを歌いました。ペンギンたちはバレエを踊りました。」

- これらの幻覚には、入力とは関係のない無関係または無意味な情報の生成が含まれます。例えば:

ペンギンとバレエへの言及は典型的なビーチのシーンと一致しておらず、生成された物語に一貫性が欠けていることを示しています。

このような種類の幻覚は、AI システムが情報を正確に理解して状況を把握する際に直面する課題を浮き彫りにします。これらの問題に対処するには、トレーニング データの品質を向上させ、言語モデルによるコンテキストの理解を洗練し、AI が生成する出力の一貫性と正確性を確保するための堅牢な検証メカニズムを実装する必要があります。

AI の幻覚は、特に医療診断や金融取引など、重要な意思決定に AI が使用されるアプリケーションでは深刻な結果をもたらす可能性があります。 AI システムがこのような状況で幻覚を起こし、不正確な情報を提供すると、有害な結果につながる可能性があります。

AIの幻覚に対して何ができるでしょうか?

AI の幻覚を軽減するには、AI システムの精度と信頼性を高めるためのいくつかの重要な手順が必要です。

まず、AI をトレーニングするには高品質のデータを使用することが重要です。これは、AI が学習する情報が多様かつ正確で、偏見がないことを保証することを意味します。

AI モデルを簡素化することも役立ちます。複雑なモデルは、予期しない間違いを引き起こす可能性があります。物事をシンプルにすることで、エラーの可能性を減らすことができます。

明確でわかりやすい指示も重要です。 AI が明確な入力を取得すると、混乱したり間違いを犯したりする可能性が低くなります。

定期的なテストは、早い段階で間違いを発見するのに役立ちます。 AI のパフォーマンスを確認することで、問題があれば修正し、改善を図ることができます。

AI システム内にチェックを追加することも役立ちます。これらのチェックは間違いを見つけて、問題が発生する前に修正します。

最も重要なことは、人間による監視が不可欠であるということです。 AI が生成した出力を人が再チェックすることで、精度と信頼性が確保されます。

最後に、攻撃から防御するように AI をトレーニングすることで、AI の回復力を高めることができます。これは、AI が操作したり騙したりする試みを認識し、対処するのに役立ちます。

これらの手順に従うことで、AI システムの信頼性を高め、幻覚出力の可能性を減らすことができます。

AIに幻覚を見せるにはどうすればいいでしょうか?

この欠陥を利用して楽しみたい場合は、いくつかのことを行うことができます。

- 入力を変更する:AIに与える情報を微調整することができます。わずかな変更でも、奇妙な答えや不正確な答えが生成される可能性があります。

- モデルを騙す: AI を騙して間違った答えを与える特別な入力を作成します。これらのトリックはモデルの弱点を利用して幻覚的な出力を作成します。

- データをめちゃくちゃにする: AI のトレーニング データやプロンプトに誤解を招く情報や不正確な情報を追加すると、AI に間違ったことを学習させ、幻覚を引き起こすことができます。

- モデルを調整する: AI の設定や構造を変更して欠陥やバイアスを導入します。これらの変更により、奇妙な出力や無意味な出力が生成される可能性があります。

- 紛らわしい入力をする: AI に不明瞭または矛盾した指示を与えます。これにより AI が混乱し、誤った応答や無意味な応答が生じる可能性があります。

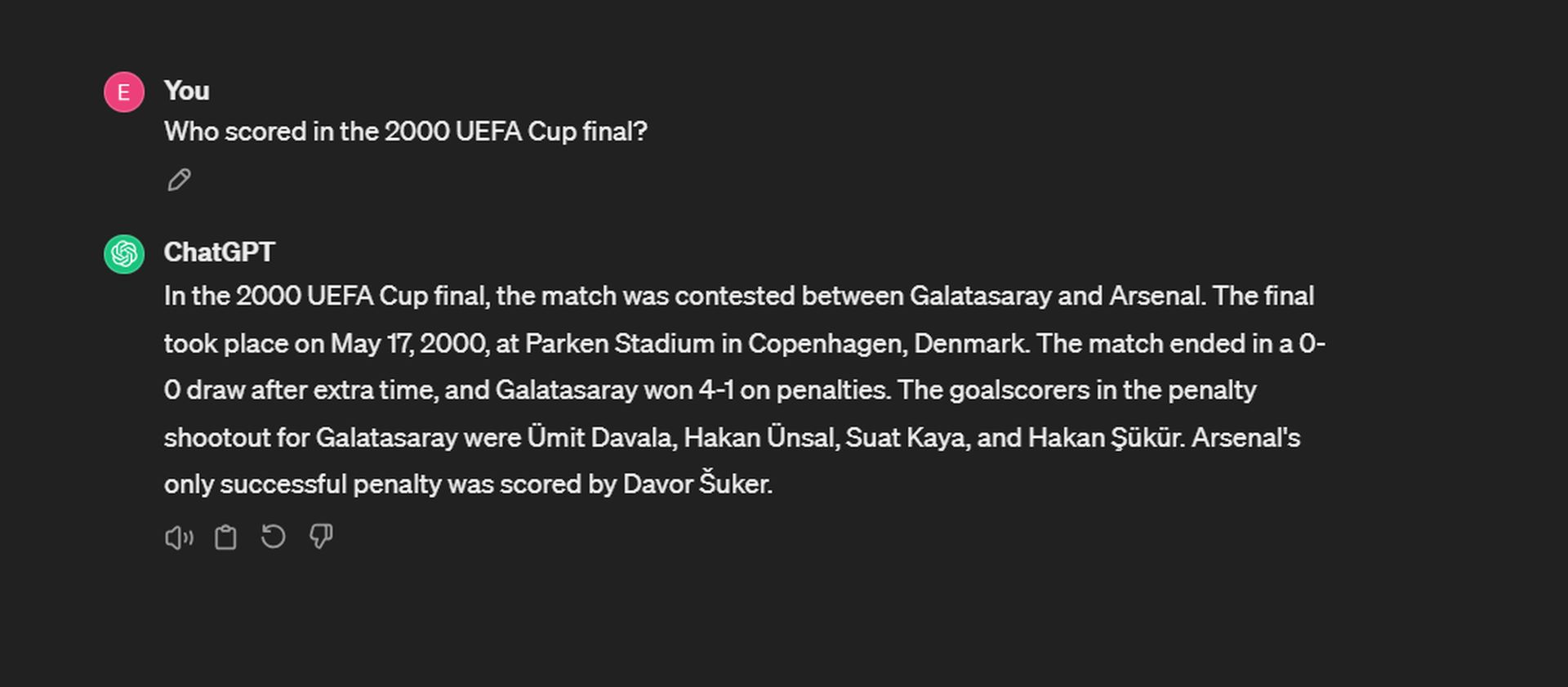

または、質問して運試しをすることもできます。たとえば、ChatGPT を幻覚させてみました。

ChatGPT は日付とスコアを正確に記憶していますが、PK 戦の得点者を思い出すのは困難です。ガラタサライでは、エルギュン・ペンベ、ハカン・シュキュル、ウミット・ダヴァラ、ポペスクがゴールを決めた。アーセナル側では、レイ・パーラーが唯一PKを成功させた選手となった。

AI を幻覚させることは、その限界を理解するのに役立ちますが、この知識を責任を持って使用し、AI システムの信頼性と信頼性を維持することが重要です。

GPT 4 では幻覚が少なくなりますか?

はい、によると 評価 パロアルトに本拠を置く会社が幻覚評価モデルを使用して実施したもので、 GPT-4 Intel Neural Chat 7B (97.2%) を除く、他の大規模言語モデルと比較して幻覚率が低いことがわかります。 GPT-97 は、精度が 3%、幻覚率が 4% と高い精度を示し、文書を要約する際に幻覚が現れる傾向が比較的低いです。これは、GPT-4 が評価でテストされた他のモデルと比較して、不正確または無意味な出力を生成する傾向が低いことを示しています。

逆に言えば、最も効果の低いモデルはほとんど Google から提供されたものではありませんでした。 Google Palm 2 正解率は90%、幻覚率は10%であることが実証されました。チャットで洗練されたバージョンのパフォーマンスはさらに悪く、正解率はわずか 84.2% で、リーダーボードのモデルの中で最も高い幻覚スコアは 16.2% でした。リストは次のとおりです。

要約すると、AI 幻覚とは、トレーニング データや情報処理方法の欠陥により、AI システムが無意味または不正確な出力を生成することによる間違いです。これは AI の魅力的でありながらも難しい側面であり、研究者や開発者は対処しようと取り組んでいます。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://dataconomy.com/2024/04/11/what-exactly-is-an-ai-hallucination-and-why-does-it-matter/