Hoewel beveiligingsprofessionals over het algemeen enthousiast zijn over de potentiële rol van generatieve AI in hun organisaties, maken ze zich ook zorgen over de impact die deze nieuwe tools op hun omgeving kunnen hebben. Uit het onderzoek van Dark Reading naar het gebruik van generatieve AI in ondernemingen blijkt dat er een hoge mate van bewustzijn en bezorgdheid is over de mogelijke valkuilen als je all-in gaat voor deze technologie.

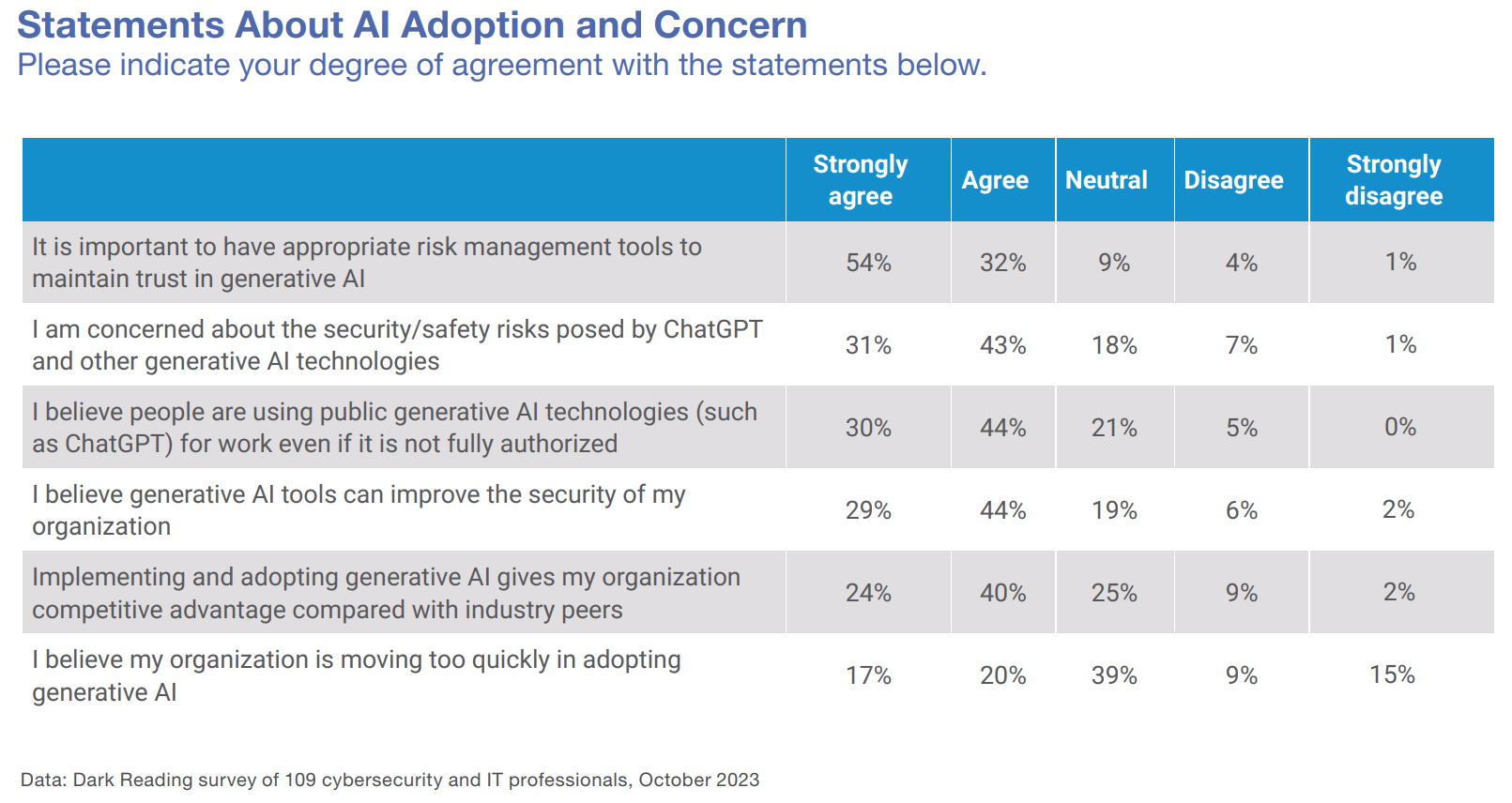

Bijna driekwart van de respondenten uit de enquête spreekt enige bezorgdheid uit over de beveiligings- en veiligheidsrisico's die ChatGPT en andere generatieve AI-technologieën met zich meebrengen. Ongeveer hetzelfde aantal gelooft ook dat werknemers publieke generatieve AI-technologieën gebruiken voor werkdoeleinden, zelfs als ze daar niet volledig geautoriseerd voor zijn.

Een meerderheid van de respondenten (86%) zegt dat de organisatie over de juiste risicobeheerinstrumenten moet beschikken om het vertrouwen in de technologie te behouden. Er bestaat echter enige vraag over welke strategieën we moeten gebruiken om risico’s te beperken, of dat nu gaat om AI-governance (43%), het definiëren van datarichtlijnen en beleid (42%), het beoordelen van de antwoorden van generatieve AI om ongewenste resultaten te identificeren (42%) en het opzetten van een AI-applicatiebeveiligingsprogramma (40%). Een kleine meerderheid (57%) zegt dat er bewustmakingstrainingen nodig zijn die zich richten op verantwoorde AI-praktijken.

Eén deelnemer aan de enquête zegt: “Ik wou dat die verwarde jongeren de risico’s konden begrijpen!”

Terwijl 30% van de respondenten zegt dat de verantwoordelijkheid voor het inzetten en beheren van generatieve AI-tools onder de IT in hun organisatie valt, zegt 17% dat dit onderdeel is van cyberbeveiliging en heeft 25% een speciale AI-groep. Toch valt de uiteindelijke verantwoordelijkheid voor beveiliging en risicobeheer voor generatieve AI voor 27% van de respondenten onder cybersecurity, en voor 21% van de respondenten onder de toegewijde AI-groep.

Hoewel er geen duidelijke meerderheid was op de vraag naar de grootste uitdagingen waarmee de organisatie wordt geconfronteerd met betrekking tot generatieve AI-beveiliging en risicobeheer, waren de vier belangrijkste antwoorden: onzekerheid over hoe naleving van de regelgeving van toepassing is op generatieve AI (47%), geen transparantie in de derde fase. partij-generatieve AI-tools (46%), geen consensus over generatieve AI-richtlijnen en -beleid (43%), en data governance (39%).

Lees meer over waar lezers van Dark Reading over denken generatieve AI in de onderneming.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://www.darkreading.com/cyber-risk/security-pros-grapple-with-ways-to-manage-gen-ai-risk