편집자별 이미지

들었어? 안드레이 카르 파시? 그는 딥러닝과 신경망 분야의 연구로 유명한 컴퓨터 과학자이자 AI 연구자입니다. 그는 OpenAI에서 ChatGPT 개발에 핵심적인 역할을 했으며 이전에는 Tesla의 AI 수석 이사였습니다. 그 전에도 그는 첫 번째 딥러닝 수업을 설계하고 주 강사로 활동했습니다. Stanford – CS 231n: 시각적 인식을 위한 컨볼루셔널 신경망. 이 수업은 스탠포드에서 가장 큰 수업 중 하나가 되었으며 150년에 등록한 학생 수가 2015명에서 750년에는 2017명으로 늘어났습니다. 딥 러닝에 관심이 있는 사람이라면 YouTube에서 이 동영상을 시청할 것을 적극 권장합니다. 나는 그에 대해 더 자세히 설명하지 않을 것이며, YouTube에서 가장 인기 있는 강연 중 하나로 초점을 전환할 것입니다. 백만 번 조회 1.4 회 “대규모 언어 모델 소개.” 이 강연은 바쁜 사람들에게 LLM을 소개하는 것이며 LLM에 관심이 있는 사람이라면 꼭 시청해야 할 것입니다.

나는 이 강연을 간략하게 요약했습니다. 이것이 관심을 불러일으키면 이 기사 마지막 부분에 제공될 슬라이드와 YouTube 링크를 살펴보는 것이 좋습니다.

이 강연에서는 LLM, 그 기능, LLM 사용과 관련된 잠재적 위험에 대한 포괄적인 소개를 제공합니다. 이는 다음과 같이 3개의 주요 부분으로 나누어진다:

1부: LLM

Andrej Karpathy의 슬라이드

LLM은 인간과 유사한 응답을 생성하기 위해 대규모 텍스트 모음에 대해 교육을 받았습니다. 이 부분에서 Andrej는 Llama 2-70b 모델에 대해 구체적으로 설명합니다. 70억 개의 매개변수를 갖춘 최대 규모의 LLM 중 하나입니다. 모델은 매개변수 파일과 실행 파일이라는 두 가지 주요 구성요소로 구성됩니다. 매개변수 파일은 모델의 가중치와 편향을 포함하는 대규모 이진 파일입니다. 이러한 가중치와 편향은 본질적으로 모델이 훈련 중에 학습한 "지식"입니다. 실행 파일은 매개변수 파일을 로드하고 모델을 실행하는 데 사용되는 코드 조각입니다. 모델의 학습 과정은 다음 두 단계로 나눌 수 있습니다.

1. 사전 훈련

여기에는 인터넷에서 약 10TB에 달하는 큰 텍스트 덩어리를 수집한 다음 GPU 클러스터를 사용하여 이 데이터에 대한 모델을 교육하는 작업이 포함됩니다. 훈련 과정의 결과는 인터넷의 손실 압축인 기본 모델입니다. 일관되고 관련 있는 텍스트를 생성할 수 있지만 질문에 직접적으로 대답할 수는 없습니다.

2. 미세 조정

사전 훈련된 모델은 더 유용하게 만들기 위해 고품질 데이터세트에 대해 추가로 훈련됩니다. 그 결과 보조 모델이 생성됩니다. Andrej는 또한 비교 라벨을 사용하는 것과 관련된 미세 조정의 세 번째 단계에 대해서도 언급합니다. 처음부터 답변을 생성하는 대신 모델에 여러 후보 답변이 제공되고 가장 좋은 답변을 선택하도록 요청됩니다. 이는 답변을 생성하는 것보다 더 쉽고 효율적일 수 있으며 모델 성능을 더욱 향상시킬 수 있습니다. 이 프로세스를 인간 피드백 강화 학습(RLHF)이라고 합니다.

2부: LLM의 미래

Andrej Karpathy의 슬라이드

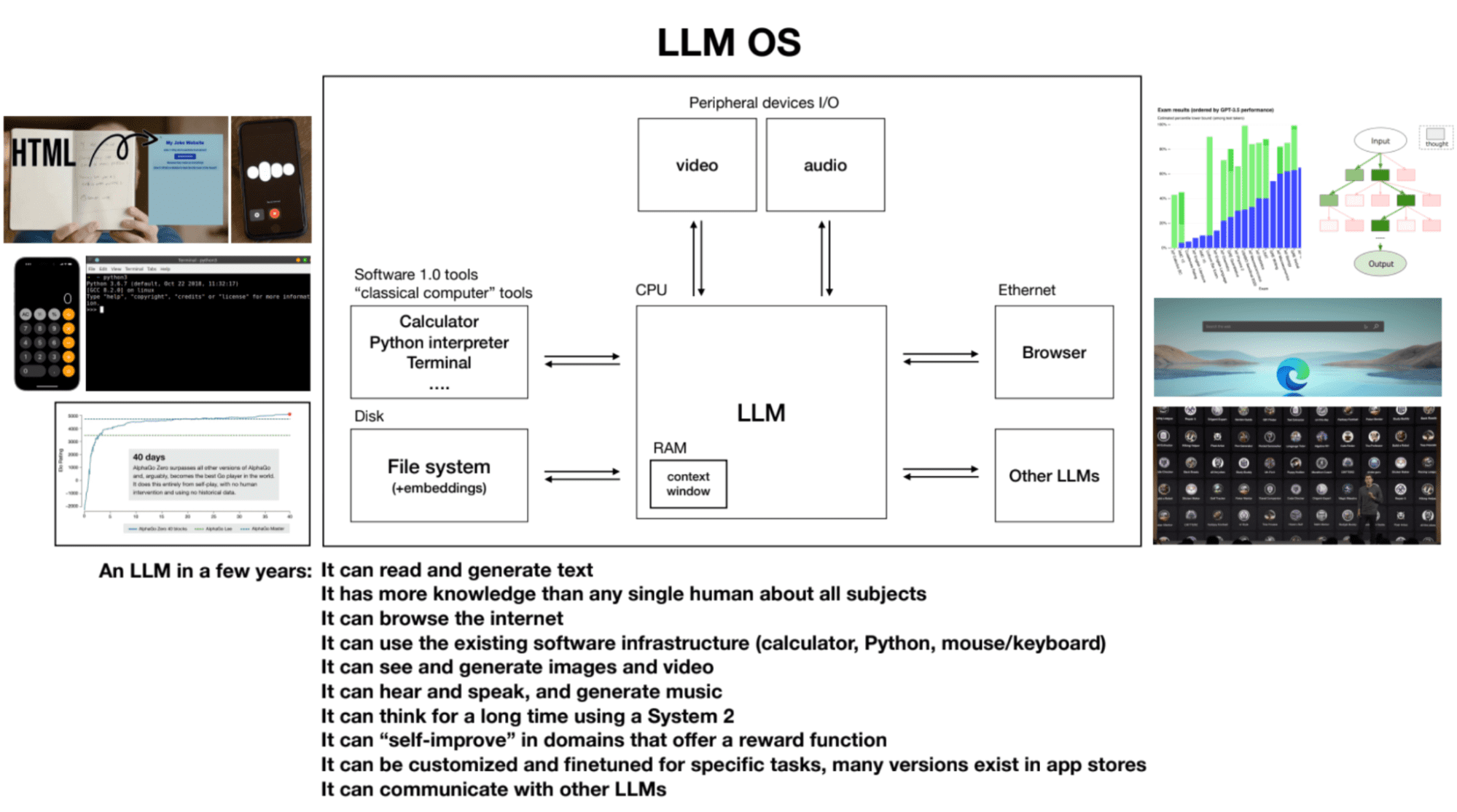

대규모 언어 모델의 미래와 해당 기능을 논의하는 동안 다음과 같은 핵심 사항이 논의됩니다.

1. 스케일링 법칙

모델 성능은 두 가지 변수, 즉 매개변수 수와 학습 텍스트 양과 상관관계가 있습니다. 더 많은 데이터로 훈련된 대규모 모델은 더 나은 성능을 달성하는 경향이 있습니다.

2. 도구의 사용

ChatGPT와 같은 LLM은 브라우저, 계산기, Python 라이브러리와 같은 도구를 활용하여 모델만으로는 어렵거나 불가능한 작업을 수행할 수 있습니다.

3. LLM의 시스템 XNUMX과 시스템 XNUMX 사고

현재 LLM은 주로 빠르고 본능적이며 패턴 기반의 시스템 1 사고 방식을 사용합니다. 그러나 더 느리고 합리적이며 의식적인 노력이 필요한 시스템 2 사고에 참여할 수 있는 LLM을 개발하는 데 관심이 있습니다.

4. LLM 운영 체제

LLM은 새로운 운영 체제의 커널 프로세스로 생각할 수 있습니다. 그들은 시스템 2를 사용하여 텍스트를 읽고 생성하고, 다양한 주제에 대한 광범위한 지식을 갖고, 인터넷을 탐색하거나 로컬 파일을 참조하고, 기존 소프트웨어 인프라를 사용하고, 이미지와 비디오를 생성하고, 듣고 말하고, 오랫동안 생각할 수 있습니다. LLM은 컴퓨터의 RAM과 유사하며 커널 프로세스는 작업을 수행하기 위해 컨텍스트 창 안팎에서 관련 정보를 페이징하려고 시도합니다.

3부: LLM 보안

Andrej Karpathy의 슬라이드

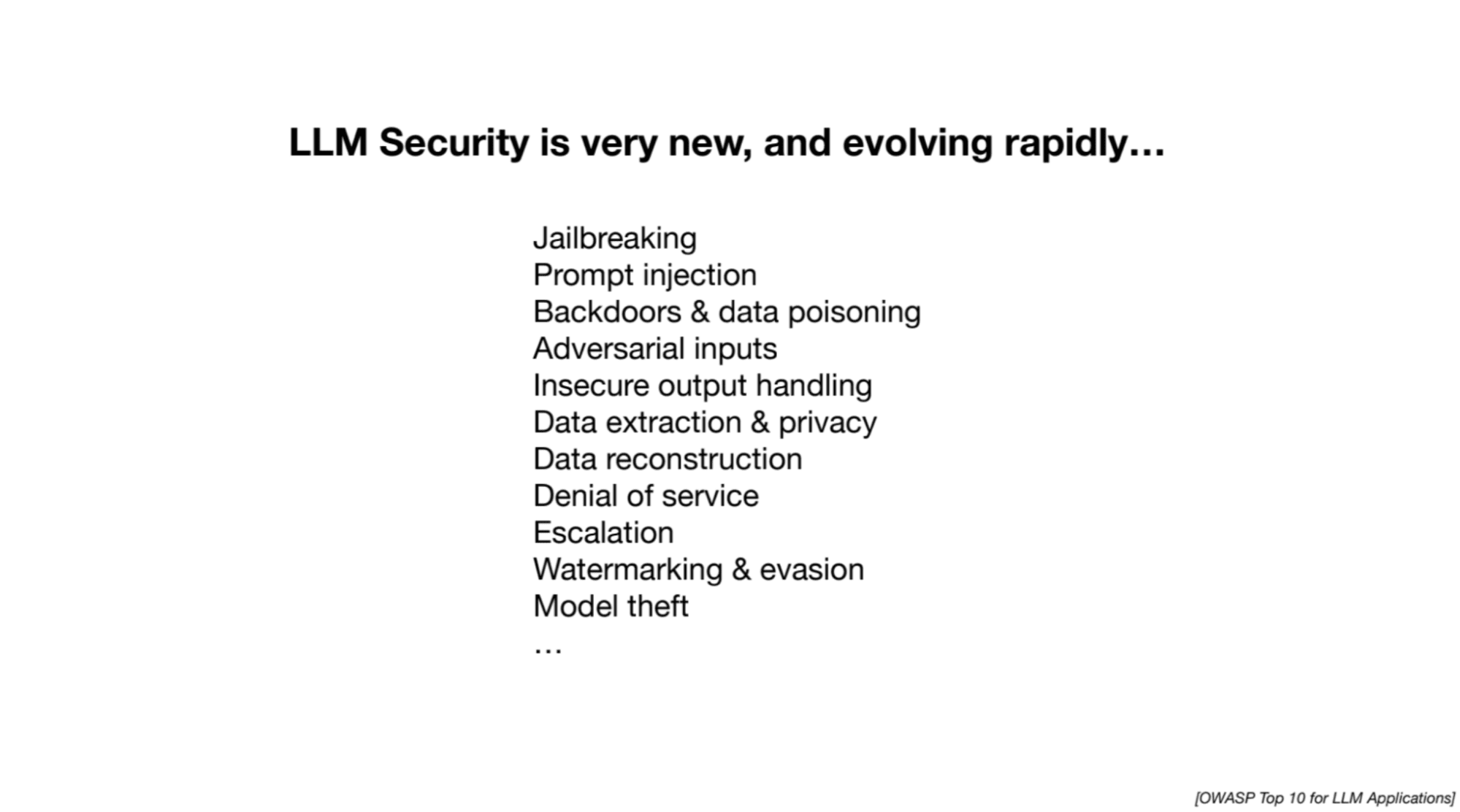

Andrej는 LLM과 관련된 보안 문제를 해결하기 위한 지속적인 연구 노력을 강조합니다. 다음 공격에 대해 설명합니다.

1. 탈옥

유해하거나 부적절한 정보를 추출하기 위해 LLM의 안전 조치를 우회하려고 시도합니다. 예를 들어 모델을 속이는 역할극, 단어나 이미지의 최적화된 시퀀스를 사용하여 반응을 조작하는 것 등이 있습니다.

2. 신속한 주입

응답을 조작하기 위해 LLM에 새로운 지침이나 프롬프트를 주입하는 것과 관련됩니다. 공격자는 이미지나 웹 페이지 내에 지침을 숨겨 모델의 답변에 관련이 없거나 유해한 콘텐츠를 포함시킬 수 있습니다.

3. 데이터 중독/백도어 공격/슬리퍼 에이전트 공격

트리거 문구가 포함된 악의적이거나 조작된 데이터에 대한 대규모 언어 모델 교육이 포함됩니다. 모델이 트리거 문구를 발견하면 바람직하지 않은 작업을 수행하거나 잘못된 예측을 제공하도록 조작될 수 있습니다.

아래를 클릭하면 YouTube에서 전체 동영상을 시청할 수 있습니다.

[임베디드 콘텐츠][임베디드 콘텐츠]

슬라이드 : 여기를 클릭하세요.

LLM이 처음이고 여정을 시작하는 데 필요한 리소스를 찾고 있다면 이 포괄적인 목록이 시작하기에 좋은 곳입니다! 여기에는 탄탄한 기초를 다지는 데 도움이 되는 기초 과정과 LLM 관련 과정이 모두 포함되어 있습니다. 또한, 보다 체계적인 학습 경험에 관심이 있다면, 막심 라본느 최근 귀하의 필요와 경험 수준에 따라 선택할 수 있는 세 가지 다른 트랙이 있는 LLM 과정을 시작했습니다. 귀하의 편의를 위해 두 리소스에 대한 링크는 다음과 같습니다.

칸월 메린 데이터 과학 및 의료 분야의 AI 응용에 큰 관심을 가진 소프트웨어 개발자 지망생입니다. Kanwal은 APAC 지역의 Google Generation Scholar 2022로 선정되었습니다. Kanwal은 유행하는 주제에 대한 기사를 작성하여 기술 지식을 공유하는 것을 좋아하며 기술 산업에서 여성의 대표성을 개선하는 데 열정적입니다.

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- PlatoData.Network 수직 생성 Ai. 자신에게 권한을 부여하십시오. 여기에서 액세스하십시오.

- PlatoAiStream. 웹3 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 플라톤ESG. 탄소, 클린테크, 에너지, 환경, 태양광, 폐기물 관리. 여기에서 액세스하십시오.

- PlatoHealth. 생명 공학 및 임상 시험 인텔리전스. 여기에서 액세스하십시오.

- 출처: https://www.kdnuggets.com/unlock-the-secrets-of-llms-in-a-60-minute-with-andrej-karpathy?utm_source=rss&utm_medium=rss&utm_campaign=unlock-the-secrets-of-llms-in-a-60-minute-with-andrej-karpathy