더욱이, 중요한 고려 사항은 이러한 AI 기술이 공항, 항공기 및 다양한 첨단 모빌리티 시스템과 같은 고부가가치 및 수요가 높은 인프라 내의 기존 생태계에 어떻게 적응하고 혁명을 일으킬 수 있는지입니다.

혁신적인 AI 기술을 활용하고 Cranfield University의 플랫폼 장점을 활용하여 석사 응용 인공 지능 과정 다양한 엔지니어링 영역에 걸쳐 응용 AI 분야의 미래 리더를 양성하는 것을 목표로 합니다. 주요 목표는 전 세계적으로 안전이 중요한 애플리케이션을 위한 신뢰할 수 있는 AI 기술의 개발과 배포를 가속화하는 것입니다.

그룹 디자인 프로젝트(GDP)는 문제 기반 학습 모듈이며, GDP의 목표는 학생들이 실제 문제를 해결하기 위해 실시간 AI 기반 시스템을 설계, 구현, 검증 및 테스트하는 것입니다. GDP는 또한 학생들에게 공동 엔지니어링 프로젝트를 진행하고 잠재 고객의 요구 사항을 충족하며 마감 기한을 준수하는 경험을 제공하는 것을 목표로 합니다.

2022년과 2023년에 응용 인공 지능 석사 과정에 등록한 학생들에게는 자극적이고 까다로운 그룹 디자인 프로젝트가 할당되었습니다. 목표는 교과 과정에서 습득한 응용 AI 지식을 활용하여 혁신적이고 안전한 공항 제품을 개발하는 것이었습니다. XNUMX명으로 구성된 소규모 팀에서 학생들은 소프트웨어 및 하드웨어 아키텍처, AI 모델 개발 및 테스트, 실제 참여 측면을 포괄하는 솔루션을 설계하는 임무를 맡았습니다.

프로젝트의 주제는 의도적으로 광범위하여 학생들이 그룹 내에서 협력하여 집단적 전문 지식과 관심을 기반으로 특정 관심 영역을 탐색하고 개선하도록 요구했습니다. 이러한 접근 방식은 창의성과 팀워크를 촉진하고 실제 시나리오에서 AI 기술의 실제 적용에 대한 더 깊은 이해를 촉진했습니다.

각 그룹은 다음 기능을 달성하기 위해 스마트 공항을 위한 실시간 AI 솔루션을 개발하도록 요청 받았습니다.

- 시스템은 정확한 자세 감지 및 추적을 기반으로 인간 사용자를 감지하고 사용자의 자세와 행동을 추정할 수 있어야 합니다.

- 시스템은 다양한 군중 행동을 분류하고 이유, 중요성 및 타당성을 명확히 할 수 있어야 합니다.

- AI 모델은 정확도, 컴퓨팅 및 추론의 다양한 측정항목을 사용하여 교차 검증되어야 합니다.

- AI 모델은 안전이 중요한 애플리케이션에서 현재 AI 기술의 장점과 단점을 알려주기 위해 실시간으로 구현될 수 있어야 합니다.

- 시스템은 강력한 성능을 위해 센서 융합을 가능하게 하기 위해 다양한 센서 소스를 입력으로 사용할 수 있지만 매우 저렴하면서도 효율적인 솔루션도 환영받습니다.

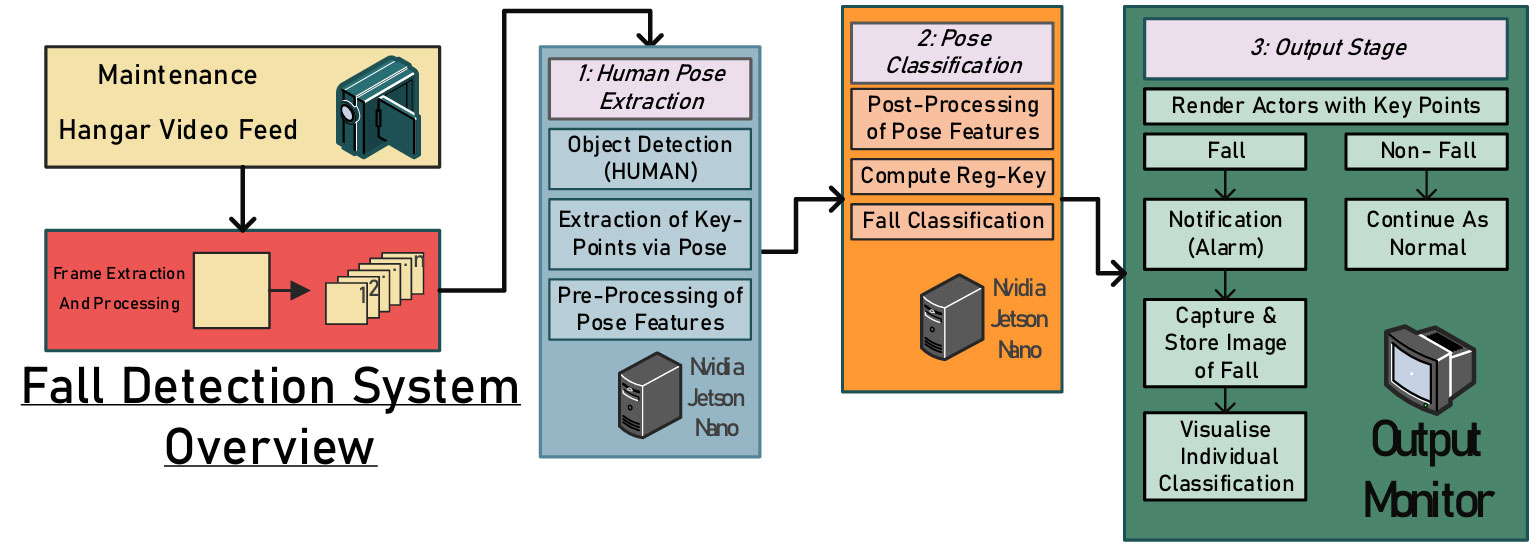

사례 연구 1: 항공기 정비 환경에서 추락 감지.

유지 관리 환경은 무인 기계, 위험한 지역 근처의 부적절한 울타리 또는 물리적 가드, 어수선한 작업 공간 등 심각한 위험을 초래합니다. 이러한 위험 중에서 치명적인 낙상 부상은 놀라울 정도로 흔합니다. 치명적이지 않은 사고를 즉시 감지하고 보고하면 추가 피해나 사망을 예방할 수 있습니다. 따라서 본 연구에서는 항공기 정비 활동 중 직원을 모니터링하여 안전을 강화하고 사고를 예방할 수 있는 통합 비전 기반 시스템을 제안합니다(아래 그림 참조).

.fusion-gallery-1 .fusion-gallery-image {테두리:0px 솔리드 #e2e2e2;}

설계된 모델의 초기 훈련 및 검증 결과에서 기성 공항 격납고 유지 관리 데이터세트가 명백히 없다는 점은 피사체에 근접하여 촬영한 수직 카메라 각도에서 캡처한 비디오의 이미지에 대한 편향 가능성을 나타냅니다. Cranfield의 장점을 활용하여 Cranfield University 유지 보수 격납고가 선택되어 이 프로젝트의 데이터 수집에 사용되었습니다.

전체적으로 시뮬레이션된 유지 관리 활동에 대한 약 50개의 짧은(XNUMX~XNUMX분) 비디오가 녹화되었으며 일부는 넘어지고 다른 일부는 넘어지지 않았습니다. 캡처된 비디오는 프레임으로 분리되었으며 MoveNet 자세 추정 소프트웨어 라이브러리를 사용하여 주석이 달렸고 대상의 주요 관절 위치에 대한 벡터 맵이 생성되었습니다. 아래 그림은 실험 데이터의 일부 스냅샷을 보여줍니다.

.fusion-gallery-2 .fusion-gallery-image {테두리:0px 솔리드 #e2e2e2;}

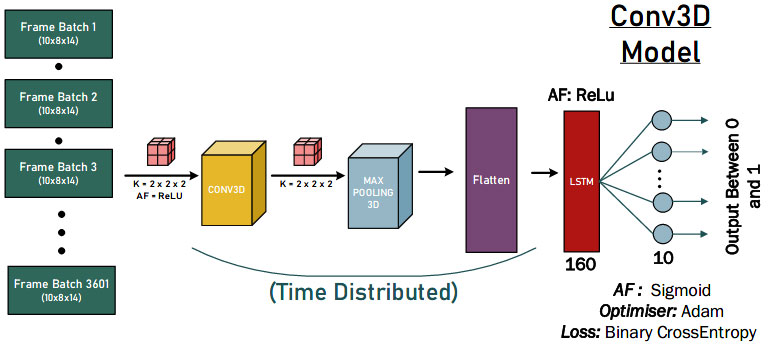

우리 학생들은 가장 강력한 AI 모델의 설계를 정량적으로 평가하기 위해 1D, 2D 및 3D 컨벌루션 신경망 접근 방식을 테스트했습니다. 아래 그림은 3D 컨볼루션 솔루션을 보여줍니다.

.fusion-gallery-3 .fusion-gallery-image {테두리:0px 솔리드 #e2e2e2;}

마지막으로 제안된 AI 솔루션은 아래 그림과 같이 추락 행위에 대한 좋은 탐지 결과를 얻었습니다. 몇 가지 결론을 내릴 수 있습니다. 첫째, 모델에는 FP 분류가 0개 있었는데, 이는 모델이 추락을 잘못 분류하지 않았음을 의미합니다. 둘째, 각 모델마다 940개의 참음성이 있는데, 이는 행위자가 넘어지기 전에 넘어지지 않은 부분(0으로 분류됨)을 포함하는 각 테스트 데이터 때문일 수 있습니다.

.fusion-gallery-4 .fusion-gallery-image {테두리:0px 솔리드 #e2e2e2;}

사례 연구 2: 컴퓨터 비전과 엣지 AI를 사용하여 심근경색의 활력징후 감지

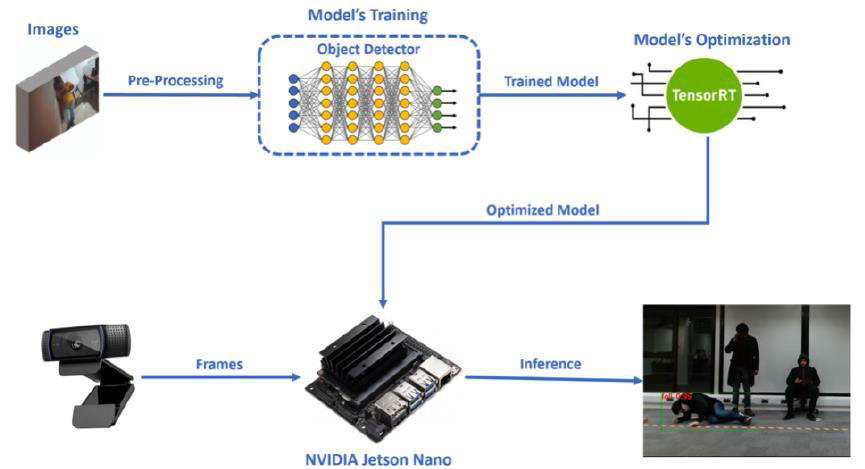

Edge AI는 물리적 환경 전반에 걸쳐 위치한 장치에 인공 지능 애플리케이션을 배포하는 것을 의미합니다. 경제성과 사용 편의성은 최종 사용자가 실제 문제에 직면하는 상황에서 AI 알고리즘을 채택하는 데 있어 핵심 요소입니다. 본 프로젝트에서 우리 학생은 공항에서의 신속한 대응과 구조를 위한 저비용, 경량의 심장마비 감지 모델을 제안했습니다. 프로세스는 아래 그림과 같이 크게 4단계로 구성됩니다.

.fusion-gallery-5 .fusion-gallery-image {테두리:0px 솔리드 #e2e2e2;}

첫 번째 단계는 클래스(가슴 통증, 낙상)의 경계 상자에 필요한 주석과 함께 이미지 데이터 세트의 적절한 선택 및 준비로 구성됩니다.

또한 두 번째 단계에서는 전이 학습을 통해 객체 감지 모델을 훈련합니다. 특정 단계는 PyTorch를 사용하여 Google Colab에서 수행되었습니다. 그 후, 훈련 단계가 완료된 후 모델은 Edge AI 컴퓨터 비전 애플리케이션에 사용하기 위해 선택한 임베디드 장치인 NVIDIA의 Jetson Nano에 삽입되었습니다.

시스템 설계의 세 번째 단계는 모델이 Jetson Nano에서 보다 효율적으로 실행될 수 있도록 모델을 적절하게 변환하고 최적화하는 것이었습니다. 우리 모델의 최적화는 NVIDIA의 TensorRT 추론 엔진을 사용하여 수행되었으며 특정 프로세스는 Jetson Nano에서 실행되었습니다(아래 그림 참조).

.fusion-gallery-6 .fusion-gallery-image {테두리:0px 솔리드 #e2e2e2;}

마지막 단계는 웹 카메라에서 수신한 프레임을 입력으로 사용하여 실시간 객체 감지 프로세스를 수행하고 클래스(가슴 통증, 넘어짐)를 감지하는 Jetson Nano에서 최적화된 모델을 실행하는 것입니다. 이 프로세스와 함께 Jetson Nano에서 실행되는 추론 코드에는 두 가지 특정 시나리오가 있었습니다. 최종 추론 결과는 아래 그림과 같습니다.

.fusion-gallery-7 .fusion-gallery-image {테두리:0px 솔리드 #e2e2e2;}

사례 연구 3: 군중 모니터링 및 사회적 거리두기 분석

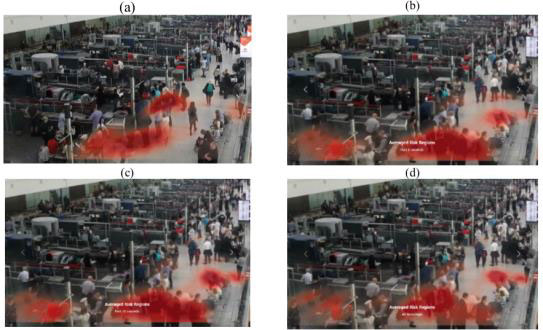

공항에는 매일 엄청난 양의 승객이 유입되고 있으며, 다른 혼잡한 장소 및 조직과 마찬가지로 공공 안전을 보장하고 전염병 발생 시 위험을 완화하기 위한 적절한 조치를 시행해야 합니다. 이 프로젝트에서 우리 학생들은 공항 전체에서 다기능 군중 모니터링 및 분석을 제공하는 통합 컴퓨터 비전 기반 시스템을 제안했습니다. 시스템 출력은 군중 기반 분석 및 인텔리전스를 제공하여 공항 관리 직원과 승객 모두에게 혜택을 주기 위한 것입니다.

이 시스템은 비디오 감시 피드를 사용하여 공공 장소의 군중을 분석하고 모니터링하는 통합 플랫폼(아래 그림 참조)으로 구성됩니다. 초점은 특히 스마트 공항에 있지만 기본 프레임워크는 군중 특성을 분석하고 모니터링하는 것이 유용한 모든 공공 상황에 적용할 수 있습니다.

.fusion-gallery-8 .fusion-gallery-image {테두리:0px 솔리드 #e2e2e2;}

장면에서 추출된 포즈 특징은 시스템 다운스트림 모델에서 고유한 작업을 수행하는 데 사용됩니다. 여기에는 사람 수 세기, 개인 간 거리 추정, 마스크 물체 감지, 상태 분류(앉기, 서기, 걷기, 누워기 등), 사회적 클러스터링이 포함됩니다. 그 결과는 통합 대시보드와 모니터링 시스템을 구성하기 위해 결합됩니다. 포즈 기능의 일반적인 사용을 제외하고 이러한 작업은 다양한 모델링 접근 방식의 고유한 과제를 나타냅니다. 다행스럽게도 모듈식 시스템 설계 덕분에 각 작업을 추상화하고 여러 팀 구성원이 이를 개발하도록 하는 것이 가능했습니다.

.fusion-gallery-9 .fusion-gallery-image {테두리:0px 솔리드 #e2e2e2;}

마지막으로, 모든 다운스트림 출력을 단일 뷰포트에 통합하도록 상호 작용 가능한 인터페이스가 설계되었습니다(아래 그림 참조). 앱은 다운스트림 모델에서 생성된 데이터 파일을 실시간으로 대시보드에 업로드하여 현장의 현재 상태를 분석할 수 있습니다. 언제든지 장면의 원본 영상을 인접한 비디오 플레이어에서 각 사람에게서 추출한 포즈 특징과 함께 볼 수 있습니다. 의사 결정자는 상자 그림 보기와 히트맵 보기 사이를 전환한 후 두 개의 드롭다운 메뉴에서 데이터가 수신되는 영상을 변경할 수 있습니다. 장면에 관한 통계는 뷰포트 바로 오른쪽에 표시됩니다. 이러한 통계는 총 사람의 마스크 상태, 총 위험 프로필, 총 사람의 포즈 상태, 총 사람 수, 사회적 거리두기 비율 및 비율 상자 그림입니다.

.fusion-gallery-10 .fusion-gallery-image {테두리:0px 솔리드 #e2e2e2;}

사례 연구 4: 공항에서의 폭력 감지

마지막으로 우리 그룹 중 하나는 인간의 자세를 추정하고 감시 영상에서 폭력적인 행동을 분류하는 폭력 탐지 프레임워크를 개발하는 것을 목표로 합니다(아래 그림 참조). 이 프레임워크는 비디오 프레임에서 직접 특징을 추출하는 대신 ViTPose를 사용하여 각 프레임에서 사람의 포즈를 감지한 다음 핵심 포인트 정보에서 전처리 및 특징을 추출합니다.

.fusion-gallery-11 .fusion-gallery-image {테두리:0px 솔리드 #e2e2e2;}

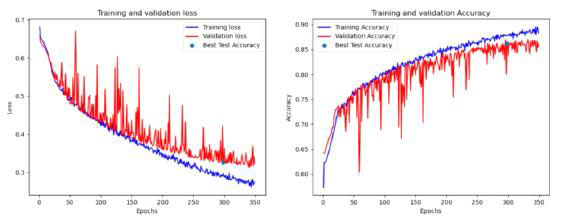

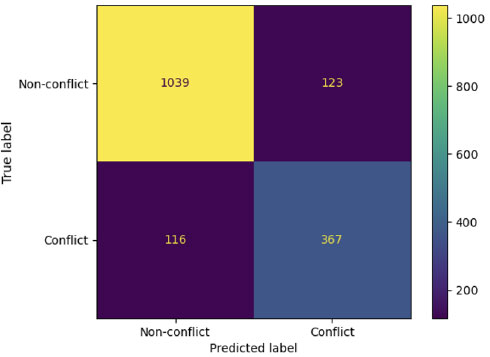

총 1개의 하이퍼파라미터 조합이 포함된 여러 데이터 세트(각도 기반, 거리 기반, 2초 및 162초 시퀀스)를 사용하여 다양한 모델을 종합적으로 분석한 결과, 팀은 마침내 특정 평가 기준을 충족하는 몇 가지 유망 모델을 식별했습니다. 아래 그림과 같이 모델은 신체 주요 지점의 거리 특성을 사용하여 폭력적인 행동에 대한 귀중한 정보를 추출할 수 있다는 결론을 내릴 수 있습니다.

.fusion-gallery-12 .fusion-gallery-image {테두리:0px 솔리드 #e2e2e2;}

마지막으로, 학생들은 Saab UK와 협력하여 AI 모델을 개발하고 많은 영국 경찰서에서 감시용으로 널리 사용되는 강력한 상황 인식 플랫폼인 산업 수준 플랫폼(SAFE)과 통합할 수 있습니다. KAFKA 게이트웨이는 AI 엔진에 따라 적용되며 추가 표시 및 경고를 위해 클라이언트 터미널로 전달됩니다. 경계 상자가 있는 가로채기된 비디오에서 폭력이 감지되면 SAFE 클라이언트 레이아웃에서 가로채기된 비디오를 표시하는 모델용으로 특별히 구성한 경보가 트리거되고 세부 정보가 포함된 경고 메시지가 제공됩니다. 결국 우리 학생들은 DARTeC 센터에서 AI 모델을 성공적으로 배포하고 인간 상황 인식 증강을 위해 Saab SAFE 시스템과 통신했습니다.

.fusion-gallery-13 .fusion-gallery-image {테두리:0px 솔리드 #e2e2e2;}

미래의 응용 AI 엔지니어 양성

이는 MSc AAI 과정에서 선택된 흥미로운 GDP 프로젝트의 몇 가지 샘플입니다. 최근 AI와의 설명 가능한 인터페이스, 자율 동작 계획을 위한 인과 추론, 자율 차량을 위한 물리학 기반 AI 및 미래 영공 관리에 대한 보다 도전적인 GDP 프로젝트가 현재 학생들에 의해 수행되었습니다. 우리는 곧 MSc 학생들이 더 흥미로운 연구를 수행할 것이라고 믿습니다.

최종 솔루션과 결과가 얼마나 흥미로운지 알아보려면 GDP 기간 동안 학생들이 발표한 다음 연구 간행물을 확인하세요.

- Osigbesan, Adeyemi, Solene Barrat, Harkeerat Singh, Dongzi Xia, Siddharth Singh, Yang Xing, Weisi Guo 및 Antonios Tsourdos. “자세 추정을 통한 항공기 정비 환경의 비전 기반 추락 감지.” 2022년 지능형 시스템(MFI)을 위한 다중 센서 융합 및 통합에 관한 IEEE 국제 컨퍼런스, 페이지 1-6. IEEE, 2022.

- 프레이저, 벤자민, 브렌든 콥, 거프리트 싱, 오르한 케이반, 통페이 비안, 발렌틴 손태그, 양 싱, 웨이시 구오, 안토니오스 추르도스. “AI 기반 군중 모니터링 및 사회적 거리두기 분석을 통해 바이러스 전파 감소.” 2022년 지능형 시스템(MFI)을 위한 다중 센서 융합 및 통합에 관한 IEEE 국제 컨퍼런스, 페이지 1-6. IEEE, 2022.

- Üstek, İ., Desai, J., Torrecillas, IL, Abadou, S., Wang, J., Fever, Q., Kasthuri, SR, Xing, Y., Guo, W. 및 Tsourdos, A., 2023, 팔월. 스마트 공항에서 ViTPose 및 분류 모델을 사용한 2023단계 폭력 탐지. 797년 IEEE 스마트 월드 콩그레스(SWC)(pp. 802-XNUMX). IEEE.

- Benoit, Paul, Marc Bresson, Yang Xing, Weisi Guo 및 Antonios Tsourdos. “자세 추정을 통한 CCTV 카메라를 통한 실시간 비전 기반 폭력 행위 감지.” 2023 IEEE 스마트 월드 콩그레스(SWC), pp. 844-849. IEEE, 2023.

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- PlatoData.Network 수직 생성 Ai. 자신에게 권한을 부여하십시오. 여기에서 액세스하십시오.

- PlatoAiStream. 웹3 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 플라톤ESG. 탄소, 클린테크, 에너지, 환경, 태양광, 폐기물 관리. 여기에서 액세스하십시오.

- PlatoHealth. 생명 공학 및 임상 시험 인텔리전스. 여기에서 액세스하십시오.

- 출처: https://blogs.cranfield.ac.uk/aerospace/exploring-safer-and-smarter-airports-with-the-applied-artificial-intelligence-msc-group-design-project/