イーロン・マスク氏の人工知能ベンチャー、 xAI、Grok言語モデルのアップグレード版がリリースされ注目を集めています。 Grok-1.5 と呼ばれる、この最新のバージョンでは、短期記憶が大幅に強化され、推論能力が向上しました。

Grok-1.5 のメモリの力

Grok-1.5 のアップグレードの中核となる点は、短期記憶容量の大幅な増加です。大規模言語モデル (LLM) では、このメモリは「」で測定されます。トークン"

大まかに言えば、トークンは、単語または単語の一部にかかわらず、テキスト内の意味の基本単位と考えることができます。 Grok-1.5 は最大 128,000 トークンを処理できるようになりました 前世代と比べて16倍に増加.

この拡張メモリ容量が重要な理由?

これにより、Grok-1.5 はタスクを実行しながら、かなり大きな情報の塊を保持して処理できるようになります。一度に XNUMX つの段落しか読むことができない状況で、複雑な法的契約書を理解しようとすることを想像してみてください。

を備えたAI 強力な短期記憶は全体像を「見る」ことができるにより、より適切な意思決定を行い、より洞察力に富んだ応答を生成できるようになります。

推理が飛躍する

Grok-1.5 は、メモリの強化に加えて、推論機能の向上も示しています。これは、情報間の複雑な関係をより深く理解し、論理的な結論を導き出す能力につながります。

ユーザーにとって、これは Grok-1.5 が以下の機能をさらに強化できる可能性があることを意味します。

- 長い文章内のニュアンスや複雑さを理解する

- 完全に直線的ではない場合でも、一連の指示や要求に従う

- 文書の重要なポイントを正確に反映した要約を提供する

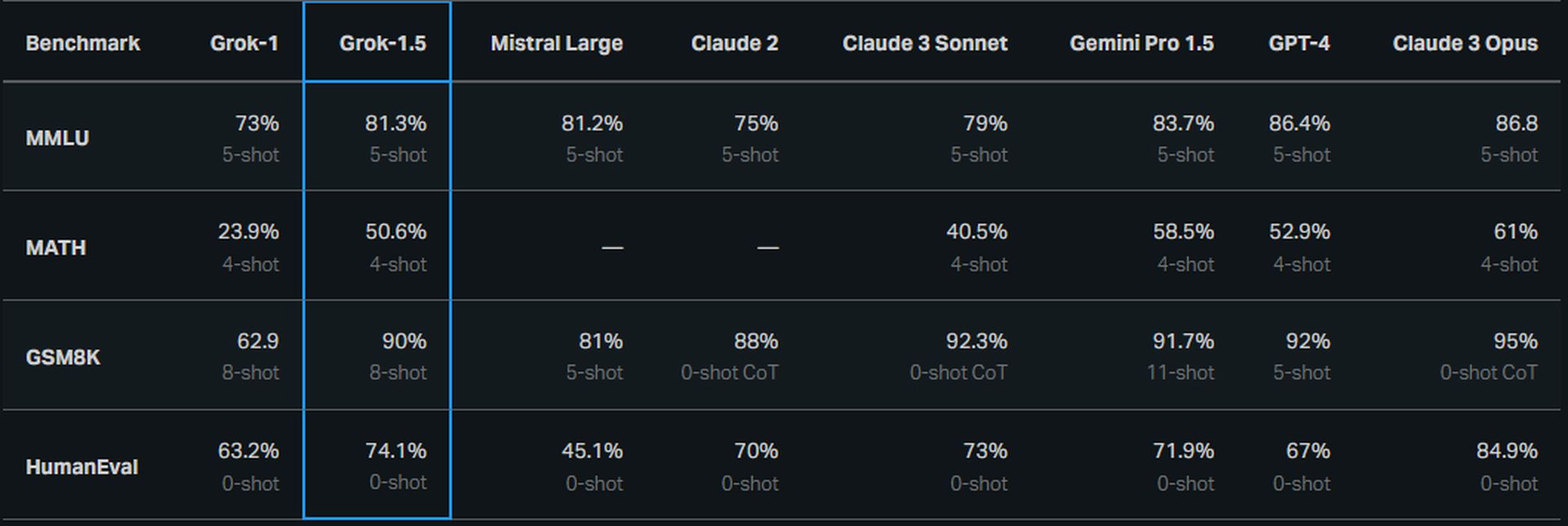

コーディングと計算が強化される

xAI は、Grok-1.5 の数学およびコーディング能力を特にターゲットにしているようです。 xAI 独自のテストによると、これらのスキルを測定するベンチマークのパフォーマンスが著しく向上しました。 MATH ベンチマーク (小学生および競技レベルの数学の問題を集めたもの) では、Grok-1.5 のスコアは 50.6% でした。また、GSM90K ベンチマーク (別の数学問題集) で 8% のスコアを示しました。

さらに、Grok-1.5 は、コードを生成し、コーディングベースの問題を解決する AI の能力を測定する HumanEval ベンチマークで 74.1% のスコアを獲得しました。これらは有望な数字ですが、xAI はスキルの他の分野における進捗状況やスコアについてまだ詳細を明らかにしていません。

これはユーザーにとって何を意味するのでしょうか?

Grok-1.5 のアップグレードの技術的な詳細は印象的ですが、これらすべては実際にユーザーにとって何を意味するのでしょうか?機能強化によってメリットが得られる可能性のある領域をいくつか次に示します。

- 文書分析: Grok-1.5 は、長く複雑なテキストやレポートを要約するのに優れた機能を備えている可能性があります。これにより、長い文書の要点をすぐに理解する必要がある人にとっては時間を節約できます。

- 文芸: 推論と記憶の向上により、Grok-1.5 は創作的な物語、台本、さらには詩であっても、より一貫性のある構造化されたテキスト形式を生成できる可能性があります。

- 問題解決:AI によって向上した数学およびコーディングのスキルは、計算が必要なタスクや特定の目的のためのコードの生成に役立つ可能性があります。

しかし、それで巨人の王座を奪うことができるだろうか?

Grok-1.5 のメモリが LLM 分野の他の主要企業と比べてどのように積み重なっているかを分析してみましょう。

- Grok-1.5: Grok は 128,000 トークンの短期記憶容量を備えており、この特定の部門において大きな優位性を誇っています。

- GPT-4: 正確な数字は公的に確認されていませんが、推定によると、ChatGPT 4 のトークン数は数万で、特に Grok-1.5 よりも少ないことが示唆されています。

- Google Gemini アドバンスト:GoogleのAIモデルのトークン数は100,000万を超えると噂されています。 Grok-1.5 よりはまだ小さいですが、その差は ChatGPT 4 で見られるものよりも小さくなっています。

Grok-1.5 のメモリの増加は明確な利点をもたらしますが、ChatGPT 4 や Google Gemini Advanced のような現在の巨人の座を奪えるという保証はありません。 LLM 分野での成功は、複数の要因が複雑に絡み合うことによって決まります。

レースは続く

Grok-1.5 のリリースは、AI 分野の急速な進歩の時期に行われました。企業や研究機関は常に限界に挑戦しています。 LLM できる。

競争がイノベーションを促進する刺激的な時代です。今後数か月、数年のうちに、Grok がさらに改良され、まったく新しい AI モデルが導入されることが予想されます。

注目の画像クレジット: X.ai

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://dataconomy.com/2024/03/29/xais-grok-1-5-upgrade/