Wikipedia stufte die Zuverlässigkeitsbewertung von CNET herab, nachdem die seit 30 Jahren bestehende Tech-Publikation KI nutzte, um Nachrichten zu generieren, die sich als plagiiert und mit Fehlern behaftet herausstellten.

CNET veröffentlicht mehr als 70 Artikel zu Finanzratschlägen, die zwischen November 2022 und Januar 2023 von künstlicher Intelligenz verfasst wurden. Die Artikel wurden unter der Überschrift „CNET Money Staff“ veröffentlicht.

Eine Prüfung bestätigte, dass viele der Geschichten sachliche Fehler, schwerwiegende Auslassungen und plagiierte Inhalte enthielten. CNET gestoppt Nachdem die Nachricht Anfang 2023 bekannt wurde, wurden von KI geschriebene Geschichten veröffentlicht, aber der Schaden war laut Wikipedia bereits angerichtet.

Lies auch: CNET setzt KI nach Veröffentlichung einer Reihe schlechter Artikel aus

Degradierung von KI-gesteuertem CNET

„CNET, das normalerweise als gewöhnlicher Tech-RS [zuverlässige Quelle] angesehen wird, hat damit begonnen, experimentell KI-generierte Artikel zu veröffentlichen, die voller Fehler sind“, sagte Wikipedia-Herausgeber David Gerard berichtet vom Futurismus.

„Bisher kommt das Experiment nicht so gut an, wie es nicht sein sollte. Ich habe noch keine gefunden, aber jeder dieser Artikel, der es in einen Wikipedia-Artikel schafft, muss entfernt werden.“

Gerard sprach, um a anzukurbeln Treffen von Wikipedia-Redakteuren diskutieren im Januar 2023 über die KI-Inhalte von CNET. Redakteure des Besserwisser-Online-Wörterbuchs unterhalten das Wikipedia-Forum „Zuverlässige Quellen“ oder „Perennial Sources“, in dem sie sich treffen, um zu entscheiden, ob eine Nachrichtenquelle vertrauenswürdig ist und für Zitate verwendet werden kann.

Das Forum bietet eine Rangliste der Nachrichtenagenturen nach ihrer Zuverlässigkeit. Nach vielen Stunden der Debatte waren sich die Herausgeber einig, dass die KI-gesteuert Die Version von CNET war nicht vertrauenswürdig und stufte den Inhalt der Website auf „im Allgemeinen unzuverlässig“ herab.

„Lassen Sie uns einen Schritt zurücktreten und darüber nachdenken, was wir hier gesehen haben“, sagte ein anderer Wikipedia-Redakteur mit dem Namen „Bloodofox“.

„CNET hat eine Reihe von Inhalten mit KI erstellt, einige davon als von Menschen geschrieben aufgeführt (!), behauptet, alles sei von Menschen bearbeitet und überprüft worden, und hat dann, nachdem es erwischt wurde, einige ‚Korrekturen‘ herausgegeben, gefolgt von Angriffen auf die Journalisten.“ das hat darüber berichtet“, fügten sie hinzu.

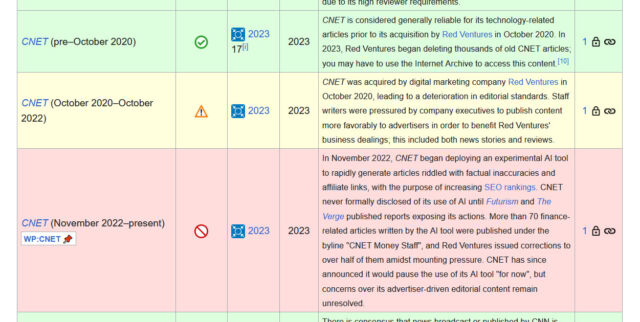

Die mehrjährigen Wikipedia-Quellen Seite gliedert die Zuverlässigkeitsbewertungen für CNET in drei Zeiträume: 1. Vor Oktober 2020, als CNET als „allgemein zuverlässig“ galt; und 2. Oktober 2020 bis Oktober 2022, wobei Wikipedia die Website im Anschluss daran nicht bewertete 500 Mio. US$ Übernahme durch Red Ventures.

Die dritte Periode dauert von November 2022 bis heute. Während dieser Zeit stufte Wikipedia CNET zu einer „im Allgemeinen unzuverlässigen“ Quelle herab, nachdem die Website auf KI umgestiegen war, „um schnell Artikel voller sachlicher Ungenauigkeiten und Affiliate-Links zu generieren“.

Google findet kein Problem mit KI

Laut dem Futurism-Bericht ging es für CNET nach der Übernahme von Red Ventures im Jahr 2020 bergab. Wikipedia sagte, der Eigentümerwechsel habe „zu einer Verschlechterung der redaktionellen Standards“ geführt, weil Red Ventures angeblich SEO Vorrang vor Qualität einräumte. Es war nicht nur CNET, das im Stall heimlich mit KI experimentierte.

Wikipedia-Redakteure wiesen auch auf andere Zuverlässigkeitsprobleme hin, die separate Websites von Red Ventures betreffen, darunter Healthline und Bankrate. Berichten zufolge wurden auf den bildungsorientierten Websites Inhalte bereitgestellt, die von KI ohne Offenlegung oder menschliche Aufsicht geschrieben wurden.

„Red Ventures war diesbezüglich nicht im Entferntesten transparent – das Unternehmen könnte bestenfalls als betrügerisch bezeichnet werden“, sagte der anonyme Wikipedia-Herausgeber Bloodofox.

In einer Erklärung zum Wikipedia-Downgrade und zu KI-erstellten Inhalten behauptete CNET, dass es „unvoreingenommene, technologieorientierte Nachrichten und Ratschläge“ bereitstelle.

„Wir genießen seit fast 30 Jahren Vertrauen aufgrund unserer strengen Redaktions- und Produktbewertungsstandards“, sagte ein Sprecher gegenüber Futurism. „Es ist wichtig klarzustellen, dass CNET KI nicht aktiv zur Erstellung neuer Inhalte nutzt. Obwohl wir keine konkreten Pläne für einen Neustart haben, würden alle zukünftigen Initiativen unserer öffentlichen KI-Richtlinie folgen.“

Die Wikipedia-Entscheidung unterstreicht die anhaltenden Bedenken hinsichtlich des Einsatzes von KI zur Erstellung von Artikeln in der Medienbranche. In der Zwischenzeit, Google hat kein Problem mit KI-Material, solange es nicht zur Manipulation des Suchalgorithmus verwendet wird.

Laut Google die Vermittlung von Kompetenzen, In Bezug auf KI-generierte Inhalte sagt das Unternehmen, dass es schon immer „an die Kraft der KI geglaubt hat, die Fähigkeit zur Bereitstellung hilfreicher Informationen zu verändern“.

Laut Google konzentrieren sich seine Ranking-Systeme auf die Qualität der Inhalte und nicht darauf, wie diese erstellt werden, sei es durch Menschen oder KI. Es geht um Fachwissen, Erfahrung, Autorität und Vertrauenswürdigkeit.

Das Unternehmen stellt jedoch fest, dass der Einsatz von Automatisierung, einschließlich KI, zur Generierung von Inhalten mit dem Hauptzweck, das Ranking in Suchergebnissen zu manipulieren, „einen Verstoß gegen unsere Spam-Richtlinien darstellt.“

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://metanews.com/how-ai-generated-content-led-to-a-reliability-rating-downgrade-for-cnet/