Partnerinhalt Huawei Cloud veranstaltete während des MWC24 Barcelona eine Reihe von Veranstaltungen zum Thema „Accelerate Intelligence with Everything as a Service“, darunter den Huawei Cloud Summit, die Produkt- und Lösungseinführung und das Cloud Native Elite Club (CNEC)-Seminar.

Diese Anlässe sollten die Infrastruktur von Huawei als Keimzelle für Innovationen im Bereich der künstlichen Intelligenz (KI) präsentieren, wobei Führungskräfte und Experten aus verschiedenen Branchen über die ganzheitlichen Auswirkungen sowie die bahnbrechenden Möglichkeiten der Kombination von KI mit Datenbanken, Big Data und Mediendiensten nachdenken und Computerarchitektur.

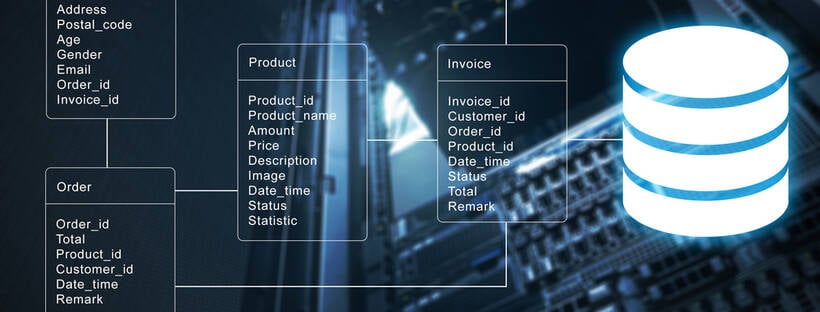

Huawei Cloud präsentierte GaussDB auf allen drei Veranstaltungen. Während des Cloud Summit stellte Bruno Zhang, CTO von Huawei Cloud, die verteilte relationale Datenbank GaussDB vor, die häufig im Finanz-, Telekommunikations- und Regierungssektor verwendet wird. „Eine starke Datenbank ist eine solide Datengrundlage, die intelligente digitale Upgrades unterstützt“, betonte Herr Zhang.

Durch den Einsatz von KI-Funktionen bei der Datenbankmigration, -bereitstellung und -wartung macht GaussDB die Datenverarbeitung für KI-Anwendungen effizienter, so Huawei.

Die neueste Version der Datenbank, die im Jahr 2023 eingeführt wurde, zeichnet sich durch Serviceverfügbarkeit rund um die Uhr, konstant hohe Leistung unter hoher Last und Stabilität in Szenarien mit hoher Parallelität aus. Es verbindet außerdem die CC EAL4+-Zertifizierung mit sicherem Quellcode und End-to-End-Verschlüsselungsmaßnahmen.

Dr. Nikos Ntarmos, Direktor des Datenbanklabors des Huawei Central Software Institute, betonte, dass GaussDB, das auf der über 20-jährigen Erfahrung von Huawei im Datenbankbereich basiert, darauf abzielt, die hohen Anforderungen der Kunden an Datenbankintelligenz und -automatisierung zu erfüllen.

Dr. Ntarmos fügte hinzu, dass diese Bemühungen die Stärkung der „selbstfahrenden“ Fähigkeiten in Schlüsselphasen der Datenpipeline beinhalten, die Datenbankberatung, Entwicklung sowie Betrieb und Wartung (O&M) umfassen. Während der Beratungsphase kann GaussDB durch die Verbindung großer und kleiner Modelle automatisch High-Level-Designs (HLDs) generieren, um beispielsweise die Effizienz des Lösungsdesigns zu verbessern. Er schätzte, dass dieser Vorteil den Lösungsentwurfszeitraum von etwa zwei Wochen auf etwa zwei Tage verkürzen kann.

In der Entwicklungsphase generiert GaussDB direkt SQL-Anweisungen über Natural Language-to-SQL- und SQL-to-SQL-Funktionen mit automatischer Identifizierung und Verbesserungsvorschlägen für schlechte SQL-Anweisungen. In der O&M-Phase automatisiert GaussDB die Inspektion, Berichterstellung und Fehlerabgrenzung und liefert gleichzeitig Behandlungsvorschläge für fehlerhafte SQL-Anweisungen.

Dr. Ntarmos erklärte, dass die Kompatibilität der Datenbank mit der gängigen Syntax, die in gängigen kommerziellen Datenbanken verwendet wird, sie zu einer Migrationslösung macht, die manuelle Eingriffe und Migrationskosten minimiert. GaussDB wurde in die Kernsysteme großer Banken, Aktienbanken und Versicherungsunternehmen in China sowie großer Huawei Cloud-Kunden in Brasilien und Thailand übernommen.

Huawei Cloud konzentriert sich auf KI als Schlüsselstrategie

Jacqueline Shi, Präsidentin des Huawei Cloud Global Marketing and Sales Service, lobte das überzeugende Potenzial der KI, fast alles neu zu gestalten. „Bei Huawei Cloud ist KI eine Schlüsselstrategie“, erklärte Frau Shi. „Bei uns erhalten Sie umfassende KI-Lösungen, wie zum Beispiel KI-Rechenleistungslösungen und Pangu-Modelle. Huawei Cloud ist einer der am schnellsten wachsenden Cloud-Anbieter. Wir hoffen, unseren Kunden Spitzentechnologien, den besten lokalen Service und mehr und bessere Auswahlmöglichkeiten bieten zu können.“

„Wir erleben eine neue Ebene der Intelligenz, angetrieben durch Grundlagenmodelle und generative KI“, wiederholte Herr Zhang. „Es wird prognostiziert, dass bis 2026 mehr als 80 Prozent der Unternehmen AIGC (Artificial Intelligence Generated Content) in der Produktion nutzen werden, wodurch 70 Prozent der Design- und Entwicklungsarbeit verändert werden. Bis 2028 werden 75 Prozent der Softwareentwickler KI-Assistenten an ihrer Seite haben, Anfang 10 waren es nur 2023 Prozent.“

„Kunden wünschen sich eine kollaborative heterogene Computing-Architektur, Cloud-native Computing mit überragender Leistung, Massendatenspeicherung, Sicherheitskonformität, schlanke Governance und flexible Bereitstellung“, fügte William Fang, Chief Product Officer bei Huawei Cloud, hinzu. „Nur durch die Integration von KI und Cloud sind Fortschritte in der Intelligenz möglich.“

Um Kunden dabei zu helfen, ihre KI-Reise zu beschleunigen, hob Herr Fang große Sprachmodelle, Big Data und Rechenleistung als wichtige Erfolgsfaktoren bei der Entwicklung der Huawei Cloud-Infrastruktur hervor.

Darüber hinaus erfordert die Beschleunigung der Intelligenz bei gleichzeitiger Ausrichtung des enormen Potenzials und der Implementierung von KI auf Geschäftsziele, auch wenn Produktion, Serviceparadigmen und Geschäftsmodelle für traditionelle Anwendungen neu definiert werden, systematische Innovation.

Zu diesem Zweck schlug Herr Zhang eine zweigleisige Strategie vor. „AI for Cloud nutzt KI und Basismodelle, um Ihr Erlebnis zu verbessern“, sagte er. „Sie gestalten Branchenanwendungen und unsere eigenen Cloud-Dienste neu, einschließlich Softwareentwicklung, Produktion digitaler Inhalte und mehr. Cloud for AI sorgt für eine nahtlose und effiziente KI-Einführung. Architektonische Innovation, KI-nativer Speicher und Daten-KI-Konvergenz ermöglichen es Ihnen, KI wie nie zuvor zu trainieren und zu nutzen.“

Die systematischen Innovations- und Branchenpraktiken von Huawei Cloud umfassen unter anderem die technische Entwicklung in den Bereichen Systemarchitektur, Computer, Speicher, Datenbank, Big Data sowie Pangu-Modelle für Automobil, Wetter, virtuelle Menschen, Forschung und Entwicklung und mehr.

Systematische KI-Geschäftsausrichtung

Herr Zhang erläuterte die Stoßrichtung „Cloud for AI“ wie folgt: „Foundation-Modelle und ihre Anwendungen sind die bislang komplexesten Software- und Hardwaresysteme. Beispielsweise haben wir neue Herausforderungen im Bereich Computing entdeckt. Deshalb werden wir von einer CPU-zentrierten Architektur zu einer heterogenen Peer-to-Peer-Cloud-Architektur übergehen, in der unterschiedliche Rechenressourcen gleichberechtigt arbeiten.“

Zhang fügte hinzu, dass Cloud-Dienste der Schlüssel zur Erreichung der hyperskalierten, stabilen und robusten KI-Berechnung seien, die für Basismodelle erforderlich sei. Eine solche Berechnung übertrifft das Mooresche Gesetz bei weitem. Huawei Cloud unterstützt Telekommunikationsunternehmen mit seiner verteilten QingTian-Architektur, KI-nativem Speicher, End-to-End-Sicherheit und Daten-KI-Konvergenz beim Aufbau einer intelligenten Cloud-Infrastruktur.

Die QingTian-Architektur beseitigt die Engpässe, die den Fortschritt großer KI-Rechencluster einschränken, indem sie Peer-to-Peer-Full-Mesh-Computing ermöglicht. Ein Hochgeschwindigkeits-Verbindungsbus integriert Kommunikation, Ressourcenmanagement und Funktionsaufrufe nahtlos in eine optimale Recheninfrastruktur.

„Wir haben drei große KI-Rechenzentren und über 30 Unterzentren auf dem chinesischen Festland eingerichtet“, sagte Herr Zhang. „Sie betreiben Hyperscale-Cluster, um Modelle mit Billionen Parametern zu unterstützen. Bald wird unser KI-Cloud-Service in der Region Hongkong in Betrieb gehen, um globale Kunden zu bedienen.“

Darüber hinaus unterstützt der KI-native Speicher datenintensive Trainingsmodelle. Ein dreigleisiger Ansatz umfasst den Speicherdienst Expanded Memory Specification (EMS), der Petabytes an Parametern mit 220 TB extrem großer Bandbreite und extrem niedriger Latenz bis auf die Mikrosekunde speichert. Ergänzt wird dies durch Scalable File Service Turbo – einen Cache-Dienst für hohen Durchsatz und Parallelität von mehreren zehn Millionen Ein-/Ausgabevorgängen pro Sekunde – und einen Object Storage Service Knowledge Lake, der Trainings- und Inferenzdaten kostengünstig speichert.

Die End-to-End-Sicherheit von Huawei Cloud schützt die Modelllaufzeitumgebungen, Trainingsdaten, die Modelle selbst, generierte Inhalte und Anwendungen von Industriekunden.

Foundation-Modelle basieren auf Daten und Datenbanken

Die Verbreitung von Basismodellen erfordert auch die Notwendigkeit, qualitativ hochwertige Daten auf effizientere Weise bereitzustellen, um das Training und die Inferenz von Modellen zu unterstützen.

„Wir nutzen LakeFormation, eine einheitliche Datenressource und Metadatentechnologie, um aus mehreren Data Lakes oder Warehouses einen logischen Data Lake aufzubauen“, sagte Herr Zhang. „Das bedeutet, dass eine Kopie der Daten von mehreren Datenanalyse-Engines und KI-Engines gemeinsam genutzt werden kann, ohne dass eine Datenmigration erforderlich ist. Darüber hinaus macht unsere AI4Data-Engine den gesamten Data-Governance-Prozess – von der Datenintegration über die Entwicklung bis hin zum Qualitäts- und Asset-Management – intelligenter.“

Auf dem Gipfel beschrieb Huawei Cloud auch, wie seine KI-orientierten Innovationen und sein umfassendes Branchenwissen über Pangu-Modelle – einschließlich des virtuellen Menschenmodells – zu einer KI-fähigen Infrastruktur beigetragen haben, die viele Branchen neu gestaltet.

Die Pangu-Modelle kombinieren Branchenwissen und LLM-Fähigkeiten (Large Language Model), um einen Expertenassistenten zu schaffen, der die Arbeit für Branchen, Unternehmen oder einzelne Benutzer möglicherweise effizienter und einfacher machen könnte.

Im Gegensatz zu LLMs wie ChatGPT verfügen Pangu Models 3.0 von Huawei Cloud über eine dreischichtige entkoppelte Architektur, so das Unternehmen. Die L0-Schicht besteht aus fünf Basismodellen, die allgemeine Fähigkeiten für branchenspezifische Anwendungen bereitstellen. L1 enthält branchenspezifische Modelle, die anhand von Branchendaten trainiert werden, während L2 Modelle für spezifische Branchenszenarien und -aufgaben bereitstellt.

Herr Zhang führte Fälle an, in denen das Pangu-Telekommunikationsmodell Telekommunikationsunternehmen dabei half, bis zu 90 Prozent der Netzwerkfehler innerhalb von Minuten automatisch zu beheben, während das Pangu-Forschungs- und Entwicklungsmodell es Entwicklern ermöglicht, Code mit nur einer Eingabeaufforderung zu generieren und Fälle mit nur einem Klick zu testen. Bei der Wettervorhersage wurde Pangu auch verwendet, um den Weg eines Taifuns über einen Zeitraum von 10 Tagen genauer und innerhalb von 10 Sekunden auf einem einzigen Server vorherzusagen, fügte er hinzu.

Bemerkenswert ist, dass das virtuelle Menschenmodell von Pangu eine Lippensynchronisationsgenauigkeit von 95 Prozent für Kundenservice und Livestreaming aufweist. Virtuelle Menschen werden häufig in Bereichen wie E-Commerce, Nachrichtensendungen, Bildung und Ausbildung eingesetzt.

In der Automobilindustrie generiert Pangu automatisch Eckfälle für komplexe Fahrszenen aller Art und verkürzt so die Zeit, die autonome Fahrmodelle zum Erlernen neuer Szenen benötigen. Weitere Modelle sind in der Pipeline. Pangu-Modelle und zugehörige Cloud-Dienste können mit vertrauenswürdiger Sicherheit und Compliance in einer öffentlichen Cloud, einer dedizierten Zone oder einer Hybrid-Cloud bereitgestellt werden.

Mit diesen Ankündigungen auf dem Gipfel machte Frau Shi die Pläne von Huawei Cloud deutlich, ein offenes Ökosystem von Cloud-Diensten und neuen Unternehmen anzubieten. Das Unternehmen arbeitet mit Kunden und Partnern zusammen, um szenariobasierte Lösungen für vertikale Branchen zu entwickeln, während es KooVerse, die Infrastruktur von Huawei Cloud, weltweit weiter ausbaut, um einfachen Zugriff und hohe Leistung zu gewährleisten.

Dieser Artikel wurde von Huawei verfasst.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://go.theregister.com/feed/www.theregister.com/2024/03/08/meeting_customer_requirements_for_database/