Apple Vision Pro är en mycket imponerande blandning av hårdvara och mjukvara, men den är inte på något sätt perfekt. Läs vidare för min uppdelning av Vision Pro-hårdvaran och mjukvaran och upplevelsen de möjliggör.

Apple Vision Pro-specifikationer, funktioner och detaljer

Apple avslöjade officiellt de fullständiga Vision Pro-specifikationerna när de öppnade förbeställningar idag. Läs vår specifikation och jämförelse med Quest 3 här.

Om du vill läsa en specificering av Vision Pro på papper kan du göra det här.. Den här recensionen kommer att referera till några av dessa specifikationer, men det handlar i första hand om den faktiska upplevelsen av att använda produkten. Och för att vara tydlig så använde jag den i ett riktigt hem, inte en noggrant kontrollerad demomiljö eller en väl upplyst studio. Och Apple skickade inte UploadVR en recensionsenhet, vi köpte vår egen.

Medan jag ofta diskuterar den långsiktiga potentialen hos AR och VR, granskar jag i den här artikeln Apple Vision Pro som den ser ut som en riktig produkt idag. En produkt som börjar på $3500. Till det priset ställer Apple stora förväntningar. Men levererar det? Är Vision Pro verkligen sju gånger bättre än Quest 3, eller till och med dubbelt så bra? Läs vidare för att ta reda på det.

Det där jäkla batteriet

Förmodligen är den hårdaste hårdvarudebatten just nu i branschen vad man ska göra med det jäkla batteriet.

Om du håller den i visiret ökar du vikten och begränsar datorkraften till smarttelefonchipset. Om du lägger den i den bakre stoppningen gör du det omöjligt att luta dig tillbaka på en stol, soffa eller säng. Och om du gör batteriet externt introducerar du en irriterande och oelegant tjuder. Alla lösningar har hårda avvägningar.

Apple Vision Pro-batterikapacitet avslöjar dess sanna syfte

Apple Vision Pros batteri har en enorm energikapacitet, nästan dubbelt Quest 3, vilket avslöjar att dess sanna syfte inte är att minska headsetets vikt.

Oavsett vad du tycker om detta, valde Apple den tjudrade batterimetoden, åtminstone för sitt första generationens headset. Och det betyder att varje gång du använder Vision Pro måste du medvetet tänka på hur du bäst placerar detta 353 grams ankare, ungefär dubbelt så mycket som en vanlig smartphone, och hur du håller kabeln ur vägen för din vänstra arm . Och om du vill stå upp eller ens bara justera din sittposition, bör du se till att batteriet är i fickan eller hålls det i handen.

Jag har fått tag i kabeln. Jag har slagit bort batteriet från stolen och ryckt obehagligt i headsetet. Och jag har lutat mig för långt åt höger och nått tjudets gräns. Batteritjudern känns alltid närvarande, och eftersom den är så kort är den mycket mer irriterande än den långa tjuden av PC VR-headset eller PlayStation VR2. Jag har plockat upp Quest 3 ofta under de senaste dagarna som en jämförelse med Vision Pro, och det är otroligt uppfriskande att bara kunna sätta headsetet på huvudet och röra sig som du vill, ingen eftertanke krävs.

Tillbaka 2019 vi frågade Oculus-chefen Jason Rubin om hans företag övervägde en tjudrad bärbar datormodell. Han är vad han sa:

"Det är en modell som vi definitivt har utforskat. Det finns många fördelar med det, som att visuellt ha de mindre glasögonen på huvudet, stor fördel. Batteri, hålla vikten borta, värmen borta från skärmen, kunna separera batteri. Allt det där är jättebra.

Problemet är när du gör det, för vi har provat det, du har en tråd. Och du glömmer aldrig den tråden."

Tyvärr hade Rubin helt rätt. Under min tid med Apple Vision Pro hittills har jag nästan aldrig glömt den tråden.

När det gäller den faktiska batteritiden kom jag konsekvent runt de 2 timmar som annonserades, även om du kan ansluta USB-C-ström till batteriet för obestämd användning, och det är så jag tillbringade större delen av min tid i Vision Pro. Med tanke på detta och produktens sittande fokus tycker jag att de populära klagomålen om batteritid, mestadels kommer från de som faktiskt inte äger headsetet, är överdrivna.

Sidenote: batteriet verkar ha en IMU i sig, eftersom att lyfta den eller knacka på den kommer ibland att aktivera strömstatuslampan. Snacka om överteknik!

Smalt vertikalt synfält & ljustätningar

Det allra första jag märkte när jag faktiskt satte Vision Pro i ansiktet var synfältet.

Horisontellt är det bra, och känns ungefär i nivå med Quest 2. Men vertikalt är det ett av de smalaste av alla moderna headset, märkbart smalare än alla Quest.

Detta spelar ingen större roll för att titta på traditionellt videoinnehåll, eftersom det mesta är i widescreen-format ändå. Men det känns något klaustrofobiskt för helt uppslukande innehåll eller se sig omkring med passthrough, begränsar synbarheten av ditt tangentbord i produktivitetsscenarier och gör det farligt att gå runt eftersom du inte kan se marken nedanför. Det är anledning #1 till att Vision Pro praktiskt taget inte kan användas utomhus, och varför videorna du ser av människor som gör detta är influencers som jagar inflytande, inte ärligt visar ett praktiskt användningsfall.

Fascinerande nog är dock Vision Pros smala synfält faktiskt felet på tjockleken på ljusförseglingen, även känd som ansiktsgränssnittet. Du kan tekniskt sett bära Vision Pro utan en lätt försegling, även om Apple inte rekommenderar det och det gör för ont i näsan för att vara praktiskt. Utan ljusförseglingen känns Vision Pros synfält bara några grader smalare än Quest 3.

Det finns 28 olika ljustätningsstorlekar, i formatet NumberNumberLetter, t.ex. 33N. Den första siffran verkar ungefär vara bredden (från 1 till 3), den andra tjockleken (från 1 till 6) och bokstaven näsbryggans storlek, antingen W för bred eller N för smal. Men detta är inte officiellt bekräftat, för att vara tydlig.

Min storlek är 21W, vilket betyder att jag borde ha den tunnaste möjliga ljustätningen, men det minskar synfältet avsevärt jämfört med att inte använda det. Jag kan bara föreställa mig hur mycket sämre synfältet är för de med tjockare ljustätningar.

Det andra konstiga med ljustätningen är att den faktiskt inte blockerar allt ljus. Och jag menar inte på grund av dess form som med andra headset. Själva tätningen är heltäckande, med endast ett litet ljusgap, en fördel med ansiktsskanningsprocessen för att välja den idealiska storleken. Problemet är att tygmaterialet i sig helt enkelt inte är helt ogenomskinligt, så starkt ljus penetrerar det delvis och tränger igenom dina ögon – och linserna, vilket orsakar distraherande bländning. Jag anser att detta är ett rent designfel. Det är också anledning #2 till att Vision Pro praktiskt taget inte kan användas utomhus, och varför videorna du ser på människor som gör detta är influencers som jagar inflytande, inte ärligt skildrar ett praktiskt användningsfall.

IPD-justering och linstydlighet

På Vision Pro hanteras IPD-justeringen helt automatiskt. Och jag menar fullt ut. När du först sätter på den blir du tillsagd att hålla den översta knappen, och du känner (och ser en visualisering av) linserna rör sig horisontellt för att passa dina ögon. Ögonspårningskamerorna känner av dina pupillers positioner och små piezoelektriska ställdon flyttar linserna på plats.

Denna grundidé är inte ny. Automatisk IPD-justering är också en funktion i Pico 4 Enterprise, Pimax Crystal och Varjo headset. Men Vision Pro går faktiskt ett steg längre än någon av dessa: varje lins rör sig oberoende. Detta är viktigt eftersom många människors IPD:er faktiskt är asymmetriska, med en något annorlunda avståndsförskjutning i förhållande till mitten av ansiktet. Med Vision Pro får du i princip perfekt horisontell optisk inriktning. Naturligtvis skulle detta ha varit en mycket större affär i en värld före Quest Pro och Quest 3, som har linser med en ögonlåda så bred att det inte spelar någon roll om din IPD är lite fel inställd.

En annan unik egenskap hos Vision Pro är dynamisk distorsionskorrigering. Den använder ögonspårning för att uppdatera linsens distorsionskorrigeringsmodell i realtid för att ta hänsyn till ögats vinkel varje bild. Meta har visat upp prototyper av detta, men Apple skickade det faktiskt.

Och som med alla headset som skickas, har Vision Pros linser fast fokus, så att du inte får realistisk fokus eftersom en djupsignal och objekt på nära håll är suddigare. Men automatisk IPD-justering per öga och dynamisk distorsionskorrigering är fortfarande anmärkningsvärda funktioner, och jag hoppas båda blir en standard för alla avancerade headset.

När det gäller den faktiska optiska klarheten hos linserna är Apple näst efter Meta. Bilden är generellt skarp och oförvrängd förutom vänster och höger kant på varje öga, ungefär 5 % på varje sida. Vid dessa kanter finns en hård oskärpa och färgkanter som är mycket mer extrema än Quest 3. Detta kan märkas när du använder dina ögon för att titta på en virtuell skärm vid din sida, vilket tvingar dig att vända på huvudet.

Receptbelagda insatser och glasögonstöd

Jag behöver inga glasögon, så jag kan inte kommentera känslan av att använda de receptbelagda insatserna på 150 $ på Vision Pro. Vad jag kan berätta är att varje insats kommer med en QR-liknande kod som Vision Pro skannar för att justera baslinjen för distorsionskorrigeringsmodellen. Mycket imponerande uppmärksamhet på detaljer och kvalitet.

Medan du teoretiskt sett kan stoppa dina glasögon i Vision Pro som min kollega Kyle Reisenbeck testade, Apple avråder starkt från att göra det. Du kan repa linserna och eventuell förvrängning från glasögonen kommer inte att korrigeras för. Ögonspårningen är inte heller designad för att användas genom glasögon, även om Kyle hävdar att det fungerade för honom.

Passthrough är en blandad påse

Klarhet, ljusstyrka, färger och dynamiskt omfång

Trots vad du kanske har hört, i alla utom de ljusaste ljusförhållandena, känns Apple Vision Pros passthrough inte något som en transparent optik. Det ser fortfarande väldigt mycket ut som ett kameraflöde för en smartphone.

Meta Quest 3 använder 4 megapixel färgkameror för passthrough, medan Vision Pro använder 6.5 megapixel kameror. Som jämförelse, för att uppnå genomgående klarhet som påstås vara "praktiskt taget omöjlig att skilja från naturlig syn", PC-baserad Varjo XR-4 använder 20 megapixelkameror.

Som med alla kamerasystem är Vision Pros kvalitet starkt beroende av ljusförhållandena. Men generellt sett, ur ett tydlighetsperspektiv är Vision Pros genomslag märkbart bättre än Quest 3, men inte dramatiskt. Det är något kornigt, men mycket mindre kornigt än Quest 3, och något suddigt, men märkbart mindre suddigt än Quest 3.

Jag använde en miniatyr Snellen diagram (tillhandahålls av min redaktör Ian Hamilton) för att kvantifiera vilken nivå av mänsklig syn som genomströmningen på varje headset kan ge. Med Quest 3 kunde jag nästan läsa den fjärde raden, vilket motsvarar 20/50 vision, medan jag på Apple Vision Pro knappt kunde läsa den femte raden, vilket motsvarar 20/40 vision. Utan headset på kan jag läsa den åttonde raden, vilket betyder 20/20 vision.

Vision Pros passthrough är tillräckligt bra för att det fasta brännviddet blir den främsta begränsande faktorn för att använda din telefon bekvämt. Men det är fortfarande inte tillräckligt bra för att se fina detaljer som liten text på något avstånd bortom en meter eller så, och utan stark belysning är det inte ens tillräckligt bra för att tydligt se tangenterna på ett tangentbord som vilar på dina knän.

Och Vision Pros passthrough är faktiskt sämre än Quest 3:s på vissa sätt. Medan Quest 3:s passthrough är ljus och levande, är Apple Vision Pro mörkare och har dämpade färger med något som ser ut som ett subtilt sepia-tonfilter. Kan detta vara en oavsiktlig avvägning av frontplattan i mörkt glas, eller går det att lösa med mjukvarujusteringar?

Ett område där Vision Pros passthrough lyser dock är dess otroliga dynamiska omfång. Visst kommer Quest 3 dynamiskt att justera sin exponering när du kommer nära en stark ljuskälla, så att till exempel skärmar är tillfälligt synliga, men Vision Pro behöver inte göra det. Kamerans dynamiska omfång är tillräckligt för att hantera en enorm variation av belysning samtidigt, så du får nästan ingen utblåsning. Det är anmärkningsvärt. Även utomhus när solen strålade mot mig, blåstes inte Vision Pros passthrough ut.

Skala, djup och rörelseoskärpa

Den överlägset största skillnaden mellan passthrough på Vision Pro och Quest 3 är den fundamentalt olika underliggande tekniken. Detta ger den mest betydande fördelen som Vision Pros passthrough har jämfört med Quest 3, men den har också några allvarliga kompromisser.

Svårigheten med passthrough som koncept är att kamerorna inte är placerade där dina ögon är. Linserna, bildskärmarna och datorhårdvaran skapar avstånd mellan dem.

På Quest är vyn du ser av den verkliga världen en realtidsreprojektion av kameravyn. Headsetet kör en datorseendealgoritm på gråskalespårningskamerorna för att generera en första persons djupkarta per bildruta, och pixlarna från färgkamerorna är sneda för att matcha denna djupkarta, i syfte att leverera en vy med rätt djup och skala du skulle se från dina ögons position. I närområdet använder Quest till och med positionsspårning så att ditt huvud kan översättas genom denna omprojekterade vy innan nästa kamerabild ens är tillgänglig för att minimera upplevd latens. Problemet med detta tillvägagångssätt är att djupkartan per bildruta är mycket låg upplösning och inte helt korrekt, vilket är anledningen till att Quest 3:s passthrough uppvisar den fruktansvärda bubbelförvrängning som vi kritiserat hårt. i vår recension, varför avstängning av positionsspårning också stänger av genomgången, och varför genomgången kommer att rycka och skeva våldsamt i ett fordon i rörelse.

Det är väldigt uppenbart att Apple Vision Pro inte använder den här typen av realtidsprojektion. Det finns ingen skevhet av något slag, någonsin, även när jag målmedvetet blockerade spårningskamerorna. Den tror aldrig att ett glasfönster är en 2D-bild. Och att täcka kamerorna på ena sidan av headsetets framsida, vilket på Quest bryter återprojektionen, gör ingenting på Vision Pro förutom att släcka ena ögat. Men hur jag verkligen vet att Vision Pro inte är en dynamiskt omprojekterad vy är att skalan och perspektivet är något avvikande. Ja, det stämmer, Apple Vision Pros passthrough är inte djupkorrekt. Detta var mest överraskande aspekt av Vision Pro för mig, och något jag har sett nästan ingen annan recension nämna.

Att vara fri från Quest-förvrängningen är djupt uppfriskande, kan kännas sublimt i jämförelse, och det är förmodligen vad de flesta människor menar när de berömmer Vision Pros passthrough. Och om du sitter i en soffa där det enda som är nära dig är dina händer, kommer du förmodligen inte ens att märka att vyn du ser inte är djupkorrekt. Men om du sitter vid ett skrivbord kommer du definitivt att märka hur bordet och bildskärmen framför dig snett när du roterar huvudet, på ett sätt som virtuella objekt inte gör det. Och på dessa nära avstånd kommer du också att märka att inriktningen av virtuella objekt med verkliga objekt är något avvikande när du rör på huvudet. Detta beror inte på något spårningsfel, det är igen, bara det att Vision Pros syn på den verkliga världen inte är djupkorrekt. Lyft upp Quest 3 och du kommer att se verkliga objekt kvar i den position och skala de var i när du hade headsetet på. Lyft upp Vision Pro så ser du att allt är något förskjutet. Apple prioriterade geometrisk stabilitet till priset av felaktigt djup och skala, medan Meta prioriterade djup och skala till priset av hård bubbelförvrängning.

Att Vision Pros syn inte är en dynamisk återprojektion är också väldigt uppenbart när du går. Gå igenom ditt hem eller utomhus i Vision Pro och varje steg kommer att få genomgångsvyn att skaka något och till och med få mig att känna mig lite illamående. Gör samma sak på Quest 3 och även om du kommer att se snedvridning på väggar, är vyn du ser fri från skakningar, för återigen, du rör dig genom en omprojektion, utan att se rå kamerautdata. Detta är skäl #3 till att Vision Pro praktiskt taget inte kan användas utomhus, och varför videorna du ser av människor som gör detta är influencers som jagar inflytande, inte ärligt skildrar ett praktiskt användningsfall.

En annan intressant skillnad mellan Apples och Metas metoder för passthrough är den resulterande dubbla bildens rörelseoskärpa. På Vision Pro uppvisar rörliga föremål som dina händer ingen suddighet när ditt huvud är stilla, och ser nästan perfekt ut. Men det finns en betydande dubbelbild när du roterar huvudet – så mycket att "wow, det är verkligen suddigt när du rör på huvudet" var den första reaktionen från den enda person som jag har demonstrerat Vision Pro för hittills. Varför detta är intressant är att på Quest 3 är det raka motsatsen; rörliga föremål som dina händer uppvisar betydande dubbelbild, medan rotation av huvudet resulterar i väldigt lite. Allt är av samma orsak: på Vision Pro ser du en kameramatning från en annan position än dina ögon, medan du på Quest ser en vy som projiceras om för att försöka matcha vad dina ögon skulle se.

Hands-On: Metas omprojektionsfria genomgångsprototyp

På SIGGRAPH 2023 provade vi Flamera, Metas forskningsprototyp av reprojektionsfri passthrough AR. Läs våra intryck och tankar här:

Det ska bli fascinerande att se hur Apples och Metas olika tillvägagångssätt utvecklas i framtida produkter. Teoretiskt sett, med en mycket högre upplösningsdjupkarta, borde Meta kunna minimera avvägningarna med omprojektering samtidigt som dess fördelar bibehålls. Att förbättra Vision Pros djup och skala skulle å andra sidan kräva att headsetet blir mycket smalare och att EyeSight försvinner, eller att kamerorna på något sätt placeras under det, så att kamerorna kan vara närmare dina ögon. Alternativt kan båda företagen använda en ny hårdvarubaserad lösning som Metas Flamera prototyp, eller implementera en neurala nätverksbaserade lösning med framtida kraftfullare chipset.

Fantastiska Near-4K OLED-mikroskärmar

Vad du snabbt inser är att begränsningarna för Vision Pros syn på den verkliga världen definitivt härrör från kamerorna, inte skärmarna, eftersom det virtuella innehållet som överlagras på din vy är inget annat än fantastiskt.

Vision Pro's nära 4K mikro-OLED-skärmar är den överlägset mest imponerande delen av dess hårdvara och placerar dess visuella kvalitet i en annan liga än alla andra konkurrenter. Det är en frisk fläkt på en marknad fylld med 2K LCD-headset med sina grumliga gråsvarta och dämpade färger.

(film från Apple)

Färgerna är livfulla, kontrasten och det dynamiska omfånget är otroligt, och det finns inte en hårdvarupixel i sikte. För första gången i något konsumentheadset jag har provat, kan jag inte urskilja hårdvarupixlarna i något scenario, och små detaljer är tydligt synliga.

Det är också det första fristående headsetet som har upplösningen att göra de produktivitetsanvändningar som företagen lovar som Meta i åratal nu faktiskt lönsamt, utan att behöva göra skärmarna större än headsetets synfält. Med en bekväm visningsstorlek känns läsbarheten någonstans mellan en 1440p och 4K-skärm. Detta är en vattendelare för headset i VR-stil.

| headset | Display Tech | Upplösning per öga |

| Oculus Rift och HTC Vive (2016) |

OLED | 1080 × 1200 (PenTile) |

| Ventilindex (2019) |

Display | 1440 × 1600 |

| måluppdrag 2 (2020) |

Display | ~1680×1870 (uppskattat) |

| måluppdrag 3 (2023) |

Display | 2064 × 2208 |

| Bigscreen Beyond (2023) |

Mikro-OLED | 2560 × 2560 |

| apple vision pro (2024) |

Mikro-OLED | 3660 × 3200 |

Det finns dock ett problem med Apple Vision Pros skärmar, uthålligheten, vilket betyder hur lång tid per bild som skärmen faktiskt är upplyst. Det är högre än nästan alla andra headset, och det betyder att du kommer att se viss rörelseoskärpa när du rör på huvudet även i helt virtuellt innehåll. Det är ett exempel på hur Apple Vision Pro optimerades för stationärt sittande, inte aktiv rörelse. Och det gör Vision Pro till ett suboptimalt headset för allt innehåll där du snabbt roterar huvudet, till exempel de få aktiva spelen.

Ett annat mindre problem är att för att driva denna upplösning använder Vision Pro ständigt eyetracked foveated rendering. I inbyggda appar byggda med RealityKit fungerar det oftast bara, även om du ibland ser mindre visuella artefakter i periferin. Men i vissa Unity-appar märkte jag mycket uppenbara och hårda artefakter, särskilt på text. Detta är tydligen ett känt problem, med korrigeringar som kommer i framtida versioner av Unity visionOS-integrationen.

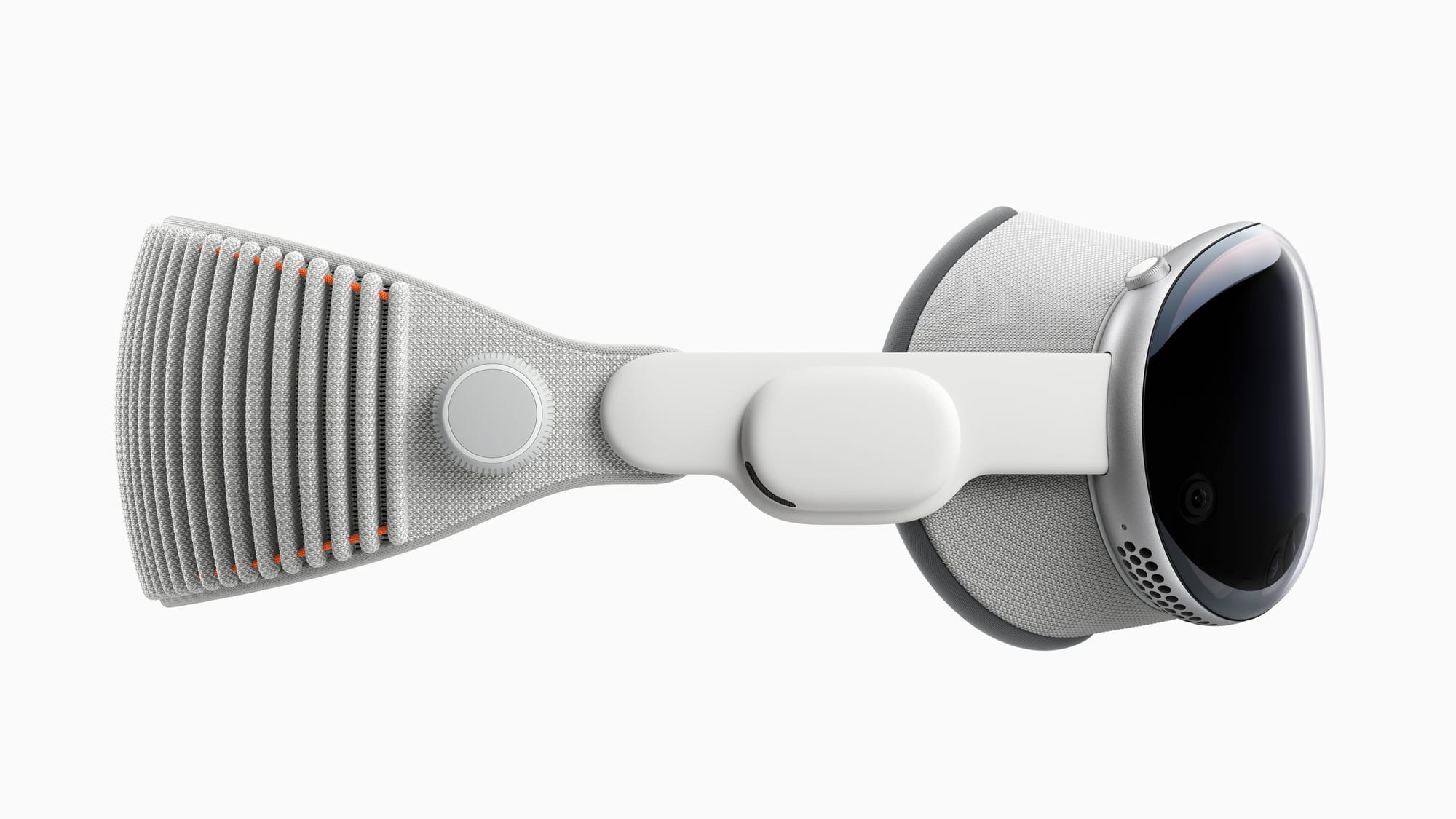

Vikt & Komfort

Medan Vision Pros upplösning gör den teoretiskt kapabel att ersätta bildskärmar, vill du förmodligen inte göra det här.

Med tanke på att mycket av marknadsföringen innebär att sitta och titta på eller interagera med virtuella skärmar i timmar, och med tanke på att batteriet är externt, kan du anta att Vision Pro är relativt lätt och bekväm. Men du skulle ha fel.

Apple Vision Pro (vänster) och Meta Quest 3 (höger) avskalade.

Trots sin externa batteridesign väger Vision Pro hela 478 gram, även med den lätta tätningen och huvudbandet borttaget. Som jämförelse väger Meta Quest 3 397 gram med ansiktsgränssnittet och remmar borttagna, och Pico 4:s visir väger runt 295 gram. Det är en något bisarr situation att det enda större headsetet med ett tjudrat batteri är det tyngsta, men Apple har fastnat en stor mängd komponenter i den här saken och kapslat in dem i en aluminiumram med en frontplatta av glas. Aluminium kan ha behövts för att hjälpa till att avleda värmen som genereras av M2- och R1-chipset, eller så kan det bara ha valts för sina estetiska egenskaper.

Ur förpackningen kommer Vision Pro med en rem som kallas Solo Knit Band förfäst. Det är remmen du ser i nästan alla Apples marknadsföringsbilder, och den är gjord av ett "3D-stickat" tyg som känns bra på bakhuvudet. Problemet är dock att det saknar en topprem, en avgörande komponent i banden på andra headset som Quest 3 och Valve Index. Resultatet är att Solo Knit Band helt enkelt inte kan bära headsetets vikt. Jag tycker att det bara är uthärdligt i cirka 5 till 10 minuter, om till och med, varefter headsetet gör så ont att jag bara behöver ta av det. Jag kan inte föreställa mig att Apple på allvar förväntar sig att någon ska bära Solo Knit Band, och jag föreställer mig att det finns för marknadsföringsbilder och varumärkesimage mer än några praktiska skäl.

Tack och lov kommer Vision Pro med en annan rem i lådan, kallad Dual Loop Band, och den har en sida-till-sida topprem. Med Dual Loop Band kan jag bära Vision Pro på obestämd tid. Jag skulle ändå inte beskriva det som särskilt bekvämt, och headsetets tyngd försvinner aldrig riktigt.

Vad jag inte gillar med Dual Loop Band är hur dess bakre rem inte är alls lika mjuk och behaglig känsla som Solo Knit Band. Jag önskar att Apple hade kombinerat Solo Knit Band med toppremmen, som ses i ett av dess designpatent.

En positiv aspekt av Vision Pros komfort är att den lätta tätningen är gjord av ett mycket bekvämt skum, och eftersom den lätta tätningen är dimensionerad för ditt ansikte sitter den väldigt bra. Ja, vikten är alltid närvarande, men åtminstone det som trycker mot ditt ansikte känns inte grovt som Quest 2.

Ocklusion & gränser

Det är en sak att lägga över virtuella skärmar och objekt på den verkliga världen, men för att göra dem övertygande och användbara måste de kunna blockeras av verkliga objekt. Vi kritiserade hårt Meta Quest 3:s totala brist på dynamisk ocklusion vid lanseringen i vår recension av den, och även om Meta nyligen lade till den, kräver den komplex utvecklarintegration och djupkartan som driver den är mycket låg upplösning, vilket leder till ganska hemska resultat.

Apple Vision Pro å andra sidan har ocklusion i två distinkta former.

Huvudformen är hand- och armocklusion. Det finns helt klart en 2D-hand- och armsegmenteringsmodell (separat från 3D-skeletthandspårningen) som körs för varje ögas kamera. Hur ren segmenteringen är beror på ljusförhållandena, men ser i allmänhet ut som vad du får när du aktiverar bakgrunder på din webbkamera i en app som Zoom, eller i bästa fall ett amatörjobb med grön skärm. Denna ocklusion finns i hela systemet, i varje app. Det är en viktig funktion som får virtuella objekt att verka som om de verkligen är i rummet med dig. Och som en snygg touch, tänds din hand och dina armar på nytt för att matcha vilken virtuell miljö du befinner dig i.

Det är dock oroande och chockerande att den här ocklusionen inte inkluderar något du håller i, vilket innebär att din telefon eller dryck fortfarande kommer att döljas bakom virtuella skärmar och föremål, även om de borde vara framför. Det är som om det du håller i är osynligt.

Sidenote: Jag har hört att det är möjligt för utvecklare att inaktivera hand- och armocklusion, men jag har inte stött på någon app som gör det.

Vision Pro genererar ett högupplöst 3D-miljönät och uppdaterar det i realtid. (film från Apple)

Den andra formen är miljö-3D-ocklusion. Vision Pro använder sin LiDAR och datorseende för att generera ett 3D-nät av din omgivning som den uppdaterar i realtid. Denna imponerande förmåga är dock inte mycket använd än. I Shared Space, där renderingen kontrolleras av Apple, används detta bara för att lägga till en subtil transparens till virtuella objekt bakom verklig geometri som väggar. Apputvecklare som använder ett Full Space skulle teoretiskt sett kunna göra så mycket mer, men ingen har verkligen gjort det ännu. Denna klyfta mellan hårdvarans kapacitet och vad den nuvarande programvaran faktiskt använder är ett återkommande tema med Apple Vision Pro.

Vad du inte hittar på Vision Pro är behovet av att dra en säkerhetsgräns, som du behöver göra på Quest 3, och du kommer aldrig att störas av ett gigantiskt fult monokromt fängelsestångsrutnät som drar över appen och framkallar djupkonflikt. Detta är dock ett tveeggat svärd, för istället fungerar Vision Pro i princip permanent i en motsvarighet till Quests stationära läge. Flytta mer än en meter eller så i valfri riktning i en uppslukande app och den kommer gradvis att övergå till passthrough. Apple Vision Pro låter dig stå upp, ja, men den tillåter inte VR i full rumsskala.

visionOS & The Shared Space

Apple Vision Pro är det första headsetet i VR-stil som levereras med ett operativsystem som inte bara är en gaffel av Android. Även om det är baserat på iPadOS, som i sig är baserat på iOS, har Apple helt klart gjort betydande underliggande förändringar och utformat systemprogramvaran för rumslig beräkning. I själva verket är detta det första fullt utrustade, anpassade för XR-operativsystemet som faktiskt levereras som driver en konsumentenhet.

Det finns två grundläggande "lägen" för visionOS, Shared Space och Full Space. Apputvecklare kan välja vilket av dessa lägen de vill rikta in sin app på.

What The Golf, ett Unity-spel som körs på Vision Pro medan Apple Messages körs vid sidan av det. (film från Apple)

Det delade utrymmet är standard. Som namnet antyder kan Shared Space-appar köras bredvid varandra. Detta kan inkludera Windows, 2D-rundade rektanglar med valfri transparens och Volymer, kubiska områden där appar kan visa 3D-innehåll, från en enda modell till en miniatyrspelvärld. Appar kan endast använda Windows, bara volymer eller båda.

I det delade utrymmet kontrollerar Apple helt renderingen, belysningen och spårningen. Nackdelen är att utvecklare bara tar emot händelser, som pixeln som användaren tittade på när de nyper, men har inte obehandlad tillgång till skeletthandspårning. Men fördelarna inkluderar vackert konsekvent UX mellan appar, en skarp kontrast till Quest där du måste lära dig om olika kontroller och interaktioner mellan varje app, även appar för enkla uppgifter. En annan fördel är att Apple använder Vision Pros sensorer för omgivande ljus för att belysa virtuellt innehåll för att matcha ditt verkliga rums belysning och fönster och volymer kastar till och med skuggor på den verkliga marken. Inget av detta kräver utvecklarintegrering av något slag, allt sker automatiskt.

Om en app istället använder ett Full Space å andra sidan kommer den att dölja alla andra Shared Space-appar som du körde, och du kan inte ta fram dem utan att pausa Full Space-appen. Full Space-appar får tillgång till skelettrendering och kan styra sin egen renderingsstack. En Full Space är som att gå i helskärm på en PC, och att använda det är i grunden ett krav för aktivt spel eller uppslukande VR-upplevelser.

I jämförelse, på andra plattformar som Meta Quest körs varje 3D-app effektivt i ett fullt utrymme, och konceptet med ett delat utrymme existerar för närvarande bara för 2D-appar, av vilka du bara kan ha upp till tre synliga samtidigt. Apples tillvägagångssätt tillåter multitasking att inkludera 3D-appar, och detta ger den betydande potential som en allmän datorenhet. Jag kan till exempel titta på en video eller lyssna på min egen musik medan jag spelar schack i Game Room. Metas kommande Augments-funktion för Quest 3 låter något liknande, men den har ännu inte levererats och läckta videor föreslår det kommer inte att stödja Unity.

En betydande nackdel med Apples hårda avgränsning av Shared Space vs Full Space är dock att du inte kan multitaska i Full Space-appar. På Quest kan du ta fram webbläsaren utan att minimera den uppslukande appen, så att du kan stå bredvid en vän i ett VR-spel medan du snabbt Googlar något. På Vision Pro måste du återvända till Shared Space, vilket kommer att göra den uppslukande appen minimerad och pausad tills du öppnar den igen.

Ingång & kontroller

Ögon- och handspårning

Den enda största skillnaden mellan visionOS och systemprogramvaran på alla headset som levererades innan det är dess radikalt annorlunda interaktionsparadigm.

I visionOS är dina ögon markören och att nypa tummen mot pekfingret är ett musklick. Och för att vara tydlig så behöver du inte ha händerna framme framför dig som du kanske har sett på vissa bilder av människor som använder Vision Pro. Hela poängen är att nypklickningen fungerar även med händerna vilade i ditt knä eller stolsarm, vilket innebär att du kan använda Vision Pro i timmar i sträck utan "gorillaarm", termen för hur man snabbt håller upp armarna tröttar ut dem. smärtpunkt.

För interaktioner du skulle utföra med två händer på en pekskärm, som att zooma och rotera, nyper du helt enkelt med båda händerna samtidigt. Dra isär eller samman händerna så zoomar du där du tittar, eller flytta den ena bakåt och den andra framåt för att rotera.

Klicka, rulla, zooma och rotera. (film från Apple)

Denna vackra blandning av eyetracking och handtracking är perfekt för nästan varje interaktion, och kan när den är som bäst kännas som telepati, en förlängning av dina tankar. Det har blivit så inarbetat i mitt sinne att jag till och med har kommit på mig själv med att försöka stirra och nypa på min TV- och laptopskärm.

Det finns dock ett område där det misslyckas spektakulärt: text. För textinmatning anstränger det dina ögon att titta på varje bokstav, och för exakt textval är det bara inte tillräckligt korrekt. Visst kan du trycka direkt på det virtuella tangentbordet, men det går ännu långsammare. Praktisk textinmatning utan ett fysiskt tangentbord förblir ett olöst problem i XR, och Apple har ingen magisk lösning.

Oavsiktliga inmatningar är också ett mycket verkligt problem med handspårning. Jag har av misstag hoppat till en annan del av en film när jag öppnat en burk för att dricka, eller valt slumpmässig text i ett dokument medan mina händer bara vilade på tangentbordet. Även om dessa händelser oftast bara sker i svag belysning, kommer de att behöva lösas på lång sikt för att göra detta till en användbar primär inmatningsmetod. Som det ser ut idag är det analogt med en pekskärm som ibland aktiveras när dammpartiklar träffar den.

Vidare finns det vissa fall där du vill ha en avskildhet mellan vad du tittar på och vad du kontrollerar. När jag letar igenom en video vill jag till exempel ofta titta på filmen medan jag rullar sökfältet, och visionOS gillar inte det. Detta verkar dock lösas med en annan mjukvaruimplementering.

Stöd för tangentbord och mus

Lika mycket som textinmatning suger med hand- och ögonspårning kan du enkelt ansluta ett Bluetooth-tangentbord, som du kan med andra fristående headset. Apples magiska tangentbord spåras till och med, med en liten förhandsvisning av textinmatning ovanför så att du kan titta på tangentbordet medan du skriver och se vad du matar in.

Om du planerar att använda Vision Pro för att skriva i vilken kapacitet som helst, till och med bara Tweets och e-postmeddelanden, är ett Bluetooth-tangentbord absolut nödvändigt. Ett mycket irriterande problem är att ibland det virtuella tangentbordet fortfarande dyker upp och skymmer din sikt. Jag misstänker att detta är en bugg.

Så det löser textinmatningsproblemet, men hur är det med textval? Textval med eyetracking är bara direkt frustrerande. Du kan ansluta Apples Magic Trackpad – men det är allt. Det finns ännu inget musstöd i visionOS, vilket verkar vara ett konstigt förbiseende. Helst skulle jag vilja se ett magiskt tangentbord med en styrplatta inbyggd, eftersom att transportera båda innebär att du nu bär runt två extra saker utöver Vision Pro, inte bara en.

Appstartare, Siri och kontrollcenter

Medan Vision Pro förlitar sig på ögonspårning och handspårning för det mesta av sin inbyggda ingång, har den också två fysiska kontroller ovanpå. Till vänster finns Capture-knappen och till höger den klickbara ratten som kallas Digital Crown.

Min minst favoritinteraktion i Vision Pro är behovet av att klicka på Digital Crown till appstartaren. Med tanke på hur ett av huvudmålen med Vision Pros interaktionssystem är att låta dig slappna av i armarna och interagera med tankens hastighet, är det verkligen konstigt att behöva sträcka armen upp och trycka på en knapp varje gång du vill starta en app . Jag förstår att en gest skulle begränsa appar från att använda nämnda gest och ibland misslyckas med att utlösa, men föreställ dig hur mycket det skulle sakta ner dig om Windows startknapp var en fysisk knapp på toppen av din bildskärm. Jag kommer ofta på mig själv med att öppna handflatan och nypa mitt pekfinger mot tummen, menygesten på Meta Quest, bara för att komma ihåg att det inte är så lätt på visionOS.

I själva verket är det på något sätt faktiskt snabbare att säga, "Siri, starta ” än att sträcka sig upp och trycka på den digitala kronan och sedan hitta och trycka på den. Du kan inte ordna om appar på appstartaren, och Siri kommer till hjälp att öppna appar på den position du tittar på när du frågar.

Sidenote: Siri på Vision Pro är av någon anledning mycket snabbare än på andra Apple-enheter. Den är dock fortfarande lika begränsad i funktionalitet.

Den andra typen av meny på Vision Pro, som på andra Apple-enheter, är kontrollcentret. För att komma åt den tittar du uppåt, med dina ögon, tills du ser en liten cirkel med en nedåtriktad pil inuti visas, tryck sedan med fingrarna. Detta är i huvudsak en snabbmeny med snabb åtkomst till tid, datum, ljus/mörk miljö, volymkontroll, aviseringar och ett utökat kontrollcenter med snabb tillgång till Wi-Fi, Bluetooth, Flygplansläge, Reseläge, AirPlay Casting, Mac virtuell skärm, gästläge, sökning och inspelning.

Det är ett intressant alternativ till en handgest. I huvudsak är det en ögat gest. Problemet är att det inte kommer att dyka upp om det finns en app i vägen för var cirkeln ska vara, så du måste vända huvudet bort från vilken app som helst för att skapa den. Det kan också vara lite ansträngande att rotera ögat så långt upp om du använder det ofta. Återigen, jag skulle föredra att det här är en handgest. Och helst skulle Apple bara slå samman appstartaren och kontrollcentret till en meny.

Digital Crown & Environments

Inom det delade utrymmet, eller i appar som använder sin egen valfria miljö, kommer rullning av Digital Crown smidigt att växla mellan full passthrough och full nedsänkning i den miljö du väljer. Halvvägs ser du den virtuella miljön framför där du sitter och den verkliga världen vid dina sidor och bakom dig, med en mjuk genomskinlighet som bleknar i kanterna. Apple låter dig välja den exakta graden av nedsänkning du vill ha, samtidigt som du kan hålla kontakten med så mycket av din omgivning som du vill.

I visionOS huvudmeny väljer du den miljö du vill ha, lite analogt med att ställa in en skrivbordsbakgrund på en Mac. Just nu kan du välja mellan:

- Haleakalā, den massiva vulkanen Hawain

- yosemite Nationalpark på vintern

- Joshua Tree Nationalpark på sommaren

- En sjösida framför Mount Hood

- White Sands Nationalpark

- Ytan på Månen

Alla dessa sex miljöer ser helt fantastiska ut, med 3D-geometrin nära dig inscannad med fotogrammetri som på vissa ställen närmar sig fotorealism och realistiskt högkvalitativt rumsligt ljud. Och som med passthrough kommer fönster och 3D-objekt att kasta realistiska skuggor på miljön. Det är en skarp kontrast till Quest, där miljöerna är lågupplösta och suddiga. Det är förresten inte Quests hårdvaras fel, eftersom dessa miljöer har väldigt låg GPU-användning. Det är ännu ett exempel på att Meta inte levererar kvalitetsmjukvara.

Om du inte är ett fan av att stänga av dig från den verkliga världen och huvudsakligen ville ha Vision Pro som ett AR-headset men ändå vill mixa om din bild, finns det fem miljöer som istället bara återupplivar genomgången: Morning Light, Spring Light, Summer Light , Höstljus Och Vinterljus. Konstigt nog kommer dessa också med ljud, men du kan självständigt justera omgivningens ljudvolym.

Sidenote: innan Apple Vision Pro avslöjades officiellt, när vi rapporterade om tillförlitliga källor som beskrev det skulle det ge "det här är clickbait om vaporware!" stilkommentarer, var Digital Crown beskriven som "Reality Dial". Det här skulle ha varit ett mycket coolare och mer passande namn, men jag antar att Apple ville ha konsistens i varumärket med Apple Watch, som också har en Digital Crown.

Syn…

EyeSight, även känd som omvänd passthrough, är en smart idé. Ett av de största problemen med att använda ett headset i samma rum som andra människor är att de inte vet när du kan eller inte kan se dem, och detta utlöser ett primärt socialt obehag som många VR-entusiaster verkar underskatta.

I teorin löser EyeSight detta, och jag applåderar Apple för att ha försökt. Problemet är att det i sin första generations form knappt fungerar.

För det första har People Awareness-algoritmen som triggar EyeSight att dyka upp i första hand varit väldigt opålitlig för mig. I allt annat än idealisk belysning misslyckas den ofta med att känna igen den andra personen och därmed deras svar på "kan du se mina ögon?" har varit ett solidt "nej, bara det svarta glaset".

Men även när People Awareness fungerar för att trigga EyeSight är bildens ljusstyrka helt enkelt för mörk för att vara användbar. Svaret på ”kan du se mina ögon” har i nästan alla möjliga ljusförhållanden varit ”knappt – och jag hade inte märkt det om du inte hade frågat”.

Det sista problemet är att medan EyeSight har parallax, så gäller detta bara den horisontella axeln. Om du tittar på det från en brant vertikal vinkel, uppifrån eller under, bryts effekten helt och ser ännu mer bisarr ut. Svaren jag har fått på detta inkluderar "wow, det där ser helt fruktansvärt ut".

Denna Meta konceptet gör visar hur EyeSight kan se ut om några generationer.

Vissa människor har skrivit av EyeSight som ett misslyckat projekt, och föreställer sig att det kommer att gå vägen för TouchBar i framtida iterationer av Vision Pro, men jag håller inte med om denna nivå av pessimism. Återigen, det är en bra idé, det är bara en mycket tidig och begränsad implementering. Meta visade först upp forskning om omvänd passthrough redan 2019, och visade nyligen en rendering av hur det kunde se ut på ett headset "möjligt att bygga nu". Även om renderingar uppenbarligen inte helt representerar verkligheten verkar Meta-forskare vara övertygade om att det är möjligt att leverera mycket högre kvalitet omvänd passthrough än Vision Pros, och jag är säker på att Apples ingenjörer redan arbetar hårt med detta också.

Optimering och prestanda

Min enda favoritsak med upplevelsen av att använda Apple Vision Pro hittills är prestandan. Oavsett vad du gör i det delade utrymmet, tappar Vision Pro helt enkelt inte synliga ramar. Jag har inte upplevt något ryck, det där hemska fenomenet som plågar Quest och PC VR och gör mig och många andra sjuka, och dess frånvaro på Vision Pro är inget annat än sublim.

Det är inte exakt klart hur Vision Pro lyckas med detta. Jag har läst spekulationer om att detta beror på att R1-chippet hanterar passthrough separat, så oavsett hur stressad M2 är kommer passthrough inte att tappa ramar. Detta låter rimligt förutom ett problem – om jag befinner mig i en helt virtuell miljö ser jag inte heller rädsla. Det är också uppenbart att styrkretsen inte är problemet på Quest när du använder en Pico 4 och ser hur smidig och presterande dess systemprogramvara är. Meta är inte hårdvarubegränsad, dess mjukvara är bara dåligt optimerad.

Min teori baserad på mina dussintals timmar i Vision Pro, och för att vara tydlig med att detta bara är min spekulation, är att den sanna orsaken till Vision Pros brist på väsen är något att göra med den underliggande arkitekturen hos visionOS. Jag misstänker att visionOS i Shared Space renderar och sammansätter passthrough, den virtuella miljön och befintligt fönsterinnehåll innan appar får någon CPU- eller GPU-tid alls. Så om en systemtråd eller appen inte slutförs i tid, skjuter den helt enkelt det som redan är sammansatt till skärmen. Att ha kärna-till-foton-kontroll över hårdvaran och mjukvaran är något användbart för andra kategorier av enheter, men för XR är det utan tvekan viktigt, och tillåter Apple att dra ut en nivå av polering som forkers av Android bara kan drömma om.

Konstigt men det finns en sak som verkar fungera dåligt på visionOS: bläddra igenom applistan. Det verkar som om animeringens bildfrekvens är bara låg, snarare än ett verkligt problem med prestanda.

Gästläge och delbarhet

När du vill demo eller dela Vision Pro måste du aktivera gästläget innan du lämnar över headsetet. Och varje gång du använder gästläget måste den andra personen gå igenom eye tracking-kalibreringen, vilket tar cirka en minut.

Det är otroligt irriterande att inte kunna lagra kalibreringen på ett användarkonto. Precis som iPad stöder Apple Vision Pro inte flera användarkonton. Med iPad är det helt klart bara ett användarfientligt beslut att försöka sälja varje familjemedlem sin egen, som funktionalitet finns i affärs- och utbildningsversionen av iPadOS. Med Vision Pro är det mer motiverat med tanke på att den lätta förseglingen och pannbanden är dimensionerade för just ditt ansikte och du kan argumentera för att dela ett headset inte skulle vara särskilt hygieniskt. Men det skulle vara trevligt för Apple att tillåta par eller vänner som är villiga att köpa en andra ljusförsegling för att få ett andra konto. OpticID-autentiseringssystemet innebär att visionOS inte ens skulle behöva det extra upplåsningssteget som visas på Meta Quest om du lägger till ett andra konto.

En mycket användbar funktion i gästläget är dock att när du aktiverar det blir du ombedd att välja ett AirPlay-mål. Om du gör det kommer headsetet att börja casta till det när personen tar på sig det. Jag skulle älska att se andra headsettillverkare lägga till ett gästläge som automatiskt startar casting och har ett förenklat gränssnitt. En irriterande egenhet är dock att du inte kan titta på upphovsrättsskyddade videor som filmer eller ens Apple Immersive Videos medan AirPlay castar. På Quest visas den här typen av videor som svarta på den castade vyn, men på Vision Pro visas de som svarta även för headsetbäraren.

Filmer och TV-program

Analytiker brukade spekulera i åratal om när och hur Apple skulle släppa en TV, och med Vision Pro gjorde det faktiskt bara det. Haken är förstås att bara en person i rummet kan se det. Men redan idag tittar tonåringar och studenter på filmer och program ensamma i sitt rum på TV, laptop eller surfplatta, liksom ensamstående i alla åldrar och omständigheter i sitt vardagsrum och resenärer på hotell och flygplan.

Upplösningen, färgerna och kontrasten hos mikro-OLED-panelerna på storleken av virtuell skärm visionOS kan frammana gör Vision Pro till ett otroligt sätt att titta på filmer och TV-program. På mitt flyg hem från New York satt jag i en ekonomistol, men jag hade bättre filmtittande än någon annan i första klass.

Och även om 2D-upplevelsen redan är fantastisk, är 3D-innehåll fantastiskt bra. Det här är inte den mörka, suddiga, ansträngande 3D du såg på biografer eller 3D-TV. Detta är äkta, perfekt 3D som bibehåller samma livfullhet som traditionellt innehåll. Det är bättre än 2D utan några avvägningar. Jag blev så imponerad av 3D-filmer på Vision Pro att det nu känns som att något saknas när jag går tillbaka till 2D-innehåll på vilken plattform som helst. Jag kunde se headset återuppliva detta format under det kommande decenniet, vilket Vision Pro redan börjar göra.

Utan att någon extra hårdvara behövs är Vision Pro bäst att fungera som en bärbar jätte-TV, och det är helt logiskt att så mycket av Apples marknadsföring fokuserar på detta användningsfall.

Förutom komforten är de enda begränsningarna här att du, precis som all optik i VR-stil, kommer att se bländning i scenarier med hög kontrast som en ljus film i en mörk miljö. Du kan mildra detta något med en ljusare miljö.

Jag har ofta hört folk säga "du kan göra det här redan med Quest!", men detta är helt enkelt inte sant - åtminstone inte juridiskt. Quest har inget inbyggt sätt att hyra eller ladda ner filmer och inga appar i butiken erbjuder nedladdning eller 3D. Det finns en Netflix VR-app, men den kräver kontroller att använda, stöder inte nedladdningar och streamar bara 480p. Det finns också en Peacock-app, men det är i huvudsak bara en genväg till webbplatsen så stöder inte heller nedladdningar. För att lagligt ladda ner filmer på Quest måste du ladda ner Android-telefonens APK-filer från Netflix eller Amazon Prime Video från din dator. Ingen av dessa tjänster har dock 3D-innehåll och Netflix kommer bara att streama 576p. Det är inte så att Quest som hårdvara inte är kapabel till detta användningsfall, det är att Meta helt enkelt inte erbjuder programvaran för det. Meta (då Facebook) hade sin egen 3D-filmuthyrningstjänst redan under Gear VR och Go-dagarna, men stängde sedan ner den runt lanseringen av Quest för att istället lansera en partnerapp från Vudu. Sen förra året stängde det ner det också. Den här typen av rörig strategisk flipflopping händer helt enkelt inte i Apples ekosystem.

iPad -appar

Möjligheten att ladda ner och köra en stor andel iPad-appar är en av de största fördelarna med Apple Vision Pro som en allmän datorenhet jämfört med alla befintliga fristående headset. Till exempel kunde jag ladda ner Slack och Trello för jobbet, Amazon Prime Video för att titta på filmer jag redan äger eller har tillgång till, och Steam Link för att spela mina PC-spel på en enorm virtuell skärm.

Även om det är sant att du kan komma åt många av dessa tjänster via webbläsaren på Quest och Pico, är det en mer involverad och mindre polerad lösning. Inhemska appar är fortfarande enastående för vissa användningsfall av samma anledningar som folk fortfarande använder dem på sin telefon, surfplatta och till och med PC istället för bara webbläsaren.

Metas CTO sa att han bad Google att ta med sin Play Store till Quest-headset, vilket kunde ha fört de allra flesta Android-appar för surfplattor och telefoner till Quest. Men Google sa nej, hävdade han. Detta kan bero på att Google vill behålla denna fördel för sin egen rumsliga datorplattform som den bygger för Samsungs kommande headset.

Även om det är bra att ha tillgång till dem, fungerar inte alla iPad-appar bra med ögonspårningsmarkören. Till exempel, i Amazon Prime Video framhäver man när man tittar på mitten av skärmen de rektangulära pekmålsgränserna för den osynliga uppspelningsknappen. Detta är så distraherande att jag är chockad att Apple officiellt marknadsför och rekommenderar Prime Video, och den enda lösningen jag kunde hitta var att använda en tillgänglighetsfunktion för att tillfälligt inaktivera ögonspårningskontroll.

Det andra problemet är att vissa utvecklare av nyckelappar har valt bort att göra dem tillgängliga på visionOS. Till exempel valde Google bort alla sina appar inklusive YouTube, Gmail och Foton, medan Netflix, Spotify och Snapchat också har gjort sina extremt populära plattformar otillgängliga. Snapchat är ett intressant exempel eftersom det har en webbversion, men eftersom Safari på visionOS är baserat på iPad-versionen kommer Snaps webbplats helt enkelt att hänvisa dig till att ladda ner iPad-appen, vilket du inte kan.

"Spatial Computing" och Mac-integration

Jag har avstått från att använda Apples beskrivning av Vision Pro som en "spatial dator" i denna recension. Debatten kring frågan om exakt vad som utgör en "dator" har rasat i den bredare tekniska industrin under större delen av decenniet, särskilt efter lanseringen av iPad Pro, som Apple är känt för. marknadsförs med ett "vad är en dator?" slogan.

Men trots Apples marknadsföring väljer de flesta proffs idag fortfarande Mac eller Windows, eftersom det är där de hittar den kraftfulla programvaran de behöver. Precis som med iPad Pro hittar du inte XCode, Visual Studio eller Unity på Vision Pro, så du kan inte använda den för att skapa appar. Inte heller kommer du att hitta Adobe Premiere, After Effects, Photoshop eller Illustrator. Det som verkligen skiljer en "dator" från andra enheter i praktiken är förmågan att professionellt skapa, inte bara konsumera. Och ur ett datorperspektiv är Vision Pro precis som att ha en iPad Pro med ett gäng externa bildskärmar. Det är bra om ditt arbete är helt webbaserat. Allt du kan göra på en Chromebook kan du göra mycket bättre i Vision Pro. Detta inkluderar faktiskt det mesta av mitt eget arbete, och jag älskar hur bra Vision Pro låter mig skriva från min soffa eller till och med min säng. Men för mer komplexa uppgifter behöver du en riktig dator.

Det verkar teoretiskt möjligt att Apple en dag skulle kunna ge visionOS möjligheten att köra macOS-appar. Och för $3500 borde det verkligen redan ha gjort det. Men för tillfället är allt du kan göra att använda Vision Pro som en bärbar bildskärm för din befintliga Mac.

Med en MacBook är denna process så sömlös att den verkar som magi. Till skillnad från andra fristående headset finns det ingen streamerprogramvara att installera, ingen inställning att aktivera och ingen "app" att installera på headsetet. Du ser en svävande 'Anslut'-prompt ovanför skärmen och genom att titta på den och nypa stängs din MacBook-skärm av och en gigantisk virtuell skärm visas ovanför den. Om du inte ser den här uppmaningen, eller om du använder en stationär Mac, kan du komma åt den här funktionen i kontrollcentret.

Streamingkvaliteten är utmärkt och latensen känns lägre än något trådlöst fjärrskrivbord jag någonsin har provat. Detta beror sannolikt på fördelarna med Apples end-to-end-kontroll av hårdvaran och mjukvaran på båda enheterna. Det verkar fungera över Wi-Fi Direct utan att det kräver ett lokalt nätverk, vilket innebär att du kan använda det var som helst och även om din router är långt borta. Och Mac-skärmen körs i det delade utrymmet, så att du kan använda iPad- och visionOS-appar bredvid den.

(film från Apple)

Dock är detta Mac-stöd ganska begränsat. Den stöder bara en skärm, vilket innebär att den varken stöder verkliga eller virtuella extra skärmar. Detta är något underhållande, givet på Quest kan du använda Metas Horizon Workrooms för att förvandla din MacBook till en trippelbildskärmsuppställning, med de två sidoskärmarna som är helt virtuella. Helst skulle jag vilja kunna ta bort enskilda macOS-appar från skärmen och placera dem i rymden. Det ska bli intressant att se hur den här funktionen utvecklas i framtida visionOS- och macOS-uppdateringar.

När det gäller Windows-stöd är det självklart inte inbyggt, men du kan använda tredjepartslösningar på App Store som Steam Link eller Parsec. För att vara tydlig men jag pratar om att titta på en virtuell bildskärm här, inte uppslukande VR. Läs vidare för mer om det.

Gaming

Det primära användningsfallet för Meta Quest är den största svagheten hos Apple Vision Pro.

Du hittar inte Superhot, Gorilla Tag, Population One, Resident Evil 4 VR eller Asgard's Wrath 2 här. Jag blev förvånad, och lite road, att hitta en stor andel av "made for Vision Pro"-spelen som bara körs i ett flytande fönster, eftersom de i princip bara är iPad-spel, med enstaka rumsliga element. Och för att vara tydlig, det här är casual mobilspel. Medan Vision Pro stöder gamepads, har AAA-titlarna som kom till iPads med M-seriemarker som Assassin's Creed Mirage, Death Stranding och Resident Evil valts bort från att visas på visionOS App Store.

De flesta Vision Pro-spel körs i ett snyggt fönster, med enstaka men sällsynta rumsliga element. (film från Apple)

Det finns mindre än 10 verkligt rumsliga spel på Vision Pro i skrivande stund, vilket betyder spel där du faktiskt interagerar i tre dimensioner med virtuella objekt som inte finns i en rektangel eller cirkel. Dessa inkluderar Synth Riders, Super Fruit Ninja, Game Room, What The Golf och Lego Builder's Journey.

- Synth Riders på visionOS skiljer sig något från versionen av spårade kontroller på andra uppslukande plattformar, men kärnspelet är väldigt likt. Det här är Apples Beat Sabre-motsvarighet, eller åtminstone den som ligger närmast den.

- Super Fruit Ninja är mer lik den berömda mobilversionen än Fruit Ninja VR-serien. Det sker i passthrough och du sveper frukt med händerna.

- Game Room är en strömlinjeformad bordssimulator från utvecklarna av Demeo, som inkluderar Hearts, Chess, Battleship

- What The Golf är ett bordsspel där du använder handgester för att kasta en minigolfboll (eller ibland klubba egentligen) genom en minibana.

- Lego Builder's Journey är ett bordsspel där du placerar miniatyrklossar för att slutföra bygget, ungefär som att lösa ett pussel.

Game Room på Apple Vision Pro (film från Apple)

Av dessa rumsliga spel är det bara Synth Riders och Super Fruit Ninja som involverar att stå upp och aktivt röra sig, medan resten är långsamma och sittande.

Super Fruit Ninja (film från Apple)

Det som gör den aktiva spelupplevelsen så mycket sämre på Vision Pro än Meta Quest är kvaliteten på spårning av skeletthand och avsaknaden av spårade kontroller.

Av någon anledning får spelutvecklare bara ett handspårningsskelett med mycket låg uppdateringshastighet att arbeta med, vilket gör att slagblock i Super Fruit Ninja och Synth Riders känns trögt och inte svarar. Det som gör detta så konstigt är att systemet uppenbarligen är kapabelt till mycket högre uppdateringshastighet för handspårning, uppenbart när du använder dina händer för att flytta runt fönster i det delade utrymmet. I det sammanhanget känns Vision Pros handspårning överlägsen Quest 3, men i spel känns den betydligt sämre. Vad händer här?

Synth Riders på Vision Pro (film från Apple)

Och oavsett hur bra handspårningen är, begränsar bristen på spårade kontroller kraftigt vad utvecklare kan göra, och bristen på haptisk feedback är mycket påtaglig. Det är bara så mycket mer tillfredsställande att träffa blocken i Beat Sabre medan du faktiskt håller i något och känner varje slag än det är att vifta med händerna i luften i Synth Riders på Vision Pro.

För att sammanfatta, Apple Vision Pro är inte ett headset för spelare, och om du köper det i hopp om att spela spel kommer du med största sannolikhet att bli allvarligt besviken.

Jag skulle mycket, mycket hellre spela Walkabout Minigolf än så här. (film från Apple)

En annan intressant skillnad mellan spel på Quest och på Vision Pro är prismodellen. På Quest köper du oftast spel direkt, för allt från $5 till $60 beroende på titeln, även om det finns ett Quest+-abonnemang på $8/månad som ger dig 2 spel per månad som du behåller så länge du prenumererar. På Vision Pro är nästan alla spel hittills tillgängliga via Apple Arcade-prenumerationstjänsten, som kostar $7/månad. Du äger faktiskt inte dessa spel, du hyr dem bara, även om Job Simulator och Vacation Simulator är inställda om du föredrar eller hatar detta eller inte beror på din egen syn på köp kontra prenumeration.

Job Simulator kommer till Apple Vision Pro

Job Simulator och Vacation Simulator kommer till Apple Vision Pro.

Åh, och om du vill använda Vision Pro som ett SteamVR-headset på Windows kan du redan göra det om du är en registrerad Apple-utvecklare med en Mac och är bekväm med att kompilera ALVR visionOS-port från källan.

Virtual Desktop och iVRy arbetar på PC VR-streamingappar för visionOS-butiken, men det är månader bort i bästa fall och Apple har inte bekräftat godkännande för någondera.

Virtuellt skrivbord och iVRy Båda byggnader för Apple Vision Pro

Virtual Desktop och iVRy arbetar båda med Apple Vision Pro-portar för trådlös streaming av VR från din speldator.

Kom dock ihåg att för någon av dessa lösningar kommer du inte att kunna spela många SteamVR-spel som standard. Det mesta SteamVR-innehållet förväntar sig spårade kontroller, och Vision Pro inkluderar eller stöder inte några. Du kan lägga till SteamVR Tracking-basstationer och indexkontroller och använda ett verktyg som OpenVR Space Calibrator för att justera dem manuellt. Men den utrustningen skulle kosta dig runt $600 om du inte äger den redan, och justeringen skulle behöva utföras varje gång. Om du inte är villig att göra det kan Vision Pro fortfarande visa sig vara ett utmärkt headset för användning med ospårade indataenheter, som racinghjul för simracing eller HOTAS-inställningar för flygsimulatorer.

Apple Immersive Video

Uppslukande video, 180-graders eller 360-graders innehåll som delvis eller helt omger dig, har varit ett primärt fokus för VR-headset sedan 2014 Samsung Gear VR och till och med Google Cardboard. Men nästan alla hade en sak gemensamt: de sög. Upplösningen var ofta dålig, 3D-skalan var fel, och de hade nästan alla fruktansvärt märkbar kompressionsblockering.

Genom sin Apple TV+-prenumerationstjänst, som kostar 10 $ i månaden, erbjuder Apple uppslukande dokumentärer med "Apple Immersive Video", vilket betyder 8K 180-graders 3D-video med HEVC-kodning, och streamar dem med höga bithastigheter. Just nu är katalogen:

- Förhistorisk Planet Immersive: en serie från den prisbelönte regissören Jon Favreau baserad på hans befintliga traditionella Apple TV+-serie Prehistoric Planet.

- Äventyr: en serie som följer extremsportidrottare på olika utmaningar runt om i världen. Det första avsnittet fokuserar på highlining.

- Vilda liv: a serie som tar dig bredvid några av de mest unika djuren på jorden, berättad av experter. Det första avsnittet fokuserar på Rhinos.

- Alicia Keys replokal: en kort dokumentärfilm som erbjuder en titt bakom kulisserna på en Alicia Keys repetitionssession.

Videokvaliteten på dessa dokumentärer går utöver all streamad 180-graders 3D-video jag någonsin har provat, och konkurreras endast av förnedladdade versioner av Felix & Paul-innehåll på Quest. Skalan är nästan perfekt och det finns ingen kompressionsartefakt i sikte. Detta är en skarp anklagelse mot Metas streamingkvalitet på sin Meta Quest TV-app, som på samma Wi-Fi-nätverk ser blockig ut i jämförelse. Apple Immersive Video är så bra att det har ändrat min syn på streamad uppslukande video från avskedande till spänning. Jag kan inte vänta med att se vilket annat innehåll som kommer med detta format. Vision Pro är tydligen också kapabel att avkoda 12K-video, så kvaliteten kan bli ännu bättre i framtiden.

Mitt enda klagomål med Apple Immersive Video är att jag önskar att det var minst 270 grader, inte bara 180, eftersom jag ofta tittar åt sidorna och ser den svarta stapeln avsevärt förringar nedsänkningen.

Det finns också en annan app som erbjuder uppslukande konserter från T-Pain, Zara Larson och UPSAHL som heter AmazeVR. Med konserter menar jag inte strömmar av riktiga konserter – det här är anpassade upplevelser som blandar 180-graders kamerafångst med renderade bakgrunder. Den finns även på Quest och Pico, men på Vision Pros skärmar lyser den verkligen.

Rumsliga videor

Den andra typen av headset för videoinnehåll som är unikt bra för visning är vanliga rektangulära stereoskopiska 3D-videor.

Apple kallar stereoskopiska 3D-videor Spatial Video, men det finns inget speciellt med Apples implementering förutom att den registrerar de två vyerna i separata strömmar av en HEVC-fil, snarare än att bara spara den som sida vid sida eller över-under.

iPhone 15 Pro spelar nu in 3D "spatial" video för Vision Pro

Med iOS 17.2 kan iPhone 15 Pro nu spela in 3D "Spatial Video" för att titta på i Apple Vision Pro.

De två iPhone 15 Pro-modellerna har kunnat spela in rumsliga videor sedan 17.2, släpptes i beta i november och offentligt i december.

Att titta på iPhone-fångade rumsliga videor kunde ha varit en rubrik unik funktion för Apple Vision Pro, men utvecklare stal dess åska genom att släppa iPhone-appar som låter dig konvertera dem till SBS 3D för att titta på alla befintliga headset, och denna månad Meta lade till förmågan för att enkelt synkronisera rumsliga iPhone-videor till Quest för visning. Eftersom iPhone-fångade rumsliga videor bara är 1080p SDR är det ingen stor skillnad i visning på en $500 Quest 3 och visning på en $3500 Vision Pro.

En sak som Quest 3 dock inte kan göra, åtminstone inte utan justeringar av utvecklarens kommandorad, är att spela in rumsliga videor. Apple Vision Pro är inte bara en 3D-visning, det är en 3D-kamera. Medan iPhone fångar bildförhållandet 16:9 vid 1920×1080, fångar Vision Pro kvadratiskt bildförhållande 1:1-video vid 2200×2200. Båda är bara 30FPS, vilket är en märkbar begränsning för alla typer av rörelse.

Personas & FaceTime

Personas är Apples realistiska virtuella avatarer i visionOS. Du genererar din Persona genom att hålla Vision Pro framför dig för att låta den skanna ditt ansikte medan du gör olika uttryck, en process som tar cirka en minut totalt.

När den väl har genererats drivs din Persona i realtid av headsetets ögon- och ansiktsspårningssensorer, såväl som handspårning. Din Persona kommer att visas i vilken iPad- eller iPhone-app som helst som begär selfiekameran, såväl som visionOS-appar som integrerar Personas som FaceTime.

Det som är riktigt bra gjort i FaceTime på Vision Pro är möjligheten att dela. Du kan dela din förstapersonsvy, inklusive passthrough, såväl som filer som bilder och till och med 3D-modeller, som mottagaren kan öppna i sitt utrymme med ett tryck. Det påminner mig om hur Meta saknar en inbyggd småskalig app för informella hangouts på Quest. Horizon Workrooms är för friktionsfritt och formellt och byggt kring att dela din PC, inte att använda Quest på egen hand.

Men just nu är Personas på visionOS begränsade till att visas inuti ett rektangulärt fönster, som en 3D-webbkameravy. För mig går detta miste om det som gör att umgås i VR är fantastiskt: det delade koordinatutrymmet. Om du är i en social VR-plattform på andra headset ser du bara en tecknad version av den andra personen, ja, men de finns i samma 3D-miljö som du skapar en känsla av social närvaro som är svår att beskriva eller ens tro förrän du Prova själv. Du kan peka på föremål, ge någon något eller genomföra gruppmöten på ett sätt som helt enkelt inte är möjligt med webbkameran som FaceTime på Apple Vision Pro emulerar. Och fördelarna med ett delat koordinatutrymme ökar ju fler människor du har.

Tack och lov arbetar Apple också på "Spatial Personas" som kan existera utanför fönster som möjliggör virtuella möten med ett delat koordinatutrymme som befintliga VR-avatarsystem. Det är en av få uppdateringar som Apple specifikt har bekräftat för efterlansering, och jag kan inte vänta med att prova den.

Okej, så det är min syn på att använda Vision Pro för att kommunicera med andra headsetbärare, men hur är det med att använda din Persona till FaceTime med människor i omvärlden som använder telefoner eller webbkameror? Det som är bra med FaceTime på Vision Pro är synen du får av den andra personen. Du kan göra den stor nog att matcha storleken på deras riktiga huvud, en mycket mer övertygande upplevelse än att se dem på en liten rektangel i din hand. Men det som är hemskt med FaceTime på Vision Pro är synen den andra personen får av dig. Personas är otroligt imponerande teknik med tanke på hur snabbt de kan genereras och hur bra de fungerar på ett fristående headset. Men de förblir djupt i den kusliga dalen, och reaktionerna från människor du FaceTime kommer att variera från skratt till chock och avsky.

Reseläge

Medan jag nu har använt Vision Pro i dussintals på dussintals timmar, när jag först hämtade den i New York hade jag bara ett par timmar på mig att använda den i en stationär byggnad. Bara några timmar senare gick jag ombord på ett flyg hem, där jag tillbringade cirka sex av de åtta timmarna med Vision Pro, ansluten till sätets eluttag.

(film från Apple)

För att kunna jämföra upplevelsen gjorde jag faktiskt samma sak med min Quest 3 på flyget till New York. Närhelst flygplanet ändrade höjd, hastighet eller bäring skulle alla virtuella element flyga iväg i motsatt riktning, och när det var turbulens skakade allt våldsamt. För att praktiskt kunna använda Quest 3 på flygningen var jag tvungen att inaktivera positionsspårning, vilket också inaktiverar passthrough. Meta arbetar på ett reseläge för Quest, men för tillfället är det ett headset endast för VR på flyg.

Varför fungerar inte visuell spårning inifrån och ut på plan som standard?

Människor tror ofta att markörlösa in-ut-spårningssystem på headset, glasögon och självspårningskontroller bara använder kamerorna, men så är inte fallet. Dessa system förlitar sig lika mycket på tröghetsmätenheten (IMU), ett chip som innehåller en liten accelerometer och gyroskop.

Medan kameror vanligtvis körs på 30Hz eller 60Hz, ger IMU vanligtvis uppdateringar runt 1000Hz, vilket möjliggör mycket lägre latens. Men en IMU kan faktiskt inte upptäcka absolut rörelse – åtminstone inte direkt. Accelerometern i IMU känner dock av acceleration i förhållande till gravitationen, och du kan ta integralen av acceleration över tid för att få hastighet. Och om du återigen tar integralen, denna tid av dessa hastighetsvärden över tid, får du förskjutning från den ursprungliga positionen.

Denna process kallas dead reckoning. Från ögonblick till ögonblick är det hur varje headset och styrenhet spårar sig själv, och den optiska komponenten som kameror eller laserbasstationer används bara för att korrigera för det kumulativa felet som orsakas av bruset i IMU-data. Men i ett fordon i rörelse som ett flygplan, kommer accelerometern att ta upp accelerationen av själva fordonet, och tro att det är själva headsetet som rör sig, vilket resulterar i plötslig och snabb positionsdrift.

Apple Vision Pro å andra sidan har redan ett reseläge, och det fungerar förvånansvärt bra. Vissa industriveteraner hade tidigare förklarat detta omöjligt, och ändå fungerar det. Det är inte ett 3DoF-läge, positionsspårning finns kvar, även om spårningskvaliteten är sämre än vanligt, med lite jitter och drift.

Även om Apple inte har avslöjat exakt hur reseläget fungerar, misstänker jag att det gör att spårning antingen helt eller till största delen förlitar sig på kamerorna, med liten eller ingen input från accelerometern i IMU.

En antydan till att denna förklaring är sann är att den varnar dig för att inte titta ut genom fönstret. Prova detta och du kommer att få betydande drifting, eftersom det visuella systemet inte längre har närliggande funktioner med hög kontrast att använda som referens.

Slutsats, och för vem är Vision Pro egentligen?

Jag har ägnat mycket tid åt att jämföra Apple Vision Pro med Meta Quest 3 i den här recensionen. Jag har gjort det eftersom det är den enda jämförbara konsumentenheten som skickas för närvarande. Men medan Vision Pro som ett headset i grunden bara är en soppad Quest 3 – i den meningen att de båda är ungefär ett halvt kilogram headset med två skärmar förstorade av pannkakslinser som visar dig den verkliga världen genom kameror – dess mjukvara och innehåll fokus, batteriarkitektur och brist på kontroller gör det till en helt annan produkt, utan tvekan inte ens en direkt konkurrent.

Quest-headset har etablerat en blomstrande XR-marknad kring användningsfallen för uppslukande spel, fitness och sociala VR-plattformar. Apple Vision Pro gör inget av dessa saker ännu, och dess hårdvara är inte utformad för. Men det gör andra saker som Quest antingen inte kan göra alls eller inte kan göra tillräckligt bra för att spela roll.

Redan 2005 tillfrågades Steve Jobs av veteranen teknisk journalist Walt Mosberg om begränsningarna med att integrera video i den handhållna formfaktorn hos en iPod. Så här sa han:

"Det grundläggande problemet här är att hörlurar är en mirakulös sak. Du sätter på dig ett par hörlurar och du får den upplevelse du får med ett par fantastiska högtalare.

Det finns inget sådant som hörlurar för video. Det finns inget jag kan bära med mig som jag kan ta på mig och det ger mig samma upplevelse jag får som när jag tittar på min 50-tums plasmaskärm hemma. Tills någon uppfinner det, kommer du att ha dessa motsatta begränsningar.”

Jag skulle hävda att 19 år senare är Apple Vision Pros verkliga syfte att förverkliga denna idé om "hörlurar för video". Vision Pro är en bärbar biograf med en större skärm än din TV som kan spela upp 3D-filmer bättre än någon TV någonsin kunde. Det är en gigantisk bildskärm som får plats i din ryggsäck. Vision Pros nuvarande fokus är att förvandla skärmar till mjukvara, och den har upplösningen för att ta bort det.

Frågan är naturligtvis: gör den detta tillräckligt bra för att vara värd $3500? Svaret är naturligtvis inte. Det är för tungt för att vara bekvämt för många människor, och det är endast prissatt för rika early adopters. Men så var den första vågen av bilar, färg-TV, persondatorer och mobiltelefoner. Det finns en anledning till att Apple märkte den här produkten som Pro, och varför så många av dess pressmeddelanden fokuserar på visionOS som produkt. Detta är början på en helt ny produktkategori för Apple, inte bara en enda linje, och Vision Pro handlar bara om att lägga grunden.

Men jag granskar inte den potentiella framtida Vision-headsetlinjen, jag recenserar första generationens Apple Vision Pro. Apple Vision Pro, som en hårdvara, är helt enkelt inte sju gånger bättre än Meta Quest 3. Men magin här ligger i mjukvarans grunder. För multitasking och allmän datoranvändning är visionOS så långt före Meta Quest-plattformen att jag har svårt att föreställa mig hur Meta någonsin skulle kunna komma ikapp – skillnaderna mellan mjukvaran är så stora. Utan kontroller konkurrerar Vision Pro helt enkelt inte med Quests primära användningsfall, men det drar ut andra användningsfall så mycket bättre. Det är en väldigt annorlunda produkt.

Åh, och för vad det är värt, jag skrev hela denna recension i Vision Pro.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://www.uploadvr.com/apple-vision-pro-review/