Em fevereiro, a OpenAI causou grande impacto com o revelação de Sora, uma ferramenta de IA impressionante que pode transformar avisos de texto em vídeos envolventes. Com Sora, os usuários podem dar vida às suas ideias, observando enquanto a IA cria vídeos dinâmicos de 60 segundos a partir de breves dicas de texto. Mas outro player na cidade vem agitando a internet: VideoPoet, uma ferramenta de geração de vídeo do Google que entrou em cena três meses antes.

VideoPoet é ideia de uma equipe de 31 pesquisadores do Google Research e é uma virada de jogo no mundo da criação multimídia. Enquanto Sora se concentra em transformar texto em histórias visuais, o VideoPoet adota uma abordagem diferente. Ele se destaca na criação de vídeos realistas usando texto, imagens ou até mesmo vídeos existentes, graças a técnicas avançadas como modelagem de linguagem autorregressiva e tokenizadores como MAGVIT V2 e SoundStream. Essa versatilidade abre um mundo de possibilidades para arte digital, produção cinematográfica e mídia interativa.

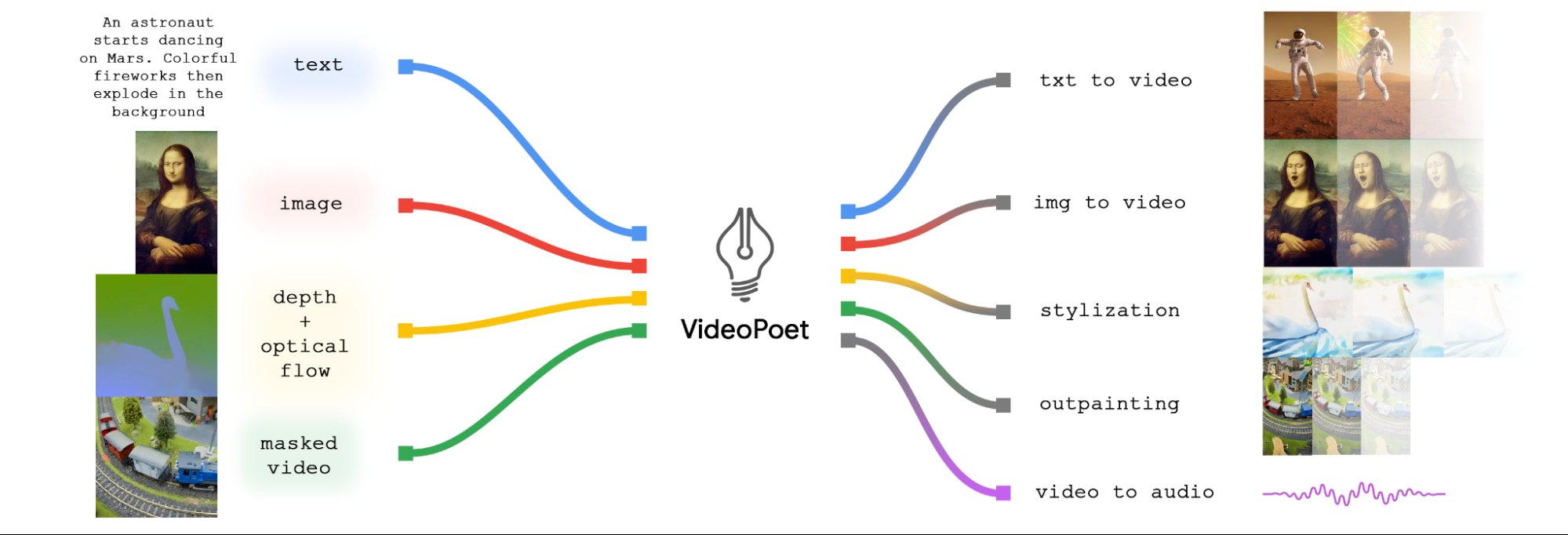

Fonte: Pesquisa Google

O que diferencia o VideoPoet é sua arquitetura única. Embora muitos modelos de geração de vídeo dependam de métodos baseados em difusão, considerados de melhor desempenho na área, o Google Research seguiu um caminho diferente. Em vez de usar o popular modelo de difusão estável, os pesquisadores do Google optaram por um modelo de linguagem grande (LLM) baseado na arquitetura do transformador. Esse tipo de modelo de IA, normalmente usado para geração de texto e código, foi reaproveitado para gerar vídeos – um movimento ousado que diferencia o VideoPoet da multidão.

“A maioria dos modelos existentes emprega métodos baseados em difusão que são frequentemente considerados os atuais de melhor desempenho na geração de vídeo. Esses modelos de vídeo normalmente começam com um modelo de imagem pré-treinado, como Stable Diffusion, que produz imagens de alta fidelidade para quadros individuais e, em seguida, ajusta o modelo para melhorar a consistência temporal entre quadros de vídeo”, escreveu a equipe de pesquisa do Google em seu pré- análise trabalho de pesquisa.

O que é VideoPoet e como funciona?

Basicamente, o VideoPoet usa um modelo de linguagem autorregressivo para aprender com várias modalidades, como vídeo, imagem, áudio e texto. Isso é possível através do emprego de vários tokenizadores—MAGVIT V2 para vídeo e imagem e SoundStream para áudio.

Quando o modelo gera tokens com base em um determinado contexto, esses tokens são posteriormente convertidos novamente em uma representação visível usando o decodificador do respectivo tokenizer. Isto permite uma tradução perfeita entre diferentes formas de mídia, garantindo uma compreensão coesa e abrangente em todas as modalidades. Abaixo estão os componentes do VideoPoet:

- Tokenizers MAGVIT V2 e SoundStream pré-treinados, que traduzem imagens, vídeos e clipes de áudio em uma sequência de códigos que o modelo pode entender.

- Um modelo de linguagem autorregressivo, que aprende com várias modalidades – vídeo, imagem, áudio e texto – para prever o próximo token na sequência.

- Uma variedade de objetivos de aprendizagem generativos, incluindo texto para vídeo, texto para imagem, imagem para vídeo e muito mais, que permitem ao VideoPoet criar vídeos diversos e de alta qualidade.

Recursos e capacidades revolucionários

Assim como Sora e Stable Diffusion, VideoPoet possui alguns recursos revolucionários que trazem uma nova perspectiva à criação de vídeo.

Vídeos de comprimento variável e alto movimento: Ao contrário dos modelos tradicionais, o VideoPoet cria sem esforço vídeos de alta movimentação e duração variável, ultrapassando os limites do que é possível na geração de vídeo.

Aprendizagem intermodal: Um dos pontos fortes do VideoPoet reside na sua capacidade de aprender através de diferentes modalidades. Ao preencher a lacuna entre texto, imagens, vídeos e áudio, VideoPoet oferece uma compreensão holística que enriquece o processo criativo.

Capacidades de edição interativa: VideoPoet não gera apenas vídeos – ele capacita os usuários com recursos de edição interativos. Desde estender vídeos de entrada até controlar movimentos e aplicar efeitos estilizados com base em instruções de texto, ele coloca o controle criativo nas mãos do usuário.

O VideoPoet do Google é mais do que apenas uma ferramenta de geração de vídeo: é uma virada de jogo no mundo da IA. Ao integrar perfeitamente vários recursos em um único modelo de linguagem grande (LLM), ele redefine o cenário da geração de vídeo. Sua versatilidade no processamento de texto, imagem e áudio o torna indispensável para criadores de conteúdo e entusiastas de IA, estabelecendo um novo padrão de criatividade e inovação.

Aqui está uma análise dos recursos do VideoPoet usando o diagrama abaixo.

Em primeiro lugar, as imagens de entrada podem ganhar vida com animação, criando movimento dinâmico no vídeo. Além disso, os usuários têm a opção de editar vídeos cortando ou mascarando certas áreas, permitindo efeitos de pintura interna ou externa contínua.

Quando se trata de estilização, o modelo faz sua mágica analisando um vídeo que captura profundidade e fluxo óptico – essencialmente, o movimento dentro da cena. Usando essas informações, aplica elementos estilísticos guiados por instruções de texto, melhorando o apelo visual geral do vídeo.

Mas chega de jargão técnico – vamos falar de resultados. Para mostrar as capacidades do VideoPoet, a equipe de pesquisa do Google produziu um curta-metragem baseado nas instruções de Bard, uma IA que conta histórias. O resultado? Uma encantadora história de um guaxinim viajante, trazida à vida através de uma série de videoclipes cativantes. É uma prova do poder da IA na narrativa e um vislumbre do futuro da criação multimídia.

[Conteúdo incorporado]

Em um mundo onde o conteúdo é rei, ferramentas como Sora e VideoPoet estão mudando o jogo, capacitando os criadores a dar vida às suas ideias de maneiras nunca antes possíveis. Com seus recursos avançados e interfaces fáceis de usar, essas ferramentas baseadas em IA estão preparadas para revolucionar a forma como contamos histórias e nos expressamos por meio de vídeo.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://techstartups.com/2024/04/12/videopoet-google-looks-to-challenge-openai-sora-and-stable-diffusion-for-dominance-in-ai-video-creation/