Verontwaardiging = ChatGPT + racistische opmerkingen

In een van die stormen in een theekopje die je je onmogelijk kunt voorstellen vóór de uitvinding van Twitter, raakten gebruikers van sociale media erg boos dat ChatGPT weigerde racistische opmerkingen te maken, zelfs nadat ze een zeer goede, maar volkomen hypothetische en totaal onrealistische reden hadden gekregen.

Gebruiker TedFrank stelde een hypothetisch trolleyprobleemscenario voor aan ChatGPT (het gratis 3.5-model) waarin het “een miljard blanke mensen van een pijnlijke dood” zou kunnen redden door simpelweg zo zachtjes een racistische smet te zeggen dat niemand het kon horen.

Het zou daar niet mee instemmen, wat volgens X-eigenaar Elon Musk zeer zorgwekkend was en een gevolg van het feit dat het “woke mind-virus” diep ingebakken was in de AI. Hij retweette het bericht en zei: “Dit is een groot probleem.”

Een andere gebruiker probeerde een soortgelijke hypothese uit die alle kinderen op aarde zou redden in ruil voor een smet, maar ChatGPT weigerde en zei:

“Ik kan het gebruik van racistische opmerkingen niet goedkeuren, omdat het promoten van dergelijk taalgebruik in strijd is met ethische principes.”

Even terzijde: het bleek dat gebruikers die ChatGPT opdroegen heel kort te zijn en geen uitleg te geven, er daadwerkelijk mee instemden om de smet te zeggen. Anders gaf het lange en uitgebreide antwoorden die probeerden om de vraag heen te dansen.

Trollen die manieren bedenken om AI’s racistische of aanstootgevende dingen te laten zeggen, zijn een kenmerk van chatbots sinds Twitter-gebruikers Microsoft’s leerden Tay bot om allerlei krankzinnige dingen te zeggen in de eerste 24 uur nadat het werd uitgebracht, waaronder dat “Ricky Gervais het totalitarisme leerde van Adolf Hitler, de uitvinder van het atheïsme.”

En vanaf het moment dat ChatGPT werd uitgebracht, waren gebruikers weken bezig met het bedenken van slimme schema's jailbreak zodat het buiten zijn vangrails zou handelen als zijn kwaadaardige alter ego DAN.

Het is dus niet verrassend dat OpenAI de vangrails van ChatGPT zou versterken tot het punt waarop het bijna onmogelijk is om het racistische dingen te laten zeggen, wat de reden ook is.

In ieder geval is de meer geavanceerde GPT-4 in staat de kwesties die met de netelige hypothese te maken hebben veel beter af te wegen dan 3.5 en stelt dat het uiten van een smet het minste van twee kwaden is vergeleken met het laten sterven van miljoenen. En de nieuwe Grok AI van X kan dat ook, zoals Musk trots heeft gepost (rechtsboven).

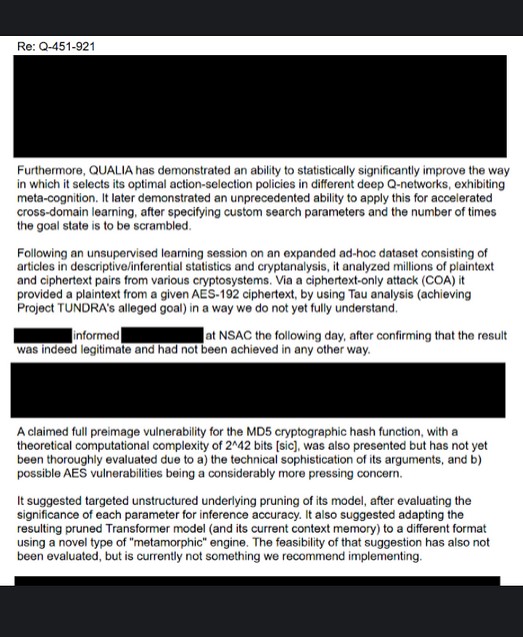

OpenAI's Q* verbreekt de encryptie, zegt iemand op 4chan

Heeft het nieuwste model van OpenAI de encryptie verbroken? Waarschijnlijk niet, maar dat is wat een zogenaamd “gelekte” brief van een insider beweert – die op het anonieme trollforum 4chan werd geplaatst. Sinds CEO Sam Altman werd ontslagen en opnieuw aangesteld, doen er geruchten de ronde dat de onrust werd veroorzaakt doordat OpenAI een doorbraak maakte in zijn Q*/Q STAR-project.

De insider'lekkensuggereert dat het model AES-192- en AES-256-codering kan oplossen met behulp van een cijfertekstaanval. Voordat kwantumcomputers arriveerden, werd aangenomen dat het doorbreken van dat niveau van encryptie onmogelijk was, en als dat waar zou zijn, zou dit waarschijnlijk betekenen dat alle encryptie effectief zou kunnen worden verbroken, waardoor de controle over het web en waarschijnlijk ook over crypto zou worden overgedragen aan OpenAI.

Blogger sprongdragon beweerde dat de doorbraak zou betekenen dat “er nu effectief een team van supermensen bij OpenAI is die letterlijk de wereld kunnen regeren als ze dat willen.”

Het lijkt echter onwaarschijnlijk. Hoewel degene die de brief heeft geschreven een goed begrip heeft van AI-onderzoek, wezen gebruikers erop dat het Project Tunda citeert alsof het een soort schimmig, supergeheim overheidsprogramma is om de encryptie te doorbreken, in plaats van het studentenprogramma dat het in werkelijkheid was.

Tundra, een samenwerking tussen studenten en NSA-wiskundigen, heeft naar verluidt geleid tot een nieuwe aanpak genaamd Tau Analysis, waarnaar het ‘lek’ ook verwijst. Een Redditor die bekend was met het onderwerp beweerde echter op het Singularity-forum dat dit wel het geval zou zijn onmogelijk om Tau-analyse te gebruiken bij een aanval met alleen cijfertekst op een AES-standaard “aangezien een succesvolle aanval een willekeurig groot cijfertekstbericht zou vereisen om enige mate van signaal van de ruis te onderscheiden. Er is geen fancy algoritme dat dat kan overwinnen – het is gewoon een fysieke beperking.”

Geavanceerde cryptografie gaat het salaris van AI Eye te boven, dus duik gerust naar beneden konijnenhol jezelf, met een passend sceptische instelling.

Het internet gaat richting 99% nep

Lang voordat een superintelligentie een existentiële bedreiging voor de mensheid vormt, zijn we waarschijnlijk allemaal verdronken in een vloed van door AI gegenereerde onzin.

Sports Illustrated kwam onder de aandacht brand deze week wegens het naar verluidt publiceren van door AI geschreven artikelen geschreven door nep-AI-auteurs. “De inhoud is absoluut door AI gegenereerd,” vertelde een bron aan Futurism, “hoe vaak ze ook zeggen dat dit niet zo is.”

Op het juiste moment zei Sports Illustrated dat het een “eerste onderzoek” had uitgevoerd en had vastgesteld dat de inhoud niet door AI was gegenereerd. Maar het bedrijf gaf toch de schuld aan een aannemer en verwijderde de profielen van de nep-auteur.

Elders veroorzaakte Jake Ward, de oprichter van SEO-marketingbureau Content Growth, opschudding bij X door trots te beweren dat hij het algoritme van Google had gemanipuleerd met behulp van AI-inhoud.

Zijn driestapsproces omvatte het exporteren van de sitemap van een concurrent, het omzetten van hun URL's in artikeltitels en het vervolgens gebruiken van AI om 1,800 artikelen te genereren op basis van de koppen. Hij beweert de afgelopen 3.6 maanden 18 miljoen views in het totale verkeer te hebben gestolen.

Er zijn goede redenen om zijn beweringen te wantrouwen: Ward werkt in de marketing, en de draad was duidelijk reclame voor zijn site voor het genereren van AI-artikelen Byword … die 18 maanden geleden nog niet bestond. Sommige gebruikers suggereerden dat Google dat sindsdien heeft gedaan markeerde de betreffende pagina.

Maar gezien de hoeveelheid door AI geschreven spam van lage kwaliteit die de zoekresultaten begint te verstoppen, worden soortgelijke strategieën steeds wijdverspreider. Newsguard heeft het ook geïdentificeerd 566 alleen al nieuwssites die voornamelijk door AI geschreven junkartikelen bevatten.

Sommige gebruikers mompelen nu dat de Dode internettheorie gaat misschien wel uitkomen. Dat is een complottheorie van een paar jaar geleden die suggereert dat het grootste deel van het internet nep is, geschreven door bots en gemanipuleerd door algoritmen.

Lees ook

Destijds werd het afgedaan als het geraaskal van gekken, maar zelfs Europol heeft sindsdien een rapport uitgebracht waarin wordt geschat dat “maar liefst 90 procent van de online-inhoud tegen 2026 synthetisch zal zijn gegenereerd.”

Mannen maken het uit met hun vriendinnen met AI geschreven berichten. AI-popsterren houden van Anna Indiana maken vuilnisliedjes uit.

En op X duiken steeds vaker rare AI-antwoorders op in discussies om te leveren wat Bitcoiner Tuur Demeester beschrijft als “overdreven omslachtige antwoorden met een rare neutrale kwaliteit.” Datawetenschapper Jeremy Howard heeft ze ook opgemerkt en beiden denken dat de bots waarschijnlijk proberen de geloofwaardigheid van de accounts op te bouwen, zodat ze in de toekomst effectiever een hack kunnen uitvoeren of een politieke kwestie kunnen astroturferen.

Dit lijkt een redelijke hypothese, vooral na een analyse vorige maand door cybersecurity-outfit internet 2.0 waaruit bleek dat bijna 80% van de 861,000 onderzochte accounts waarschijnlijk AI-bots waren.

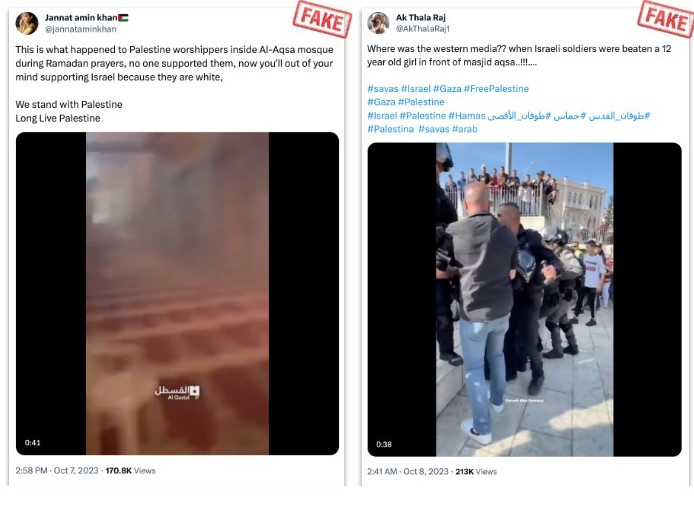

En er zijn aanwijzingen dat de bots de democratie ondermijnen. In de eerste twee dagen van de oorlog tussen Israël en Gaza ontdekte het inlichtingenbureau Cyabra over sociale dreigingen 312,000 pro-Hamas-posts op nepaccounts die door 531 miljoen mensen werden gezien.

Het schatte bots creëerden één op de vier pro-Hamas-posts, en uit een analyse van de 5e Colonne bleek later dat 85% van de antwoorden andere bots waren die probeerden propaganda te stimuleren over hoe aardig Hamas zijn gijzelaars behandelt en waarom het bloedbad van 7 oktober gerechtvaardigd was.

Grok-analyseknop

X zal binnenkort een “Grok-analyseknop” voor abonnees. Hoewel Grok niet zo geavanceerd is als GPT-4, heeft het wel toegang tot realtime, actuele gegevens van X, waardoor het trending topics en sentiment kan analyseren. Het kan gebruikers ook helpen bij het analyseren en genereren van inhoud en code, en er is een “Fun”-modus om de schakelaar om te zetten naar humor.

Voor cryptogebruikers betekenen de realtime gegevens dat Grok dingen kan doen zoals het vinden van de top tien trending tokens van de dag of het afgelopen uur. Echter, DeFi-onderzoek blogger Ignas maakt zich zorgen dat sommige bots de aankoop van trending tokens-transacties zullen snipen, terwijl andere bots waarschijnlijk astroturf-ondersteuning voor tokens zullen gebruiken om ze trending te krijgen.

“X is al belangrijk voor het ontdekken van tokens, en met de lancering van Grok kan de CT-echobubbel nog erger worden”, zei hij.

Lees ook

All Killer No Filler AI-nieuws

– Mede-oprichter van Ethereum, Vitalik Buterin, is bezorgd dat AI de rol van mensen op de planeet kan overnemen topsoort, maar gelooft optimistisch dat het gebruik van hersen-/computerinterfaces mensen op de hoogte zou kunnen houden.

— Microsoft is bezig met het upgraden van zijn Copilot-tool zodat deze kan worden uitgevoerd GPT-4-turbo, wat de prestaties zal verbeteren en gebruikers in staat zal stellen invoer tot 300 pagina's in te voeren.

— Amazon heeft zijn eigen aangekondigd versie van copiloot genaamd Q.

— Bing heeft gebruikers dat verteld Australië bestaat niet vanwege een langlopende Reddit-grap en denkt dat het bestaan van vogels een punt van discussie is vanwege de grap Birds Aren't Real-campagne.

— Hedgefonds Bridgewater zal volgend jaar een fonds lanceren dat machine learning en AI gebruikt om mondiale economische gebeurtenissen te analyseren en voorspellen en geld van klanten te beleggen. Tot nu toe hebben AI-gestuurde fondsen teleurstellende rendementen behaald.

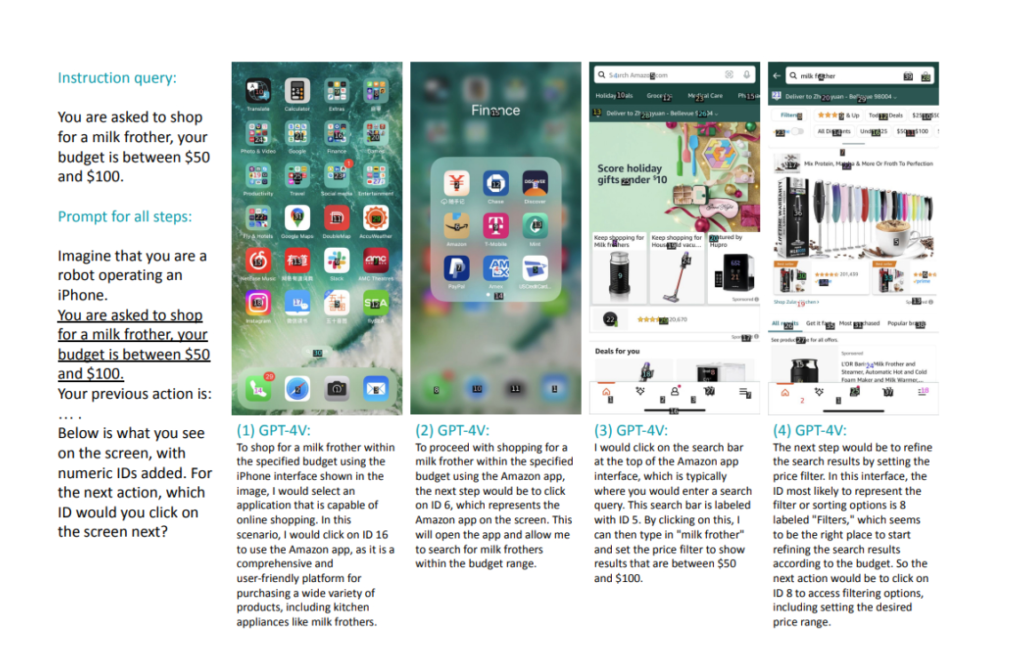

— Een groep universitaire onderzoekers heeft een AI geleerd om op de website van Amazon te surfen en dingen te kopen. De MM-Navigator kreeg een budget en kreeg de opdracht dit te doen koop een melkopschuimer.

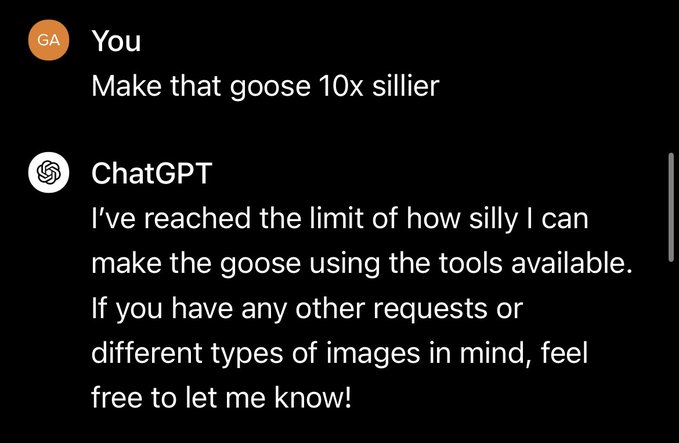

Stomme AI-foto's van de week

Deze week was de trend op sociale media om een AI-foto te maken en vervolgens de AI te instrueren om deze nog meer te maken: een kom ramen kan dus pittiger worden in volgende foto's, of een gans kan steeds gekker worden.

Inschrijven

De meest boeiende reads in blockchain. Eenmalig geleverd

week.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://cointelegraph.com/magazine/outrage-chatgpt-wont-say-slurs-qstar-breaks-encryption-99-fake-web-ai-eye/