Dankzij technologische vooruitgang wordt het steeds moeilijker om te zeggen wat echt is en wat niet. Dit probleem wordt verergerd door het gebruik van deepfake-technologie—audio en video's die AI gebruiken om individuen of hun stemmen te vervangen. Hoewel veel deepfakes met succes zijn gebruikt voor entertainment (zoals if Nicholas Cage was in de Raiders of the Lost Ark) of gamen (zoals in FIFA-atleten), is een groot percentage van hen gemaakt voor meer sinistere redenen. Naarmate het gemakkelijker wordt om deze gemanipuleerde video's te maken, hopen veel experts dat kwantumcomputing kan helpen om de potentiële bedreigingen van deze opkomende technologie te overwinnen.

Hoe werkt deepfake-technologie?

Om een succesvolle deepfake-video te maken, heb je nodig machine learning algoritmen. "Deep learning-algoritmen leren zichzelf hoe ze problemen uit grote datasets kunnen oplossen en worden vervolgens gebruikt om gezichten te wisselen tussen video en andere digitale inhoud", legt uit Post-kwantum CEO Andersen Cheng. Post-Quantum is een toonaangevend cyberbeveiligingsbedrijf dat zich richt op kwantumbestendig beveiliging, ook tegen deepfakes. "Er zijn een aantal methoden om deze deepfakes te maken," verklaarde Cheng, "maar de meest populaire is het gebruik van diepe neurale netwerken met auto-encoders. Een auto-encoder is een deep learning AI-programma dat videoclips bestudeert om te begrijpen hoe een persoon eruit ziet vanuit meerdere hoeken en vanuit de omgeving, en vervolgens die persoon in kaart brengt op het individu door gemeenschappelijke kenmerken te vinden.”

Een set-up van deepfake-technologie (PC Wikimedia Commons)

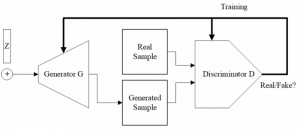

Om ervoor te zorgen dat de auto-encoder goed werkt, moeten meerdere videoclips van het gezicht van het onderwerp worden geanalyseerd om een grotere hoeveelheid gegevens te verkrijgen. Vervolgens kan de auto-encoder helpen bij het maken van een samengestelde video door de oorspronkelijke persoon te verwisselen met het nieuwe onderwerp. Een tweede type machine learning, een General Adversarial Network (GAN's) genaamd, zal fouten in de nieuwe samengestelde video detecteren en verbeteren. Volgens een Artikel uit 2022: "GAN's trainen een 'generator' om nieuwe beelden te creëren op basis van de latente representatie van het bronbeeld en een 'discriminator' om het realisme van de gegenereerde materialen te evalueren." Dit proces gebeurt verschillende keren totdat de discriminator niet kan zeggen of de video is gemanipuleerd en de deepfake compleet is.

De dreiging van deepfake-technologie

Momenteel zijn er veel open-source software of gratis apps die individuen kunnen gebruiken om deepfakes te maken. Hoewel dit voor velen gunstig lijkt, vooral degenen in de entertainmentindustrie, heeft het geleid tot ernstige, zelfs criminele problemen. Volgens een Deeprace-rapport, was 96% van de deepfake-video's online in 2019, niet verrassend, pornografie. Terwijl veel van deze illegale video's werden gemaakt om wraak te nemen op een ex, werden andere gebruikt om schandalen te creëren voor vrouwelijke beroemdheden en zelfs politici. In 2018 werd een deepfake-video vrijgegeven van een Belgische politieke partij waarop de toenmalige president Trump de klimaatakkoorden van Parijs bespreekt. Nu nepnieuws al een probleem wordt voor het grote publiek, kunnen deepfake-video's de druppel zijn die de emmer doet overlopen. Ook al diepe audio richt grote schade aan, aangezien een gemanipuleerd audiobestand van de CEO van een technologiebedrijf hielp bij het plegen van fraude. Voor Cheng kunnen dit soort media het vertrouwen van het publiek vrij snel aantasten. "We hebben de bredere kwestie van maatschappelijk vertrouwen: hoe zal het publiek onderscheid kunnen maken tussen wat echt is en wat een deepfake is," voegde Cheng eraan toe. "Zoals we hebben gezien, is er zelfs bewijs dat deepfakes worden gebruikt om beschermende maatregelen zoals biometrische authenticatie te omzeilen." Met deze groeiende zorgen geloven Cheng en zijn team bij Post-Quantum dat ze een oplossing hebben in de vorm van Nomidio, een gespecialiseerde ultra-beveiligingssoftware.

Voorbereiding op bedreigingen met DeepFake-technologie

Cheng en dit team keken naar de vele bedreigingen van quantum computing en deepfakes en creëerden Nomidio om ervoor te zorgen dat inlogidentiteiten en zelfs biometrische authenticatie veilig blijven. "Nomidio is een biometrische, wachtwoordloze multi-factor biometrische (MFB) service die veilige authenticatie mogelijk maakt met een eenvoudige en intuïtieve gebruikerservaring", aldus Cheng. "Het vervangt op gebruikersnaam/wachtwoord gebaseerde login en single sign-on, waarbij gebruikers achter de schermen worden geauthenticeerd aan de hand van hun biometrische profiel met multi-factor authenticatie (MFA)." Omdat Cheng al jaren een expert is op het gebied van cyberbeveiliging, zorgde hij ervoor dat Nomidio ook beveiligd kon zijn tegen deepfakes. “Onze kernfilosofie bij het maken ervan was om zoveel mogelijk extra input te gebruiken en echte multi-factor authenticatie (dwz met meer dan twee factoren), dus het is in feite de ideale oplossing om toekomstige ontwikkelingen in deepfake-technologie aan te pakken. Dit komt uiteindelijk doordat traditionele MFA onvoldoende is, maar MFB real-time aanvallen vrijwel onmogelijk kan maken. Dat wil zeggen, een combinatie van bijvoorbeeld stem, gezicht en een pincode is zeer veilig door het feit dat elke afzonderlijke factor mogelijk kan worden vervalst, maar het vrijwel onmogelijk is om ze alle drie in hetzelfde geval te vervalsen. Met Nomidio kan een combinatie van stem- en gezichtsbiometrie, spraakherkenning, contextafhankelijke data en zelfs gedragsanalyse worden gecombineerd tot één authenticatiesysteem. ”

Hoewel Nomidio zelf geen gebruik maakt van kwantumcomputing om deepfake-bedreigingen te overwinnen, zouden kwantumcomputers mogelijk kunnen werken tegen deze nep-mediabestanden. Net zo quantum computers maken vaak gebruik van machine learning-algoritmen om sneller en efficiënter te werken, en kunnen ze mogelijk detecteren nepvideo's of audiobestanden sneller. Hoewel de technologie nog steeds wordt ontwikkeld en slechts weinigen kijken naar deepfakes als een mogelijke use-case voor kwantumcomputers, kunnen deze machines van het volgende niveau in de toekomst worden gebruikt om onze media waarheidsgetrouwer en nauwkeuriger te maken.

Nu de dreigingen van deepfake-technologie steeds duidelijker worden, proberen veel regeringen en bedrijven al manieren te vinden om deze te helpen bestrijden. In 2021 lanceerde Facebook de Deepfake Detection Challenge, met een prijs van $ 500,000 voor degenen die nieuwe technologie ontwikkelen om deepfakes op te sporen. In de VS hebben staten als Californië, Texas en Virginia wetten die het gebruik van deepfake voor zowel pornografie als politiek verbieden. De Europees parlement stelde ook meer regelgeving vast rond deepfakes, waarbij de Digital Services Act werd gewijzigd om het gebruik van labels op deepfake-video's op te leggen. Hoewel deze wetgeving pas in 2024 van kracht zal worden, toont het wel de ernst aan van de dreiging van deepfake-technologie.

Kenna Hughes-Castleberry is een stafschrijver bij Inside Quantum Technology en de Science Communicator bij JILA (een samenwerking tussen de University of Colorado Boulder en NIST). Haar schrijfritmes omvatten deep tech, de metaverse en kwantumtechnologie.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- Platoblockchain. Web3 Metaverse Intelligentie. Kennis versterkt. Toegang hier.

- Bron: https://www.insidequantumtechnology.com/news-archive/inside-quantum-technologys-inside-scoop-quantum-and-deepfake-technology/