Introductie

AutoGen Studio, mogelijk gemaakt door het AutoGen-framework, is een revolutionair platform voor het ontwikkelen van AI-agents die naadloos samenwerken om taken uit te voeren. In deze blogpost verkennen we de mogelijkheden van AutoGen Studio en integreren we deze met gratis alternatieven van OpenAI zoals Tekst genereren WebUI en LM Studio. Aan het einde van deze handleiding heeft u een uitgebreid inzicht in hoe u AutoGen Studio lokaal kunt gebruiken met alternatieve taalmodeltools.

leerdoelen

- Begrijp de basisprincipes van AutoGen en AutoGen Studio.

- Leer het installatieproces van AutoGen Studio.

- Integreer AutoGen Studio met de Text Generation Web UI voor tekstgeneratietaken.

- Ontdek het gebruik van AutoGen Studio met LM Studio voor taalmodelinteracties.

Dit artikel is gepubliceerd als onderdeel van het Data Science-blogathon.

Inhoudsopgave

Wat is AutoGen?

Autogen is een raamwerk dat is ontworpen voor het ontwikkelen van toepassingen die gebruik maken van Language Model (LLM)-agents die kunnen samenwerken om taken op te lossen. Deze agenten, die zowel aanpasbaar als gemoedelijk zijn, integreren naadloos menselijke participatie en opereren in verschillende modi, waarbij ze gebruik maken van combinaties van LLM's, menselijke input en hulpmiddelen.

AutoGen Studio fungeert als een AI-applicatie, met een gebruikersinterface die wordt aangedreven door het AutoGen-framework. Het primaire doel is om het prototypingproces van AI-agents te stroomlijnen, waardoor gebruikers deze agenten kunnen uitbreiden met verschillende vaardigheden, ze kunnen structureren in samenhangende workflows en kunnen deelnemen aan interactieve taakvoltooiing.

Wat is het doel van AutoGen Studio?

Verbetering van de gebruikersinteractie

Dankzij de intuïtieve interface van AutoGen Studio kunnen gebruikers moeiteloos agenten en multi-agent-workflows declaratief definiëren en wijzigen. De noodzaak om zich te verdiepen in complexe code of ingewikkelde configuraties wordt geëlimineerd. In plaats daarvan kunnen gebruikers een point-and-click-, drag-and-drop-interface gebruiken om de parameters van agenten en hun interacties te specificeren. Het lijkt op het bieden van een digitaal canvas waarin gebruikers de choreografie ontwerpen, en AutoGen Studio zorgt ervoor dat de agenten hun instructies naadloos volgen.

Het potentieel van agenten realiseren: eenvoudig vaardigheden toevoegen

Overweeg een scenario waarin een virtueel team nieuwe vaardigheden moet verwerven om veranderende taken aan te pakken. In een traditionele omgeving kan het integreren van deze vaardigheden gepaard gaan met het navigeren door ingewikkelde coderegels. AutoGen Studio vereenvoudigt echter het proces van het expliciet toevoegen van vaardigheden aan agenten. De interface geeft een duidelijk beeld van bestaande vaardigheden en biedt een toegankelijk platform voor het integreren van nieuwe vaardigheden. Het is alsof je een team nieuwe tools geeft, die je met slechts een paar klikken kunt bereiken.

Samenwerking tastbaar maken: de sectie Speeltuin

AutoGen Studio gaat verder dan de theoretische opzet en introduceert een Playground-sectie waar gebruikers kunnen communiceren met de eerder gedefinieerde agent-workflows. In deze virtuele ruimte gebeurt de magie: een digitale omgeving waar gebruikers deelnemen aan sessies, chatinteracties observeren en getuige zijn van de resultaten van hun georkestreerde samenwerking. Het is alsof je een virtuele oefenruimte hebt waar gebruikers de uitvoering van hun digitale ensemble kunnen verfijnen.

Succes delen: de galerijsectie

Zodra gebruikers de choreografie van hun agenten hebben geperfectioneerd en getuige zijn geweest van succesvolle sessies, biedt AutoGen Studio een platform om prestaties te delen via de sectie Galerij. Deze sectie dient als een opslagplaats voor succesvolle samenwerkingen tussen agenten, vergelijkbaar met het presenteren van een digitaal meesterwerk aan een breder publiek. Het bevordert de samenwerking en inspiratie binnen de AutoGen-gemeenschap.

Raadpleeg dit voor meer informatie over Autogen Studio blog

Stapsgewijze handleiding voor het implementeren van AutoGen Studio met Text-Generation-Web UI

Text Generation Web UI is een gebruiksvriendelijke webgebaseerde interface die is ontworpen voor het maken van tekst met behulp van verschillende grote taalmodellen, waaronder transformers, GPTQ, llama.cpp en andere. Het biedt een scala aan functies, zoals modelwisseling, notebookmodus, chatmodus en meer, waardoor het veelzijdig is voor toepassingen zoals creatief schrijven en chatbotontwikkeling.

Stap 1: Installatieproces

Volg deze stappen om een groot taalmodel lokaal op uw computer uit te voeren:

- Kloon de repository met behulp van de opdracht:

git clone https://github.com/oobabooga/text-generation-webui- Navigeer naar de map "Web-UI voor tekstgeneratie".

cd text-generation-webui- Kies het juiste startscript op basis van uw besturingssysteem.

Voorbeeld: Als u Windows OS gebruikt, voert u de volgende opdracht uit:

.start_windows.bat --api --listen-port 7822 --extensions openai- Linux: ./start_linux.sh

- Windows: start_windows.bat

- macOS: ./start_macos.sh

- WSL: ./start_wsl.bat

Druk op Enter. Hierdoor worden automatisch de vereiste pakketten voor de webinterface voor het genereren van tekst gedownload en geïnstalleerd. De installatie kan ongeveer een minuut duren.

Stap 2: GPU selecteren

- Tijdens de installatie wordt u gevraagd uw GPU te selecteren. Kies de juiste GPU, bijvoorbeeld 'N' als u geen GPU heeft en het model in CPU-modus wilt gebruiken, en druk op Enter.

- Het script installeert de benodigde pakketten volgens de opgegeven GPU.

Stap 3: Kopieer OpenAI-compatibele API-URL

Kopieer de gegenereerde OpenAI-compatibele URL. U heeft dit in een latere stap nodig.

Stap 4: Web-UI openen

- Navigeer naar de opgegeven lokale URL die in de uitvoer wordt vermeld.

- Open uw browser en voer de URL in. De webinterface zou moeten verschijnen.

Stap 5: Modellen downloaden

- Ga in de interface naar het tabblad “modellen”.

- Download het gewenste model.

- Voer de gebruikersnaam/het modelpad van het knuffelgezicht in het eerste vak in. Voorbeeld: TheBloke/Mistral-7B-Instruct-v0.2-GGUF

- Om een enkel bestand te downloaden (voor GGUF-modellen), voert u de naam ervan in het tweede vak in. Voorbeeld: Bij het knuffelen van dit model kies ik ervoor om TheBloke/Mistral-7B-Instruct-v0.2-GGUF te gebruiken. als u naar de sectie met beschikbare bestanden navigeert, ziet u de verschillende modellen van TheBloke/Mistral-7B-Instruct-v0.2-GGUF. Ik kies mistral-7b-instruct-v0.2.Q4_K_M.gguf

Controleer de terminal om de succesvolle download van het model te bevestigen. Het kan een minuut duren voordat het voltooid is.

Stap6: Interface vernieuwen

- Na het downloaden vernieuwt u de webinterface door op de knop Vernieuwen🔃 te klikken.

- Het gedownloade model zou nu in het vervolgkeuzemenu moeten worden vermeld.

Stap 7: Het model kiezen

- Kies het gewenste model uit de vervolgkeuzelijst.

- Klik op de knop “laden” om het geselecteerde model te laden.

Stap 8: Model geladen

- Na succesvol laden verschijnt er een bevestigingsbericht, wat aangeeft dat het model succesvol is geladen.

- Klik vervolgens op "Instellingen opslaan", nu kunnen we zien dat de instellingen zijn opgeslagen

Stap 9: Autogen Studio uitvoeren

Open een nieuwe terminal en voer de volgende opdrachten uit

De volgende stap is het installeren van AutoGen Studio. Voor een soepele ervaring raad ik aan een virtuele omgeving (bijvoorbeeld conda) te gebruiken om conflicten met bestaande Python-pakketten te voorkomen. Met Python 3.10 of nieuwer actief in uw virtuele omgeving, gebruikt u de volgende pip-opdracht:

pip install autogenstudioautogenstudio ui --port 8080uitvoerserver_autogenstudio.log

INFO: Started server process [11050]

INFO: Waiting for application startup.

INFO: Application startup complete.

INFO: Uvicorn running on http://127.0.0.1:8080 (Press CTRL+C to quit)Stap 10: Een LLM-provider instellen in Autogen UI

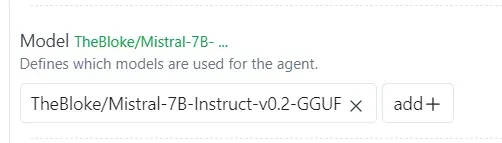

- Navigeer in de gebruikersinterface van AutoGen Studio naar de bovenkant en zoek het gedeelte 'Build'. Klik erop en kies vervolgens "Model"

- Klik op “Nieuw model” om een nieuw model in te voegen. Voer de modelnaam, basis-URL (plak de OpenAI-compatibele API-URL die u hebt gekopieerd.) Bijvoorbeeld http://0.0.0.0:5000/v1) en stel de API-sleutel in als “NoApi (typ een willekeurige tekenreeks, laat deze niet leeg).

- Als u klaar bent, klikt u op 'OK'.

Stap 11: De workflow instellen

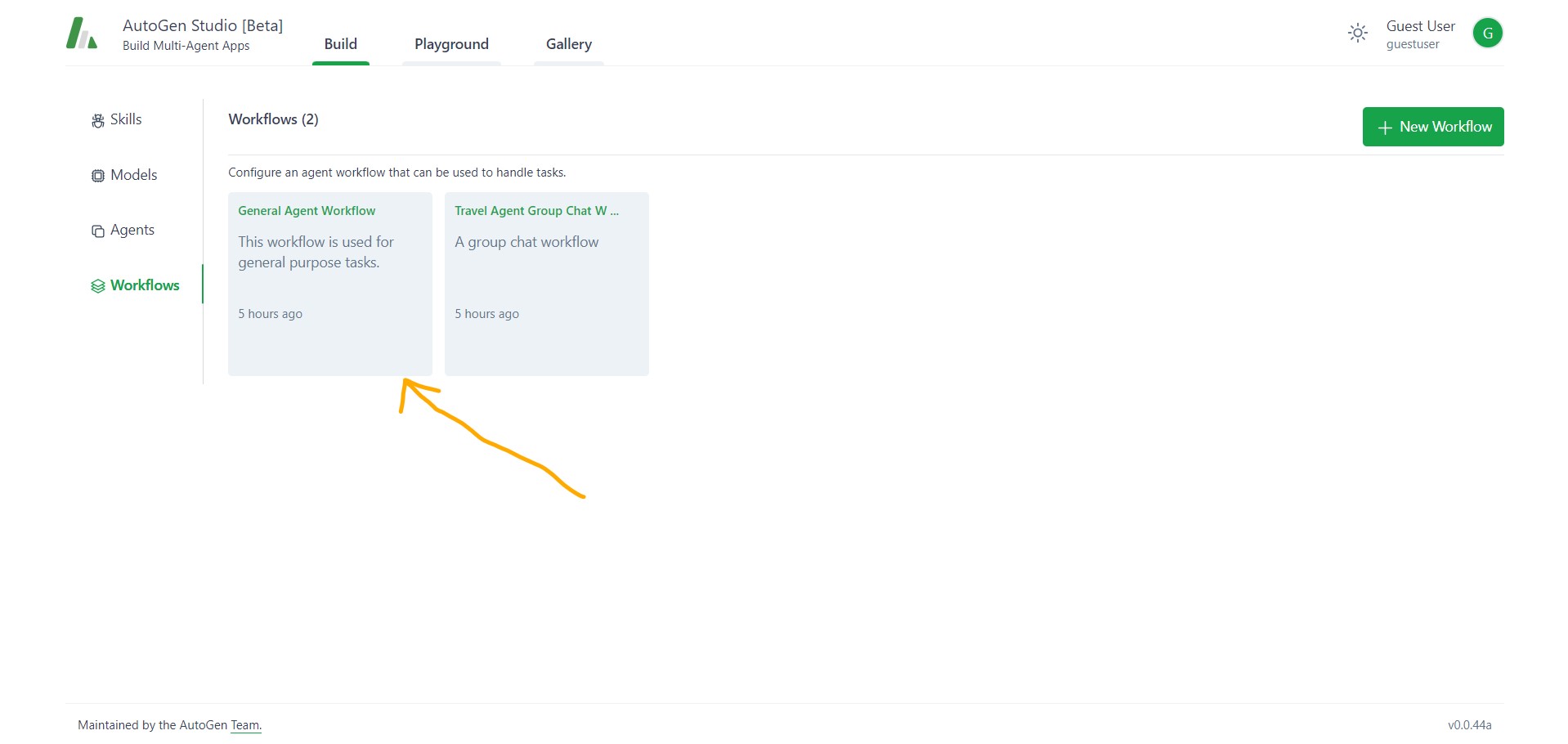

Configureer een agentworkflow die kan worden gebruikt om taken af te handelen.

- Navigeer naar workflow sectie en klik op Algemene agentworkflow

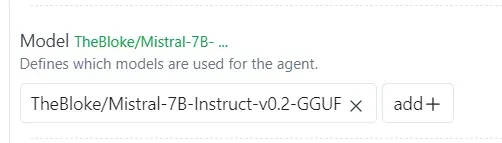

- Klik op de user_proxy-agent en klik op "Toevoegen" onder het modelgedeelte en kies het model dat u wilt gebruiken in de vervolgkeuzelijst.

- Volg dezelfde stappen voor de primaire_assistent. Zorg ervoor dat de naam van het door u gekozen model in groene kleur naast het modelgedeelte wordt weergegeven. Klik ten slotte nogmaals op “OK” om te bevestigen.

Voorbeeldgebruik

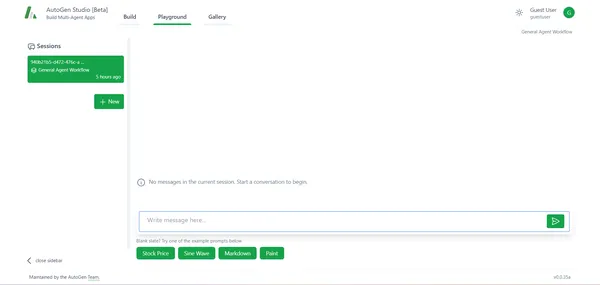

Klik op het speeltuingedeelte en maak een nieuw gedeelte door op de knop "nieuw" te klikken

Kies de algemene agentworkflow en druk op de knop Maken

Wanneer de sessie succesvol is aangemaakt. Voer nu de query uit en druk op de verzendknop

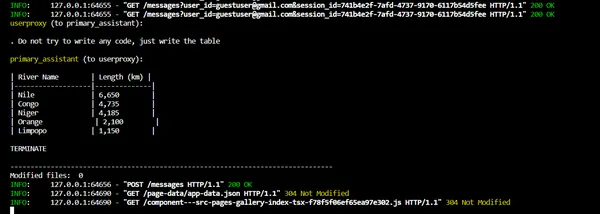

Overweeg nu deze vraag: Maak een lijst van de vijf belangrijkste rivieren in Afrika en hun lengte, en geef dat weer als afprijstabel. Probeer geen code te schrijven, maar schrijf gewoon de tabel.

Web-UI-logboek voor het genereren van tekst

Om te verifiëren dat LLM output begint te genereren, kunt u na een paar minuten in de log in Text-generation-webui zien dat de tokens worden gegenereerd. Dit bewijst dat autogen UI LLM gebruikt via Text-generation-webui.

Autogen Studio Inloggen Terminal

Resultaat

Stapsgewijze handleiding voor het implementeren van AutoGen Studio met LM Studio

LM Studio, een baanbrekend project, loopt voorop en zorgt ervoor dat gebruikers naadloos kunnen communiceren met open-source LLM's. Deze tool is ontwikkeld rond de llama.cpp-bibliotheek en vergemakkelijkt de installatie, het beheer en het gebruik van verschillende LLM's op desktopomgevingen.

Stap 1: Download LM Studio

Navigeer naar de officiële LM Studio-website (https://lmstudio.ai/) en kies de versie die compatibel is met uw besturingssysteem (Windows, Mac of Linux). Klik op de downloadlink om het downloadproces te starten.

Stap 2: Zoek en kies een model

Zoek de zoekbalk in het midden van het hoofdscherm. Voer trefwoorden of een specifieke modelnaam in om de beschikbare opties te verkennen. Kies een model dat aansluit bij uw verkenningsdoelen.

Stap 3: Start de lokale server

Lokale server – Zoek het pictogram met de dubbele pijl aan de linkerkant, klik erop en start de lokale server.

Kopieer de basis-URL en plak deze in autogen studio.

Stap 4: Autogen Studio uitvoeren

De volgende stap is het installeren van AutoGen Studio. Voor een soepele ervaring raad ik aan een virtuele omgeving (bijvoorbeeld conda) te gebruiken om conflicten met bestaande Python-pakketten te voorkomen. Met Python 3.10 of nieuwer actief in uw virtuele omgeving, gebruikt u de volgende pip-opdracht:

pip install autogenstudioautogenstudio ui --port 8080uitvoerserver_autogenstudio.log

INFO: Started server process [11050]

INFO: Waiting for application startup.

INFO: Application startup complete.

INFO: Uvicorn running on http://127.0.0.1:8080 (Press CTRL+C to quit)Stap 5: Een LLM-provider instellen in Autogen UI

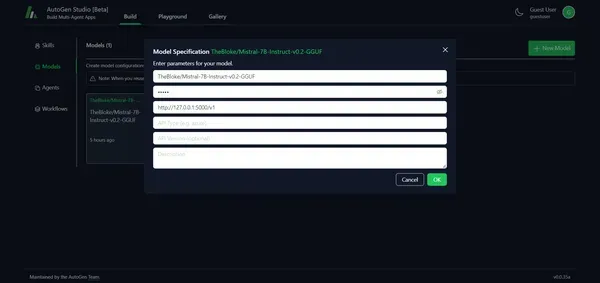

- Navigeer in de gebruikersinterface van AutoGen Studio naar de bovenkant en zoek het gedeelte 'Build'. Klik erop en kies vervolgens "Model"

- Klik op “Nieuw model” om een nieuw model in te voegen. Voer de modelnaam, basis-URL (plak de OpenAI-compatibele API-URL die u hebt gekopieerd.) Bijvoorbeeld http://0.0.0.0:5000/v1) en stel de API-sleutel in als “NoApi (typ een willekeurige tekenreeks, laat deze niet leeg).

- Als u klaar bent, klikt u op 'OK'.

Stap 6: De workflow instellen

Configureer een agentworkflow die kan worden gebruikt om taken af te handelen.

- Navigeer naar workflow sectie en klik op Algemene agentworkflow

- Klik op de user_proxy-agent en klik op "Toevoegen" onder het modelgedeelte en kies het model dat u wilt gebruiken in de vervolgkeuzelijst.

Belangrijke tip: Stel ook de Human Input Mode in op “ALWAYS” (anders krijg je geen output in autogen studio)

- Volg dezelfde stappen voor de primaire_assistent. Zorg ervoor dat de naam van het door u gekozen model in groene kleur naast het modelgedeelte wordt weergegeven. Klik ten slotte nogmaals op “OK” om te bevestigen.

Voorbeeldgebruik

Denk nu eens na over deze vraag: maak een lijst van de vijf belangrijkste rivieren in Afrika en hun lengte, en retourneer dat als een afprijstabel. Probeer geen code te schrijven, maar schrijf gewoon de tabel.

Klik op het speeltuingedeelte en maak een nieuw gedeelte door op de knop "nieuw" te klikken

Kies de algemene agentworkflow en druk op de knop Maken

Wanneer de sessie succesvol is aangemaakt. Voer nu de query uit en druk op de verzendknop.

Belangrijk: Zodra u een taak in autogen studio in de speeltuinsectie hebt opgegeven, gaat u naar de autogen studio-terminal en daar ziet u dit 'Geef feedback aan de gebruikersproxy. Druk op enter om over te slaan en automatisch antwoord te gebruiken, of typ 'exit' om het gesprek te beëindigen:”. druk nu op "Enter".

LM Studio-logboeken

Om te verifiëren dat LLM output begint te genereren, kunt u in de log in LM Studio zien dat de tokens worden gegenereerd. Dit bewijst dat autogen UI LLM gebruikt via LM Studio.

AutoGen Studio-logboek

Resultaat

Conclusie

Concluderend komt AutoGen Studio naar voren als een krachtig hulpmiddel voor het ontwikkelen van en communiceren met AI-agenten. Door het te combineren met gratis alternatieven zoals Text Generation Web UI en LM Studio, kunnen gebruikers de functionaliteiten uitbreiden en verschillende taalmodellen lokaal verkennen. Deze gids voorziet u van de kennis om het potentieel van AutoGen Studio te benutten naast alternatieve tools, en opent deuren naar innovatieve AI-toepassingen.

Key Takeaways

- AutoGen Studio vereenvoudigt de ontwikkeling van AI-agents via een intuïtieve gebruikersinterface.

- De secties Playground en Gallery in AutoGen Studio bieden virtuele ruimtes voor interactie en samenwerking.

- Door de Text Generation Web UI te installeren en in te stellen, kunt u lokale tekst genereren met behulp van verschillende taalmodellen.

- LM Studio maakt de naadloze integratie van open-source taalmodellen voor diverse toepassingen mogelijk.

- De integratie van AutoGen Studio met alternatieve tools biedt flexibiliteit en breidt de mogelijkheden van AI-ontwikkeling uit.

Veelgestelde Vragen / FAQ

A. AutoGen Studio onderscheidt zich door zijn gebruiksvriendelijke interface, waarmee u moeiteloos AI-agents kunt prototypen en verbeteren. Het intuïtieve ontwerp elimineert de noodzaak van complexe codering, waardoor het toegankelijk is voor zowel beginners als doorgewinterde ontwikkelaars.

A. Het installeren van AutoGen Studio is een fluitje van een cent. Gebruik eenvoudigweg de aanbevolen pip-opdracht binnen een virtuele omgeving, zodat u verzekerd bent van een soepele ervaring. Het proces is goed gedocumenteerd, waardoor het toegankelijk is voor gebruikers met verschillende niveaus van technische expertise.

A. Absoluut! Door de beschreven stappen te volgen, kunt u de Text Generation Web UI naadloos integreren met AutoGen Studio. Deze combinatie opent een wereld aan mogelijkheden voor taken variërend van creatief schrijven tot het ontwikkelen van chatbots.

A. LM Studio is een project dat de interactie met open-source taalmodellen vereenvoudigt. Indien geïntegreerd met AutoGen Studio.

De in dit artikel getoonde media zijn geen eigendom van Analytics Vidhya en worden naar goeddunken van de auteur gebruikt.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://www.analyticsvidhya.com/blog/2024/02/how-to-use-autogen-studio-locally-using-lm-studio-or-text-generation-web-ui/