Ik schreef eerder dat het debat over welke CPU de wereld regeert (Arm versus RISC-V) in moderne systemen enigszins door de bomen het bos mist. Dit is nergens duidelijker dan bij intelligente audio en visie: slimme deurbellen, luidsprekers, stemgestuurde afstandsbedieningen, intelligente oordopjes, het vermijden van botsingen in auto's, zelfparkeren en een miljoen andere toepassingen. Geen van deze zou mogelijk zijn door simpelweg een CPU of zelfs een reeks CPU's rechtstreeks op een AI-engine aan te sluiten. CPU's spelen een belangrijke administratieve rol, maar op audio en vision gebaseerde, op intelligentie gebaseerde systemen zijn afhankelijk van complexe pijplijnen van signaalverwerking rondom de AI-kern. Het bouwen van deze pijplijnen kan de productontwikkeling in zeer competitieve markten echter aanzienlijk ingewikkelder maken en risico's met zich meebrengen.

Wat is een AI-pijplijn?

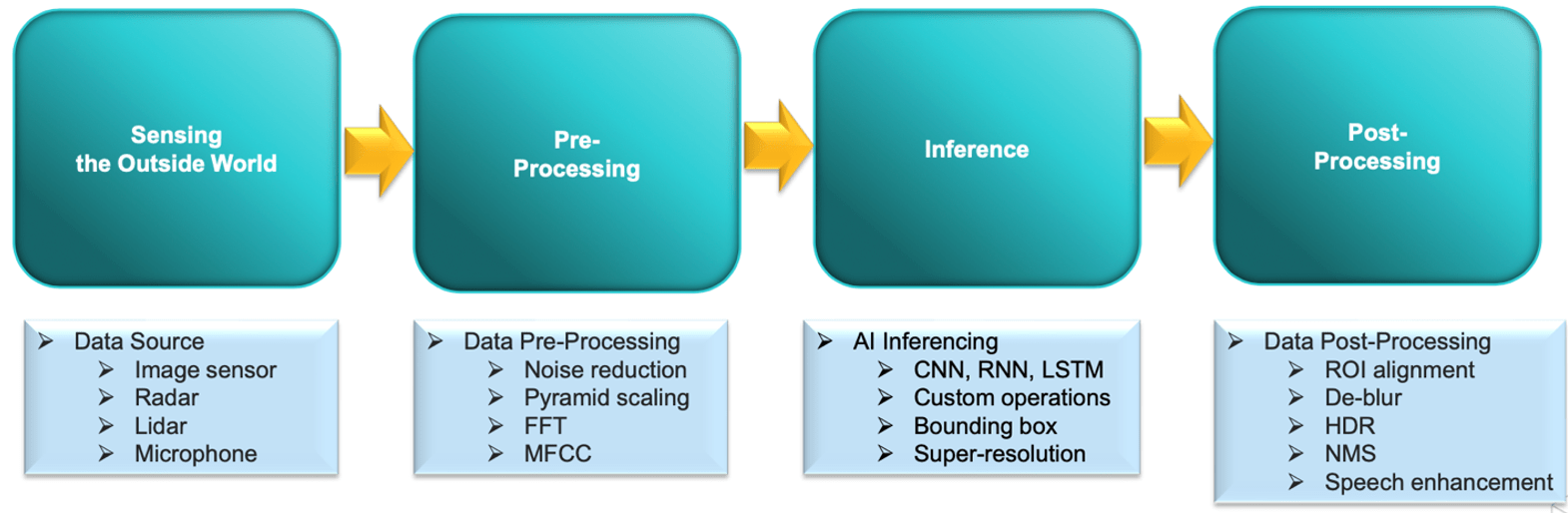

Audiomonsters zijn eendimensionale, continu variërende signalen, beeldsignalen zijn vergelijkbaar maar tweedimensionaal. Na ruisonderdrukking moeten ze allemaal op zijn minst worden geschaald naar een vorm die compatibel is met de monsters waarop het AI-model is getraind. Een afbeelding kan bijvoorbeeld worden verkleind tot grijstinten, omdat kleur aanzienlijk bijdraagt aan de kosten voor training en gevolgtrekking. Een audiosignaal kan worden gefilterd om lage en hoge frequentiebanden te elimineren. Om vergelijkbare redenen wordt het signaalbereik aangepast en gemiddeld. Al deze stappen kunnen eenvoudig worden afgehandeld door software die op een DSP draait.

Dit niveau van voorverwerking is eenvoudig. Pulin Desai (Productmarketing en management voor Tensilica vison, radar, lidar en communicatie DSP's bij Cadence) liet me kennismaken met een paar recente ontwikkelingen die een hogere nauwkeurigheid bevorderen. Spraakherkenning maakt bijvoorbeeld gebruik van een techniek genaamd MFCC om kenmerken uit spraak te extraheren die als directer bepalend worden beschouwd dan een eenvoudige audiogolf. Nog een voorbeeld: ruisonderdrukking voegt nu intelligentie toe ter ondersteuning van spraakopdrachten die spraak op de achtergrondmuziek overschrijven of om ervoor te zorgen dat u noodsirenes niet mist. Beide gevallen worden bestuurd door signaalverwerking, soms met een vleugje AI.

Opkomende visietransformers met wereldwijde herkenningssterktes zijn nu hot en gaan over op multischaalgebaseerde beeldherkenning, waarbij een beeld wordt opgesplitst in een piramide van geleidelijk verkleinde beelden met een lagere resolutie. Er zijn meer mogelijkheden voor pre-inferentie en dan zal (uiteindelijk) de daadwerkelijke inferentiestap (CNN, transformator of andere opties) worden uitgevoerd. Na de gevolgtrekking moeten de nabewerkingsstappen worden geactiveerd; deze kunnen niet-maximale onderdrukking (NMS), beeldverscherping of spraakverbetering omvatten. Mogelijk voert de pijplijn zelfs een extra gevolgtrekkingsstap uit voor classificatie. Het is duidelijk waarom zo'n proces wordt gezien als een pijplijn: vele stappen vanaf een origineel beeld of geluid, meestal signaalverwerking die wordt uitgevoerd via software die op DSP's draait.

Net zoals AI-modellen blijven evolueren, blijven pijplijnalgoritmen evolueren. Voor een product-OEM moet het mogelijk zijn om deze complexe pijpleidingen te ontwikkelen en te onderhouden, zodat deze binnen bijvoorbeeld 18-24 maanden op de markt kunnen worden gebracht en de producten concurrerend kunnen blijven gedurende een productlevensduur van 5 jaar of langer. Kortom, OEM's hebben vereenvoudiging en versnelling nodig bij het ontwikkelen en onderhouden van DSP-software om deze doelen te bereiken.

Het stroomlijnen van de ontwikkelingsstroom

Het Tensilica-portfolio wordt al ondersteund door een uitgebreid partnerschapsecosysteem op het gebied van audio, spraak en beeld, dat een groot deel van de hulp zou moeten bieden die nodig is bij het invullen van een pijplijnimplementatie. Uiteraard zullen OEM's waar nodig selectief willen differentiëren via hun eigen algoritmen, en hier worden recente ontwikkelingen bijzonder belangrijk.

De eerste en meest opvallende is auto-vectorisatie. U schrijft software voor een DSP op vrijwel dezelfde manier waarop u software voor een CPU schrijft, behalve waar u optimaal gebruik kunt maken van de DSP om brede vectorberekeningen te versnellen. Voorheen vereiste het schrijven van software om deze mogelijkheid volledig te benutten speciale expertise op het gebied van handmatige codering voor vectorisatie, waardoor een knelpunt ontstond bij de ontwikkeling en upgrades.

Auto-vectorisatie heeft tot doel deze taak te automatiseren. Prakash Madhvapathy (directeur productmarketing en management voor Tensilica audio/voice DSP's bij Cadence) vertelt me dat er enkele richtlijnen zijn die de ontwikkelaar moet volgen om deze drukknop te maken, maar code die volgens deze richtlijnen is geschreven, werkt even goed (hoewel langzamer) op een CPU . Ze hebben tests uitgevoerd met een verscheidenheid aan industriestandaardtoepassingen en hebben ontdekt dat de compiler net zo goed presteert als handgecodeerde software. Auto-vectorisatie maakt de ontwikkeling van DSP-algoritmen dus toegankelijk voor een breder publiek om knelpunten in de ontwikkeling te helpen verminderen.

De volgende belangrijke verbetering ondersteunt waar nodig drijvende-komma met dubbele precisie. Dubbele precisie lijkt misschien overdreven voor edge-toepassingen, maar nieuwere algoritmen zoals MFCC en softmax gebruiken nu functies zoals exponentiële waarden en logs die single-point floats snel overlopen/onderlopen. Double point helpt de nauwkeurigheid te behouden, waardoor een ontwikkelaar speciale handelingen kan vermijden bij het overzetten van op datacenters gebaseerde softwareontwikkelingsplatforms.

Een andere belangrijke verbetering is de ondersteuning voor 40-bits adressen in de iDMA, waardoor het systeem maximaal 1TB geheugen rechtstreeks kan adresseren zonder dat de ontwikkelaar adresverschuivingen via speciale code hoeft te beheren. Klinkt als veel geheugen voor een edge-apparaat, maar u hoeft alleen maar naar toepassingen in de automobielsector te kijken om te beseffen dat dergelijke afmetingen in sommige toepassingen gebruikelijk worden. Het bredere adresbereik biedt ook meer vereenvoudiging bij het porten vanaf datacenterplatforms.

Productverbeteringen en beschikbaarheid

Alle bestaande DSP's zijn geporteerd naar het Tensilica Xtensa LX8-platform dat alle bovengenoemde ontwikkelingen ondersteunt, samen met een L2-cache-optie, verbeterde vertakkingsvoorspelling waarbij wordt erkend dat gemengde besturing en vectorcode steeds gebruikelijker worden, directe AXI4-verbinding met elke kern en uitgebreide interrupt steun.

Cadence heeft onlangs twee nieuwe Tensilica audio DSP's (HiFi 1s en HiFi 5s) en twee nieuwe vision DSP's (Vision 110 en Vision 130) uitgebracht, allemaal voortbouwend op het LX8-platform. Deze omvatten verschillende verbeteringen op het gebied van prestaties en kracht, maar ik wil me hier vooral concentreren op verbeteringen om de softwareontwikkeling te vereenvoudigen en te versnellen.

De Vision 130/100 DSP's ondersteunen on-the-fly decompressie, zoals vermeld in een eerdere blog. Voeg daar nog een hogere fmax, hogere drijvende-kommaprestaties, snellere FFT's en ondersteuning voor drijvende-kommacomplextypen aan toe, wat in totaal tot 5x prestatieverbeteringen oplevert op standaard DSP-benchmarks en tot 3.5x verbetering op AI-benchmarks. Deze nieuwe Vision-processors zijn nu verkrijgbaar.

De audio HiFi 1s en 5s DSP's leveren tot 35x verbetering op XCLIB-functies met dubbele precisie, 5-15% codec-prestaties door verbeterde vertakkingsvoorspelling en tot 50% verbeterde prestaties dankzij de L2-cache. Deze nieuwe DSP-processors zullen naar verwachting in december 2023 beschikbaar zijn. (Ik moet hieraan toevoegen dat HiFi 1s, hoewel een audio-DSP, voldoende capaciteit heeft om ook video-wake-up met ultralaag vermogen aan te kunnen. Best gaaf!)

U kunt meer leren over HiFi DSP's HIER en Vision DSP's HIER. Kijk ook eens naar a wit papier over het belang van DSP’s in onze dappere nieuwe AI-wereld.

Lees ook:

Nieuwe STA-functies van Cadence

Effectieve gemengde signaalmodellen ontwikkelen. Innovatie in verificatie

Beweringsynthese via LLM. Innovatie in verificatie

Deel dit bericht via:

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://semiwiki.com/artificial-intelligence/337575-accelerating-development-for-audio-and-vision-ai-pipelines/