Uw contactcenter fungeert als de essentiële schakel tussen uw bedrijf en uw klanten. Elk telefoontje naar uw contactcenter is een kans om meer te weten te komen over de behoeften van uw klanten en hoe goed u aan die behoeften voldoet.

De meeste contactcenters vereisen dat hun agenten na elk gesprek hun gesprek samenvatten. Het samenvatten van gesprekken is een waardevol hulpmiddel waarmee contactcenters klantgesprekken kunnen begrijpen en er inzichten uit kunnen verkrijgen. Bovendien verbeteren nauwkeurige gesprekssamenvattingen het klanttraject, doordat klanten niet meer informatie hoeven te herhalen wanneer ze worden doorverbonden met een andere agent.

In dit bericht leggen we uit hoe u de kracht van generatieve AI kunt gebruiken om de inspanning te verminderen en de nauwkeurigheid van het maken van oproepsamenvattingen en oproepafspraken te verbeteren. We laten ook zien hoe u snel aan de slag kunt met de nieuwste versie van onze open source-oplossing, Live gespreksanalyse met Agent Assist.

De nieuwste beste AI-tools kan uw contactcenter een boost geven. Deze innovatieve oplossingen verbeteren het samenvatten van oproepen en het beheer van de afhandeling in de klantenservice. Blijf de contactcentertechnologie een stap voor met deze AI-aangedreven producten die de bedrijfsvoering en klantervaringen verbeteren.

Uitdagingen met gespreksoverzichten

Naarmate contactcenters meer spraakgegevens verzamelen, is de behoefte aan efficiënte gesprekssamenvatting aanzienlijk toegenomen. De meeste samenvattingen zijn echter leeg of onnauwkeurig, omdat het handmatig maken ervan tijdrovend is en gevolgen heeft voor de belangrijkste statistieken van agenten, zoals de gemiddelde verwerkingstijd (AHT). Agenten melden dat het samenvatten tot een derde van het totale gesprek kan duren, dus slaan ze dit over of vullen ze onvolledige informatie in. Dit schaadt de klantervaring; klanten worden langdurig gefrustreerd terwijl de agent typt, en onvolledige samenvattingen betekenen dat klanten moeten worden gevraagd informatie te herhalen wanneer deze tussen agenten wordt overgedragen.

Het goede nieuws is dat het automatiseren en oplossen van de samenvattingsuitdaging nu mogelijk is via generatieve AI.

Genatieve AI helpt klantgesprekken nauwkeurig en efficiënt samen te vatten

generatieve AI wordt mogelijk gemaakt door zeer grote machine learning-modellen (ML), ook wel foundation models (FM's) genoemd, die vooraf zijn getraind in grote hoeveelheden gegevens op schaal. Een subset van deze FM's gericht op het begrijpen van natuurlijke taal worden grote taalmodellen (LLM's) genoemd en zijn in staat mensachtige, contextueel relevante samenvattingen te genereren. De beste LLM's kunnen zelfs complexe, niet-lineaire zinsstructuren met gemak verwerken en verschillende aspecten bepalen, waaronder onderwerp, bedoeling, volgende stappen, resultaten en meer. Door LLM's te gebruiken om de samenvatting van gesprekken te automatiseren, kunnen klantgesprekken nauwkeurig worden samengevat en in een fractie van de tijd die nodig is voor handmatige samenvatting. Hierdoor kunnen contactcenters een superieure klantervaring bieden en tegelijkertijd de documentatielast voor hun agenten verminderen.

De volgende schermafbeelding toont een voorbeeld van de pagina Live Call Analytics met Agent Assist-oproepdetails, die informatie over elk gesprek bevat.

De volgende video toont een voorbeeld van Live Call Analytics met Agent Assist, waarin een lopend gesprek wordt samengevat, nadat het gesprek is beëindigd en een vervolg-e-mail wordt gegenereerd.

Overzicht oplossingen

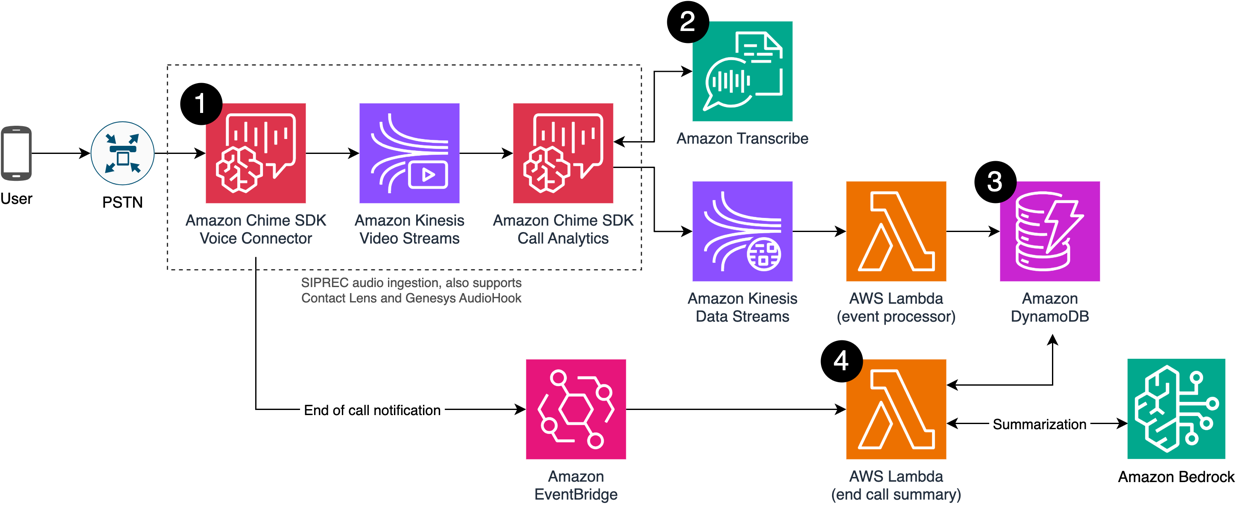

Het volgende diagram illustreert de workflow van de oplossing.

De eerste stap bij het genereren van abstracte gesprekssamenvattingen is het transcriberen van het klantgesprek. Het hebben van nauwkeurige, gebruiksklare transcripties is van cruciaal belang voor het genereren van nauwkeurige en effectieve gesprekssamenvattingen. Amazon Transcribe kan u helpen transcripties met hoge nauwkeurigheid te maken voor uw contactcentergesprekken. Amazon Transcribe is een functierijke spraak-naar-tekst-API met ultramoderne spraakherkenningsmodellen die volledig worden beheerd en voortdurend worden getraind. Klanten zoals New York Times, Slack, Zillow, Wix, en duizenden anderen gebruiken Amazon Transcribe om zeer nauwkeurige transcripties te genereren om hun bedrijfsresultaten te verbeteren. Een belangrijke onderscheidende factor voor Amazon Transcribe is het vermogen om klantgegevens te beschermen door gevoelige informatie uit de audio en tekst te redigeren. Hoewel het beschermen van de privacy en veiligheid van klanten over het algemeen belangrijk is voor contactcenters, is het zelfs nog belangrijker om gevoelige informatie, zoals bankrekeninggegevens en burgerservicenummers, te maskeren voordat u geautomatiseerde gespreksoverzichten genereert, zodat deze niet in de overzichten worden geïnjecteerd.

Voor klanten die al gebruik maken van Amazon Connect, ons omnichannel cloud-contactcentrum, Contactlens voor Amazon Connect biedt native realtime transcriptie- en analysefuncties. Als u echter generatieve AI wilt gebruiken met uw bestaande contactcenter, hebben wij dit ontwikkeld solutions die het grootste deel van het zware werk doen dat gepaard gaat met het in realtime of na een gesprek transcriberen van gesprekken vanuit uw bestaande contactcentrum, en het genereren van geautomatiseerde gesprekssamenvattingen met behulp van generatieve AI. Bovendien kunt u met de oplossing die in deze sectie wordt beschreven dat ook doen te integreren met uw Customer Relationship Management (CRM)-systeem om uw CRM naar keuze automatisch bij te werken met gegenereerde gespreksoverzichten. In dit voorbeeld gebruiken we onze Live oproepanalyse met Agent Assist (LCA)-oplossing om real-time oproeptranscripties en oproepsamenvattingen te genereren waarop LLM's worden gehost Amazonebodem. Je kunt ook een schrijven AWS Lambda functie en geef LCA de Amazon Resource Name (ARN) van de functie op in de AWS CloudFormatie parameters en gebruik de LLM van uw keuze.

De volgende vereenvoudigde LCA-architectuur illustreert de samenvatting van oproepen met Amazon Bedrock.

LCA wordt geleverd als een CloudFormation-sjabloon die de voorgaande architectuur implementeert en waarmee u gesprekken in realtime kunt transcriberen. De workflowstappen zijn als volgt:

- Gespreksaudio kan via SIPREC vanaf uw telefoonsysteem worden gestreamd naar Amazon Chime SDK Voice Connector, die de audio buffert in Amazon Kinesis-videostreams. LCA ondersteunt ook andere mechanismen voor audio-opname, zoals Genesys Cloud Audiohook.

- Amazon Chime SDK Call Analytics streamt vervolgens de audio van Kinesis Video Streams naar Amazon Transcribe en schrijft de JSON-uitvoer naar Amazon Kinesis-gegevensstromen.

- Een Lambda-functie verwerkt de transcriptiesegmenten en zet ze voort in een Amazon DynamoDB tafel.

- Nadat het gesprek is beëindigd, publiceert Amazon Chime SDK Voice Connector een Amazon EventBridge melding die een Lambda-functie activeert die het persistente transcript van DynamoDB leest, een LLM-prompt genereert (meer hierover in de volgende sectie) en een LLM-gevolgtrekking uitvoert met Amazon Bedrock. De gegenereerde samenvatting wordt bewaard in DynamoDB en kan door de agent worden gebruikt in de LCA-gebruikersinterface. U kunt optioneel een Lambda-functie ARN opgeven die wordt uitgevoerd nadat de samenvatting is gegenereerd om te integreren met CRM-systemen van derden.

LCA biedt ook de mogelijkheid om de samenvattings-Lambda-functie aan te roepen tijdens de oproep, omdat op elk moment de transcriptie kan worden opgehaald en een prompt kan worden gemaakt, zelfs als de oproep bezig is. Dit kan handig zijn wanneer een gesprek wordt doorverbonden naar een andere agent of wordt geëscaleerd naar een supervisor. In plaats van de klant in de wacht te zetten en het gesprek uit te leggen, kan de nieuwe agent snel een automatisch gegenereerde samenvatting lezen, waarin kan worden vermeld wat het huidige probleem is en wat de vorige agent heeft geprobeerd te doen om het op te lossen.

Voorbeeld van oproepsamenvattingsprompt

U kunt LLM-gevolgtrekkingen uitvoeren met snelle engineering om uw oproepsamenvattingen te genereren en te verbeteren. U kunt de promptsjablonen aanpassen om te zien wat het beste werkt voor de LLM die u selecteert. Hieronder volgt een voorbeeld van de standaardprompt voor het samenvatten van een transcript met LCA. Wij vervangen de {transcript} tijdelijke aanduiding met het daadwerkelijke transcript van het gesprek.

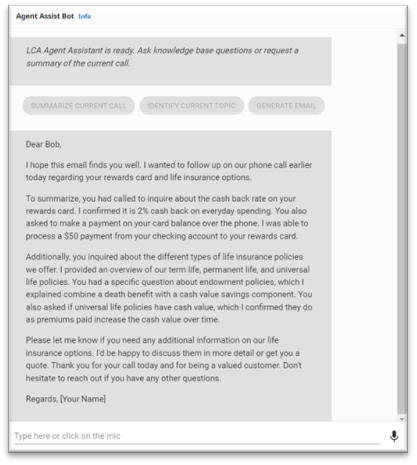

LCA voert de prompt uit en slaat de gegenereerde samenvatting op. Naast samenvattingen kunt u de LLM opdracht geven vrijwel elke tekst te genereren die belangrijk is voor de productiviteit van agenten. U kunt bijvoorbeeld kiezen uit een reeks onderwerpen die tijdens het gesprek aan bod zijn gekomen (beschikking van de agent), een lijst met vereiste vervolgtaken genereren of zelfs een e-mail naar de beller schrijven waarin u hem of haar bedankt voor het gesprek.

De volgende schermafbeelding is een voorbeeld van het genereren van vervolg-e-mail door agenten in de LCA-gebruikersinterface.

Met een goed ontworpen prompt kunnen sommige LLM's al deze informatie ook in één enkele gevolgtrekking genereren, waardoor de gevolgtrekkingskosten en verwerkingstijd worden verminderd. De agent kan het gegenereerde antwoord vervolgens binnen enkele seconden na het beëindigen van het gesprek gebruiken voor zijn of haar na-contactwerk. U kunt het gegenereerde antwoord ook integreren automatisch in uw CRM-systeem.

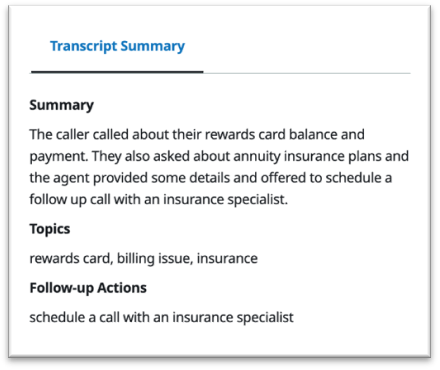

De volgende schermafbeelding toont een voorbeeldoverzicht in de LCA-gebruikersinterface.

Het is ook mogelijk om een samenvatting te genereren terwijl het gesprek nog gaande is (zie de volgende schermafbeelding), wat vooral handig kan zijn bij lange klantgesprekken.

Voorafgaand aan generatieve AI zouden agenten moeten opletten, terwijl ze ook aantekeningen zouden maken en indien nodig andere taken moesten uitvoeren. Door het gesprek automatisch te transcriberen en LLM's te gebruiken om automatisch samenvattingen te maken, kunnen we de mentale last voor de agent verlagen, zodat deze zich kan concentreren op het leveren van een superieure klantervaring. Dit leidt ook tot nauwkeuriger werk na het gesprek, omdat de transcriptie een nauwkeurige weergave is van wat er tijdens het gesprek is gebeurd, en niet alleen van wat de agent aantekeningen heeft gemaakt of zich heeft herinnerd.

Samengevat

De voorbeeld-LCA-applicatie wordt geleverd als open source. Gebruik deze als uitgangspunt voor uw eigen oplossing en help ons deze te verbeteren door back-fixes en functies aan te dragen via GitHub-pull-verzoeken. Voor informatie over het implementeren van LCA raadpleegt u Live oproepanalyse en assistentie van agenten voor uw contactcentrum met AI-diensten in Amazon-taal. Blader naar de LCA GitHub-repository om de code te verkennen, meld je aan om op de hoogte te worden gehouden van nieuwe releases en bekijk de README voor de nieuwste documentatie-updates. Voor klanten die al Amazon Connect gebruiken, kunt u meer leren over generatieve AI met Amazon Connect door te verwijzen naar Hoe leiders van contactcenters zich kunnen voorbereiden op generatieve AI.

Over de auteurs

Christoffel Lott is een Senior Solutions Architect in het AWS AI Language Services-team. Hij heeft 20 jaar ervaring in de ontwikkeling van bedrijfssoftware. Chris woont in Sacramento, Californië en houdt van tuinieren, ruimtevaart en reizen over de hele wereld.

Christoffel Lott is een Senior Solutions Architect in het AWS AI Language Services-team. Hij heeft 20 jaar ervaring in de ontwikkeling van bedrijfssoftware. Chris woont in Sacramento, Californië en houdt van tuinieren, ruimtevaart en reizen over de hele wereld.

Smriti Ranjan is een Principal Product Manager in het AWS AI/ML-team dat zich richt op taal- en zoekdiensten. Voordat ze bij AWS kwam, werkte ze bij Amazon Devices en andere technologie-startups waar ze product- en groeifuncties leidde. Smriti woont in Boston, Massachusetts en houdt van wandelen, concerten bijwonen en de wereld rondreizen.

Smriti Ranjan is een Principal Product Manager in het AWS AI/ML-team dat zich richt op taal- en zoekdiensten. Voordat ze bij AWS kwam, werkte ze bij Amazon Devices en andere technologie-startups waar ze product- en groeifuncties leidde. Smriti woont in Boston, Massachusetts en houdt van wandelen, concerten bijwonen en de wereld rondreizen.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/use-generative-ai-to-increase-agent-productivity-through-automated-call-summarization/