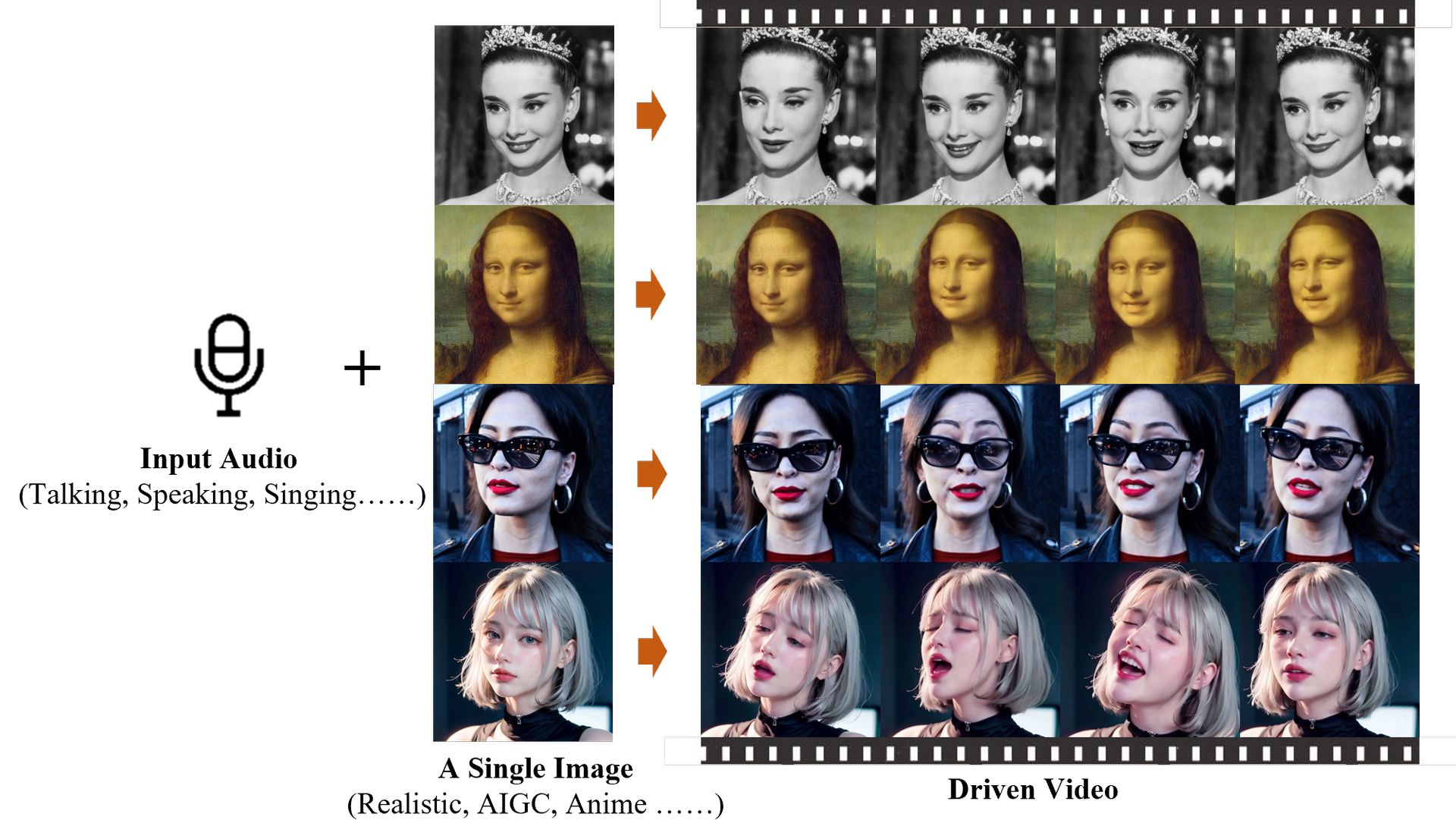

Haben Sie sich jemals gewünscht, dass Ihre Fotos sprechen oder singen könnten? Lernen Sie EMO kennen, die Abkürzung für Emote Portrait Alive. EMO wurde von Forschern des Alibaba Institute for Intelligent Computing entwickelt und ist ein künstliches Intelligenzsystem, das genau zu diesem Zweck entwickelt wurde.

EMO verfolgt einen einzigartigen Animationsansatz und umgeht komplexe 3D-Modelle, indem es Audio direkt in Videobilder umwandelt. Das bedeutet, dass Ihre animierten Videos die natürlichen Bewegungen und Ausdrücke von Sprache oder Gesang beibehalten, und zwar alles aus einem einzigen Foto und Audioclip.

Alibaba AI: Was ist Emote Portrait Alive (EMO)?

EMO oder Emote Portrait Alive ist ein künstliches Intelligenzsystem, das von Forschern des Alibaba Institute for Intelligent Computing entwickelt wurde. Seine Hauptfunktion besteht darin, Animieren Sie statische PorträtfotosErstellen Sie Videos, in denen die Person realistisch zu sprechen oder zu singen scheint.

Was EMO auszeichnet, ist sein Ansatz zur Generierung dieser Animationen. Anstatt sich auf herkömmliche Methoden zu verlassen, die oft Schwierigkeiten haben, die Nuancen des menschlichen Ausdrucks zu erfassen, wandelt EMO Audiowellenformen direkt in Videobilder um. Das bedeutet, dass zum Generieren von Animationen keine 3D-Zwischenmodelle oder Gesichtsmarkierungen erforderlich sind. Stattdessen konzentriert es sich auf die Erfassung subtiler Gesichtsbewegungen und individueller Gesichtsstile, die mit natürlicher Sprache verbunden sind.

Gerade dabei 👀

Das ist das erstaunlichste Audio2Video, das ich je gesehen habe.

Es heißt EMO: Emote Portrait Alive pic.twitter.com/3b1AQMzPYu— Stelfie der Zeitreisende (@StelfieTT) 28. Februar 2024

Die Technologie hinter EMO basiert auf einem Diffusionsmodell, das für seine Fähigkeit bekannt ist, realistische synthetische Bilder zu erzeugen. Um das System zu trainieren, nutzten die Forscher einen großen Datensatz von Talking-Head-Videos aus verschiedenen Quellen, darunter Reden, Filme, Fernsehsendungen und Musikdarbietungen. Diese umfassende Schulung ermöglicht es EMO, qualitativ hochwertige Videos zu produzieren und dabei die Identität des Themas zu bewahren und Ausdruckskraft zu vermitteln.

Neben der Erstellung von Konversationsvideos kann EMO auch Gesangsporträts animieren. Durch die Synchronisierung von Mundformen und Gesichtsausdrücken mit dem Gesang können Gesangsvideos in unterschiedlichen Stilrichtungen und unterschiedlicher Dauer erstellt werden.

Während die Entwicklung von EMO spannende Möglichkeiten für die Erstellung personalisierter Videoinhalte bietet, wirft sie auch ethische Bedenken auf. Es besteht die Gefahr von Missbrauch, z Identitätswechsel oder die Verbreitung von Fehlinformation. Daher ist es wichtig, den Einsatz dieser Technologie mit Vorsicht anzugehen und sicherzustellen, dass geeignete Schutzmaßnahmen vorhanden sind, um diese ethischen Bedenken auszuräumen.

Pika Lip Sync bringt auch KI-generierte Videos zum Sprechen

Wie funktioniert EMO?

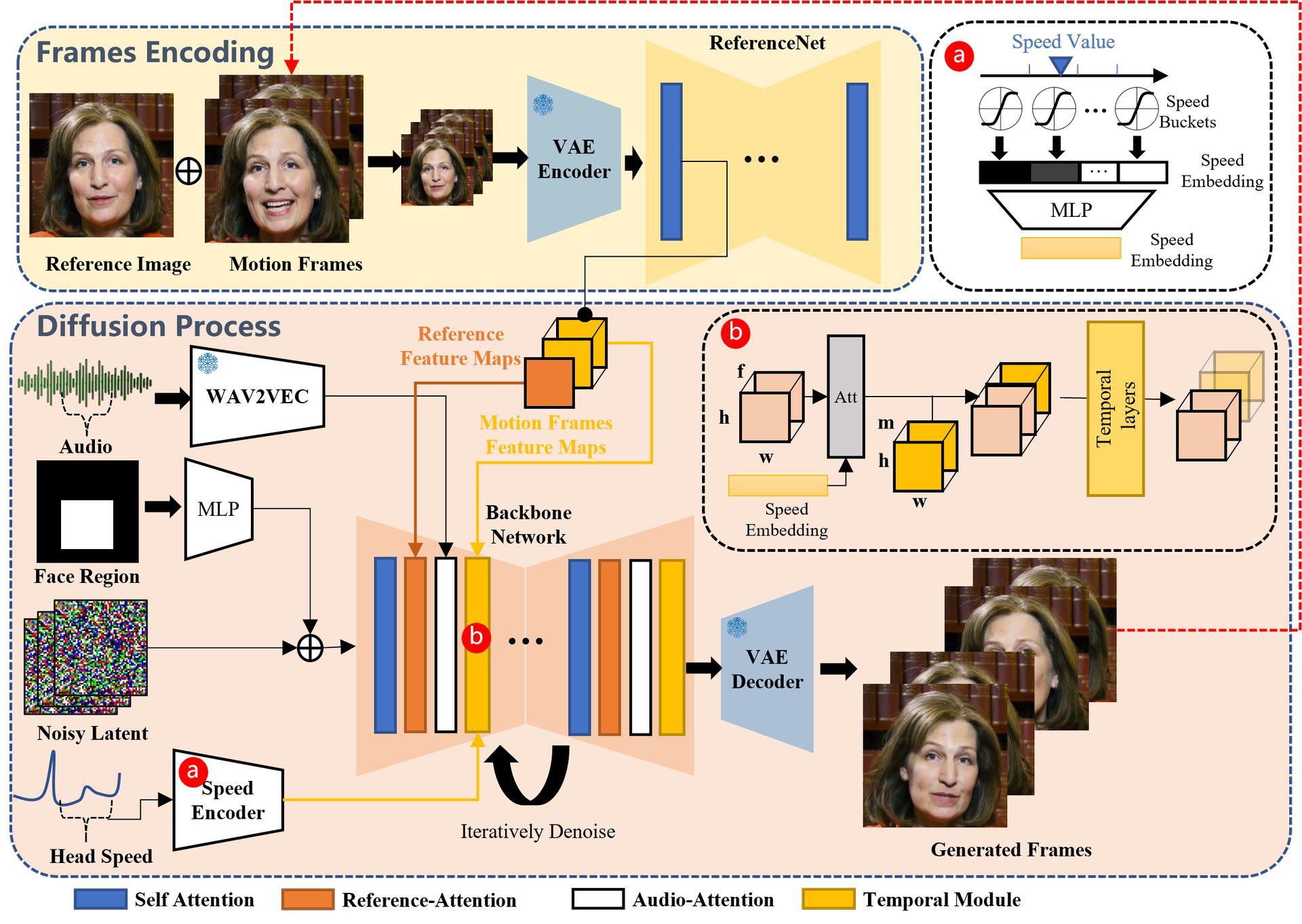

Das EMO-System arbeitet in zwei Hauptphasen: Frame-Kodierung und Diffusionsprozess.

- Frames-Kodierung: Extrahiert Features aus Referenzbildern und Bewegungsbildern, um die Grundlage für die Animation zu schaffen.

- Diffusionsprozess: Verwendet einen vortrainierten Audio-Encoder zur Verarbeitung der Audioeingabe. Es integriert Gesichtsbereichsmasken mit Multi-Frame-Rauschen zur Animationsgenerierung. Backbone Network entrauscht Animationen, unterstützt durch Reference-Attention- und Audio-Attention-Mechanismen. Zeitmodule passen die Bewegungsgeschwindigkeit an.

Was können Sie mit EMO machen?

EMO bietet ein vielseitiges Tool zum Erstellen lebensechter animierter Videos und erweitert die Möglichkeiten für die Erstellung personalisierter und ausdrucksstarker Inhalte, wie zum Beispiel:

- Gesangstalente: Erzeugt Gesangs-Avatar-Videos mit ausdrucksstarken Gesichtsausdrücken, synchronisiert mit singenden Audioeingängen.

- Sprache und Stil: Unterstützt verschiedene Sprachen und Porträtstile und erfasst Tonvariationen für dynamische Avatar-Animationen.

- Schneller Rhythmus: Gewährleistet die Synchronisierung von Charakteranimationen mit rasanten Rhythmen.

- Im Gespräch: Animiert Porträts als Reaktion auf gesprochene Audioeingaben in verschiedenen Sprachen und Stilen.

- Schauspielerübergreifende Leistung: Stellt Charaktere aus Filmen oder anderen Medien in mehrsprachigen und multikulturellen Kontexten dar.

Zusammenfassend ist EMO, auch bekannt als Emote Portrait Alive, ein bedeutender Fortschritt in der Animationstechnologie. Es kann Standbilder in lebendige Videos verwandeln, in denen die Personen realistisch zu sprechen oder zu singen scheinen. EMO erreicht dies durch die direkte Umwandlung von Audio in Videobilder und die genaue Erfassung von Gesichtsausdrücken und Bewegungen. Während EMO spannende Möglichkeiten für die Erstellung dynamischer visueller Inhalte bietet, müssen ethische Bedenken hinsichtlich eines möglichen Missbrauchs berücksichtigt werden. Nichtsdestotrotz stellt EMO ein wertvolles Werkzeug dar, um Standbilder zum Leben zu erwecken und kann potenziell die Art und Weise verändern, wie wir in Zukunft mit visuellen Medien interagieren.

Für detailliertere Informationen, hier ist seine Forschungsarbeit.

Ausgewählte Bildquelle: EMO: Emote Portrait Alive-Forschung

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://dataconomy.com/2024/02/29/emote-portrait-alive-emo-alibaba-ai/