Apple Vision Pro ist eine sehr beeindruckende Kombination aus Hardware und Software, aber keineswegs perfekt. Lesen Sie weiter für meine Aufschlüsselung der Vision Pro-Hardware und -Software und der damit verbundenen Erfahrung.

Apple Vision Pro – Spezifikationen, Funktionen und Details

Apple hat heute bei der Eröffnung der Vorbestellungen offiziell die vollständigen Vision Pro-Spezifikationen bekannt gegeben. Lesen Sie hier unsere Aufschlüsselung der technischen Daten und den Vergleich mit Quest 3.

Wenn Sie eine Aufschlüsselung der technischen Daten von Vision Pro auf Papier lesen möchten, können Sie dies tun hier. In diesem Testbericht wird auf einige dieser Spezifikationen verwiesen, es geht jedoch in erster Linie um die tatsächliche Erfahrung bei der Verwendung des Produkts. Und um es klarzustellen: Ich habe es in einem echten Zuhause verwendet, nicht in einer sorgfältig kontrollierten Demo-Umgebung oder einem gut beleuchteten Studio. Und Apple hat UploadVR kein Testgerät geschickt, wir haben unser eigenes gekauft.

Während ich oft über das langfristige Potenzial von AR und VR diskutiere, bewerte ich in diesem Artikel Apple Vision Pro in seiner heutigen Form als echtes Produkt. Ein Produkt ab 3500 $. Bei diesem Preis setzt Apple große Erwartungen. Aber liefert es? Ist Vision Pro wirklich siebenmal besser als Quest 3 oder sogar doppelt so gut? Lesen Sie weiter, um es herauszufinden.

Diese verdammte Batterie

Die wohl heftigste Hardware-Debatte in der Branche ist derzeit die Frage, was mit der verdammten Batterie geschehen soll.

Wenn Sie es im Visier behalten, erhöhen Sie das Gewicht und beschränken die Rechenleistungsgrenze auf Smartphone-Chipsätze. Wenn Sie es in die hintere Polsterung legen, ist es unmöglich, sich auf einem Stuhl, Sofa oder Bett zurückzulehnen. Und wenn Sie den Akku extern verbauen, entsteht ein lästiges und unelegantes Kabel. Alle Lösungen haben harte Kompromisse.

Die Akkukapazität des Apple Vision Pro verrät seinen wahren Zweck

Der Akku des Apple Vision Pro hat eine enorme Energiekapazität, fast doppelt so viel wie die des Quest 3, was zeigt, dass sein eigentlicher Zweck nicht darin besteht, das Gewicht des Headsets zu reduzieren.

Was auch immer Ihre Meinung dazu sein mag, Apple hat sich zumindest für sein Headset der ersten Generation für den Ansatz des kabelgebundenen Akkus entschieden. Und das bedeutet, dass Sie jedes Mal, wenn Sie Vision Pro verwenden, bewusst darüber nachdenken müssen, wie Sie diesen 353 Gramm schweren Anker, der etwa doppelt so viel wiegt wie ein typisches Smartphone, am besten positionieren und wie Sie das Kabel so halten, dass es Ihrem linken Arm nicht im Weg ist . Und wenn Sie aufstehen oder einfach nur Ihre Sitzposition ändern möchten, stellen Sie sicher, dass sich der Akku in Ihrer Tasche befindet oder Sie ihn in der Hand halten.

Ich habe mich am Kabel verfangen. Ich habe den Akku von meinem Stuhl geworfen und dabei unbehaglich am Headset gezogen. Und ich habe mich zu weit nach rechts gelehnt und die Begrenzung der Halteleine erreicht. Das Batterieband fühlt sich allgegenwärtig an, und weil es so kurz ist, ist es viel störender als das lange Kabel von PC-VR-Headsets oder PlayStation VR2. Ich habe mir Quest 3 in den letzten Tagen häufig zum Vergleich mit Vision Pro angesehen und es ist unglaublich erfrischend, dass man das Headset einfach auf den Kopf setzen und sich bewegen kann, wie man möchte, ohne dass man vorher darüber nachdenken muss.

Im Jahr 2019 haben wir fragte Oculus-Manager Jason Rubin ob sein Unternehmen ein angebundenes tragbares Computermodell in Betracht zieht. Er ist, was er gesagt hat:

„Das ist ein Modell, das wir definitiv erforscht haben. Es gibt viele Vorteile, zum Beispiel optisch ist es ein großer Vorteil, die kleinere Brille auf dem Kopf zu haben. Batterie, Gewicht fernhalten, Hitze vom Bildschirm fernhalten, Batterie trennen. Das alles ist großartig.

Das Problem ist, wenn man es tut, weil wir es versucht haben, Du hast einen Draht. Und diesen Draht vergisst man nie."

Leider hatte Rubin völlig Recht. In meiner bisherigen Zeit mit Apple Vision Pro habe ich dieses Kabel fast nie vergessen.

Was die tatsächliche Akkulaufzeit angeht, habe ich durchweg die angegebenen 2 Stunden erreicht, obwohl man den Akku für eine unbegrenzte Nutzung über USB-C mit Strom versorgen kann, und so habe ich den Großteil meiner Zeit im Vision Pro verbracht. Angesichts dieser Tatsache und der Tatsache, dass das Produkt auf das Sitzen ausgerichtet ist, finde ich die häufigen Beschwerden über die Akkulaufzeit, die vor allem von denen kommen, die das Headset nicht wirklich besitzen, übertrieben.

Nebenbemerkung: Der Akku scheint eine IMU zu enthalten, da durch Anheben oder Antippen manchmal die Betriebsstatus-LED aktiviert wird. Sprechen Sie über Overengineering!

Enges vertikales Sichtfeld und Lichtdichtungen

Das allererste, was mir auffiel, als ich Vision Pro tatsächlich auf mein Gesicht auftrug, war das Sichtfeld.

Horizontal ist es in Ordnung und fühlt sich in etwa auf dem Niveau des Quest 2 an. Vertikal ist es jedoch eines der schmalsten aller modernen Headsets, deutlich schmaler als jedes Quest.

Beim Ansehen herkömmlicher Videoinhalte spielt das keine große Rolle, da die meisten davon ohnehin im Breitbildformat vorliegen. Bei vollständig immersiven Inhalten oder beim Umsehen mit Passthrough fühlt es sich jedoch etwas klaustrophobisch an, schränkt die Sichtbarkeit Ihrer Tastatur in Produktivitätsszenarien ein und macht das Herumlaufen gefährlich, da Sie den Boden darunter nicht sehen können. Das ist der Grund Nr. 1 dafür, dass Vision Pro praktisch nicht im Freien eingesetzt werden kann und warum die Videos, die Sie von Menschen sehen, die dies tun, Influencer sind, die nach Einfluss streben, und nicht ehrlich einen praktischen Anwendungsfall darstellen.

Faszinierenderweise ist das schmale Sichtfeld des Vision Pro jedoch tatsächlich auf die Dicke der Lichtdichtung zurückzuführen, die auch als Gesichtsschnittstelle bezeichnet wird. Technisch gesehen können Sie Vision Pro ohne Lichtschutz tragen, obwohl Apple dies nicht empfiehlt und es Ihrer Nase zu sehr schadet, als dass es praktisch wäre. Ohne die Lichtdichtung fühlt sich das Sichtfeld des Vision Pro nur ein paar Grad schmaler an als das des Quest 3.

Es gibt 28 verschiedene Lichtsiegelgrößen, im Format ZahlZahlBuchstabe, z.B. 33N. Die erste Zahl scheint ungefähr die Breite (von 1 bis 3) anzugeben, die zweite die Dicke (von 1 bis 6) und der Buchstabe die Größe des Nasenrückens, entweder W für breit oder N für schmal. Dies ist jedoch nicht offiziell bestätigt, um es klarzustellen.

Meine Größe beträgt 21 W, was bedeutet, dass ich eine möglichst dünne Lichtabdichtung haben sollte, allerdings schränkt sie das Sichtfeld erheblich ein, verglichen mit der Nichtverwendung. Ich kann mir nur vorstellen, wie viel schlechter das Sichtfeld für diejenigen mit dickeren Lichtdichtungen ist.

Das andere Merkwürdige an der Lichtdichtung ist, dass sie nicht wirklich das gesamte Licht blockiert. Und ich meine nicht wegen seiner Form wie bei anderen Headsets. Die Versiegelung selbst ist umfassend und weist nur einen winzigen Lichtspalt auf, ein Vorteil des Gesichtsscanverfahrens zur Auswahl der idealen Größe. Das Problem besteht darin, dass das Stoffmaterial selbst einfach nicht vollständig undurchsichtig ist, sodass helles Licht teilweise durchdringt und zu Ihren Augen – und den Brillengläsern – gelangt, was zu störender Blendung führt. Ich halte das für einen völligen Designfehler. Es ist auch Grund Nr. 2, dass Vision Pro nicht praktisch im Freien eingesetzt werden kann und warum die Videos, die Sie von Leuten sehen, die dies tun, Influencer sind, die nach Einfluss streben, und nicht ehrlich einen praktischen Anwendungsfall darstellen.

IPD-Anpassung und Linsenklarheit

Beim Vision Pro erfolgt die IPD-Anpassung vollautomatisch. Und ich meine voll und ganz. Wenn Sie es zum ersten Mal aufsetzen, werden Sie aufgefordert, den oberen Knopf gedrückt zu halten, und Sie spüren (und sehen eine Visualisierung), wie sich die Linsen horizontal bewegen, um sich an Ihren Augen auszurichten. Die Eye-Tracking-Kameras erfassen die Position Ihrer Pupillen und winzige piezoelektrische Aktoren bewegen die Linsen an ihren Platz.

Diese Grundidee ist nicht neu. Die automatische IPD-Anpassung ist auch eine Funktion der Headsets Pico 4 Enterprise, Pimax Crystal und Varjo. Aber Vision Pro geht tatsächlich noch einen Schritt weiter: Jede Linse bewegt sich unabhängig voneinander. Dies ist wichtig, da die IPDs vieler Menschen tatsächlich asymmetrisch sind und einen leicht unterschiedlichen Abstand zur Gesichtsmitte aufweisen. Mit Vision Pro erhalten Sie eine praktisch perfekte horizontale optische Ausrichtung. In einer Welt vor Quest Pro und Quest 3, deren Objektive eine so große Eyebox haben, dass es keine Rolle spielt, wenn Ihr IPD etwas falsch eingestellt ist, wäre das natürlich eine viel größere Sache gewesen.

Eine weitere einzigartige Funktion von Vision Pro ist die dynamische Verzerrungskorrektur. Es verwendet Eye-Tracking, um das Modell zur Korrektur der Linsenverzerrung in Echtzeit zu aktualisieren, um den Winkel Ihres Auges bei jedem Bild zu berücksichtigen. Meta hat Prototypen vorgeführt davon, aber Apple hat es tatsächlich ausgeliefert.

Und wie bei allen handelsüblichen Headsets haben die Objektive des Vision Pro einen festen Fokus, sodass Sie keinen realistischen Fokus erhalten, da Tiefenmarkierungen und Objekte in der Nähe unschärfer sind. Aber die automatische IPD-Anpassung pro Auge und die dynamische Verzerrungskorrektur sind immer noch bemerkenswerte Funktionen, und ich hoffe, dass beide zum Standard für alle High-End-Headsets werden.

Was die tatsächliche optische Klarheit der Linsen angeht, liegt Apple nach Meta an zweiter Stelle. Das Bild ist im Allgemeinen scharf und unverzerrt, mit Ausnahme der linken und rechten Ränder jedes Auges, etwa 5 % auf jeder Seite. An diesen Rändern gibt es eine starke Unschärfe und Farbsäume, die viel extremer sind als bei Quest 3. Dies kann sichtbar werden, wenn Sie mit den Augen auf einen virtuellen Bildschirm an Ihrer Seite blicken und Sie dazu zwingen, den Kopf zu drehen.

Rezepteinsätze und Brillenhalter

Da ich keine Brille benötige, kann ich nichts über das Gefühl sagen, das die Verwendung der 150-Dollar-Rezepteinsätze bei Vision Pro mit sich bringt. Was ich Ihnen sagen kann, ist, dass jeder Einsatz mit einem QR-ähnlichen Code versehen ist, den Vision Pro scannt, um die Basislinie des Verzerrungskorrekturmodells anzupassen. Sehr beeindruckende Liebe zum Detail und zur Qualität.

Während Sie theoretisch Ihre Brille in Vision Pro einstecken können, wie mein Kollege Kyle Reisenbeck getestetApple rät dringend davon ab. Sie könnten die Gläser zerkratzen und etwaige durch die Brille verursachte Verzerrungen werden nicht korrigiert. Das Eye-Tracking ist auch nicht für die Verwendung durch Brillen konzipiert, obwohl Kyle behauptet, dass es bei ihm funktioniert hat.

Passthrough ist eine gemischte Sache

Klarheit, Helligkeit, Farben und Dynamikumfang

Entgegen allem, was Sie vielleicht gehört haben, fühlt sich das Passthrough des Apple Vision Pro trotz der hellsten Lichtverhältnisse überhaupt nicht wie eine transparente Optik an. Es sieht immer noch sehr wie ein Smartphone-Kamera-Feed aus.

Meta Quest 3 verwendet 4-Megapixel-Farbkameras für Passthrough, während Vision Pro 6.5-Megapixel-Kameras verwendet. Zum Vergleich: Um eine Passthrough-Klarheit zu erreichen, die angeblich „praktisch nicht von der natürlichen Sicht zu unterscheiden“ ist PC-basierter Varjo XR-4 verwendet 20-Megapixel-Kameras.

Wie bei allen Kamerasystemen hängt die Qualität von Vision Pro stark von den Lichtverhältnissen ab. Aber im Allgemeinen ist der Passthrough von Vision Pro im Hinblick auf die Klarheit deutlich besser als der von Quest 3, aber nicht dramatisch. Es ist leicht körnig, wenn auch viel weniger körnig als Quest 3, und leicht verschwommen, wenn auch deutlich weniger verschwommen als Quest 3.

Ich habe eine Miniatur verwendet Snellen-Diagramm (bereitgestellt von meinem Redakteur Ian Hamilton), um zu quantifizieren, welches Maß an menschlicher Sicht der Passthrough auf jedem Headset bieten kann. Mit Quest 3 konnte ich die vierte Zeile gerade noch lesen, was einer Sehschärfe von 20/50 entspricht, während ich mit Apple Vision Pro die fünfte Zeile gerade noch lesen konnte, was einer Sehstärke von 20/40 entspricht. Ohne Headset kann ich die achte Reihe lesen, was eine Sehschärfe von 20/20 bedeutet.

Der Passthrough des Vision Pro ist so gut, dass die feste Brennweite zum Hauptbeschränkungsfaktor für die komfortable Nutzung Ihres Telefons wird. Aber es ist immer noch nicht gut genug, um feine Details wie kleinen Text in einer Entfernung von mehr als einem Meter oder so zu erkennen, und ohne helle Beleuchtung ist es nicht einmal gut genug, um die Tasten einer Tastatur auf Ihren Knien klar zu erkennen.

Und der Passthrough von Vision Pro ist in mancher Hinsicht tatsächlich schlechter als der von Quest 3. Während der Passthrough des Quest 3 hell und lebendig ist, ist der des Apple Vision Pro dunkler und hat gedämpfte Farben mit etwas, das wie ein subtiler Sepia-Tonfilter aussieht. Könnte dies ein unbeabsichtigter Kompromiss der abgedunkelten Glasfrontplatte sein, oder ist es durch Software-Optimierungen lösbar?

Ein Bereich, in dem das Passthrough von Vision Pro jedoch glänzt, ist sein unglaublicher Dynamikumfang. Sure Quest 3 passt seine Belichtung dynamisch an, wenn Sie sich einer hellen Lichtquelle nähern, sodass beispielsweise Bildschirme vorübergehend sichtbar sind, Vision Pro jedoch nicht. Der Dynamikbereich der Kamera reicht aus, um große Lichtunterschiede gleichzeitig zu bewältigen, so dass es fast zu keinem Bildausfall kommt. Es ist bemerkenswert. Selbst im Freien, wenn die Sonne auf mich strahlte, war der Passthrough des Vision Pro nicht kaputt.

Skalierung, Tiefe und Bewegungsunschärfe

Der mit Abstand größte Unterschied zwischen Passthrough auf Vision Pro und Quest 3 ist die grundlegend unterschiedliche zugrunde liegende Technik. Dies bietet den größten Vorteil des Passthrough von Vision Pro gegenüber Quest 3, bringt aber auch einige schwerwiegende Nachteile mit sich.

Die Schwierigkeit beim Passthrough-Konzept besteht darin, dass die Kameras nicht dort positioniert sind, wo Ihre Augen sind. Die Linsen, Displays und Computerhardware schaffen Distanz zwischen ihnen.

Bei Quest ist die Ansicht, die Sie auf die reale Welt sehen, eine Echtzeit-Neuprojektion der Kameraansicht. Das Headset führt einen Computer-Vision-Algorithmus auf den Graustufen-Tracking-Kameras aus, um pro Bild eine First-Person-Tiefenkarte zu erstellen, und die Pixel der Farbkameras werden so verzerrt, dass sie mit dieser Tiefenkarte übereinstimmen, um eine Ansicht mit der richtigen Tiefe und im richtigen Maßstab zu liefern Sie würden aus der Position Ihrer Augen sehen. Im Nahfeld nutzt Quest sogar Positionsverfolgung, sodass Ihr Kopf durch diese neu projizierte Ansicht wandern kann, bevor das nächste Kamerabild überhaupt verfügbar ist, um die wahrgenommene Latenz zu minimieren. Das Problem bei diesem Ansatz besteht darin, dass die Tiefenkarte pro Bild eine sehr niedrige Auflösung aufweist und nicht ganz genau ist, weshalb der Passthrough von Quest 3 die schreckliche Blasenverzerrung aufweist, die wir scharf kritisiert haben in unserer Überprüfung, warum das Deaktivieren der Positionsverfolgung auch den Passthrough ausschaltet und warum der Passthrough in einem fahrenden Fahrzeug heftig ruckelt und schief läuft.

Es ist sehr offensichtlich, dass Apple Vision Pro diese Art der Echtzeit-Reprojektion nicht verwendet. Es gibt keinerlei Verzerrungen, selbst wenn ich die Tracking-Kameras absichtlich blockiert habe. Es wird nie angenommen, dass ein Glasfenster ein 2D-Bild ist. Und das Abdecken der Kameras auf einer Seite der Vorderseite des Headsets, was bei Quest die Neuprojektion unterbricht, bewirkt bei Vision Pro nichts, außer dass ein Auge schwarz wird. Aber ich weiß wirklich, dass es sich bei Vision Pro nicht um eine dynamisch neu projizierte Ansicht handelt, weil der Maßstab und die Perspektive leicht abweichen. Ja, das stimmt, der Passthrough von Apple Vision Pro ist nicht tiefenrichtig. Das war das Meiste Der für mich überraschende Aspekt von Vision Pro, den ich in kaum einer anderen Rezension erwähnt habe.

Die Abwesenheit der Quest-Warping-Verzerrung ist zutiefst erfrischend, kann sich im Vergleich erhaben anfühlen und ist wahrscheinlich das, was die meisten Leute meinen, wenn sie den Passthrough des Vision Pro loben. Und wenn Sie auf einer Couch sitzen und das Einzige, was Sie in Ihrer Nähe haben, Ihre Hände sind, werden Sie wahrscheinlich nicht einmal bemerken, dass die Ansicht, die Sie sehen, nicht tiefenrichtig ist. Wenn Sie jedoch an einem Schreibtisch sitzen, werden Sie auf jeden Fall bemerken, wie sich der Tisch und der Monitor vor Ihnen verschieben, wenn Sie Ihren Kopf drehen, und zwar auf eine Art und Weise, wie dies bei virtuellen Objekten nicht der Fall ist. Und bei diesen kurzen Distanzen werden Sie auch bemerken, dass die Ausrichtung virtueller Objekte mit realen Objekten leicht abweicht, wenn Sie Ihren Kopf bewegen. Das liegt nicht an einem Tracking-Fehler, sondern lediglich daran, dass die Sicht von Vision Pro auf die reale Welt nicht tiefenrichtig ist. Heben Sie Quest 3 an und Sie werden sehen, dass reale Objekte in der Position und im Maßstab bleiben, in denen sie sich befanden, als Sie das Headset aufgesetzt hatten. Heben Sie Vision Pro an und Sie werden sehen, dass alles leicht versetzt ist. Apple priorisierte geometrische Stabilität auf Kosten einer falschen Tiefe und Skalierung, während Meta Tiefe und Skalierung auf Kosten einer starken Blasenverformung priorisierte.

Dass es sich bei der Ansicht von Vision Pro nicht um eine dynamische Neuprojektion handelt, wird auch beim Gehen sehr deutlich. Gehen Sie mit Vision Pro durch Ihr Zuhause oder draußen, und jeder Schritt führt dazu, dass die Passthrough-Ansicht leicht wackelt und mir sogar ein wenig mulmig wird. Machen Sie dasselbe bei Quest 3 und Sie werden zwar verzerrende Verzerrungen an den Wänden sehen, aber die Ansicht, die Sie sehen, ist frei von diesem Verwackeln, denn auch hier bewegen Sie sich durch eine Neuprojektion und sehen keine rohe Kameraausgabe. Dies ist Grund Nr. 3 dafür, dass Vision Pro nicht praktisch im Freien eingesetzt werden kann und warum die Videos, die Sie von Leuten sehen, die dies tun, Influencer sind, die nach Einfluss streben, und nicht ehrlich einen praktischen Anwendungsfall darstellen.

Ein weiterer interessanter Unterschied zwischen den Passthrough-Ansätzen von Apple und Meta ist die resultierende doppelte Bewegungsunschärfe. Mit Vision Pro zeigen sich bewegende Objekte wie Ihre Hände bei stillem Kopf keine Unschärfe und sehen nahezu perfekt glatt aus. Aber wenn man den Kopf dreht, kommt es zu erheblichen Doppelbildern – so sehr, dass „Wow, es ist wirklich verschwommen, wenn man den Kopf bewegt“ die erste Reaktion der einzigen Person war, der ich Vision Pro bisher vorgeführt habe. Das Interessante daran ist, dass es bei Quest 3 genau das Gegenteil ist; Bei bewegten Objekten wie Ihren Händen kommt es zu erheblichen Doppelbildern, während das Drehen Ihres Kopfes nur sehr wenig dazu führt. Es hat alles den gleichen Grund: Bei Vision Pro sehen Sie einen Kamera-Feed aus einer anderen Position als Ihre Augen, während Sie bei Quest eine neu projizierte Ansicht sehen, die versucht, dem zu entsprechen, was Ihre Augen sehen würden.

Hands-On: Metas reprojektionsfreier Passthrough-Prototyp

Auf der SIGGRAPH 2023 haben wir Flamera ausprobiert, Metas Forschungsprototyp für reprojektionsfreie Passthrough-AR. Lesen Sie hier unsere Eindrücke & Gedanken:

Es wird faszinierend sein zu sehen, wie sich die unterschiedlichen Ansätze von Apple und Meta in zukünftigen Produkten weiterentwickeln. Theoretisch sollte Meta mit einer Tiefenkarte mit viel höherer Auflösung in der Lage sein, die Nachteile der Neuprojektion zu minimieren und gleichzeitig seine Vorteile beizubehalten. Um die Tiefe und Skalierung von Vision Pro zu verbessern, müsste man das Headset hingegen deutlich schlanker machen und auf EyeSight verzichten oder die Kameras irgendwie darunter platzieren, damit die Kameras näher an der Position Ihrer Augen sind. Alternativ könnte jedes Unternehmen eine neuartige hardwarebasierte Lösung wie die von Meta verwenden Flamera-Prototyp, oder implementieren Sie a basierend auf einem neuronalen Netzwerk Lösung mit künftig leistungsstärkeren Chipsätzen.

Atemberaubende nahezu 4K-OLED-Mikrodisplays

Was Ihnen schnell klar wird, ist, dass die Einschränkungen der Sicht von Vision Pro auf die reale Welt definitiv von den Kameras und nicht von den Displays herrühren, denn der virtuelle Inhalt, der Ihre Sicht überlagert, ist einfach atemberaubend.

Vision-Profis nahezu 4K Micro-OLED-Displays sind mit Abstand das beeindruckendste Element seiner Hardware und heben seine visuelle Qualität in eine andere Liga als alle anderen Konkurrenten. Es ist ein Hauch frischer Luft in einem Markt voller 2K-LCD-Headsets mit ihren düsteren grauen Schwarztönen und gedämpften Farben.

(Aufnahmen von Apple)

Die Farben sind lebendig, der Kontrast und der Dynamikumfang sind unglaublich und es ist kein Hardwarepixel in Sicht. Zum ersten Mal bei einem Consumer-Headset, das ich ausprobiert habe, kann ich die Hardware-Pixel in keinem Szenario erkennen und winzige Details sind deutlich sichtbar.

Es ist außerdem das erste eigenständige Headset, das die von Unternehmen versprochenen Produktivitätsanwendungsfälle umsetzen kann wie Meta seit Jahren tatsächlich realisierbar, ohne dass die Bildschirme größer gemacht werden müssen als das Sichtfeld des Headsets. Bei einer angenehmen Anzeigegröße fühlt sich die Lesbarkeit irgendwo zwischen einem 1440p- und einem 4K-Monitor an. Dies ist ein Wendepunkt für VR-Headsets.

| HEADSET | Anzeige Tech | Auflösung pro Auge |

| Oculus Rift und HTC Vive (2016) |

OLED | 1080/1200 (PenTile) |

| Ventilindex (2019) |

LCD | 1440/1600 |

| Metaquest 2 (2020) |

LCD | ~1680×1870 (geschätzt) |

| Metaquest 3 (2023) |

LCD | 2064/2208 |

| Bigscreen jenseits (2023) |

Mikro-OLED | 2560/2560 |

| Apple Vision Pro (2024) |

Mikro-OLED | 3660/3200 |

Bei den Displays von Apple Vision Pro gibt es jedoch ein Problem: die Nachleuchtdauer, d. h. wie lange pro Bild das Display tatsächlich beleuchtet ist. Es ist höher als fast jedes andere Headset und das bedeutet, dass Sie selbst bei vollständig virtuellen Inhalten eine gewisse Bewegungsunschärfe bemerken, wenn Sie Ihren Kopf bewegen. Es ist ein Beispiel dafür, wie Apple Vision Pro für die stationäre Nutzung im Sitzen optimiert wurde, nicht für aktive Bewegung. Und es macht Vision Pro zu einem suboptimalen Headset für alle Inhalte, bei denen Sie Ihren Kopf schnell drehen, wie zum Beispiel die wenigen aktiven Spiele.

Ein weiteres kleineres Problem besteht darin, dass Vision Pro zur Steuerung dieser Auflösung ständig das Eye-Tracking-Foveated-Rendering verwendet. In nativen Apps, die mit RealityKit erstellt wurden, funktioniert es meistens einfach, obwohl gelegentlich kleinere visuelle Artefakte in der Peripherie auftreten. Aber in einigen Unity-Apps sind mir sehr offensichtliche und harte Artefakte aufgefallen, insbesondere im Text. Dies ist offenbar ein bekanntes Problem, dessen Korrekturen in zukünftigen Versionen der Unity visionOS-Integration erfolgen werden.

Gewicht & Komfort

Obwohl Vision Pro aufgrund seiner Auflösung theoretisch in der Lage ist, Monitore zu ersetzen, möchten Sie dies wahrscheinlich nicht tun.

Angesichts der Tatsache, dass ein Großteil des Marketings darin besteht, stundenlang zu sitzen und virtuelle Bildschirme anzusehen oder mit ihnen zu interagieren, und da der Akku extern ist, könnte man davon ausgehen, dass Vision Pro relativ leicht und komfortabel ist. Aber du liegst falsch.

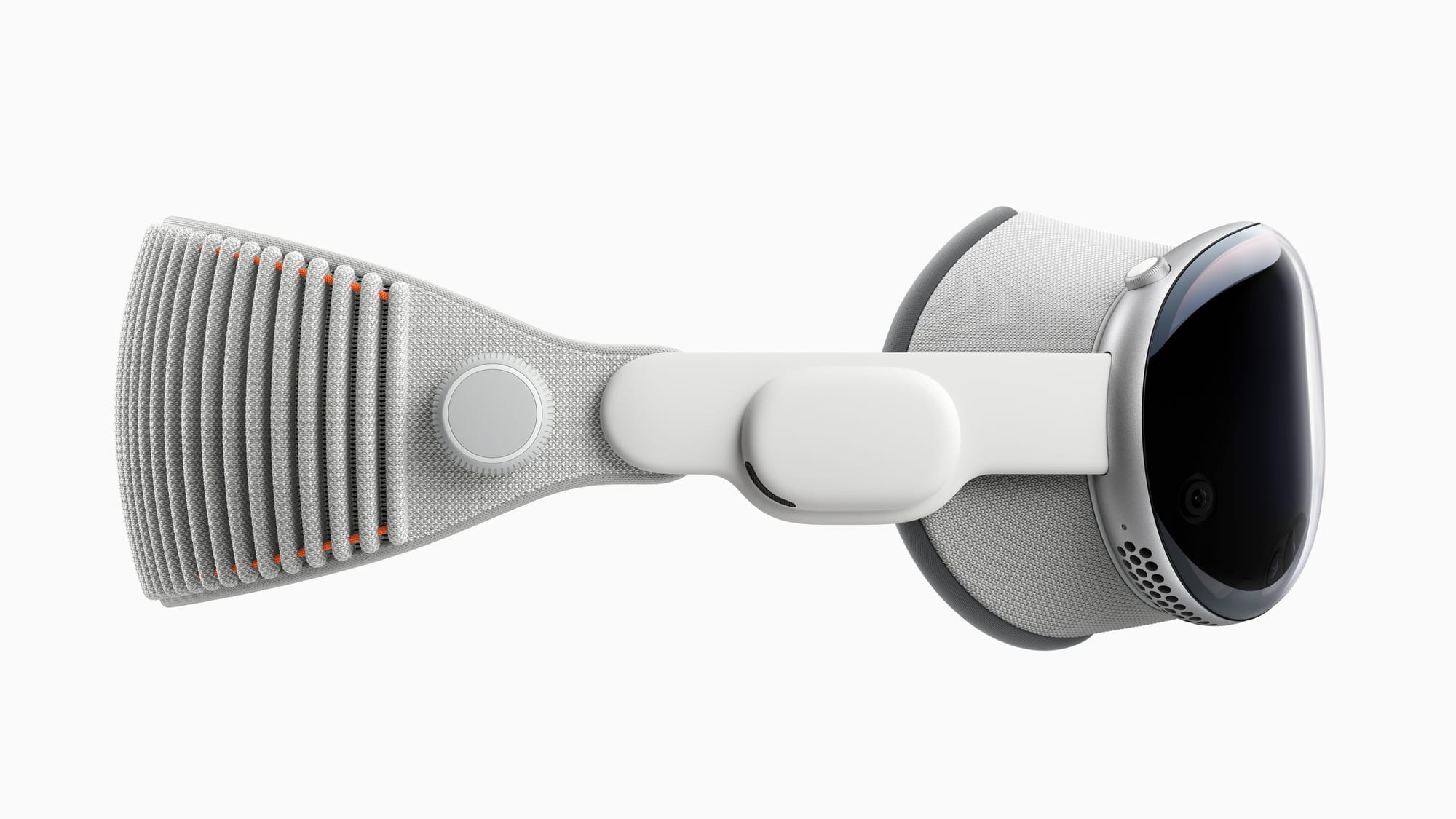

Apple Vision Pro (links) und Meta Quest 3 (rechts) ohne jegliches Zubehör.

Trotz seines externen Batteriedesigns wiegt Vision Pro selbst ohne Lichtdichtung und Kopfband satte 478 Gramm. Zum Vergleich: Das Meta Quest 3 wiegt ohne Gesichtsschnittstelle und ohne Riemen 397 Gramm, und das Visier des Pico 4 wiegt etwa 295 Gramm. Es ist eine etwas seltsame Situation, dass das einzige große Headset mit angeschlossenem Akku das schwerste ist, aber Apple hat in diesem Gerät eine beträchtliche Menge Komponenten untergebracht und sie in einen Aluminiumrahmen mit einer Glasfrontplatte gehüllt. Möglicherweise war Aluminium erforderlich, um die von den M2- und R1-Chipsätzen erzeugte Wärme abzuleiten, oder es wurde einfach aufgrund seiner ästhetischen Qualitäten ausgewählt.

Im Auslieferungszustand ist Vision Pro bereits mit einem Riemen namens „Solo Knit Band“ ausgestattet. Es ist der Riemen, den Sie auf fast allen Marketingfotos von Apple sehen, und er besteht aus einem „3D-gestrickten“ Stoff, der sich am Hinterkopf großartig anfühlt. Das Problem besteht jedoch darin, dass ihm ein oberer Riemen fehlt, ein wichtiger Bestandteil der Riemen anderer Headsets wie Quest 3 und Valve Index. Das Ergebnis ist, dass das Solo Knit Band das Gewicht des Headsets einfach nicht bequem tragen kann. Ich finde es nur etwa 5 bis 10 Minuten lang erträglich, wenn überhaupt, danach schmerzt das Headset so sehr, dass ich es einfach abnehmen muss. Ich kann mir nicht vorstellen, dass Apple ernsthaft erwartet, dass irgendjemand das Solo Knit Band trägt, und ich kann mir vorstellen, dass es eher aus Marketinggründen und zum Markenimage existiert als aus praktischen Gründen.

Zum Glück liegt dem Vision Pro jedoch ein anderes Band bei, das sogenannte Dual Loop Band, und es verfügt über ein seitliches Band an der Oberseite. Mit dem Dual Loop Band kann ich Vision Pro unbegrenzt tragen. Ich würde es allerdings nicht als besonders komfortabel bezeichnen und das Gewicht des Headsets lässt nie wirklich nach.

Was mir am Dual Loop Band nicht gefällt, ist, dass sich der hintere Riemen nicht annähernd so weich und angenehm anfühlt wie beim Solo Knit Band. Ich wünschte, Apple hätte das Solo Knit Band mit dem oberen Riemen kombiniert in einem seiner Designpatente zu sehen.

Ein positiver Aspekt des Komforts von Vision Pro ist, dass die Polsterung der Lichtdichtung aus einem sehr bequemen Schaumstoff besteht und da die Lichtdichtung auf die Größe Ihres Gesichts abgestimmt ist, sitzt sie sehr gut. Ja, das Gewicht ist immer vorhanden, aber zumindest fühlt sich das, was gegen Ihr Gesicht drückt, nicht so rau an wie bei Quest 2.

Okklusion und Grenzen

Es ist eine Sache, virtuelle Bildschirme und Objekte über die reale Welt zu legen, aber um sie überzeugend und nutzbar zu machen, müssen sie durch reale Objekte verdeckt werden können. In unserem Testbericht haben wir scharf kritisiert, dass Meta Quest 3 bei der Veröffentlichung überhaupt keine dynamische Okklusion aufweist. Auch wenn Meta diese kürzlich hinzugefügt hat, erfordert sie eine komplexe Entwicklerintegration und die Tiefenkarte, die sie steuert, hat eine sehr niedrige Auflösung, was zu ziemlich schrecklich aussehenden Ergebnissen führt.

Apple Vision Pro hingegen weist eine Okklusion in zwei unterschiedlichen Formen auf.

Die Hauptform ist der Hand-Arm-Verschluss. Es gibt eindeutig ein 2D-Hand- und Armsegmentierungsmodell (getrennt von der 3D-Skelett-Handverfolgung), das für die Kamera jedes Auges ausgeführt wird. Wie sauber die Segmentierung ist, hängt von den Lichtverhältnissen ab, sieht aber im Allgemeinen so aus, wie Sie es erhalten, wenn Sie Hintergründe auf Ihrer Webcam in einer App wie Zoom aktivieren, oder bestenfalls bei einem Amateur-Greenscreen-Job. Diese Okklusion ist im gesamten System und in jeder App vorhanden. Es ist eine wichtige Funktion, die virtuelle Objekte so aussehen lässt, als ob sie sich tatsächlich mit Ihnen im Raum befänden. Und als Feinschliff werden Ihre Hände und Arme neu beleuchtet, um sie an jede virtuelle Umgebung anzupassen, in der Sie sich befinden.

Es ist jedoch beunruhigend und erschütternd, dass diese Verdeckung nichts einschließt, was Sie in der Hand halten, was bedeutet, dass Ihr Telefon oder Getränk immer noch hinter virtuellen Bildschirmen und Objekten verborgen bleibt, selbst wenn sie sich davor befinden sollten. Es ist, als ob das, was Sie in der Hand halten, unsichtbar wäre.

Nebenbemerkung: Ich habe gehört, dass es für Entwickler möglich ist, die Okklusion von Hand und Arm zu deaktivieren, aber ich bin noch keiner App begegnet, die dies tut.

Vision Pro generiert ein hochauflösendes 3D-Umgebungsnetz und aktualisiert es in Echtzeit. (Aufnahmen von Apple)

Die andere Form ist die 3D-Umgebungsokklusion. Vision Pro nutzt LiDAR und Computer Vision, um ein 3D-Netz Ihrer Umgebung zu erstellen, das in Echtzeit aktualisiert wird. Diese beeindruckende Fähigkeit wird jedoch noch nicht viel genutzt. Im Shared Space, wo das Rendering von Apple gesteuert wird, wird dies nur verwendet, um virtuellen Objekten hinter realer Geometrie wie Wänden eine subtile Transparenz zu verleihen. App-Entwickler, die einen Full Space nutzen, könnten theoretisch noch viel mehr tun, aber das hat noch keiner wirklich getan. Diese Lücke zwischen den Fähigkeiten der Hardware und dem, was die aktuelle Software tatsächlich nutzt, ist ein wiederkehrendes Thema bei Apple Vision Pro.

Was Sie bei Vision Pro nicht finden werden, ist die Notwendigkeit, eine Sicherheitsgrenze zu ziehen, wie Sie es bei Quest 3 tun müssen, und Sie werden nie durch ein riesiges, hässliches, monochromes Gefängnisgitter gestört, das sich über die App zieht und zu Tiefenkonflikten führt. Dies ist jedoch ein zweischneidiges Schwert, da Vision Pro stattdessen im Wesentlichen permanent in einem Äquivalent zum stationären Modus von Quest arbeitet. Wenn Sie sich in einer immersiven App mehr als etwa einen Meter in eine beliebige Richtung bewegen, wird nach und nach auf Passthrough umgestellt. Mit Apple Vision Pro können Sie zwar aufstehen, aber es ermöglicht keine vollständige VR im Raummaßstab.

visionOS und der Shared Space

Apple Vision Pro ist das erste Headset im VR-Stil, das mit einem Betriebssystem ausgeliefert wird, das nicht nur eine Abzweigung von Android ist. Obwohl es auf iPadOS basiert, das wiederum auf iOS basiert, hat Apple offensichtlich erhebliche grundlegende Änderungen vorgenommen und die Systemsoftware für räumliches Computing entwickelt. Tatsächlich ist dies das erste vollständig für XR entwickelte Betriebssystem, das tatsächlich ein Verbrauchergerät mit Strom versorgt.

Es gibt zwei grundlegende „Modi“ von visionOS, den Shared Space und einen Full Space. App-Entwickler können wählen, auf welchen dieser Modi sie ihre App ausrichten möchten.

What The Golf, ein Unity-Spiel, das auf Vision Pro läuft, während Apple Messages daneben läuft. (Aufnahmen von Apple)

Der Shared Space ist die Standardeinstellung. Wie der Name schon sagt, können Shared Space-Apps nebeneinander ausgeführt werden. Dazu können Windows, abgerundete 2D-Rechtecke mit optionaler Transparenz, und Volumes, quaderförmige Bereiche, in denen Apps 3D-Inhalte anzeigen können, von einem einzelnen Modell bis hin zu einer Miniaturspielwelt, gehören. Apps können nur Windows, nur Volumes oder beides verwenden.

Im Shared Space steuert Apple das Rendering, die Beleuchtung und das Tracking vollständig. Der Nachteil besteht darin, dass Entwickler nur Ereignisse erhalten, wie z. B. das Pixel, auf das der Benutzer beim Kneifen geschaut hat, aber keinen direkten Zugriff auf die Skeletthandverfolgung haben. Zu den Vorteilen gehört jedoch die wunderbar konsistente Benutzeroberfläche zwischen den Apps, ein starker Kontrast zu Quest, wo Sie unterschiedliche Steuerelemente und Interaktionen zwischen den einzelnen Apps neu erlernen müssen, selbst Apps für einfache Aufgaben. Ein weiterer Vorteil besteht darin, dass Apple die Umgebungslichtsensoren von Vision Pro verwendet, um virtuelle Inhalte so zu beleuchten, dass sie der Beleuchtung Ihres realen Raums und den Fenstern und Volumen entsprechen und sogar Schatten auf den realen Boden werfen. Nichts davon erfordert irgendeine Entwicklerintegration, alles geschieht automatisch.

Wenn eine App hingegen stattdessen einen Full Space verwendet, werden alle anderen von Ihnen ausgeführten Shared Space-Apps ausgeblendet, und Sie können sie nicht aufrufen, ohne die Full Space-App anzuhalten. Full-Space-Apps erhalten Zugriff auf das Skelett-Rendering und können ihren eigenen Rendering-Stack steuern. Ein Full Space ist wie der Vollbildmodus auf einem PC und seine Verwendung ist im Wesentlichen eine Voraussetzung für aktives Spielen oder immersive VR-Erlebnisse.

Im Vergleich dazu läuft auf anderen Plattformen wie Meta Quest praktisch jede 3D-App in einem vollständigen Bereich, und das Konzept eines gemeinsamen Bereichs existiert derzeit nur für 2D-Apps, von denen Sie nur bis zu drei gleichzeitig sichtbar haben können. Der Ansatz von Apple ermöglicht Multitasking unter Einbeziehung von 3D-Apps, was ihm ein erhebliches Potenzial als allgemeines Computergerät verleiht. Ich kann zum Beispiel ein Video ansehen oder meine eigene Musik hören, während ich im Game Room Schach spiele. Metas kommende Augments-Funktion für Quest 3 klingt etwas ähnlich, muss aber noch ausgeliefert werden durchgesickerte Videos deuten darauf hin Es wird Unity nicht unterstützen.

Ein wesentlicher Nachteil von Apples strenger Abgrenzung zwischen Shared Space und Full Space besteht jedoch darin, dass in Full Space-Apps kein Multitasking möglich ist. Auf Quest können Sie den Browser aufrufen, ohne die immersive App zu minimieren, sodass Sie in einem VR-Spiel neben einem Freund stehen und schnell etwas googeln können. Auf Vision Pro müssen Sie zum Shared Space zurückkehren, wodurch die immersive App minimiert und angehalten wird, bis Sie sie erneut öffnen.

Eingabe und Steuerung

Augen- und Handverfolgung

Der einzige größte Unterschied zwischen visionOS und der Systemsoftware aller davor ausgelieferten Headsets ist das grundlegend andere Interaktionsparadigma.

In visionOS sind Ihre Augen der Cursor und das Kneifen Ihres Daumens an Ihren Zeigefinger ist der Mausklick. Und um es klarzustellen: Sie müssen Ihre Hände nicht vor sich ausstrecken, wie Sie es vielleicht auf einigen Fotos von Menschen gesehen haben, die Vision Pro verwenden. Der springende Punkt ist, dass der Pinch-Klick auch dann funktioniert, wenn Ihre Hände auf Ihrem Schoß oder Ihrer Stuhllehne ruhen, was bedeutet, dass Sie Vision Pro stundenlang ohne „Gorilla-Arm“ verwenden können, der Begriff dafür, dass das Hochhalten Ihrer Arme sie schnell ermüdet Punkt des Schmerzes.

Für Interaktionen, die Sie mit zwei Händen auf einem Touchscreen ausführen würden, wie z. B. Zoomen und Drehen, drücken Sie einfach mit beiden Händen gleichzeitig. Ziehen Sie Ihre Hände auseinander oder zusammen, um dorthin zu zoomen, wo Sie hinschauen, oder bewegen Sie eine nach hinten und die andere nach vorne, um sie zu drehen.

Klicken, Scrollen, Zoomen und Drehen. (Aufnahmen von Apple)

Diese schöne Kombination aus Eye-Tracking und Hand-Tracking eignet sich hervorragend für fast jede Interaktion und kann sich im besten Fall wie Telepathie anfühlen, eine Erweiterung Ihrer Gedanken. Es hat sich so tief in meinem Kopf eingenistet, dass ich sogar versucht habe, auf den Bildschirm meines Fernsehers und Laptops zu starren und ihn zu kneifen.

Es gibt jedoch einen Bereich, in dem es spektakulär versagt: Text. Bei der Texteingabe ist es für die Augen anstrengend, jeden einzelnen Buchstaben zu betrachten, und für eine präzise Textauswahl ist es einfach nicht genau genug. Natürlich können Sie die virtuelle Tastatur direkt berühren, aber das ist noch langsamer. Die praktische Texteingabe ohne physische Tastatur bleibt bei XR ein ungelöstes Problem, und Apple hat keine magische Lösung parat.

Auch unbeabsichtigte Eingaben sind beim Handtracking ein sehr reales Problem. Ich bin versehentlich zu einem anderen Teil eines Films gesprungen, während ich eine Getränkedose geöffnet habe, oder habe zufälligen Text in einem Dokument ausgewählt, während meine Hände einfach auf der Tastatur lagen. Obwohl diese Vorkommnisse meist nur bei schwacher Beleuchtung auftreten, müssen sie langfristig behoben werden, um dies zu einer praktikablen primären Eingabemethode zu machen. In seiner heutigen Form ähnelt es einem Touchscreen, der manchmal aktiviert wird, wenn Staubpartikel darauf treffen.

Darüber hinaus gibt es Fälle, in denen Sie eine Trennung zwischen dem, was Sie sehen, und dem, was Sie kontrollieren, wünschen. Wenn ich beispielsweise ein Video durchsuche, möchte ich oft den Film ansehen, während ich in der Suchleiste scrolle, und visionOS gefällt das nicht. Dies scheint jedoch mit einer anderen Softwareimplementierung lösbar zu sein.

Tastatur- und Mausunterstützung

Auch wenn die Texteingabe mit Hand- und Eye-Tracking mühsam ist, können Sie wie bei anderen eigenständigen Headsets ganz einfach eine Bluetooth-Tastatur anschließen. Apples Magic Keyboard wird sogar getrackt, mit einer kleinen Texteingabevorschau darüber, sodass Sie beim Tippen auf die Tastatur schauen und sehen können, was Sie eingeben.

Wenn Sie Vision Pro zum Schreiben in irgendeiner Form verwenden möchten, auch nur für Tweets und E-Mails, ist eine Bluetooth-Tastatur unbedingt erforderlich. Ein sehr ärgerliches Problem ist, dass manchmal immer noch die virtuelle Tastatur auftaucht und Ihnen die Sicht versperrt. Ich vermute, dass es sich hierbei um einen Fehler handelt.

Damit ist das Texteingabeproblem gelöst, aber wie sieht es mit der Textauswahl aus? Die Textauswahl mit Eye-Tracking ist einfach nur frustrierend. Sie können das Magic Trackpad von Apple anschließen – aber das ist es auch schon. In visionOS gibt es noch keine Mausunterstützung, was wie ein seltsames Versehen erscheint. Idealerweise würde ich mir ein Magic Keyboard mit integriertem Trackpad wünschen, da der Transport beider bedeutet, dass man jetzt zusätzlich zum Vision Pro zwei zusätzliche Dinge mit sich herumträgt und nicht nur eines.

App Launcher, Siri und Kontrollzentrum

Während Vision Pro für die meisten seiner integrierten Eingaben auf Eye-Tracking und Hand-Tracking setzt, verfügt es auch über zwei physische Bedienelemente an der Oberseite. Auf der linken Seite befindet sich die Aufnahmetaste und auf der rechten Seite das anklickbare Einstellrad namens Digital Crown.

Was mir in Vision Pro am wenigsten gefällt, ist die Notwendigkeit, auf die Digital Crown zu klicken, um den App-Launcher aufzurufen. Angesichts der Tatsache, dass eines der Hauptziele des Interaktionssystems von Vision Pro darin besteht, es Ihnen zu ermöglichen, Ihre Arme zu entspannen und in Gedankengeschwindigkeit zu interagieren, ist es wirklich seltsam, jedes Mal, wenn Sie eine App starten möchten, Ihren Arm nach oben strecken und eine Taste drücken zu müssen . Ich verstehe, dass eine Geste Apps daran hindern würde, diese Geste zu verwenden, und gelegentlich nicht ausgelöst würde, aber stellen Sie sich vor, wie sehr es Sie verlangsamen würde, wenn die Windows-Starttaste eine physische Taste oben auf Ihrem Monitor wäre. Ich öffne oft meine Handfläche und drücke meinen Zeigefinger an meinen Daumen, die Menügeste bei Meta Quest, nur um dann daran zu denken, dass das unter visionOS nicht so einfach ist.

Tatsächlich ist es irgendwie sogar schneller zu sagen: „Siri, starte ” als nach oben zu greifen und die Digital Crown zu drücken, sie dann zu suchen und darauf zu tippen. Sie können Apps im App-Launcher nicht neu anordnen, und Siri öffnet Apps an der Position, die Sie gerade betrachten, wenn Sie danach fragen.

Nebenbemerkung: Aus irgendeinem Grund ist Siri auf Vision Pro viel schneller als auf anderen Apple-Geräten. Allerdings ist die Funktionalität immer noch genauso eingeschränkt.

Die andere Art von Menü auf Vision Pro ist, wie auch auf anderen Apple-Geräten, das Kontrollzentrum. Um darauf zuzugreifen, schauen Sie mit Ihren Augen nach oben, bis Sie einen kleinen Kreis mit einem Abwärtspfeil darin sehen, und tippen Sie dann mit Ihren Fingern darauf. Dabei handelt es sich im Wesentlichen um ein Schnellmenü mit schnellem Zugriff auf Uhrzeit, Datum, Hell/Dunkel-Umschaltung, Lautstärkeregelung, Benachrichtigungen und ein erweitertes Kontrollzentrum mit schnellem Zugriff auf WLAN, Bluetooth, Flugmodus, Reisemodus, AirPlay Casting, Virtuelle Mac-Anzeige, Gastmodus, Suche und Aufnahme.

Es ist eine interessante Alternative zu einer Handbewegung. Im Wesentlichen ist es ein Auge Geste. Das Problem besteht darin, dass es nicht angezeigt wird, wenn sich an der Stelle, an der sich der Kreis befinden sollte, eine App befindet. Sie müssen also den Kopf von jeder App abwenden, um sie zu starten. Es kann auch etwas anstrengend sein, das Auge so weit nach oben zu drehen, wenn Sie häufig darauf zugreifen. Auch hier würde ich es vorziehen, wenn dies eine Handbewegung wäre. Und im Idealfall sollte Apple den App Launcher und das Control Center einfach in einem Menü zusammenführen.

Digitale Krone und Umgebungen

Innerhalb des Shared Space oder in Apps, die ihre eigene optionale Umgebung verwenden, sorgt das Scrollen der Digital Crown für einen reibungslosen Übergang zwischen vollständigem Passthrough und vollständigem Eintauchen in die von Ihnen gewählte Umgebung. Auf halbem Weg sehen Sie die virtuelle Umgebung vor Ihrem Sitzplatz und die reale Welt seitlich und hinter Ihnen, mit einer sanften Durchsichtigkeit an den Rändern. Mit Apple können Sie genau den Grad der Immersion wählen, den Sie wünschen, und gleichzeitig mit so viel von Ihrer Umgebung in Verbindung bleiben, wie Sie möchten.

Im visionOS-Hauptmenü wählen Sie die gewünschte Umgebung aus, etwa analog zum Festlegen eines Desktop-Hintergrunds auf einem Mac. Im Moment können Sie wählen zwischen:

- Haleakalā, der gewaltige Hawain-Vulkan

- Yosemite Nationalpark im Winter

- Joshua Tree Nationalpark im Sommer

- Ein Seeufer davor Haube montieren

- White Sands Guyana National Museum

- Die Oberfläche von Der Mond

Alle sechs dieser Umgebungen sehen absolut atemberaubend aus, mit der 3D-Geometrie in Ihrer Nähe, die mit Photogrammetrie gescannt wurde, die an einigen Stellen an Fotorealismus heranreicht, und mit realistischem, hochwertigem räumlichem Audio. Und wie beim Passthrough werfen Fenster und 3D-Objekte realistische Schatten auf die Umgebung. Es ist ein starker Kontrast zu Quest, wo die Umgebungen niedrig aufgelöst und verschwommen sind. Das ist übrigens nicht die Schuld der Quest-Hardware, da diese Umgebungen eine sehr geringe GPU-Auslastung aufweisen. Dies ist ein weiteres Beispiel dafür, dass Meta einfach keine qualitativ hochwertige Software liefert.

Wenn Sie kein Fan davon sind, sich von der realen Welt abzuschotten, und Vision Pro hauptsächlich als AR-Headset haben möchten, Ihre Sicht aber dennoch neu gestalten möchten, gibt es fünf Umgebungen, die stattdessen nur Passthrough neu beleuchten: Morgenlicht, Frühlingslicht, Sommerlicht , Herbstlicht und Winterlicht. Seltsamerweise sind diese auch mit Audio ausgestattet, aber Sie können die Lautstärke der Umgebungslautstärke unabhängig voneinander anpassen.

Nebenbemerkung: Bevor Apple Vision Pro offiziell vorgestellt wurde, als wir über die zuverlässigen Quellen berichteten, die es beschrieben, kam heraus: „Das ist Clickbait über Vaporware!“ Stilkommentare, die Digital Crown war beschrieben als „Reality Dial“. Das wäre ein viel coolerer und passenderer Name gewesen, aber ich vermute, dass Apple mit der Apple Watch, die auch über eine Digital Crown verfügt, ein einheitliches Branding wollte.

Sehvermögen…

EyeSight, auch Reverse Passthrough genannt, ist eine clevere Idee. Eines der größten Probleme bei der Verwendung eines Headsets im selben Raum mit anderen Personen besteht darin, dass diese nicht wissen, wann Sie sie sehen können und wann nicht. Dies löst ein grundlegendes soziales Unbehagen aus, das viele VR-Enthusiasten offenbar unterschätzen.

Theoretisch löst EyeSight dieses Problem, und ich applaudiere Apple für den Versuch. Das Problem ist, dass es in seiner ersten Generation kaum funktioniert.

Erstens war der People Awareness-Algorithmus, der EyeSight überhaupt erst erscheinen lässt, für mich sehr unzuverlässig. Bei alles andere als idealen Lichtverhältnissen wird die andere Person oft nicht erkannt und somit auch ihre Antwort auf die Frage „Können Sie meine Augen sehen?“ nicht erkannt. war ein klares „Nein, nur das schwarze Glas“.

Aber selbst wenn People Awareness EyeSight auslöst, ist die Helligkeit des Bildes einfach zu dunkel, um nützlich zu sein. Die Antwort auf die Frage „Können Sie meine Augen sehen?“ war bei fast allen möglichen Lichtverhältnissen „kaum – und ich hätte es nicht bemerkt, wenn Sie nicht gefragt hätten“.

Das letzte Problem besteht darin, dass EyeSight zwar Parallaxe hat, diese jedoch nur für die horizontale Achse gilt. Betrachtet man es aus einem steilen vertikalen Winkel, von oben oder unten, bricht der Effekt völlig zusammen und wirkt noch skurriler. Zu den Antworten, die ich darauf bekam, gehörte: „Wow, das sieht absolut schrecklich aus.“

Dieses Meta Konzept rendern zeigt, wie EyeSight in ein paar Generationen aussehen könnte.

Einige Leute haben EyeSight als gescheitertes Projekt abgeschrieben und stellen sich vor, dass es in zukünftigen Versionen von Vision Pro den gleichen Weg gehen wird wie die TouchBar, aber ich bin mit diesem Grad an Pessimismus nicht einverstanden. Auch hier ist es eine gute Idee, es handelt sich lediglich um eine sehr frühe und begrenzte Umsetzung. Meta präsentierte erstmals 2019 Forschungsergebnisse zum Reverse Passthrough und zeigte kürzlich eine Darstellung dessen, wie es auf einem Headset aussehen könnte, „das jetzt gebaut werden kann“. Auch wenn die Darstellungen offensichtlich nicht vollständig die Realität abbilden, scheinen die Meta-Forscher zuversichtlich zu sein, dass es möglich ist, Reverse Passthrough mit viel höherer Qualität als bei Vision Pro zu liefern, und ich bin sicher, dass die Ingenieure von Apple auch bereits hart daran arbeiten.

Optimierung und Leistung

Was mir bisher an der Erfahrung mit Apple Vision Pro am besten gefällt, ist die Leistung. Egal, was Sie im Shared Space tun, Vision Pro lässt Frames einfach nicht sichtbar fallen. Ich habe kein Ruckeln erlebt, dieses schreckliche Phänomen, das Quest und PC VR plagt und mich und viele andere krank macht, und das Fehlen bei Vision Pro ist einfach großartig.

Es ist nicht ganz klar, wie Vision Pro das schafft. Ich habe Spekulationen gelesen, dass dies daran liegt, dass der R1-Chip den Passthrough separat verarbeitet, sodass der Passthrough keine Frames auslässt, egal wie stark der M2 ausgelastet ist. Das klingt plausibel, bis auf ein Problem: Wenn ich mich in vollständig virtuellen Umgebungen befinde, sehe ich auch kein Ruckeln. Es ist auch offensichtlich, dass der Chipsatz bei Quest nicht das Problem ist, wenn Sie einen Pico 4 verwenden und sehen, wie reibungslos und leistungsfähig die Systemsoftware ist. Meta ist nicht auf die Hardware beschränkt, seine Software ist nur schlecht optimiert.

Meine Theorie, die auf meinen Dutzenden Stunden in Vision Pro basiert und um es klarzustellen, ist nur meine Spekulation, ist, dass der wahre Grund für das fehlende Ruckeln von Vision Pro etwas mit der zugrunde liegenden Architektur von visionOS zu tun hat. Ich vermute, dass visionOS im Shared Space Passthrough, die virtuelle Umgebung und den vorhandenen Fensterinhalt rendert und zusammensetzt, bevor Apps überhaupt CPU- oder GPU-Zeit erhalten. Wenn also ein Systemthread oder die App nicht rechtzeitig abgeschlossen wird, wird einfach das, was bereits zusammengesetzt ist, auf die Anzeige verschoben. Die Kernel-zu-Photon-Kontrolle über die Hardware und Software ist für andere Gerätekategorien einigermaßen nützlich, aber für XR ist sie wohl unerlässlich und ermöglicht es Apple, einen Grad an Feinschliff zu erreichen, von dem Android-Forker nur träumen können.

Seltsamerweise scheint jedoch eine Sache unter visionOS schlecht zu funktionieren: das Scrollen durch die App-Liste. Es scheint jedoch, dass die Framerate der Animation einfach niedrig ist und kein echtes Leistungsproblem darstellt.

Gastmodus und Teilbarkeit

Wenn Sie Vision Pro vorführen oder teilen möchten, müssen Sie den Gastmodus aktivieren, bevor Sie das Headset übergeben. Und jedes Mal, wenn Sie den Gastmodus verwenden, muss die andere Person die Eye-Tracking-Kalibrierung durchführen, was etwa eine Minute dauert.

Es ist unglaublich ärgerlich, die Kalibrierung nicht in einem Benutzerkonto speichern zu können. Wie das iPad unterstützt Apple Vision Pro nicht mehrere Benutzerkonten. Beim iPad handelt es sich eindeutig nur um eine benutzerfeindliche Entscheidung, die versucht, jedem Familienmitglied seine eigene Funktionalität zu verkaufen existiert in der Geschäfts- und Bildungsversion von iPadOS. Bei Vision Pro gibt es eher eine Rechtfertigung, da die Lichtdichtung und die Kopfbänder auf Ihr spezielles Gesicht abgestimmt sind und man argumentieren könnte, dass das Teilen eines Headsets nicht besonders hygienisch wäre. Aber es wäre schön, wenn Apple Paaren oder Freunden, die bereit sind, ein zweites Lichtsiegel zu kaufen, einen zweiten Account ermöglichen würde. Das OpticID-Authentifizierungssystem bedeutet, dass visionOS nicht einmal den zusätzlichen Entsperrschritt benötigt, der in Meta Quest erscheint, wenn Sie ein zweites Konto hinzufügen.

Eine sehr nützliche Funktion des Gastmodus besteht jedoch darin, dass Sie beim Aktivieren aufgefordert werden, ein AirPlay-Ziel auszuwählen. Wenn Sie dies tun, beginnt das Headset mit der Übertragung, sobald die Person es aufsetzt. Ich würde gerne sehen, dass andere Headset-Hersteller einen Gastmodus hinzufügen, der das Casting automatisch startet und über eine vereinfachte Benutzeroberfläche verfügt. Eine ärgerliche Eigenart ist jedoch, dass Sie beim AirPlay-Casting keine urheberrechtlich geschützten Videos wie Filme oder sogar Apple Immersive Videos ansehen können. Auf Quest werden diese Art von Videos in der Cast-Ansicht schwarz angezeigt, auf Vision Pro jedoch auch für den Headset-Träger schwarz.

Filme & Fernsehsendungen

Analysten spekulierten jahrelang darüber, wann und wie Apple einen Fernseher auf den Markt bringen würde, und mit Vision Pro ist dies praktisch geschehen. Der Haken daran ist natürlich, dass nur eine Person im Raum es sehen kann. Aber schon heute schauen Teenager und Studenten Filme und Serien allein in ihrem Zimmer auf dem Fernseher, Laptop oder Tablet, ebenso Singles jeden Alters und jeder Situation in ihrem Wohnzimmer und Reisende in Hotels und Flugzeugen.

Die Auflösung, Farben und der Kontrast der Micro-OLED-Panels auf der Größe eines virtuellen Bildschirms, den visionOS zaubern kann, machen Vision Pro zu einer unglaublichen Möglichkeit, Filme und Fernsehsendungen anzusehen. Auf meinem Heimflug von New York saß ich auf einem Economy-Sitz, konnte mir aber Filme besser ansehen als alle anderen in der ersten Klasse.

Und während das 2D-Seherlebnis bereits großartig ist, sind die 3D-Inhalte umwerfend gut. Dies ist nicht das schwache, verschwommene und die Augen ermüdende 3D, das Sie in Kinos oder auf 3D-Fernsehern gesehen haben. Das ist echtes, perfektes 3D, das die gleiche Lebendigkeit traditioneller Inhalte beibehält. Es ist ohne Kompromisse besser als 2D. Ich war von 3D-Filmen auf Vision Pro so beeindruckt, dass ich jetzt das Gefühl habe, dass etwas fehlt, wenn ich auf einer beliebigen Plattform zu 2D-Inhalten zurückkehre. Ich könnte mir vorstellen, dass Headsets dieses Format im Laufe des nächsten Jahrzehnts wiederbeleben, wie es Vision Pro bereits zu tun beginnt.

Da keine zusätzliche Hardware erforderlich ist, ist die Funktion eines tragbaren Riesenfernsehers das, was Vision Pro am besten kann, und es macht durchaus Sinn, dass sich ein Großteil des Marketings von Apple auf diesen Anwendungsfall konzentriert.

Abgesehen vom Komfort besteht die einzige Einschränkung hier darin, dass Sie, wie bei allen VR-Optiken, in kontrastreichen Szenarien wie einem hellen Film in einer dunklen Umgebung Blendungen sehen werden. Mit einer helleren Umgebung können Sie dies etwas abmildern.

Ich habe schon oft Leute sagen hören: „Das geht schon mit Quest!“, aber das stimmt einfach nicht – zumindest nicht rechtlich. Quest verfügt über keine integrierte Möglichkeit, Filme auszuleihen oder herunterzuladen, und keine Apps im Store bieten das Herunterladen oder 3D an. Es gibt eine Netflix VR-App, für deren Verwendung jedoch Controller erforderlich sind, keine Downloads unterstützt werden und nur 480p gestreamt werden. Es gibt auch eine Peacock-App, die jedoch im Wesentlichen nur eine Verknüpfung zur Website darstellt und daher auch keine Downloads unterstützt. Um legal Filme auf Quest herunterzuladen, müssen Sie die Android-Telefon-APKs von Netflix oder Amazon Prime Video von Ihrem Computer herunterladen. Allerdings verfügt keiner dieser Dienste über 3D-Inhalte und Netflix streamt nur 576p. Es ist nicht so, dass Quest als Hardware für diesen Anwendungsfall nicht geeignet wäre, sondern dass Meta einfach nicht die Software dafür anbietet. Meta (damals Facebook) verfügte bereits zu Gear VR- und Go-Zeiten über einen eigenen Verleihdienst für 3D-Filme, stellte ihn dann jedoch um die Einführung von Quest herum ein, um stattdessen eine Partner-App von Vudu auf den Markt zu bringen. Letztes Jahr wurde dann auch das geschlossen. Diese Art von chaotischem strategischem Umdenken kommt im Apple-Ökosystem einfach nicht vor.

iPad Apps

Die Möglichkeit, einen großen Prozentsatz der iPad-Apps herunterzuladen und auszuführen, ist einer der größten Vorteile des Apple Vision Pro als allgemeines Computergerät gegenüber jedem vorhandenen Standalone-Headset. Ich konnte zum Beispiel Slack und Trello für die Arbeit herunterladen, Amazon Prime Video zum Ansehen von Filmen, die ich bereits besitze oder auf die ich Zugriff habe, und Steam Link, um meine PC-Spiele auf einem riesigen virtuellen Bildschirm zu spielen.

Es stimmt zwar, dass Sie auf Quest und Pico über den Webbrowser auf viele dieser Dienste zugreifen können, aber das ist eine aufwändigere und weniger ausgefeilte Lösung. Native Apps sind in manchen Anwendungsfällen nach wie vor die Vorreiterrolle, und zwar aus den gleichen Gründen, aus denen Menschen sie immer noch auf ihrem Telefon, Tablet und sogar PC statt nur im Browser nutzen.

Der CTO von Meta sagte, er habe Google gebeten, seinen Play Store auf Quest-Headsets zu bringen, was die überwiegende Mehrheit der Android-Tablet- und Telefon-Apps auf Quest hätte bringen können. Aber Google habe nein gesagt, behauptete er. Dies liegt möglicherweise daran, dass Google diesen Vorteil für seine eigene Spatial-Computing-Plattform behalten möchte, die es für das kommende Headset von Samsung entwickelt.

Obwohl es großartig ist, Zugriff darauf zu haben, funktionieren nicht alle iPad-Apps gut mit dem Eye-Tracking-Cursor. Wenn Sie beispielsweise in Amazon Prime Video in die Mitte des Bildschirms schauen, werden die rechteckigen Berührungszielgrenzen der unsichtbaren Wiedergabetaste hervorgehoben. Das ist so ablenkend, dass ich schockiert bin, dass Apple Prime Video offiziell bewirbt und empfiehlt, und die einzige Lösung, die ich finden konnte, war die Verwendung einer Barrierefreiheitsfunktion, um die Eye-Tracking-Steuerung vorübergehend zu deaktivieren.

Das andere Problem besteht darin, dass einige Entwickler wichtiger Apps sich dagegen entschieden haben, diese auf visionOS verfügbar zu machen. Beispielsweise hat Google alle seine Apps, einschließlich YouTube, Gmail und Fotos, deaktiviert, während Netflix, Spotify und Snapchat ihre äußerst beliebten Plattformen ebenfalls nicht mehr verfügbar gemacht haben. Snapchat ist ein interessantes Beispiel, weil es eine Webversion gibt, aber weil Safari auf visionOS auf der iPad-Version basiert, werden Sie auf der Website von Snap lediglich zum Herunterladen der iPad-App weitergeleitet, was nicht möglich ist.

„Spatial Computing“ und Mac-Integration

Ich habe in diesem Testbericht darauf verzichtet, Apples Beschreibung des Vision Pro als „Raumcomputer“ zu verwenden. Die Debatte um die Frage, was genau ein „Computer“ ausmacht, tobt seit fast einem Jahrzehnt in der gesamten Technologiebranche, insbesondere nach der Einführung des iPad Pro, für das Apple bekannt ist vermarktet mit einem „Was ist ein Computer?“ Slogan.

Trotz des Marketings von Apple entscheiden sich die meisten Profis auch heute noch für Mac oder Windows, weil sie dort die leistungsstarke Software finden, die sie benötigen. Wie beim iPad Pro finden Sie XCode, Visual Studio oder Unity auf Vision Pro nicht, sodass Sie damit keine Apps erstellen können. Auch Adobe Premiere, After Effects, Photoshop oder Illustrator werden Sie nicht finden. Was einen „Computer“ in der Praxis wirklich von anderen Geräten unterscheidet, ist die Fähigkeit, professionell zu erstellen und nicht nur zu konsumieren. Und aus rechnerischer Sicht ist Vision Pro so, als hätte man ein iPad Pro mit einer Reihe externer Monitore. Das ist in Ordnung, wenn Ihre Arbeit vollständig webbasiert ist. Alles, was Sie auf einem Chromebook tun können, können Sie in Vision Pro viel besser machen. Dazu gehört tatsächlich der Großteil meiner eigenen Arbeit, und ich finde es toll, wie gut ich mit Vision Pro von meinem Sofa oder sogar meinem Bett aus schreiben kann. Für komplexere Aufgaben benötigen Sie jedoch einen echten Computer.

Es scheint theoretisch möglich, dass Apple visionOS eines Tages die Möglichkeit geben könnte, macOS-Apps auszuführen. Und für 3500 Dollar hätte es das eigentlich schon sein sollen. Aber im Moment können Sie Vision Pro nur als tragbaren Monitor für Ihren vorhandenen Mac verwenden.

Bei einem MacBook verläuft dieser Vorgang so reibungslos, dass er wie von Zauberhand wirkt. Im Gegensatz zu anderen eigenständigen Headsets muss keine Streamer-Software installiert, keine Einstellung aktiviert und keine „App“ auf dem Headset installiert werden. Sie sehen eine schwebende „Verbinden“-Eingabeaufforderung über dem Display. Wenn Sie darauf blicken und kneifen, schaltet sich Ihr MacBook-Bildschirm aus und darüber erscheint ein riesiger virtueller Bildschirm. Wenn diese Aufforderung nicht angezeigt wird oder Sie einen Desktop-Mac verwenden, können Sie im Kontrollzentrum auf diese Funktion zugreifen.

Die Streaming-Qualität ist ausgezeichnet und die Latenz fühlt sich geringer an als bei jedem drahtlosen Remote-Desktop, den ich je ausprobiert habe. Dies ist wahrscheinlich auf die Vorteile zurückzuführen, die Apple durch die umfassende Kontrolle der Hardware und Software auf beiden Geräten bietet. Es scheint über Wi-Fi Direct zu funktionieren, ohne dass ein lokales Netzwerk erforderlich ist, sodass Sie es überall und auch dann verwenden können, wenn Ihr Router weit entfernt ist. Und das Mac-Display läuft im Shared Space, sodass Sie parallel dazu iPad- und visionOS-Apps verwenden können.

(Aufnahmen von Apple)

Allerdings ist diese Mac-Unterstützung recht begrenzt. Es unterstützt nur ein Display, d. h. es unterstützt weder reale noch virtuelle Zusatzdisplays. Das ist einigermaßen amüsant, da Sie auf Quest Metas Horizon Workrooms verwenden können, um Ihr MacBook in ein Drei-Monitor-Setup zu verwandeln, wobei die beiden Seitenmonitore vollständig virtuell sind. Idealerweise würde ich gerne die Möglichkeit haben, einzelne macOS-Apps vom Bildschirm zu lösen und im Raum zu positionieren. Es wird interessant sein zu sehen, wie sich diese Funktion in zukünftigen visionOS- und macOS-Updates weiterentwickelt.

Was die Windows-Unterstützung betrifft, ist diese natürlich nicht integriert, aber Sie können im App Store Lösungen von Drittanbietern wie Steam Link oder Parsec verwenden. Um es klar auszudrücken: Ich spreche hier von der Betrachtung eines virtuellen Monitors, nicht von immersiver VR. Lesen Sie weiter, um mehr darüber zu erfahren.

Gaming

Der primäre Anwendungsfall von Meta Quest ist die größte Schwäche von Apple Vision Pro.

Superhot, Gorilla Tag, Population One, Resident Evil 4 VR oder Asgard's Wrath 2 finden Sie hier nicht. Ich war überrascht und etwas amüsiert, als ich feststellte, dass ein großer Prozentsatz der „für Vision Pro entwickelten“ Spiele einfach in einem schwebenden Fenster laufen, da es sich im Wesentlichen nur um iPad-Spiele mit gelegentlichen räumlichen Elementen handelt. Und um es klarzustellen: Es handelt sich um Gelegenheitsspiele für Mobilgeräte. Während Vision Pro Gamepads unterstützt, wurden die AAA-Titel, die auf iPads mit M-Serie-Chips kamen, wie Assassin's Creed Mirage, Death Stranding und Resident Evil, von der Veröffentlichung im visionOS App Store ausgeschlossen.

Die meisten Vision Pro-Spiele laufen in einem schicken Fenster mit gelegentlichen, aber seltenen räumlichen Elementen. (Aufnahmen von Apple)

Zum Zeitpunkt des Verfassens dieses Artikels gibt es auf Vision Pro weniger als 10 wirklich räumliche Spiele, d. h. Spiele, bei denen Sie tatsächlich dreidimensional mit virtuellen Objekten interagieren, die nicht in einem Rechteck oder Kreis enthalten sind. Dazu gehören Synth Riders, Super Fruit Ninja, Game Room, What The Golf und Lego Builder's Journey.

- Synth Riders auf visionOS unterscheidet sich geringfügig von der Version mit verfolgten Controllern auf anderen immersiven Plattformen, das Kern-Gameplay ist jedoch sehr ähnlich. Dies ist Apples Beat Sabre-Äquivalent oder kommt ihm zumindest am nächsten.

- Super Fruit Ninja ähnelt eher der berühmten mobilen Version als der Fruit Ninja VR-Serie. Es findet im Passthrough statt und Sie streichen Obst mit Ihren Händen.

- Game Room ist ein optimierter Tabletop-Simulator der Entwickler von Demeo, der Hearts, Chess und Battleship umfasst

- What The Golf ist ein Tischspiel, bei dem Sie mit Handgesten einen Minigolfball (oder manchmal auch einen Schläger) durch einen Minigolfplatz schleudern.

- Lego Builder's Journey ist ein Tabletop-Spiel, bei dem Sie Miniatursteine platzieren, um den Bau fertigzustellen, ähnlich wie beim Lösen eines Puzzles.

Game Room auf Apple Vision Pro (Filmmaterial von Apple)

Von diesen räumlichen Spielen erfordern nur „Synth Riders“ und „Super Fruit Ninja“ das Aufstehen und die aktive Bewegung, während der Rest langsam vorgeht und sitzt.

Super Fruit Ninja (Filmmaterial von Apple)

Was das aktive Spielerlebnis bei Vision Pro so viel schlechter macht als bei Meta Quest, ist die Qualität der Skeletthandverfolgung und das Fehlen verfolgter Controller.

Aus irgendeinem Grund steht Spieleentwicklern nur ein Handverfolgungsskelett mit sehr niedriger Aktualisierungsrate zur Verfügung, wodurch sich das Schlagen von Blöcken in Super Fruit Ninja und Synth Riders träge und reaktionslos anfühlt. Was dies so seltsam macht, ist, dass das System eindeutig in der Lage ist, die Handverfolgung mit einer viel höheren Aktualisierungsrate durchzuführen, was deutlich wird, wenn Sie Ihre Hände zum Bewegen von Fenstern im Shared Space verwenden. In diesem Zusammenhang fühlt sich die Handverfolgung von Vision Pro der von Quest 3 überlegen an, in Spielen fühlt sie sich jedoch deutlich schlechter an. Was ist denn hier los?

Synth Riders auf Vision Pro (Filmmaterial von Apple)

Und unabhängig davon, wie gut die Handverfolgung ist, schränkt der Mangel an getrackten Controllern die Möglichkeiten der Entwickler erheblich ein, und der Mangel an haptischem Feedback ist sehr offensichtlich. Es ist einfach viel befriedigender, in Beat Sabre auf die Blöcke zu schlagen, während man tatsächlich etwas hält und jeden Schlag spürt, als in Synth Riders auf Vision Pro mit den Händen in der Luft zu wedeln.

Zusammenfassend lässt sich sagen, dass Apple Vision Pro kein Headset für Gamer ist, und wenn Sie es kaufen, um Spiele zu spielen, werden Sie höchstwahrscheinlich schwer enttäuscht sein.

Ich würde viel, viel lieber Walkabout Minigolf spielen als dieses. (Aufnahmen von Apple)

Ein weiterer interessanter Unterschied zwischen Spielen auf Quest und Vision Pro ist das Preismodell. Bei Quest kaufen Sie die Spiele meistens direkt, je nach Titel zwischen 5 und 60 US-Dollar. Es gibt jedoch ein Quest+-Abonnement für 8 US-Dollar pro Monat, das Ihnen zwei Spiele pro Monat gewährt, die Sie behalten, solange Sie das Abonnement behalten. Bei Vision Pro sind bisher fast alle Spiele über den Abonnementdienst Apple Arcade erhältlich, der 2 US-Dollar pro Monat kostet. Sie besitzen diese Spiele nicht wirklich, sondern leihen sie nur, obwohl es sich um Job Simulator und Vacation Simulator handelt eingestellt sind um diesem Trend zu widerstehen. Ob Sie dies bevorzugen oder nicht, hängt von Ihrer eigenen Meinung zum Kauf im Vergleich zum Abonnement ab.

Job Simulator kommt zu Apple Vision Pro

Job Simulator und Vacation Simulator kommen zu Apple Vision Pro.

Oh, und wenn Sie Vision Pro als SteamVR-Headset unter Windows verwenden möchten, können Sie dies bereits tun, wenn Sie ein registrierter Apple-Entwickler mit einem Mac sind und mit der Kompilierung vertraut sind ALVR visionOS-Port von der Quelle.

Virtual Desktop und iVRy arbeiten an PC-VR-Streaming-Apps für den visionOS Store, aber bis dahin wird es bestenfalls noch Monate dauern und Apple hat die Genehmigung für beides noch nicht bestätigt.

Virtual Desktop und iVRy erstellen beide für Apple Vision Pro

Virtual Desktop und iVRy arbeiten beide mit Apple Vision Pro-Ports für das drahtlose Streaming von VR von Ihrem Gaming-PC.

Beachten Sie jedoch, dass Sie bei keiner dieser Lösungen standardmäßig viele SteamVR-Spiele spielen können. Die meisten SteamVR-Inhalte erwarten verfolgte Controller, und Vision Pro enthält oder unterstützt keine. Sie könnten SteamVR-Tracking-Basisstationen und Index-Controller hinzufügen und ein Tool wie verwenden OpenVR-Weltraumkalibrator um sie manuell auszurichten. Aber diese Ausrüstung würde Sie etwa 600 US-Dollar kosten, wenn Sie sie nicht bereits besitzen, und die Ausrichtung müsste jedes Mal durchgeführt werden. Wenn Sie dazu nicht bereit sind, könnte sich Vision Pro dennoch als hervorragendes Headset für die Verwendung mit nicht verfolgten Eingabegeräten erweisen, wie z. B. Rennlenkrädern für Sim-Racing oder HOTAS-Setups für Flugsimulatoren.

Immersives Apple-Video

Immersive Videos, 180-Grad- oder 360-Grad-Inhalte, die Sie teilweise oder vollständig umgeben, sind seit der Samsung Gear VR 2014 und sogar Google Cardboard ein Hauptaugenmerk von VR-Headsets. Aber eines hatten fast alle gemeinsam: Sie waren scheiße. Die Auflösung war oft schlecht, die 3D-Skalierung stimmte nicht und fast alle hatten eine fürchterlich auffällige Blockierung bei der Komprimierung.

Über seinen Abonnementdienst Apple TV+, der 10 US-Dollar pro Monat kostet, bietet Apple immersive Dokumentationen mit „Apple Immersive Video“, also 8K-180-Grad-3D-Videos mit HEVC-Kodierung, an und streamt sie mit hohen Bitraten. Im Moment ist der Katalog:

- Prähistorischer Planet Immersive: eine Serie des preisgekrönten Regisseurs Jon Favreau, die auf seiner bestehenden traditionellen Apple TV+-Serie Prehistoric Planet basiert.

- Abenteuer: Eine Serie, die Extremsportler bei verschiedenen Herausforderungen auf der ganzen Welt begleitet. Die erste Folge konzentriert sich auf das Highlining.

- Wildes Leben: a Serie, die Sie direkt neben einige der einzigartigsten Tiere der Erde bringt, erzählt von Experten. Die erste Folge konzentriert sich auf Nashörner.

- Alicia Keys Proberaum: ein kurzer Dokumentarfilm, der einen Blick hinter die Kulissen einer Alicia Keys-Probensitzung bietet.

Die Videoqualität dieser Dokumentationen übertrifft jedes gestreamte 180-Grad-3D-Video, das ich je ausprobiert habe, und wird nur von vorab heruntergeladenen Versionen der Felix & Paul-Inhalte auf Quest übertroffen. Die Skalierung ist nahezu perfekt und es ist kein Komprimierungsartefakt in Sicht. Dies ist ein deutliches Lob für die Streaming-Qualität von Meta in seiner Meta Quest TV-App, die im selben Wi-Fi-Netzwerk im Vergleich dazu klobig aussieht. Apple Immersive Video ist so gut, dass es meine Einstellung zu gestreamten immersiven Videos von Ablehnung zu Begeisterung verändert hat. Ich kann es kaum erwarten zu sehen, welche weiteren Inhalte in diesem Format entstehen. Vision Pro ist offenbar auch in der Lage, 12K-Videos zu dekodieren, sodass die Qualität in Zukunft noch besser werden könnte.

Mein einziger Kritikpunkt an Apple Immersive Video ist, dass ich mir gewünscht hätte, dass es mindestens 270 Grad und nicht nur 180 Grad wäre, da ich oft zur Seite schaue und der schwarze Balken das Eintauchen erheblich beeinträchtigt.

Es gibt auch eine weitere App namens AmazeVR, die immersive Konzerte von T-Pain, Zara Larson und UPSAHL anbietet. Mit Konzerten meine ich nicht Streams von echten Konzerten – es handelt sich um individuelle Erlebnisse, bei denen 180-Grad-Kameraaufnahmen mit gerenderten Hintergründen kombiniert werden. Es ist auch auf Quest und Pico verfügbar, aber auf den Displays von Vision Pro glänzt es wirklich.

Raumvideos

Die andere Art von Videoinhalts-Headsets, die sich besonders gut zum Ansehen eignen, sind normale rechteckige stereoskopische 3D-Videos.

Apple nennt stereoskopische 3D-Videos „Spatial Video“, aber an der Implementierung von Apple ist nichts Besonderes, außer dass die beiden Ansichten in separaten Streams einer HEVC-Datei aufgezeichnet werden, anstatt sie einfach nebeneinander oder übereinander zu speichern.

Das iPhone 15 Pro zeichnet jetzt „räumliche“ 3D-Videos für Vision Pro auf

Mit iOS 17.2 kann das iPhone 15 Pro jetzt 3D-„Spatial Video“ aufnehmen, um es in Apple Vision Pro anzusehen.

Seit Version 15, die im November als Betaversion und im Dezember öffentlich veröffentlicht wurde, können die beiden iPhone 17.2 Pro-Modelle räumliche Videos aufnehmen.

Das Ansehen von mit dem iPhone aufgenommenen räumlichen Videos hätte ein einzigartiges Feature für Apple Vision Pro sein können, aber die Entwickler stahl seinen Donner durch die Veröffentlichung von iPhone-Apps, mit denen Sie sie in SBS 3D konvertieren können, um sie auf jedem vorhandenen Headset anzusehen, und zwar diesen Monat Meta hat die Fähigkeit hinzugefügt zum einfachen Synchronisieren räumlicher iPhone-Videos mit Quest zum Ansehen. Da mit dem iPhone aufgenommene räumliche Videos nur 1080p SDR haben, gibt es keinen großen Unterschied zwischen der Wiedergabe auf einem Quest 500 für 3 US-Dollar und der Wiedergabe auf einem Vision Pro für 3500 US-Dollar.

Eine Sache, die Quest 3 jedoch nicht kann, zumindest nicht ohne Änderungen an der Entwickler-Befehlszeile, ist die Aufnahme räumlicher Videos. Apple Vision Pro ist nicht nur ein 3D-Viewer, es ist eine 3D-Kamera. Während das iPhone ein Seitenverhältnis von 16:9 bei 1920 x 1080 aufnimmt, nimmt Vision Pro Videos im quadratischen Seitenverhältnis von 1:1 bei 2200 x 2200 auf. Beide erreichen nur 30 FPS, was bei jeder Art von Bewegung eine spürbare Einschränkung darstellt.

Personas und FaceTime

Personas sind Apples realistische virtuelle Avatare in visionOS. Sie erstellen Ihre Persona, indem Sie Vision Pro vor sich halten, damit es Ihr Gesicht scannt, während Sie verschiedene Gesichtsausdrücke machen. Dieser Vorgang dauert insgesamt etwa eine Minute.

Nach der Generierung wird Ihre Persona in Echtzeit von den Augen- und Gesichtsverfolgungssensoren sowie der Handverfolgung des Headsets gesteuert. Ihre Persona wird in jeder iPad- oder iPhone-App angezeigt, die die Selfie-Kamera anfordert, sowie in visionOS-Apps, die Personas integrieren, wie z. B. FaceTime.

Was in FaceTime auf Vision Pro wirklich gut gelungen ist, ist die Möglichkeit zum Teilen. Sie können Ihre Egoperspektive, einschließlich Passthrough, sowie Dateien wie Bilder und sogar 3D-Modelle teilen, die der Empfänger mit einem Fingertipp in seinem Bereich öffnen kann. Es erinnert mich daran, dass Meta auf Quest eine integrierte kleine App für informelle Hangouts schmerzlich vermisst. Horizon Workrooms ist zu reibungslos und formell und basiert auf der gemeinsamen Nutzung Ihres PCs und nicht auf der nativen Nutzung von Quest allein.

Aber derzeit sind Personas auf visionOS darauf beschränkt, in einem rechteckigen Fenster angezeigt zu werden, als wäre es eine 3D-Webcam-Ansicht. Für mich geht dabei das verloren, was die Geselligkeit in VR so großartig macht: der gemeinsame Koordinatenraum. Wenn Sie sich auf anderen Headsets in einer sozialen VR-Plattform befinden, sehen Sie nur eine Cartoon-Version der anderen Person, ja, aber wenn sie in derselben 3D-Umgebung wie Sie existiert, entsteht ein Gefühl sozialer Präsenz, das schwer zu beschreiben oder zu glauben ist, bis Sie es selbst tun Versuch es selber. Sie können auf Objekte zeigen, jemandem etwas geben oder Gruppentreffen auf eine Weise durchführen, die mit dem Webcam-Raster-Ansatz, den FaceTime auf Apple Vision Pro emuliert, einfach nicht möglich ist. Und die Vorteile eines gemeinsamen Koordinatenraums verstärken sich, je mehr Personen Sie haben.

Glücklicherweise arbeitet Apple auch an „Spatial Personas“, die außerhalb von Fenstern existieren können und virtuelle Treffen mit einem gemeinsamen Koordinatenraum wie bestehende VR-Avatarsysteme ermöglichen. Es ist eines der wenigen Updates, die Apple ausdrücklich für die Zeit nach der Veröffentlichung bestätigt hat, und ich kann es kaum erwarten, es auszuprobieren.

Okay, das ist meine Meinung zur Verwendung von Vision Pro zur Kommunikation mit anderen Headset-Trägern, aber wie wäre es mit der Verwendung Ihrer Persona für FaceTime mit Menschen in der Außenwelt, die Telefone oder Webcams verwenden? Das Tolle an FaceTime auf Vision Pro ist die Sicht auf die andere Person. Sie können es so groß machen, dass es der Größe seines echten Kopfes entspricht – ein viel fesselnderes Erlebnis, als es auf einem winzigen Rechteck in Ihrer Hand zu sehen. Aber das Schreckliche an FaceTime auf Vision Pro ist die Sicht, die die andere Person auf Sie hat. Personas sind eine unglaublich beeindruckende Technologie, wenn man bedenkt, wie schnell sie generiert werden können und wie gut sie auf einem eigenständigen Headset funktionieren. Aber sie bleiben tief im unheimlichen Tal, und die Reaktionen der Menschen, die Sie über FaceTime erreichen, reichen von Lachen bis hin zu Schock und Ekel.

Reisemodus

Während ich Vision Pro inzwischen Dutzende und Aberdutzende von Stunden verwendet habe, hatte ich, als ich es zum ersten Mal in New York in die Hand nahm, nur ein paar Stunden Zeit, um es in einem stationären Gebäude zu verwenden. Nur ein paar Stunden später bestieg ich einen Flug nach Hause, wo ich etwa sechs der acht Stunden damit verbrachte, Vision Pro zu tragen, angeschlossen an die Steckdose des Sitzes.

(Aufnahmen von Apple)

Um das Erlebnis vergleichen zu können, habe ich das Gleiche tatsächlich mit meinem Quest 3 auf dem Flug gemacht zu New York. Wann immer das Flugzeug seine Höhe, seine Geschwindigkeit oder seine Richtung änderte, flogen alle virtuellen Elemente in die entgegengesetzte Richtung davon, und wenn Turbulenzen herrschten, bebte alles heftig. Um Quest 3 praktisch auf dem Flug nutzen zu können, musste ich die Positionsverfolgung deaktivieren, wodurch auch Passthrough deaktiviert wird. Meta arbeitet an einem Reisemodus für Quest, aber derzeit handelt es sich um ein reines VR-Headset auf Flügen.

Warum funktioniert die visuelle Inside-Out-Verfolgung bei Flugzeugen nicht standardmäßig?

Man denkt oft, dass markerlose Inside-Out-Tracking-Systeme auf Headsets, Brillen und Self-Tracking-Controllern nur die Kameras nutzen, aber das ist nicht der Fall. Diese Systeme basieren ebenso auf der Inertialmesseinheit (IMU), einem Chip, der einen winzigen Beschleunigungsmesser und ein Gyroskop enthält.

Während Kameras typischerweise mit 30 Hz oder 60 Hz laufen, liefert die IMU typischerweise Updates um 1000 Hz, was eine deutlich geringere Latenz ermöglicht. Allerdings kann eine IMU keine absolute Bewegung erfassen – zumindest nicht direkt. Der Beschleunigungsmesser in der IMU misst jedoch die Beschleunigung relativ zur Schwerkraft, und Sie können das Integral der Beschleunigung über die Zeit bilden, um die Geschwindigkeit zu ermitteln. Und wenn Sie erneut das Integral dieser Geschwindigkeitswerte über die Zeit bilden, erhalten Sie eine Verschiebung von der ursprünglichen Position.

Dieser Vorgang wird Koppelnavigation genannt. Von Moment zu Moment verfolgt jedes Headset und jeder Controller sich selbst, und die optischen Komponenten wie Kameras oder Laserbasisstationen werden nur verwendet, um den kumulativen Fehler zu korrigieren, der durch das Rauschen der IMU-Daten verursacht wird. Aber in einem sich bewegenden Fahrzeug wie einem Flugzeug erfasst der Beschleunigungsmesser die Beschleunigung des Fahrzeugs selbst und geht davon aus, dass sich das Headset selbst bewegt, was zu plötzlichen und schnellen Positionsabweichungen führt.

Apple Vision Pro hingegen verfügt bereits über einen Reisemodus, der überraschend gut funktioniert. Einige Branchenveteranen hatten dies zuvor für unmöglich erklärt, und doch funktioniert es. Es handelt sich nicht um einen 3DoF-Modus, die Positionsverfolgung bleibt bestehen, allerdings ist die Verfolgungsqualität schlechter als üblich, mit leichtem Jitter und Drift.

Obwohl Apple nicht genau bekannt gegeben hat, wie der Reisemodus funktioniert, vermute ich, dass er dafür sorgt, dass die Verfolgung entweder vollständig oder größtenteils von den Kameras abhängt und kaum oder gar keine Eingaben vom Beschleunigungsmesser in der IMU erfolgen.

Ein Hinweis darauf, dass diese Erklärung wahr ist, ist, dass sie Sie davor warnt, aus dem Fenster zu schauen. Probieren Sie dies aus und es kommt zu erheblichen Abweichungen, da das visuelle System nicht mehr über kontrastreiche Merkmale in der Nähe verfügt, die als Referenz dienen könnten.

Fazit: Und für wen genau ist Vision Pro geeignet?

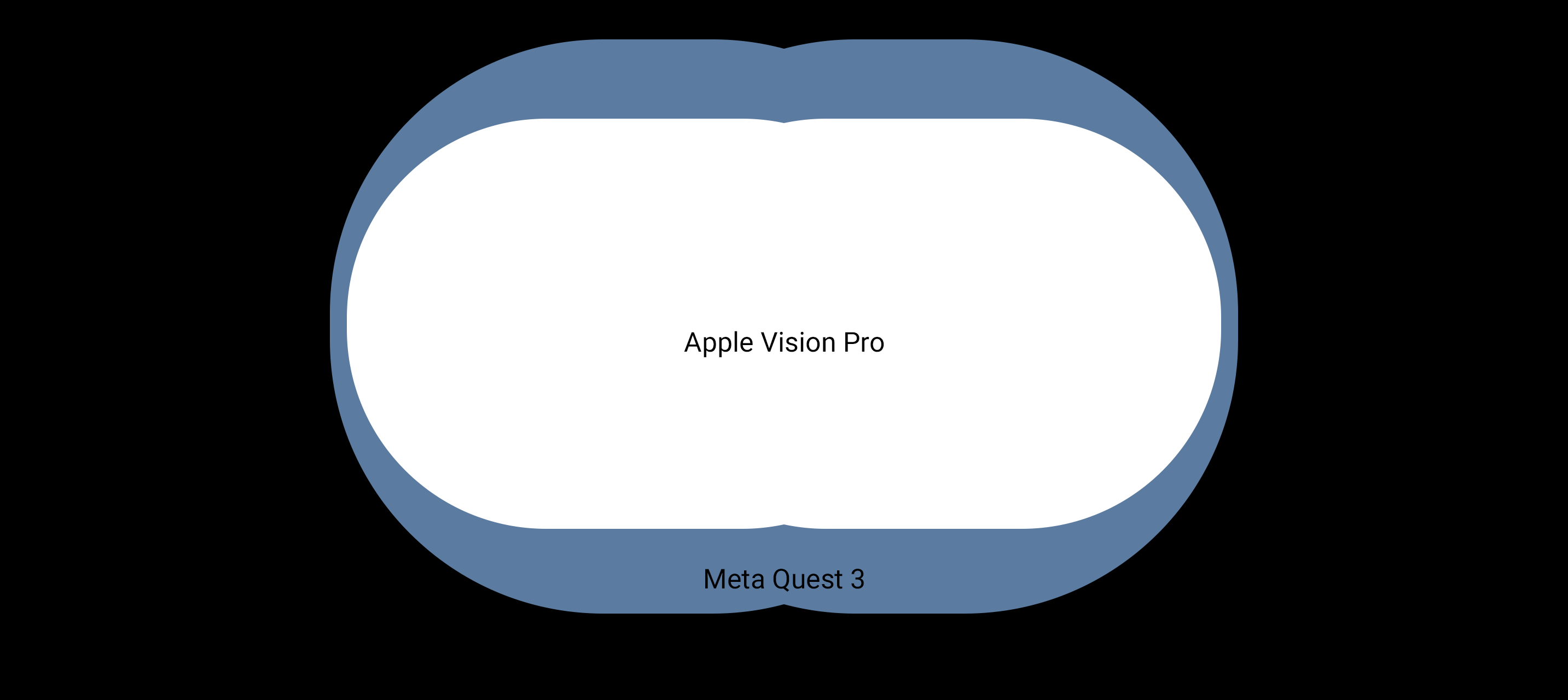

Ich habe in diesem Test viel Zeit damit verbracht, Apple Vision Pro mit Meta Quest 3 zu vergleichen. Ich habe dies getan, weil es das einzige vergleichbare Consumer-Gerät ist, das derzeit ausgeliefert wird. Aber während Vision Pro als Headset im Wesentlichen nur ein aufgemotztes Quest 3 ist – in dem Sinne, dass es sich bei beiden um etwa ein halbes Kilogramm schwere Headsets mit zwei durch Pancake-Linsen vergrößerten Displays handelt, die Ihnen die reale Welt durch Kameras zeigen –, sind es Software und Inhalt Der Fokus, die Batteriearchitektur und das Fehlen von Controllern machen es zu einem ganz anderen Produkt, das wohl nicht einmal ein direkter Konkurrent ist.

Quest-Headsets haben einen florierenden XR-Markt rund um die Anwendungsfälle immersiver Gaming-, Fitness- und Social-VR-Plattformen geschaffen. Apple Vision Pro bietet noch nichts davon und seine Hardware ist auch nicht dafür ausgelegt. Aber es macht andere Dinge, die Quest entweder überhaupt nicht oder nicht gut genug kann, um von Bedeutung zu sein.