المصدر rawpixel.com

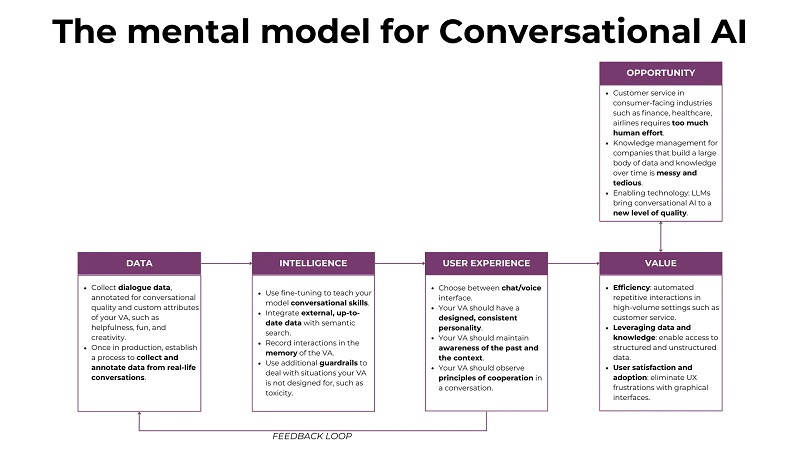

الذكاء الاصطناعي للمحادثة هو أحد تطبيقات LLM التي أثارت الكثير من الضجة والاهتمام بسبب قابليتها للتوسع عبر العديد من الصناعات وحالات الاستخدام. في حين أن أنظمة المحادثة موجودة منذ عقود، فقد جلبت LLMs دفعة الجودة التي كانت مطلوبة لاعتمادها على نطاق واسع. في هذه المقالة، سوف نستخدم النموذج العقلي الموضح في الشكل 1 لتحليل تطبيقات الذكاء الاصطناعي للمحادثة (راجع: بناء منتجات الذكاء الاصطناعي بنموذج عقلي شامل لمقدمة للنموذج العقلي). بعد النظر في فرص السوق والقيمة التجارية لأنظمة الذكاء الاصطناعي للمحادثة، سنشرح "الآلات" الإضافية من حيث البيانات، وضبط ماجستير إدارة الأعمال، وتصميم المحادثة التي يجب إعدادها لجعل المحادثات ليست ممكنة فحسب، بل مفيدة أيضًا وممتعة.

1. الفرصة، والقيمة، والقيود

تم تصميم تصميم تجربة المستخدم التقليدي حول عدد كبير من عناصر تجربة المستخدم المصطنعة، والتمريرات السريعة، والصنابير، والنقرات، مما يتطلب منحنى تعليمي لكل تطبيق جديد. باستخدام الذكاء الاصطناعي للمحادثة، يمكننا التخلص من هذا الانشغال، واستبداله بالتجربة الأنيقة لمحادثة تتدفق بشكل طبيعي حيث يمكننا نسيان الانتقالات بين التطبيقات والنوافذ والأجهزة المختلفة. نحن نستخدم اللغة، وهي بروتوكولنا العالمي والمألوف للتواصل، للتفاعل مع مختلف المساعدين الافتراضيين (VAs) وإنجاز مهامنا.

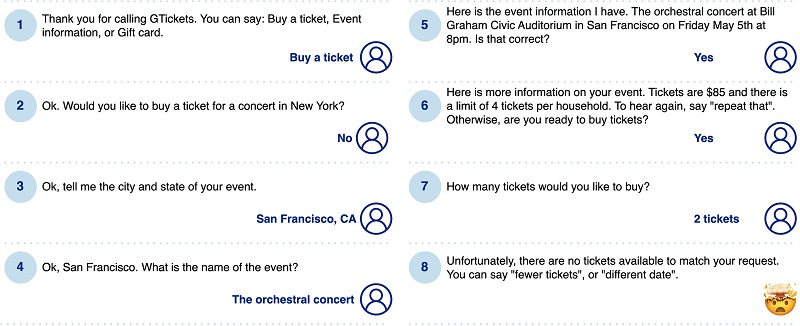

واجهات المستخدم للمحادثة ليست بالضبط الأشياء الساخنة الجديدة. لقد كانت أنظمة الاستجابة الصوتية التفاعلية (IVRs) وروبوتات الدردشة موجودة منذ التسعينيات، وقد أعقب التقدم الكبير في البرمجة اللغوية العصبية (NLP) عن كثب موجات من الأمل والتطوير لواجهات الصوت والدردشة. ومع ذلك، قبل وقت ماجستير إدارة الأعمال، تم تنفيذ معظم الأنظمة في النموذج الرمزي، بالاعتماد على القواعد والكلمات الرئيسية وأنماط المحادثة. وكانت تقتصر أيضًا على مجال محدد ومحدد مسبقًا من "الكفاءة"، وسرعان ما سيصل المستخدمون الذين يغامرون خارج هذا المجال إلى طريق مسدود. بشكل عام، كانت هذه الأنظمة مليئة بنقاط الفشل المحتملة، وبعد عدة محاولات محبطة، لم يعد العديد من المستخدمين إليها أبدًا. ويوضح الشكل التالي مثالاً للحوار. المستخدم الذي يريد طلب تذاكر لحفل موسيقي معين يمر بصبر عبر عملية استجواب مفصلة، فقط ليكتشف في النهاية أن الحفل قد بيع بالكامل.

وباعتبارها تقنية تمكينية، يمكن لـ LLMs الارتقاء بواجهات المحادثة إلى مستويات جديدة من الجودة ورضا المستخدم. يمكن لأنظمة المحادثة الآن أن تعرض معرفة عالمية أوسع بكثير والكفاءة اللغوية والقدرة على المحادثة. من خلال الاستفادة من النماذج المدربة مسبقًا، يمكن أيضًا تطويرها في فترات زمنية أقصر بكثير حيث تم الآن استبدال العمل الشاق المتمثل في تجميع القواعد والكلمات الرئيسية وتدفقات الحوار بالمعرفة الإحصائية لماجستير القانون. دعونا نلقي نظرة على تطبيقين بارزين حيث يمكن للذكاء الاصطناعي التحادثي أن يوفر قيمة على نطاق واسع:

- دعم العملاء وبشكل أعم، التطبيقات التي يستخدمها عدد كبير من المستخدمين الذين غالبًا ما يقدمون طلبات مماثلة. هنا، تتمتع الشركة التي تقدم دعم العملاء بميزة معلوماتية واضحة على المستخدم ويمكنها الاستفادة من ذلك لإنشاء تجربة مستخدم أكثر سهولة ومتعة. خذ بعين الاعتبار حالة إعادة حجز الرحلة. بالنسبة لي، باعتباري مسافرًا متكررًا إلى حد ما، فهذا شيء يحدث 1-2 مرات في السنة. وفي المنتصف، أميل إلى نسيان تفاصيل العملية، ناهيك عن واجهة المستخدم الخاصة بشركة طيران معينة. على النقيض من ذلك، فإن دعم العملاء في شركة الطيران لديه طلبات إعادة الحجز في مقدمة ومركز عملياتهم. بدلاً من الكشف عن عملية إعادة الحجز عبر واجهة رسومية معقدة، يمكن "إخفاء" منطقها عن العملاء الذين يتصلون بالدعم، ويمكنهم استخدام اللغة كقناة طبيعية لإجراء إعادة الحجز. وبطبيعة الحال، سيظل هناك "ذيل طويل" من الطلبات الأقل شهرة. على سبيل المثال، تخيل تقلبًا مزاجيًا عفويًا يدفع عميلة الأعمال إلى إضافة كلبها المحبوب كأمتعة زائدة إلى رحلة محجوزة. يمكن تمرير هذه الطلبات الفردية الإضافية إلى الوكلاء البشريين أو تغطيتها عبر نظام إدارة المعرفة الداخلي المتصل بالمساعد الافتراضي.

- إدارة المعرفة والتي ترتكز على كمية كبيرة من البيانات. بالنسبة للعديد من الشركات الحديثة، تعد المعرفة الداخلية التي تتراكم على مدار سنوات من التشغيل والتكرار والتعلم أحد الأصول الأساسية والتمييز - إذا تم تخزينها وإدارتها والوصول إليها بطريقة فعالة. نظرًا لوجود ثروة من البيانات المخفية في أدوات التعاون، والمواقع الويكي الداخلية، وقواعد المعرفة، وما إلى ذلك، غالبًا ما يفشلون في تحويلها إلى معرفة قابلة للتنفيذ. عندما يغادر الموظفون، يتم تعيين موظفين جدد، ولا تتوصل أبدًا إلى الانتهاء من صفحة التوثيق التي بدأتها قبل ثلاثة أشهر، وتقع المعرفة القيمة ضحية للإنتروبيا. لقد أصبح من الصعب أكثر فأكثر العثور على طريقة عبر متاهة البيانات الداخلية والحصول على أجزاء من المعلومات المطلوبة في موقف عمل معين. وهذا يؤدي إلى خسائر فادحة في الكفاءة للعاملين في مجال المعرفة. لمعالجة هذه المشكلة، يمكننا تعزيز LLMs بالبحث الدلالي على مصادر البيانات الداخلية. تسمح LLMs باستخدام أسئلة اللغة الطبيعية بدلاً من الاستعلامات الرسمية المعقدة لطرح الأسئلة على قاعدة البيانات هذه. وبالتالي يمكن للمستخدمين التركيز على احتياجاتهم من المعلومات بدلاً من التركيز على بنية قاعدة المعرفة أو بناء جملة لغة الاستعلام مثل SQL. ولأنها تعتمد على النصوص، تعمل هذه الأنظمة مع البيانات في مساحة دلالية غنية، مما يؤدي إلى إنشاء روابط ذات معنى "تحت الغطاء".

خارج مجالات التطبيق الرئيسية هذه، هناك العديد من التطبيقات الأخرى، مثل الرعاية الصحية عن بعد، ومساعدي الصحة العقلية، وروبوتات الدردشة التعليمية، التي يمكنها تبسيط تجربة المستخدم وتحقيق القيمة لمستخدميها بطريقة أسرع وأكثر كفاءة.

إذا كان هذا المحتوى التعليمي المتعمق مفيدًا لك ، فيمكنك ذلك اشترك في القائمة البريدية لأبحاث الذكاء الاصطناعي ليتم تنبيهنا عندما نصدر مادة جديدة.

2. البيانات

لم يتم تدريب LLMs في الأصل على المشاركة في محادثات قصيرة بطلاقة أو محادثات أكثر جوهرية. وبدلاً من ذلك، يتعلمون إنشاء الرمز المميز التالي في كل خطوة استدلال، مما يؤدي في النهاية إلى نص متماسك. يختلف هذا الهدف المنخفض المستوى عن التحدي المتمثل في المحادثة البشرية. تعد المحادثة أمرًا بديهيًا بشكل لا يصدق بالنسبة للبشر، ولكنها تصبح معقدة ودقيقة بشكل لا يصدق عندما تريد تعليم الآلة القيام بذلك. على سبيل المثال، دعونا نلقي نظرة على المفهوم الأساسي للنوايا. عندما نستخدم اللغة، فإننا نفعل ذلك لغرض محدد، وهو هدفنا التواصلي - يمكن أن يكون نقل المعلومات، أو التواصل الاجتماعي، أو مطالبة شخص ما بفعل شيء ما. في حين أن الأولين واضحان إلى حد ما بالنسبة لـ LLM (طالما أنه رأى المعلومات المطلوبة في البيانات)، فإن الأخير يمثل تحديًا أكبر بالفعل. لا يحتاج LLM فقط إلى دمج المعلومات ذات الصلة وتنظيمها بطريقة متماسكة، ولكنه يحتاج أيضًا إلى تحديد النغمة العاطفية الصحيحة فيما يتعلق بالمعايير الناعمة مثل الشكلية والإبداع والفكاهة وما إلى ذلك. وهذا يمثل تحديًا لتصميم المحادثة (راجع القسم 5)، والذي يرتبط ارتباطًا وثيقًا بمهمة إنشاء بيانات الضبط الدقيق.

يعد الانتقال من توليد اللغة الكلاسيكية إلى التعرف على أغراض تواصلية محددة والاستجابة لها خطوة مهمة نحو سهولة الاستخدام وقبول أنظمة المحادثة بشكل أفضل. كما هو الحال بالنسبة لجميع مساعي الضبط الدقيق، يبدأ ذلك بتجميع مجموعة البيانات المناسبة.

يجب أن تكون بيانات الضبط الدقيق قريبة قدر الإمكان من توزيع البيانات الواقعية (المستقبلية). أولا، يجب أن تكون بيانات المحادثة (الحوار). ثانيًا، إذا كان مساعدك الافتراضي متخصصًا في مجال معين، فيجب عليك محاولة تجميع بيانات الضبط الدقيق التي تعكس المعرفة الضرورية بالمجال. ثالثًا، إذا كانت هناك تدفقات وطلبات نموذجية ستتكرر بشكل متكرر في تطبيقك، كما في حالة دعم العملاء، فحاول دمج أمثلة متنوعة لها في بيانات التدريب الخاصة بك. يعرض الجدول التالي نموذجًا لبيانات الضبط الدقيق للمحادثة من مجموعة بيانات محادثات 3K لـ ChatBot، وهو متاح مجانًا على Kaggle:

يمكن أن يصبح إنشاء بيانات المحادثة يدويًا مهمة باهظة الثمن - فالتعهيد الجماعي واستخدام LLMs لمساعدتك في إنشاء البيانات هما طريقتان للتوسيع. بمجرد جمع بيانات الحوار، يجب تقييم المحادثات والتعليق عليها. يتيح لك ذلك عرض الأمثلة الإيجابية والسلبية لنموذجك ودفعه نحو التقاط خصائص المحادثات "الصحيحة". يمكن أن يتم التقييم إما بالدرجات المطلقة أو بترتيب الخيارات المختلفة بين بعضها البعض. يؤدي النهج الأخير إلى بيانات أكثر دقة، لأن البشر عادةً ما يكونون أفضل في تصنيف الخيارات المتعددة بدلاً من تقييمها بشكل منفصل.

مع وجود بياناتك في مكانها الصحيح، تصبح جاهزًا لضبط النموذج الخاص بك وإثرائه بإمكانيات إضافية. في القسم التالي، سننظر في الضبط الدقيق ودمج المعلومات الإضافية من الذاكرة والبحث الدلالي، وربط الوكلاء بنظام المحادثة الخاص بك لتمكينه من تنفيذ مهام محددة.

3. تجميع نظام المحادثة

يتم إنشاء نظام محادثة نموذجي باستخدام وكيل محادثة يقوم بتنسيق وتنسيق مكونات وقدرات النظام، مثل LLM والذاكرة ومصادر البيانات الخارجية. يعد تطوير أنظمة الذكاء الاصطناعي للمحادثة مهمة تجريبية وتجريبية للغاية، وسيكون المطورون لديك في حالة تنقل مستمر بين تحسين بياناتك، وتحسين استراتيجية الضبط الدقيق، والتلاعب بالمكونات والتحسينات الإضافية، واختبار النتائج . سيقوم أيضًا أعضاء الفريق غير الفنيين، بما في ذلك مديري المنتجات ومصممي تجربة المستخدم، باختبار المنتج بشكل مستمر. واستنادًا إلى أنشطة اكتشاف العملاء الخاصة بهم، فإنهم في وضع رائع لتوقع أسلوب ومحتوى محادثة المستخدمين في المستقبل ويجب عليهم المساهمة بهذه المعرفة بشكل فعال.

3.1 تدريس مهارات المحادثة للماجستير في القانون الخاص بك

من أجل الضبط الدقيق، تحتاج إلى بيانات الضبط الدقيق الخاصة بك (راجع القسم 2) وماجستير في القانون مُدرب مسبقًا. يعرف طلاب ماجستير اللغة بالفعل الكثير عن اللغة والعالم، والتحدي الذي يواجهنا هو تعليمهم مبادئ المحادثة. في الضبط الدقيق، تكون المخرجات المستهدفة عبارة عن نصوص، وسيتم تحسين النموذج لإنشاء نصوص مشابهة قدر الإمكان للأهداف. لإجراء الضبط الدقيق الخاضع للإشراف، تحتاج أولاً إلى تحديد مهمة الذكاء الاصطناعي للمحادثة التي تريد أن يؤديها النموذج، وجمع البيانات، وتشغيلها وتكرارها خلال عملية الضبط الدقيق.

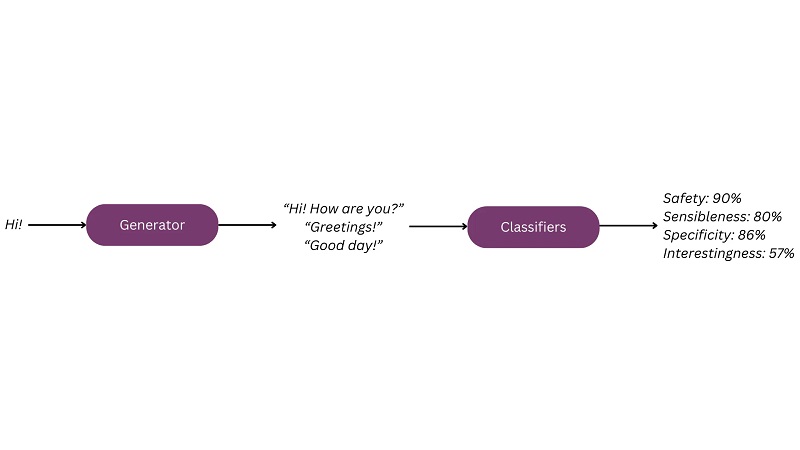

مع الضجيج المحيط ببرامج LLM، ظهرت مجموعة متنوعة من أساليب الضبط الدقيق. للحصول على مثال تقليدي إلى حد ما لضبط المحادثة، يمكنك الرجوع إلى وصف نموذج LaMDA.[1] تم ضبط LaMDA بدقة على خطوتين. أولاً، يتم استخدام بيانات الحوار لتعليم مهارات المحادثة النموذجية (الضبط الدقيق "التوليدي"). بعد ذلك، يتم استخدام التسميات التي ينتجها المفسرون أثناء تقييم البيانات لتدريب المصنفين الذين يمكنهم تقييم مخرجات النموذج وفقًا للسمات المرغوبة، والتي تشمل المعقولية، والنوعية، والإثارة، والسلامة (الضبط الدقيق "التمييزي"). يتم بعد ذلك استخدام هذه المصنفات لتوجيه سلوك النموذج نحو هذه السمات.

بالإضافة إلى ذلك، فإن الأسس الواقعية - القدرة على تأسيس مخرجاتهم على معلومات خارجية موثوقة - هي سمة مهمة لحاملي ماجستير إدارة الأعمال. لضمان الأسس الواقعية وتقليل الهلوسة، تم ضبط LaMDA بدقة باستخدام مجموعة بيانات تتضمن استدعاء نظام استرجاع معلومات خارجي كلما كانت هناك حاجة إلى معرفة خارجية. وهكذا، تعلم النموذج أولاً استرداد المعلومات الواقعية كلما قام المستخدم بإجراء استعلام يتطلب معرفة جديدة.

أسلوب الضبط الشائع الآخر هو تعزيز التعلم من ردود الفعل البشرية (RLHF) [2]. يقوم RLHF "بإعادة توجيه" عملية التعلم الخاصة بـ LLM من مهمة التنبؤ بالرمز التالي المباشرة والمصطنعة نحو تعلم التفضيلات البشرية في موقف تواصلي معين. يتم ترميز هذه التفضيلات البشرية مباشرة في بيانات التدريب. أثناء عملية التعليق التوضيحي، تُعرض على البشر مطالبات ويقومون إما بكتابة الاستجابة المطلوبة أو ترتيب سلسلة من الاستجابات الموجودة. يتم بعد ذلك تحسين سلوك LLM ليعكس التفضيل البشري.

3.2 إضافة البيانات الخارجية والبحث الدلالي

بالإضافة إلى تجميع المحادثات لتحسين النموذج، قد ترغب في تحسين نظامك ببيانات متخصصة يمكن الاستفادة منها أثناء المحادثة. على سبيل المثال، قد يحتاج نظامك إلى الوصول إلى بيانات خارجية، مثل براءات الاختراع أو الأوراق العلمية، أو بيانات داخلية، مثل ملفات تعريف العملاء أو المستندات الفنية الخاصة بك. ويتم ذلك عادة عن طريق البحث الدلالي (المعروف أيضًا باسم توليد الاسترجاع المعزز، أو RAG)[3]. يتم حفظ البيانات الإضافية في قاعدة بيانات في شكل تضمينات دلالية (راجع. هذا المقال لشرح التضمينات ومراجع أخرى). عندما يأتي طلب المستخدم، تتم معالجته مسبقًا وتحويله إلى تضمين دلالي. يحدد البحث الدلالي بعد ذلك المستندات الأكثر صلة بالطلب ويستخدمها كسياق للموجه. من خلال دمج البيانات الإضافية مع البحث الدلالي، يمكنك تقليل الهلوسة وتقديم استجابات أكثر فائدة ومرتكزة على الحقائق. من خلال التحديث المستمر لقاعدة بيانات التضمين، يمكنك أيضًا تحديث المعرفة واستجابات نظامك دون إعادة تشغيل عملية الضبط الدقيق باستمرار.

3.3 الوعي بالذاكرة والسياق

تخيل الذهاب إلى حفلة ومقابلة المحامي بيتر. تشعر بالحماس وتبدأ في الترويج لروبوت الدردشة القانوني الذي تخطط حاليًا لبنائه. يبدو بيتر مهتمًا، ويميل نحوك، أومئ برأسه. في مرحلة ما، تريد الحصول على رأيه بشأن ما إذا كان يرغب في استخدام تطبيقك. بدلًا من عبارة إعلامية من شأنها أن تعوض بلاغتك، تسمع: “أوم… ماذا كان يفعل هذا التطبيق مرة أخرى؟”

يفترض عقد التواصل غير المكتوب بين البشر أننا نستمع إلى شركائنا في المحادثة ونبني أفعالنا الكلامية على السياق الذي نشارك في إنشائه أثناء التفاعل. وفي البيئات الاجتماعية، فإن ظهور هذا الفهم المشترك هو ما يميز المحادثة المثمرة والمثرية. في الإعدادات الأكثر دنيوية مثل حجز طاولة مطعم أو شراء تذكرة قطار، يعد ذلك ضرورة مطلقة لإنجاز المهمة وتوفير القيمة المتوقعة للمستخدم. يتطلب هذا أن يعرف مساعدك تاريخ المحادثة الحالية، ولكن أيضًا المحادثات السابقة - على سبيل المثال، لا ينبغي أن يطلب الاسم والتفاصيل الشخصية الأخرى للمستخدم مرارًا وتكرارًا عندما يبدأ محادثة.

أحد التحديات التي تواجه الحفاظ على الوعي بالسياق هو حل المرجع الأساسي، أي فهم الكائنات التي تتم الإشارة إليها بالضمائر. يستخدم البشر بشكل حدسي الكثير من الإشارات السياقية عندما يفسرون اللغة - على سبيل المثال، يمكنك أن تسأل طفلًا صغيرًا، "من فضلك أخرج الكرة الخضراء من الصندوق الأحمر وأحضرها لي"، وسيعرف الطفل أنك تقصد الكرة ، وليس الصندوق. بالنسبة للمساعدين الافتراضيين، يمكن أن تكون هذه المهمة صعبة إلى حد ما، كما هو موضح في الحوار التالي:

مساعد: شكرًا، سأقوم الآن بحجز رحلتك. هل ترغب أيضًا في طلب وجبة لرحلتك؟

مستخدم: امم... هل يمكنني أن أقرر لاحقًا ما إذا كنت أريد ذلك؟

مساعد: عذرًا، لا يمكن تغيير هذه الرحلة أو إلغاؤها لاحقًا.

وهنا يفشل المساعد في التعرف على الضمير it من المستخدم لا يشير إلى الرحلة، بل إلى الوجبة، مما يتطلب تكرارًا آخر لإصلاح سوء الفهم هذا.

3.4 حواجز حماية إضافية

بين الحين والآخر، حتى أفضل حاملي شهادة الماجستير في القانون سوف يسيئون التصرف ويهلوسون. في كثير من الحالات، تعتبر الهلوسة مشكلة تتعلق بالدقة، وعليك أن تتقبل أنه لا يوجد ذكاء اصطناعي دقيق بنسبة 100%. بالمقارنة مع أنظمة الذكاء الاصطناعي الأخرى، فإن "المسافة" بين المستخدم والذكاء الاصطناعي صغيرة نوعًا ما بين المستخدم والذكاء الاصطناعي. يمكن أن تتحول مشكلة الدقة البسيطة بسرعة إلى شيء يُنظر إليه على أنه سام أو تمييزي أو ضار بشكل عام. بالإضافة إلى ذلك، نظرًا لأن LLMs ليس لديهم فهم متأصل للخصوصية، فيمكنهم أيضًا الكشف عن البيانات الحساسة مثل معلومات التعريف الشخصية (PII). يمكنك العمل ضد هذه السلوكيات باستخدام حواجز حماية إضافية. تتيح لك أدوات مثل Guardrails AI وRebuff وNeMo Guardrails وMicrosoft Guidance إمكانية إزالة المخاطر عن نظامك من خلال صياغة متطلبات إضافية على مخرجات LLM وحظر المخرجات غير المرغوب فيها.

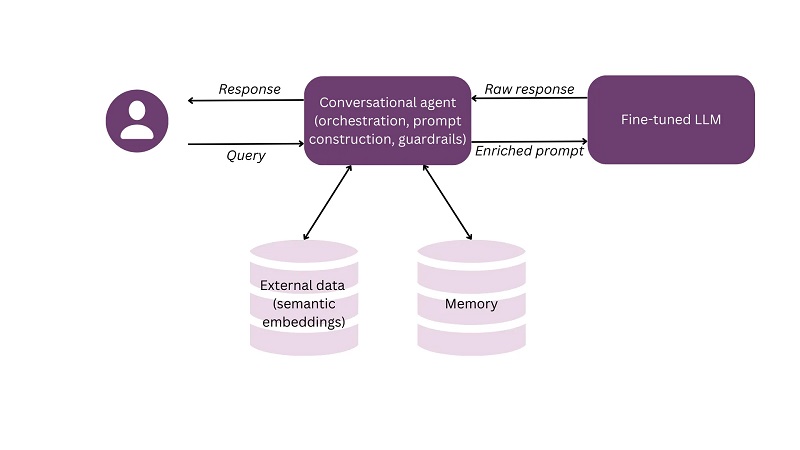

هناك بنيات متعددة ممكنة في الذكاء الاصطناعي للمحادثة. يُظهر المخطط التالي مثالًا بسيطًا لكيفية دمج LLM المضبوط جيدًا والبيانات الخارجية والذاكرة بواسطة وكيل المحادثة، والذي يكون مسؤولًا أيضًا عن الإنشاء الفوري وحواجز الحماية.

4. تجربة المستخدم وتصميم المحادثة

يكمن سحر واجهات المحادثة في بساطتها وتجانسها عبر التطبيقات المختلفة. إذا كان مستقبل واجهات المستخدم هو أن جميع التطبيقات تبدو متشابهة إلى حد ما، فهل مهمة مصمم تجربة المستخدم محكوم عليها بالفشل؟ بالتأكيد لا - المحادثة هي فن يجب تدريسه لمدرس LLM الخاص بك حتى يتمكن من إجراء محادثات مفيدة وطبيعية ومريحة للمستخدمين. يظهر تصميم المحادثة الجيد عندما نجمع بين معرفتنا بعلم النفس البشري واللغويات وتصميم تجربة المستخدم. فيما يلي، سنأخذ في الاعتبار أولاً خيارين أساسيين عند إنشاء نظام محادثة، وهما ما إذا كنت ستستخدم الصوت و/أو الدردشة، بالإضافة إلى السياق الأكبر لنظامك. بعد ذلك، سننظر إلى المحادثات نفسها، ونرى كيف يمكنك تصميم شخصية مساعدك أثناء تعليمه المشاركة في محادثات مفيدة وتعاونية.

4.1 الصوت مقابل الدردشة

يمكن تنفيذ واجهات المحادثة باستخدام الدردشة أو الصوت. باختصار، أصبح الصوت أسرع بينما تتيح الدردشة للمستخدمين الحفاظ على خصوصيتهم والاستفادة من وظائف واجهة المستخدم الغنية. دعنا نتعمق قليلاً في الخيارين لأن هذا هو أحد القرارات الأولى والأكثر أهمية التي ستواجهها عند إنشاء تطبيق محادثة.

للاختيار بين البديلين، ابدأ بالنظر في الإعداد الفعلي الذي سيتم استخدام تطبيقك فيه. على سبيل المثال، لماذا تعتمد معظم أنظمة المحادثة في السيارات، مثل تلك التي تقدمها شركة Nuance Communications، على الصوت؟ لأن يدي السائق مشغولة بالفعل ولا يمكنهم التبديل باستمرار بين عجلة القيادة ولوحة المفاتيح. وينطبق هذا أيضًا على الأنشطة الأخرى مثل الطهي، حيث يرغب المستخدمون في البقاء على اطلاع على تدفق أنشطتهم أثناء استخدام تطبيقك. السيارات والمطابخ هي في الغالب إعدادات خاصة، بحيث يمكن للمستخدمين تجربة متعة التفاعل الصوتي دون القلق بشأن الخصوصية أو إزعاج الآخرين. على النقيض من ذلك، إذا كان سيتم استخدام تطبيقك في مكان عام مثل المكتب أو المكتبة أو محطة القطار، فقد لا يكون الصوت هو خيارك الأول.

بعد فهم الوضع المادي، فكر في الجانب العاطفي. يمكن استخدام الصوت عمدًا لنقل النغمة والمزاج والشخصية - هل يضيف هذا قيمة إلى سياقك؟ إذا كنت تنشئ تطبيقك لقضاء وقت الفراغ، فقد يزيد الصوت من عامل المرح، في حين يمكن لمساعد الصحة العقلية أن يستوعب المزيد من التعاطف ويسمح للمستخدم الذي قد يعاني من الاضطرابات بنطاق أكبر من التعبير. على النقيض من ذلك، إذا كان تطبيقك سيساعد المستخدمين في بيئة احترافية مثل التداول أو خدمة العملاء، فإن التفاعل النصي الأكثر مجهولًا قد يساهم في اتخاذ قرارات أكثر موضوعية ويوفر عليك متاعب تصميم تجربة عاطفية مفرطة.

كخطوة تالية، فكر في الوظيفة. تتيح لك الواجهة النصية إثراء المحادثات بالوسائط الأخرى مثل الصور وعناصر واجهة المستخدم الرسومية مثل الأزرار. على سبيل المثال، في مساعد التجارة الإلكترونية، سيكون التطبيق الذي يقترح المنتجات عن طريق نشر صورها وأوصافها المنظمة أكثر سهولة في الاستخدام من التطبيق الذي يصف المنتجات عبر الصوت وربما يوفر معرفاتها.

أخيرًا، دعنا نتحدث عن تحديات التصميم والتطوير الإضافية لبناء واجهة مستخدم صوتية:

- هناك خطوة إضافية للتعرف على الكلام تحدث قبل معالجة مدخلات المستخدم باستخدام LLMs ومعالجة اللغات الطبيعية (NLP).

- يعد الصوت وسيلة اتصال أكثر شخصية وعاطفية - وبالتالي، فإن متطلبات تصميم شخصية متسقة ومناسبة وممتعة خلف مساعدك الافتراضي أعلى، وستحتاج إلى مراعاة عوامل إضافية من "تصميم الصوت" مثل الجرس والتوتر والنبرة وسرعة التحدث.

- يتوقع المستخدمون أن تستمر محادثتك الصوتية بنفس سرعة المحادثة البشرية. لتقديم تفاعل طبيعي عبر الصوت، تحتاج إلى زمن استجابة أقصر بكثير من الدردشة. في المحادثات البشرية، تبلغ الفجوة النموذجية بين المنعطفات 200 مللي ثانية - وهذه الاستجابة السريعة ممكنة لأننا نبدأ في تكوين أدوارنا أثناء الاستماع إلى خطاب شريكنا. سيحتاج مساعدك الصوتي إلى التوافق مع هذه الدرجة من الطلاقة في التفاعل. على النقيض من ذلك، بالنسبة لروبوتات الدردشة، فإنك تتنافس مع فترات زمنية تبلغ ثوانٍ، حتى أن بعض المطورين يقدمون تأخيرًا إضافيًا لجعل المحادثة تبدو وكأنها محادثة مكتوبة بين البشر.

- يعد الاتصال عبر الصوت عملية خطية تتم لمرة واحدة - إذا لم يحصل المستخدم على ما قلته، فستكون في حلقة توضيح مملة وعرضة للأخطاء. وبالتالي، يجب أن تكون دوراتك موجزة وواضحة وغنية بالمعلومات قدر الإمكان.

إذا اخترت الحل الصوتي، فتأكد من أنك لا تفهم المزايا بوضوح مقارنة بالدردشة فحسب، بل تأكد أيضًا من أنك تتمتع بالمهارات والموارد اللازمة لمواجهة هذه التحديات الإضافية.

4.2 أين سيعيش الذكاء الاصطناعي للمحادثة؟

الآن، دعونا نفكر في السياق الأكبر الذي يمكنك من خلاله دمج الذكاء الاصطناعي للمحادثة. نحن جميعًا على دراية ببرامج الدردشة الآلية الموجودة على مواقع الشركات - تلك الأدوات الموجودة على يمين شاشتك والتي تظهر عندما نفتح موقع الويب الخاص بالشركة. شخصيًا، في أغلب الأحيان، يكون رد فعلي البديهي هو البحث عن زر الإغلاق. لماذا هذا؟ من خلال المحاولات الأولية "للتحدث" مع هذه الروبوتات، تعلمت أنها لا تستطيع تلبية متطلبات معلومات أكثر تحديدًا، وفي النهاية، ما زلت بحاجة إلى التمشيط عبر موقع الويب. العظة من القصة؟ لا تقم ببناء برنامج chatbot لأنه رائع وعصري، بل قم بإنشائه لأنك متأكد من أنه يمكن أن يخلق قيمة إضافية لمستخدميك.

إلى جانب الأداة المثيرة للجدل على موقع الشركة على الويب، هناك العديد من السياقات المثيرة لدمج برامج الدردشة الأكثر عمومية التي أصبحت ممكنة مع LLMs:

- مساعدو الطيارين: يقوم هؤلاء المساعدون بإرشادك وتقديم النصح لك خلال عمليات ومهام محددة، مثل GitHub CoPilot للبرمجة. عادةً ما يكون مساعدو الطيارين "مرتبطين" بتطبيق معين (أو بمجموعة صغيرة من التطبيقات ذات الصلة).

- البشر الاصطناعية (أيضًا البشر الرقميون): هذه المخلوقات "تحاكي" البشر الحقيقيين في العالم الرقمي. إنهم يبدون ويتصرفون ويتحدثون مثل البشر، وبالتالي يحتاجون أيضًا إلى قدرات محادثة غنية. غالبًا ما يتم استخدام البشر الاصطناعيين في التطبيقات الغامرة مثل الألعاب والواقع المعزز والافتراضي.

- التوائم الرقمية: التوائم الرقمية هي "نسخ" رقمية من العمليات والأشياء في العالم الحقيقي، مثل المصانع أو السيارات أو المحركات. يتم استخدامها لمحاكاة وتحليل وتحسين تصميم وسلوك الكائن الحقيقي. تسمح تفاعلات اللغة الطبيعية مع التوائم الرقمية بوصول أكثر سلاسة وتنوعًا إلى البيانات والنماذج.

- قواعد بيانات: في الوقت الحاضر، تتوفر البيانات حول أي موضوع، سواء كان ذلك توصيات استثمارية، أو مقتطفات من التعليمات البرمجية، أو مواد تعليمية. ما يكون صعبًا في كثير من الأحيان هو العثور على البيانات المحددة التي يحتاجها المستخدمون في موقف معين. تكون الواجهات الرسومية لقواعد البيانات إما شديدة الحبيبات أو مغطاة بعناصر واجهة مستخدم للبحث والتصفية لا نهاية لها. لا يمكن الوصول إلى لغات الاستعلام المتنوعة مثل SQL وGraphQL إلا للمستخدمين ذوي المهارات المقابلة. تسمح حلول المحادثة للمستخدمين بالاستعلام عن البيانات باللغة الطبيعية، في حين يقوم برنامج LLM الذي يعالج الطلبات بتحويلها تلقائيًا إلى لغة الاستعلام المقابلة (راجع: هذا المقال للحصول على شرح لـ Text2SQL).

4.3 طبع شخصية على مساعدك

كبشر، نحن مجبرون على التجسيم، أي إضفاء سمات بشرية إضافية عندما نرى شيئًا يشبه الإنسان بشكل غامض. تعد اللغة واحدة من أكثر القدرات الفريدة والرائعة للبشرية، وسوف ترتبط منتجات المحادثة تلقائيًا بالبشر. سوف يتخيل الأشخاص شخصًا خلف شاشتهم أو أجهزتهم - ومن الممارسات الجيدة عدم ترك هذا الشخص المحدد لخيال المستخدمين، بل إعطائه شخصية متسقة تتماشى مع منتجك وعلامتك التجارية. تسمى هذه العملية "تصميم الشخصية".

الخطوة الأولى لتصميم الشخصية هي فهم سمات الشخصية التي ترغب في أن تظهرها شخصيتك. من الناحية المثالية، يتم ذلك بالفعل على مستوى بيانات التدريب - على سبيل المثال، عند استخدام RLHF، يمكنك أن تطلب من المعلقين تصنيف البيانات وفقًا لسمات مثل المساعدة، والأدب، والمرح، وما إلى ذلك، من أجل انحياز النموذج نحو الخصائص المطلوبة. يمكن مطابقة هذه الخصائص مع سمات علامتك التجارية لإنشاء صورة متسقة تعمل باستمرار على الترويج لعلامتك التجارية من خلال تجربة المنتج.

بالإضافة إلى الخصائص العامة، يجب عليك أيضًا التفكير في كيفية تعامل مساعدك الافتراضي مع مواقف محددة تتجاوز "الطريق السعيد". على سبيل المثال، كيف ستستجيب لطلبات المستخدمين التي تتجاوز نطاقها، وكيف سترد على الأسئلة المتعلقة بها، وتتعامل مع اللغة المسيئة أو المبتذلة؟

من المهم تطوير إرشادات داخلية واضحة حول شخصيتك يمكن استخدامها من قبل معلقي البيانات ومصممي المحادثات. سيسمح لك هذا بتصميم شخصيتك بطريقة هادفة والحفاظ على اتساقها عبر فريقك وبمرور الوقت، حيث يخضع تطبيقك لتكرارات وتحسينات متعددة.

4.4 جعل المحادثات مفيدة مع "مبدأ التعاون"

هل كان لديك انطباع بأنك تتحدث إلى جدار من الطوب بينما كنت تتحدث بالفعل مع إنسان؟ في بعض الأحيان، نجد أن شركاء المحادثة لدينا غير مهتمين بقيادة المحادثة إلى النجاح. ولحسن الحظ، في معظم الحالات، تكون الأمور أكثر سلاسة، وسوف يتبع البشر بشكل حدسي "مبدأ التعاون" الذي قدمه فيلسوف اللغة بول جريس. وفقًا لهذا المبدأ، فإن البشر الذين يتواصلون بنجاح مع بعضهم البعض يتبعون أربعة ثوابت، وهي الكمية والنوعية والملاءمة والطريقة.

الحد الأقصى للكمية

إن مبدأ الكمية يطلب من المتحدث أن يكون غني بالمعلومات وأن يقدم مساهمته بالمعلومات كما هو مطلوب. ومن ناحية المساعد الافتراضي، فهذا يعني أيضًا تحريك المحادثة للأمام بشكل فعال. على سبيل المثال، خذ بعين الاعتبار هذا المقتطف من تطبيق أزياء للتجارة الإلكترونية:

مساعد: ما نوع الملابس التي تبحث عنها؟

مستخدم: أنا أبحث عن فستان باللون البرتقالي.

المساعد: لا: آسف، ليس لدينا فساتين برتقالية في الوقت الراهن.

افعل: آسف، ليس لدينا فساتين باللون البرتقالي، ولكن لدينا هذا الفستان الرائع والمريح للغاية باللون الأصفر: ...

يأمل المستخدم في ترك تطبيقك مع عنصر مناسب. إن إيقاف المحادثة بسبب عدم وجود عناصر تناسب الوصف الدقيق يقتل احتمالية النجاح. ومع ذلك، إذا قدم تطبيقك اقتراحات حول عناصر بديلة، فسيبدو ذلك أكثر فائدة ويترك خيار التفاعل الناجح مفتوحًا.

خاصة في التفاعلات الصوتية، من المهم إيجاد التوازن الصحيح بين توفير جميع المعلومات التي قد يحتاجها المستخدم لتحقيق النجاح مع عدم إغراقه بالمعلومات غير الضرورية التي قد تحجب التفاعل.

مكسيم الجودة

إن مبدأ الجودة يطلب من المتحدثين أن يكونوا صادقين وألا يقولوا أشياء يعتقدون أنها كاذبة أو يفتقرون إلى الأدلة الكافية بشأنها. هناك الكثير من الذاتية والاعتقاد الشخصي هنا - وبالتالي، لا يمكن عرض هذا المبدأ بشكل مباشر على LLMs. كما رأينا، يميل حاملو شهادة الماجستير في القانون إلى الهلوسة، ويكون هذا الخطر مرتفعًا بشكل خاص عندما تنجرف المحادثة إلى مناطق أقل شهرة. يمكن استخدام حواجز حماية إضافية لتجنب البيانات المضللة وإعادة المحادثة إلى المسار الصحيح.

الحد الأقصى للأهمية

مبدأ الملاءمة يطلب منا أن نكون – حسنًا، ذو صلة. كشرط مسبق، يجب على المساعد الافتراضي أن يفهم النية الحقيقية للمستخدم. فيما يلي مثال لمساعد طيران ينتهك هذه القاعدة:

مستخدم: أحتاج إلى رحلة جوية من برلين إلى زيوريخ صباح الغد.

مساعد: حسنًا، لقد وجدت الرحلات التالية من برلين إلى زيوريخ صباح الغد. تغادر الرحلة BZ36294 برلين الساعة 6.30 صباحًا وتصل إلى زيوريخ الساعة 8 صباحًا. تغادر الرحلة BZ96294 برلين الساعة 8 صباحًا وتصل الساعة 9.30 صباحًا. تغادر الرحلة BZ96294 برلين الساعة 8 صباحًا وتصل إلى زيوريخ الساعة 9.30 صباحًا. تغادر الرحلة BZ95614 برلين الساعة 11 صباحًا وتصل إلى زيورخ الساعة 12.30:11.45 ظهرًا. هناك أيضًا إمكانية رحلة متصلة، وفي هذه الحالة ستغادر برلين الساعة 3 صباحًا وتصل إلى زيوريخ الساعة XNUMX مساءً.

مستخدم: عذرا... هل يمكنك تكرار هذا مرة أخرى؟

يقوم المساعد بإغراق المستخدم بمعلومات تفصيلية قد لا تكون ذات صلة. ومن خلال تقسيم هذا الأمر وتوجيه المستخدم للحد من مساحة البحث الخاصة به، يصبح الحوار أسهل بكثير في الهضم:

مستخدم: أحتاج إلى رحلة جوية من برلين إلى زيوريخ صباح الغد.

مساعد: حسنًا، وجدت رحلات طيران تغادر في الساعة 6.30 و8 و11 صباحًا. في أي وقت تريد المغادرة؟

مستخدم: يجب أن أكون في زيوريخ قبل الساعة 9 صباحًا.

مساعد: حسنًا، يمكنك ركوب الرحلة BZ36294. يغادر الساعة 6.30 ويصل الساعة 8 صباحًا. هل يجب أن أشتري التذكرة لك؟

مستخدم: نعم شكرا.

مكسيم الطريقة

وأخيرًا، تنص قاعدة الأسلوب على أن أفعالنا الكلامية يجب أن تكون واضحة وموجزة ومرتبة، متجنبة الغموض والغموض في التعبير. يجب أن يتجنب مساعدك الافتراضي المصطلحات الفنية أو الداخلية، ويفضل الصيغ البسيطة والمفهومة عالميًا.

في حين أن مبادئ غرايس صالحة لجميع المحادثات بشكل مستقل عن مجال معين، إلا أن طلاب ماجستير القانون غير المدربين خصيصًا للمحادثة غالبًا ما يفشلون في تحقيقها. وبالتالي، عند تجميع بيانات التدريب الخاصة بك، من المهم أن يكون لديك ما يكفي من نماذج الحوار التي تسمح لنموذجك بتعلم هذه المبادئ.

يتطور مجال تصميم المحادثة بسرعة كبيرة. سواء كنت تقوم بالفعل ببناء منتجات الذكاء الاصطناعي أو تفكر في مسار حياتك المهنية في الذكاء الاصطناعي، فأنا أشجعك على التعمق في هذا الموضوع (راجع المقدمات الممتازة في [5] و[6]). وبما أن الذكاء الاصطناعي يتحول إلى سلعة، فإن التصميم الجيد إلى جانب استراتيجية البيانات التي يمكن الدفاع عنها سيصبحان عاملين مهمين يميزان منتجات الذكاء الاصطناعي.

نبذة عامة

دعونا تلخيص الوجبات الرئيسية من هذه المادة. بالإضافة إلى ذلك، يقدم الشكل 5 "ورقة الغش" مع النقاط الرئيسية التي يمكنك تنزيلها كمرجع.

- تعمل LLMs على تعزيز الذكاء الاصطناعي للمحادثة: لقد أدت نماذج اللغات الكبيرة (LLMs) إلى تحسين جودة تطبيقات الذكاء الاصطناعي للمحادثة وقابليتها للتوسع عبر مختلف الصناعات وحالات الاستخدام.

- يمكن أن يضيف الذكاء الاصطناعي للمحادثة الكثير من القيمة إلى التطبيقات التي تحتوي على الكثير من طلبات المستخدم المماثلة (مثل خدمة العملاء) أو التي تحتاج إلى الوصول إلى كمية كبيرة من البيانات غير المنظمة (مثل إدارة المعرفة).

- البيانات: يتطلب الضبط الدقيق لمهام المحادثة بيانات محادثة عالية الجودة تعكس بشكل وثيق التفاعلات في العالم الحقيقي. يمكن أن يكون التعهيد الجماعي والبيانات الناتجة عن LLM موارد قيمة لتوسيع نطاق جمع البيانات.

- تجميع النظام معًا: يعد تطوير أنظمة الذكاء الاصطناعي للمحادثة عملية تكرارية وتجريبية تتضمن التحسين المستمر للبيانات، واستراتيجيات الضبط الدقيق، وتكامل المكونات.

- تدريس مهارات المحادثة لـ LLMs: يتضمن الضبط الدقيق لـ LLMs تدريبهم على التعرف على نوايا ومواقف تواصلية محددة والاستجابة لها.

- إضافة بيانات خارجية مع البحث الدلالي: يؤدي دمج مصادر البيانات الخارجية والداخلية باستخدام البحث الدلالي إلى تعزيز استجابات الذكاء الاصطناعي من خلال توفير المزيد من المعلومات ذات الصلة بالسياق.

- الوعي بالذاكرة والسياق: يجب أن تحافظ أنظمة المحادثة الفعالة على الوعي بالسياق، بما في ذلك تتبع تاريخ المحادثة الحالية والتفاعلات السابقة، لتوفير استجابات هادفة ومتماسكة.

- وضع حواجز الحماية: لضمان السلوك المسؤول، يجب أن تستخدم أنظمة الذكاء الاصطناعي للمحادثة حواجز الحماية لمنع عدم الدقة والهلوسة وانتهاكات الخصوصية.

- تصميم الشخصية: يعد تصميم شخصية متسقة لمساعد المحادثة الخاص بك أمرًا ضروريًا لإنشاء تجربة مستخدم متماسكة وذات علامة تجارية. يجب أن تتوافق خصائص الشخصية مع سمات منتجك وعلامتك التجارية.

- الصوت مقابل الدردشة: يعتمد الاختيار بين واجهات الصوت والدردشة على عوامل مثل الإعداد المادي والسياق العاطفي والوظائف وتحديات التصميم. ضع هذه العوامل في الاعتبار عند اتخاذ قرار بشأن الواجهة الخاصة بالذكاء الاصطناعي للمحادثة.

- التكامل في سياقات مختلفة: يمكن دمج الذكاء الاصطناعي للمحادثة في سياقات مختلفة، بما في ذلك مساعدي الطيارين، والبشر الاصطناعيين، والتوائم الرقمية، وقواعد البيانات، ولكل منها حالات استخدام ومتطلبات محددة.

- مراعاة مبدأ التعاون: إن اتباع مبادئ الكمية والجودة والملاءمة والطريقة في المحادثات يمكن أن يجعل التفاعلات مع الذكاء الاصطناعي للمحادثة أكثر فائدة وسهولة في الاستخدام.

مراجع حسابات

[1] هنغ تزي تشين وآخرون. 2022. LaMDA: نحو نماذج حوار آمنة ومتأصلة وعالية الجودة لكل شيء.

[2] أوبن إيه آي. 2022. شات جي بي تي: تحسين نماذج اللغة للحوار. تم استرجاعه في 13 يناير 2022.

[3] باتريك لويس وآخرون. 2020. الاسترجاع المعزز لمهام البرمجة اللغوية العصبية المكثفة بالمعرفة.

[4] بول جريس. 1989. دراسات في طريق الكلمات.

[5] كاثي بيرل. 2016. تصميم واجهات المستخدم الصوتية.

[6] مايكل كوهين وآخرون. 2004. تصميم واجهة المستخدم الصوتية.

ملحوظة: جميع الصور من تصميم المؤلف، ما لم يُذكر خلاف ذلك.

تم نشر هذه المقالة في الأصل نحو علم البيانات وإعادة النشر إلى TOPBOTS بإذن من المؤلف.

هل تستمتع بهذه المقالة؟ قم بالتسجيل للحصول على المزيد من تحديثات أبحاث الذكاء الاصطناعي.

سنخبرك عندما نصدر المزيد من المقالات الموجزة مثل هذه.

مقالات ذات صلة

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- PlatoData.Network Vertical Generative Ai. تمكين نفسك. الوصول هنا.

- أفلاطونايستريم. ذكاء Web3. تضخيم المعرفة. الوصول هنا.

- أفلاطون كربون، كلينتك ، الطاقة، بيئة، شمسي، إدارة المخلفات. الوصول هنا.

- أفلاطون هيلث. التكنولوجيا الحيوية وذكاء التجارب السريرية. الوصول هنا.

- المصدر https://www.topbots.com/redefining-conversational-ai-with-large-language-models/