Obraz z Freepik

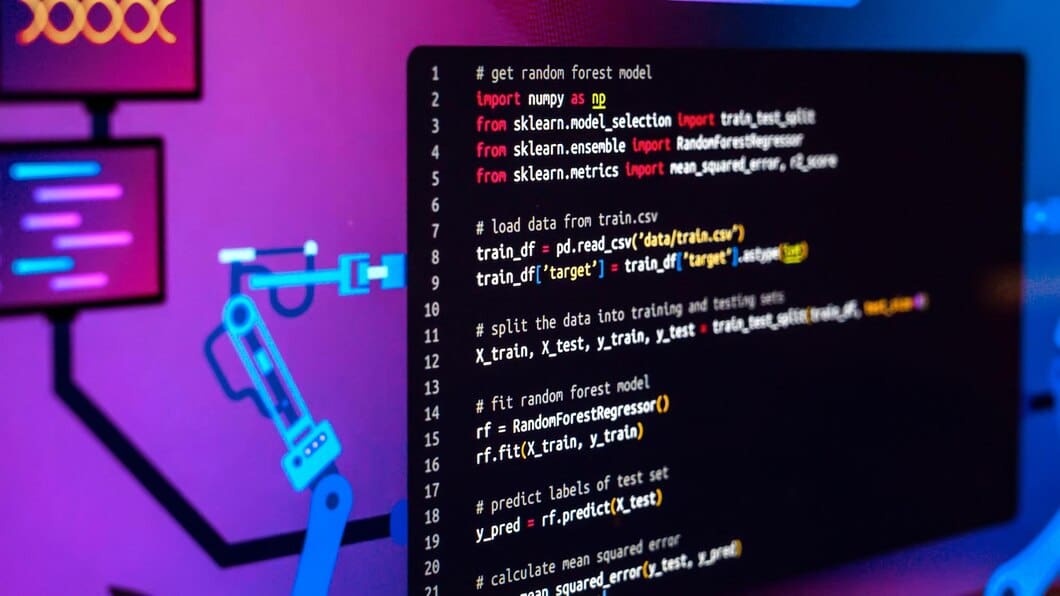

Python króluje w świecie nauki o danych, jednak wielu aspirujących (a nawet doświadczonych) badaczy danych dopiero zarysowuje jego prawdziwe możliwości. Aby naprawdę opanować analizę danych w Pythonie, musisz wyjść poza podstawy i korzystaj z zaawansowanych technik dostosowane do wydajnej manipulacji danymi, przetwarzania równoległego i wykorzystania wyspecjalizowanych bibliotek.

Duże, złożone zbiory danych i zadania wymagające dużej mocy obliczeniowej, z którymi się spotkasz, wymagają więcej niż podstawowe umiejętności w języku Python.

Ten artykuł służy jako szczegółowy przewodnik mający na celu udoskonalenie umiejętności posługiwania się językiem Python. Zagłębimy się w techniki przyspieszania Twojego kodu, używanie Pythona z dużymi zbiorami danychi przekształcanie modeli w usługi internetowe. W dalszej części będziemy badać sposoby skutecznego rozwiązywania złożonych problemów z danymi.

Mastering zaawansowane techniki Pythona analityki danych jest niezbędna na obecnym rynku pracy. Większość firm potrzebuje analityków danych, którzy mają smykałkę do Pythona. Django i Flask.

Komponenty te usprawniają włączenie kluczowych funkcji bezpieczeństwa, szczególnie w sąsiednich niszach, takich jak bieganie Hosting zgodny z PCI, budować Produkt SaaS do płatności cyfrowychlub nawet akceptowanie płatności na stronie internetowej.

A co z praktycznymi krokami? Oto niektóre techniki, które możesz zacząć opanowywać już teraz:

Efektywna manipulacja danymi za pomocą Pand

Efektywna manipulacja danymi za pomocą Pand opiera się na wykorzystaniu potężnych obiektów DataFrame i Series do obsługi i analizowania danych.

Pandy doskonale radzą sobie z zadaniami takimi jak filtrowanie, grupowanie i łączenie zbiorów danych, umożliwiając wykonywanie skomplikowanych operacji manipulacji danymi przy użyciu minimalnej ilości kodu. Jego funkcjonalność indeksowania, w tym indeksowanie wielopoziomowe, umożliwia szybkie pobieranie i dzielenie danych, dzięki czemu idealnie nadaje się do pracy z dużymi zbiorami danych.

Dodatkowo, Integracja Pand z innymi analizami danych i biblioteki wizualizacyjne w ekosystemie Pythona, takie jak NumPy i Matplotlib, dodatkowo zwiększają jego możliwości w zakresie wydajnej analizy danych.

Dzięki tym funkcjom Pandy są niezbędnym narzędziem w zestawie narzędzi do analityki danych. Zatem mimo że Python jest niezwykle popularnym językiem, nie należy postrzegać tego jako wady. Jest tak wszechstronny, jak wszechobecny — a opanowanie języka Python pozwala na wykonanie wszystkiego, od analizy statystycznej, czyszczenia danych i wizualizacji, po bardziej „niszowe” rzeczy, takie jak używanie narzędzia do wapna i nawet przetwarzanie języka naturalnego aplikacji.

Wysoka wydajność obliczeniowa dzięki NumPy

NumPy znacznie zwiększa możliwości Pythona w zakresie obliczeń o wysokiej wydajności, zwłaszcza poprzez obsługę dużych, tablice wielowymiarowe i macierze. Osiąga to poprzez zapewnienie wszechstronnego zestawu funkcji matematycznych zaprojektowanych do wydajnych operacji na tych strukturach danych.

Jeden z kluczowe funkcje NumPy jest jego implementacja w języku C, która pozwala na szybkie wykonanie skomplikowanych obliczeń matematycznych za pomocą operacji wektorowych. Powoduje to zauważalną poprawę wydajności w porównaniu z używaniem natywnych struktur danych i pętli Pythona do podobnych zadań. Na przykład zadania takie jak mnożenie macierzy, które są powszechne w wielu obliczeniach naukowych, można szybko wykonać za pomocą funkcje takie jak np.dot().

Analitycy danych mogą wykorzystać wydajną obsługę tablic i potężne możliwości obliczeniowe NumPy, aby osiągnąć znaczne przyspieszenie kodu Pythona, dzięki czemu jest on opłacalny w zastosowaniach wymagających wysokiego poziomu obliczeń numerycznych.

Zwiększanie wydajności poprzez przetwarzanie wieloprocesowe

Zwiększanie wydajności poprzez przetwarzanie wieloprocesowe w Pythonie polega na użyciu „przetwarzanie wieloprocesowe moduł do uruchamiania zadań równolegle na wielu rdzeniach procesora zamiast sekwencyjnie na jednym rdzeniu.

Jest to szczególnie korzystne w przypadku zadań obciążonych procesorem, wymagających znacznych zasobów obliczeniowych, ponieważ pozwala na podział i współbieżne wykonywanie zadań, skracając w ten sposób całkowity czas wykonania. Podstawowe użycie polega na tworzeniu „Proces' obiektów i określenie funkcji docelowej, która ma być wykonywana równolegle.

Dodatkowo, 'Basen' class może być używana do zarządzania wieloma procesami roboczymi i rozdzielania między nimi zadań, co eliminuje większość ręcznego zarządzania procesami. Mechanizmy komunikacji międzyprocesowej, takie jak 'Kolejka' i 'Rura' ułatwiają wymianę danych pomiędzy procesami, natomiast synchronizacja prymitywów takich jak 'Zamek' i 'Semafor' upewnij się, że procesy nie kolidują ze sobą podczas uzyskiwania dostępu do współdzielonych zasobów.

Aby jeszcze bardziej usprawnić wykonywanie kodu, można zastosować techniki takie jak Kompilacja JIT z bibliotekami takie jak Numba, mogą znacznie przyspieszyć kod Pythona, dynamicznie kompilując części kodu w czasie wykonywania.

Wykorzystanie bibliotek niszowych do analizy danych o podwyższonym poziomie

Używanie określonych bibliotek Pythona do analizy danych może znacznie przyspieszyć Twoją pracę. Na przykład Pandas jest idealny do organizowania i manipulowania danymi, podczas gdy PyTorch oferuje zaawansowane możliwości głębokiego uczenia się ze wsparciem GPU.

Z drugiej strony Plotly i Seaborn mogą pomóc w uczynieniu danych bardziej zrozumiałymi i angażującymi podczas tworzenia wizualizacji. W przypadku bardziej wymagających zadań obliczeniowych polecamy biblioteki takie jak LightGBM i XGBoost oferować efektywne wdrożenia algorytmów wzmacniających gradient, które obsługują duże zbiory danych o dużej wymiarowości.

Każda z tych bibliotek specjalizuje się w różnych aspektach analizy danych i uczenia maszynowego, co czyni je cennymi narzędziami dla każdego badacza danych.

Wizualizacja danych w Pythonie znacznie się rozwinęła, oferując szeroką gamę technik prezentowania danych w znaczący i wciągający sposób.

Zaawansowana wizualizacja danych nie tylko poprawia interpretację danych, ale także pomaga w odkrywaniu podstawowych wzorców, tendencje i korelacje, które mogą nie być oczywiste przy użyciu tradycyjnych metod.

Niezbędne jest indywidualne opanowanie tego, co można zrobić w Pythonie — ale trzeba mieć też przegląd tego, jak to zrobić można wykorzystać platformę Python w pełnym zakresie w środowisku korporacyjnym to punkt, który z pewnością wyróżni Cię na tle innych analityków danych.

Oto kilka zaawansowanych technik, które warto wziąć pod uwagę:

- Interaktywne wizualizacje. Biblioteki lubią Bokeh i Plotly umożliwiają tworzenie dynamicznych wykresów, z którymi użytkownicy mogą wchodzić w interakcję, na przykład powiększając określone obszary lub najeżdżając kursorem na punkty danych, aby zobaczyć więcej informacji. Ta interaktywność może sprawić, że złożone dane będą bardziej dostępne i zrozumiałe.

- Złożone typy wykresów. Poza podstawowymi wykresami liniowymi i słupkowymi, Python obsługuje zaawansowane typy wykresów jak mapy cieplne, wykresy pudełkowe, wykresy skrzypcowe i jeszcze bardziej wyspecjalizowane wykresy, takie jak wykresy chmur deszczowych. Każdy typ wykresu służy konkretnemu celowi i może pomóc uwypuklić różne aspekty danych, od rozkładów i korelacji po porównania między grupami.

- Dostosowywanie za pomocą matplotlib. Biblioteki Matplotu oferuje szerokie możliwości dostosowywania, pozwalając na precyzyjną kontrolę nad wyglądem działek. Techniki takie jak dostosowywanie parametrów wykresu za pomocą plt.getp i plt.setp funkcje lub manipulowanie właściwościami elementów fabuły umożliwiają tworzenie figur o jakości publikacyjnej, które przedstawiają dane w najlepszym możliwym świetle.

- Wizualizacja szeregów czasowych. W przypadku danych tymczasowych wykresy szeregów czasowych mogą skutecznie wyświetlać wartości w czasie, pomagając identyfikować trendy, wzorce lub anomalie w różnych okresach. Biblioteki takie jak Seaborn ułatwiają tworzenie i dostosowywanie wykresów szeregów czasowych, usprawniając analizę danych opartych na czasie.

Zwiększanie wydajności poprzez przetwarzanie wieloprocesowe w Pythonie umożliwia równoległe wykonywanie kodu, dzięki czemu idealnie nadaje się do zadań intensywnie obciążających procesor, bez konieczności wykonywania operacji we/wy lub interakcji użytkownika.

Różne rozwiązania nadają się do różnych celów — od tworzenia prostych wykresów liniowych po złożone interaktywne pulpity nawigacyjne i wszystko pomiędzy. Oto niektóre z najpopularniejszych:

- Infogram wyróżnia się przyjaznym dla użytkownika interfejsem i różnorodną biblioteką szablonów, obsługującą szeroką gamę branż, w tym media, marketing, edukację i rząd. Oferuje bezpłatne konto podstawowe i różne plany cenowe dla bardziej zaawansowanych funkcji.

- FusionWykresy pozwala na utworzenie ponad 100 różnych typów interaktywnych wykresów i map, przeznaczonych zarówno do projektów webowych, jak i mobilnych. Obsługuje dostosowywanie i oferuje różne opcje eksportu.

- Zgrabnie oferuje prostą składnię i wiele opcji interaktywności, odpowiednich nawet dla osób bez wiedzy technicznej, dzięki graficznemu interfejsowi użytkownika. Jednak jego wersja społecznościowa ma ograniczenia, takie jak publiczne wizualizacje i ograniczona liczba elementów estetycznych.

- RAWWykresy to platforma typu open source, kładąca nacisk na wizualizację danych bez użycia kodu i metodą „przeciągnij i upuść”, dzięki czemu złożone dane są wizualnie łatwe do zrozumienia dla każdego. Szczególnie nadaje się do wypełniania luki pomiędzy aplikacjami arkuszy kalkulacyjnych i edytorami grafiki wektorowej.

- Widok Qlik jest preferowany przez uznanych analityków danych do analizowania danych na dużą skalę. Integruje się z szeroką gamą źródeł danych i niezwykle szybko analizuje dane.

Opanowanie zaawansowanych technik języka Python ma kluczowe znaczenie dla analityków danych, aby uwolnić pełny potencjał tego potężnego języka. Chociaż podstawowe umiejętności w zakresie języka Python są nieocenione, opanowanie zaawansowanej manipulacji danymi, optymalizacji wydajności i wykorzystywania wyspecjalizowanych bibliotek zwiększa możliwości analizy danych.

Ciągłe uczenie się, podejmowanie wyzwań i bycie na bieżąco z najnowszymi osiągnięciami Pythona są kluczem do zostania biegłym praktykiem.

Poświęć więc czas na opanowanie zaawansowanych funkcji języka Python, aby móc stawić czoła złożonym zadaniom związanym z analizą danych, wprowadzać innowacje i podejmować decyzje oparte na danych, które wywierają realny wpływ.

Nahlę Davies jest programistą i pisarzem technicznym. Zanim całkowicie poświęciła się pracy nad pisaniem technicznym, udało jej się – między innymi intrygujących rzeczy – zostać głównym programistą w organizacji zajmującej się brandingiem 5,000 Inc., której klientami są Samsung, Time Warner, Netflix i Sony.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://www.kdnuggets.com/mastering-python-for-data-science-beyond-the-basics?utm_source=rss&utm_medium=rss&utm_campaign=mastering-python-for-data-science-beyond-the-basics