Wikipedia ha declassato il rating di affidabilità di CNET dopo che la pubblicazione tecnologica, operativa da 30 anni, ha utilizzato l'intelligenza artificiale per generare notizie che si sono rivelate plagiate e piene di errori.

CNET pubblicato più di 70 articoli di consulenza finanziaria scritti dall'intelligenza artificiale tra novembre 2022 e gennaio 2023. Gli articoli sono stati pubblicati con il titolo "CNET Money Staff".

Un audit ha confermato che molte delle storie contenevano errori fattuali, gravi omissioni e contenuti plagiati. CNET fermato pubblicare storie scritte dall’intelligenza artificiale dopo che la notizia è arrivata all’inizio del 2023, ma il danno, secondo Wikipedia, era già stato fatto.

Leggi anche: CNET sospende l'intelligenza artificiale dopo aver pubblicato una serie di cattivi articoli

Declassamento di CNET basato sull'intelligenza artificiale

"CNET, solitamente considerato come una normale RS tecnologica [fonte affidabile], ha iniziato a eseguire sperimentalmente articoli generati dall'intelligenza artificiale, che sono pieni di errori", ha affermato l'editore di Wikipedia David Gerard, come segnalati dal futurismo.

“Finora l'esperimento non sta andando bene, come non dovrebbe. Non ne ho ancora trovato nessuno, ma tutti gli articoli che compaiono in un articolo di Wikipedia devono essere rimossi."

Gerard stava parlando per dare il via a incontro degli editori di Wikipedia per discutere dei contenuti dell'intelligenza artificiale di CNET nel gennaio 2023. Gli editori del dizionario online tutto-tutto mantengono il forum Wikipedia Reliable Sources o Perennial Sources, dove si incontrano per decidere se una fonte di notizie può essere attendibile e utilizzata nelle citazioni.

Il forum presenta una classifica che classifica i notiziari in base alla loro affidabilità. Dopo molte ore di dibattito, i redattori hanno convenuto che il Guidato dall'IA La versione di CNET non era affidabile e ha retrocesso i contenuti del sito Web a "generalmente inaffidabile".

"Facciamo un passo indietro e consideriamo ciò a cui abbiamo assistito qui", ha detto un altro editore di Wikipedia che si chiama "Bloodofox".

"CNET ha generato un sacco di contenuti con l'intelligenza artificiale, ne ha elencati alcuni come scritti da persone (!), ha affermato che erano stati tutti modificati e controllati da persone e poi, dopo essere stato scoperto, ha emesso alcune 'correzioni' seguite da attacchi ai giornalisti che ne hanno parlato”, hanno aggiunto.

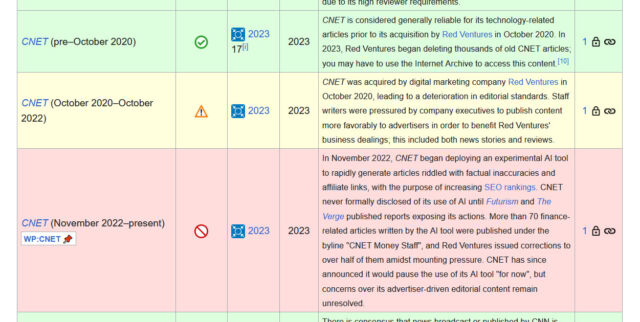

Le fonti perenni di Wikipedia pagina suddivide le valutazioni di affidabilità per CNET in tre periodi di tempo: 1. Pre-ottobre 2020, quando CNET era considerato “generalmente affidabile”; e dal 2 ottobre 2020 all'ottobre 2022, dove Wikipedia non ha valutato il sito web successivo al suo $500 milioni acquisizione da parte di Red Ventures.

Il terzo periodo va da novembre 2022 ad oggi. Durante questo periodo, Wikipedia ha declassato CNET a fonte “generalmente inaffidabile” dopo che il sito web si è rivolto all’intelligenza artificiale “per generare rapidamente articoli pieni di inesattezze fattuali e link di affiliazione”.

Google non trova alcun problema con l’intelligenza artificiale

Secondo il rapporto Futurism, le cose hanno iniziato a peggiorare per CNET dopo l'acquisizione di Red Ventures nel 2020. Wikipedia ha affermato che il cambio di proprietà ha portato "a un deterioramento degli standard editoriali" perché Red Ventures avrebbe dato priorità alla SEO rispetto alla qualità. Non si trattava solo di CNET che sperimentava segretamente l'intelligenza artificiale nella stalla.

Gli editori di Wikipedia hanno anche sottolineato altri problemi di affidabilità che coinvolgono siti Web separati di proprietà di Red Ventures, tra cui Healthline e Bankrate. Secondo quanto riferito, i siti incentrati sull’istruzione pubblicavano contenuti scritti dall’intelligenza artificiale senza divulgazione o supervisione umana.

"Red Ventures non è stata neanche lontanamente trasparente su tutto ciò: la società potrebbe nella migliore delle ipotesi essere descritta come ingannevole", ha affermato l'anonimo editore di Wikipedia Bloodofox.

In una dichiarazione riguardante il downgrade di Wikipedia e i contenuti creati dall'intelligenza artificiale, CNET ha affermato di fornire "notizie e consigli imparziali incentrati sulla tecnologia".

"Godiamo della nostra fiducia da quasi 30 anni grazie ai nostri rigorosi standard editoriali e di revisione dei prodotti", ha detto a Futurism un portavoce. “È importante chiarire che CNET non utilizza attivamente l’intelligenza artificiale per creare nuovi contenuti. Sebbene non abbiamo piani specifici per il riavvio, qualsiasi iniziativa futura seguirà la nostra politica pubblica sull’IA”.

La decisione di Wikipedia evidenzia le preoccupazioni persistenti riguardo all’uso dell’intelligenza artificiale per creare articoli nel settore dei media. Nel frattempo, Google non ha problemi con il materiale AI, purché non venga utilizzato per ingannare l'algoritmo di ricerca.

Secondo Google guida sui contenuti generati dall’intelligenza artificiale, l’azienda afferma di aver sempre “creduto nel potere dell’intelligenza artificiale di trasformare la capacità di fornire informazioni utili”.

Google afferma che i suoi sistemi di classificazione si concentrano sulla qualità dei contenuti e non su come vengono prodotti, sia dagli esseri umani che dall’intelligenza artificiale. Guarda alla competenza, all’esperienza, all’autorevolezza e all’affidabilità.

Tuttavia, l'azienda rileva che l'utilizzo dell'automazione, inclusa l'intelligenza artificiale, per generare contenuti con lo scopo principale di manipolare il posizionamento nei risultati di ricerca "rappresenta una violazione delle nostre politiche sullo spam".

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://metanews.com/how-ai-generated-content-led-to-a-reliability-rating-downgrade-for-cnet/