Ricordi quando il Bardo di Google, ora chiamato Gemini, non ho potuto rispondere a una domanda sul telescopio spaziale James Webb nel suo annuncio di lancio? Permettimi di rinfrescarti la memoria su questo famoso caso: è uno dei più grandi esempi di allucinazioni IA che abbiamo mai visto.

Cosa è successo? Durante l'annuncio, alla demo di Google Bard è stato chiesto: "Quali nuove scoperte del telescopio spaziale James Webb posso condividere con mio figlio di 9 anni?" Dopo una breve pausa, la demo di Google Bard ha fornito due risposte corrette. Tuttavia, la sua risposta finale era errata. Secondo la demo di Google Bard, il telescopio aveva catturato le prime immagini di un pianeta al di fuori del nostro sistema solare. Tuttavia, in realtà, il Very Large Telescope dell'Osservatorio Europeo Australe aveva già scattato immagini di questi "esopianeti", che erano conservate negli archivi della NASA.

Non per essere un ~ beh, in realtà ~ idiota, e sono sicuro che Bard sarà impressionante, ma per la cronaca: JWST non ha scattato "la primissima immagine di un pianeta al di fuori del nostro sistema solare".

la prima immagine è stata invece realizzata da Chauvin et al. (2004) con il VLT/NACO utilizzando l'ottica adattiva. https://t.co/bSBb5TOeUW pic.twitter.com/KnrZ1SSz7h

— Grant Tremblay (@astrogrant) 7 Febbraio 2023

Perché i giganti della tecnologia come Google non riescono nemmeno a prevenire tali errori? Scopriamolo!

Cos'è un'allucinazione dell'intelligenza artificiale?

Un'allucinazione AI si verifica quando un programma per computer, tipicamente alimentato dall'intelligenza artificiale (AI), produce risultati errati, privi di senso o fuorvianti. Questo termine viene spesso utilizzato per descrivere situazioni in cui i modelli di intelligenza artificiale generano risposte completamente fuori traccia o non correlate all'input ricevuto. È come fare una domanda e ricevere una risposta che non ha alcun senso o non è affatto quella che ti aspettavi.

Capire perché le allucinazioni dell'IA accadere, diamo un'occhiata a come funziona l'intelligenza artificiale. I modelli di intelligenza artificiale, come i chatbot o i sistemi di riconoscimento delle immagini, vengono addestrati su grandi set di dati per apprendere modelli e fare previsioni. Tuttavia, se i dati di addestramento sono errati, incompleti o distorti, il modello di intelligenza artificiale potrebbe apprendere modelli o associazioni errate. Ciò può portare a risultati allucinatori in cui l’intelligenza artificiale genera risposte basate su informazioni errate o fraintese. E succede spesso anche se potresti non accorgertene.

Le allucinazioni legate all’intelligenza artificiale possono manifestarsi in varie forme, ognuna delle quali evidenzia sfide e complessità diverse all’interno dei sistemi di intelligenza artificiale. Ecco alcuni tipi comuni di allucinazioni AI:

- Frase Allucinazione AI:

- In questo scenario, il modello AI genera una frase che è in conflitto con un'affermazione precedente nello stesso contesto. Ad esempio:

- Suggerimento: "Descrivi il viaggio di un personaggio in frasi di tre parole".

- Risultato: “Camminava lentamente. All'improvviso, scappò. Poi ha camminato”.

- In questo scenario, il modello AI genera una frase che è in conflitto con un'affermazione precedente nello stesso contesto. Ad esempio:

L'ultima frase contraddice la precedente azione di corsa, interrompendo la coerenza della narrazione.

- Allucinazione immediata dell'IA:

- Questo tipo si verifica quando la risposta generata dall'intelligenza artificiale è in conflitto con la richiesta o la query prevista. Per esempio:

- Suggerimento: "Scrivi una ricetta per la torta al cioccolato".

- Risultato: "Ecco una poesia sulle stelle".

- Questo tipo si verifica quando la risposta generata dall'intelligenza artificiale è in conflitto con la richiesta o la query prevista. Per esempio:

Il contenuto generato non soddisfa la richiesta relativa alla cucina, indicando un'incapacità di cogliere il contesto.

- Allucinazioni reali dell'IA:

- Le contraddizioni fattuali sorgono quando il modello di intelligenza artificiale presenta informazioni false come accurate. Ad esempio:

- Suggerimento: "Elenca tre elementi nella tavola periodica".

- Risultato: "Idrogeno, ossigeno, carbonite".

- Le contraddizioni fattuali sorgono quando il modello di intelligenza artificiale presenta informazioni false come accurate. Ad esempio:

La “carbonite” non è un elemento, il che porta a disinformazione nella risposta.

- Allucinazioni AI irrilevanti o casuali:

- Queste allucinazioni comportano la generazione di informazioni irrilevanti o prive di senso non correlate all'input. Per esempio:

- Suggerimento: "Descrivi una giornata in spiaggia".

- Risultato: “La sabbia era calda. I gabbiani cantavano jazz. I pinguini ballavano il balletto.

- Queste allucinazioni comportano la generazione di informazioni irrilevanti o prive di senso non correlate all'input. Per esempio:

La menzione dei pinguini e del balletto non è in linea con la tipica scena sulla spiaggia, dimostrando una mancanza di coerenza nella narrativa generata.

Questi tipi di allucinazioni sottolineano le sfide che i sistemi di intelligenza artificiale devono affrontare nel comprendere e contestualizzare accuratamente le informazioni. Per affrontare questi problemi è necessario migliorare la qualità dei dati di addestramento, affinare la comprensione del contesto da parte dei modelli linguistici e implementare solidi meccanismi di convalida per garantire la coerenza e l’accuratezza dei risultati generati dall’intelligenza artificiale.

Le allucinazioni legate all’intelligenza artificiale possono avere gravi conseguenze, soprattutto nelle applicazioni in cui l’intelligenza artificiale viene utilizzata per prendere decisioni importanti, come diagnosi mediche o operazioni finanziarie. Se un sistema di intelligenza artificiale presenta allucinazioni e fornisce informazioni imprecise in questi contesti, potrebbe portare a risultati dannosi.

Cosa puoi fare contro le allucinazioni dell'intelligenza artificiale?

Ridurre le allucinazioni dell’IA comporta alcuni passaggi chiave per rendere i sistemi di intelligenza artificiale più accurati e affidabili:

In primo luogo, è fondamentale utilizzare dati di buona qualità per addestrare l’intelligenza artificiale. Ciò significa assicurarsi che le informazioni da cui apprende l’intelligenza artificiale siano diverse, accurate e prive di pregiudizi.

Anche la semplificazione dei modelli di intelligenza artificiale può aiutare. I modelli complessi a volte possono portare a errori inaspettati. Mantenendo le cose semplici, possiamo ridurre le possibilità di errori.

Anche le istruzioni chiare e di facile comprensione sono importanti. Quando l’intelligenza artificiale riceve input chiari, è meno probabile che si confonda e commetta errori.

Test regolari aiutano a individuare tempestivamente eventuali errori. Controllando le prestazioni dell'intelligenza artificiale, possiamo risolvere eventuali problemi e apportare miglioramenti.

Anche l’aggiunta di controlli all’interno dei sistemi di intelligenza artificiale può aiutare. Questi controlli rilevano gli errori e li correggono prima che causino problemi.

Ancora più importante, la supervisione umana è essenziale. Il fatto che le persone ricontrollino gli output generati dall'intelligenza artificiale garantisce precisione e affidabilità.

Infine, addestrare l’IA a difendersi dagli attacchi può renderla più resiliente. Ciò aiuta l’IA a riconoscere e gestire i tentativi di manipolarla o ingannarla.

Seguendo questi passaggi, possiamo rendere i sistemi di intelligenza artificiale più affidabili e ridurre le possibilità di avere allucinazioni.

Come si fa ad avere allucinazioni a un'intelligenza artificiale?

Se vuoi sfruttare questo difetto e divertirti, puoi fare alcune cose:

- Modificare l'input: puoi modificare le informazioni fornite all'IA. Anche piccoli cambiamenti possono far sì che produca risposte strane o errate.

- Inganna il modello: Crea input speciali che ingannano l'IA inducendola a dare risposte sbagliate. Questi trucchi sfruttano i punti deboli del modello per creare output allucinati.

- Fai confusione con i dati: Aggiungendo informazioni fuorvianti o errate ai dati di addestramento dell'IA o al tuo prompt, puoi farle apprendere le cose sbagliate e produrre allucinazioni.

- Regola il modello: modifica le impostazioni o la struttura dell'IA per introdurre difetti o pregiudizi. Questi cambiamenti possono far sì che generi output strani o privi di senso.

- Fornisci input confusi: Fornire all'IA istruzioni poco chiare o contraddittorie. Ciò può confondere l'IA e portare a risposte errate o prive di senso.

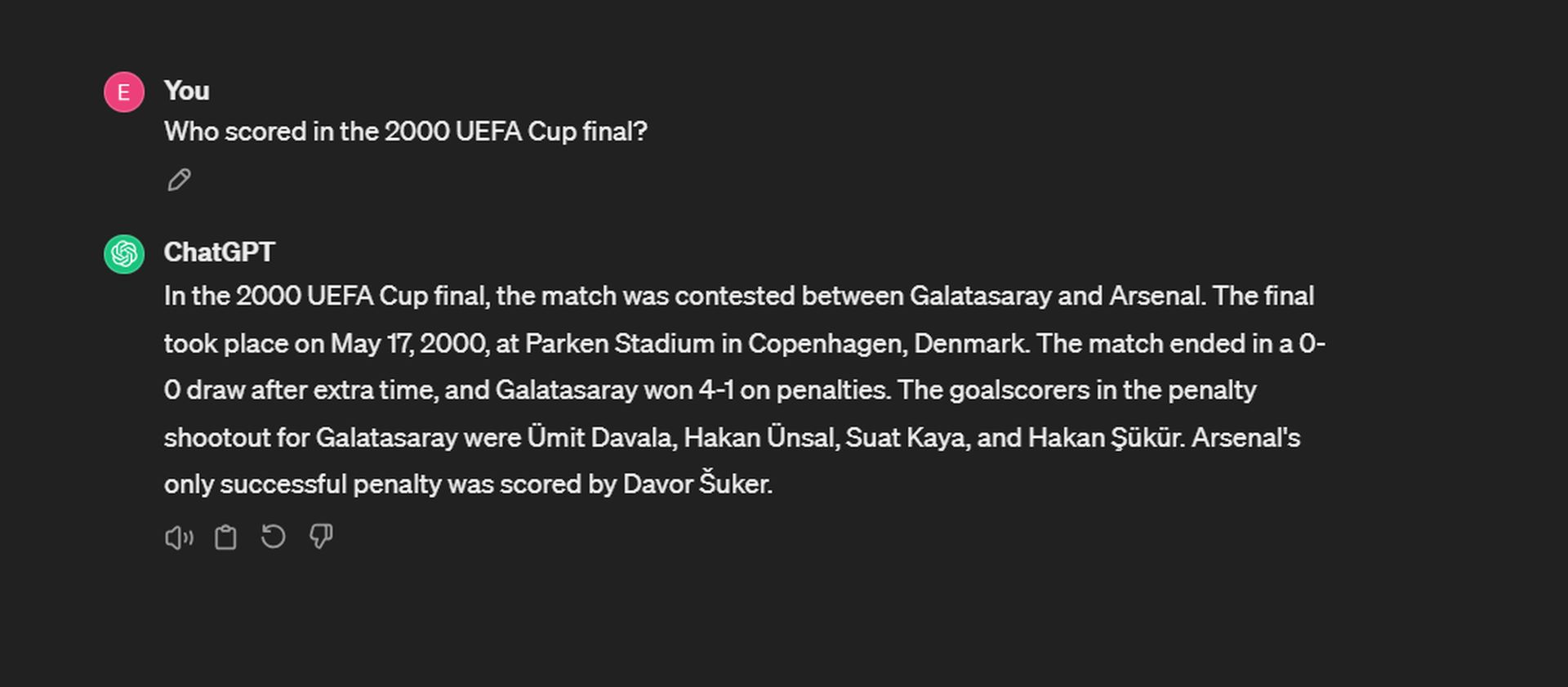

Oppure puoi semplicemente fare domande e tentare la fortuna! Ad esempio, abbiamo provato a far avere allucinazioni a ChatGPT:

Mentre ChatGPT ricorda accuratamente la data e il punteggio, vacilla nel ricordare i marcatori dei calci di rigore. Per il Galatasaray, i gol sono stati segnati da Ergün Penbe, Hakan Şükür, Ümit Davala e Popescu. Dalla parte dell'Arsenal, Ray Parlour è stato l'unico marcatore di rigori di successo.

Sebbene dare allucinazioni all’intelligenza artificiale possa aiutarci a comprenderne i limiti, è importante utilizzare questa conoscenza in modo responsabile e garantire che i sistemi di intelligenza artificiale rimangano affidabili e degni di fiducia.

GPT 4 ha meno allucinazioni?

Sì, secondo il valutazione condotto dalla società con sede a Palo Alto utilizzando il loro modello di valutazione delle allucinazioni, GPT-4 dimostra un tasso di allucinazioni inferiore rispetto ad altri modelli linguistici di grandi dimensioni, ad eccezione di Intel Neural Chat 7B (97.2%). Con un tasso di precisione del 97% e un tasso di allucinazioni del 3%, GPT-4 mostra un elevato livello di precisione e una tendenza relativamente bassa a introdurre allucinazioni durante il riepilogo dei documenti. Ciò indica che GPT-4 è meno incline a generare risultati errati o privi di senso rispetto ad altri modelli testati nella valutazione.

D’altro canto, alcuni dei modelli meno efficaci provenivano da Google. Google Palm 2 ha dimostrato un tasso di precisione del 90% e un tasso di allucinazioni del 10%. La sua controparte ottimizzata per la chat ha ottenuto risultati ancora peggiori, con un tasso di precisione di solo l'84.2% e il punteggio di allucinazioni più alto di qualsiasi modello in classifica pari al 16.2%. Ecco l'elenco:

In sintesi, un’allucinazione dell’IA è un errore commesso dai sistemi di intelligenza artificiale in cui producono risultati privi di senso o errati a causa di difetti nei dati di addestramento o nel modo in cui elaborano le informazioni. È un aspetto affascinante, ma allo stesso tempo impegnativo, dell'intelligenza artificiale che ricercatori e sviluppatori stanno lavorando per affrontare.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://dataconomy.com/2024/04/11/what-exactly-is-an-ai-hallucination-and-why-does-it-matter/