Ha pubblicato Marley Stevens un video su TikTok lo scorso semestre che ha descritto come un annuncio di servizio pubblico per qualsiasi studente universitario. Il suo messaggio: non utilizzare software di controllo grammaticale se il tuo professore potrebbe eseguire il tuo articolo attraverso un sistema di rilevamento dell'intelligenza artificiale.

Stevens è una studentessa dell'Università della Georgia del Nord, ed è stata insolitamente pubblica su quella che lei chiama una "debacle", in cui è stata accusata di usare l'intelligenza artificiale per scrivere un articolo che dice di aver composto lei stessa, tranne per l'uso della grammatica standard. e funzionalità di controllo ortografico di Grammarly, che ha installato come estensione sul suo browser web.

Il video di avvertimento iniziale che ha pubblicato è stato visto più di 5.5 milioni di volte e da allora ha realizzato più di 25 video di follow-up rispondendo ai commenti dei follower e documentando la sua battaglia con il college sulla questione, inclusa la condivisione di immagini di e-mail inviatele. dai presidi accademici e dalle immagini del suo lavoro da studentessa per cercare di dimostrare la sua tesi, per aumentare la consapevolezza di ciò che vede come strumenti di rilevamento dell'intelligenza artificiale difettosi che sono sempre più sanzionati dalle università e utilizzati dai professori.

Stevens dice che un professore in un corso di giustizia penale che ha seguito l'anno scorso le ha dato uno zero su un foglio perché ha detto che il sistema di rilevamento dell'intelligenza artificiale di Turnitin lo ha contrassegnato come scritto da un robot. Stevens insiste che il lavoro è interamente suo e che non ha utilizzato ChatGPT o altri chatbot per comporre nessuna parte del suo articolo.

@m.stevens03 #granmerly #ai #intelligenza artificiale #fyp #psa ♬ suono originale – Marley Stevens

Come risultato dello zero sul foglio, dice, il suo voto finale nella classe è sceso a un voto abbastanza basso da impedirle di qualificarsi per un Borsa di studio HOPE, che richiede agli studenti di mantenere un GPA 3.0. E dice che l'università l'ha messa in libertà vigilata per aver violato le sue politiche sulla cattiva condotta accademica, e le è stato richiesto di pagare 105 dollari per partecipare a un seminario sull'imbroglio.

L'università ha rifiutato le ripetute richieste di EdSurge di parlare delle sue politiche per l'utilizzo del rilevamento dell'intelligenza artificiale. I funzionari hanno invece inviato una dichiarazione affermando che le leggi federali sulla privacy degli studenti impediscono loro di commentare qualsiasi episodio di frode individuale e che: “La nostra facoltà comunica linee guida specifiche riguardanti l’uso dell’intelligenza artificiale per varie classi, e tali linee guida sono incluse nel programma delle lezioni. L'uso inappropriato dell'IA è affrontato anche nel ns Codice di condotta dello studente. "

La sezione del codice di condotta studentesco definisce il plagio come: “Utilizzo di idee o espressioni di un'altra persona o agenzia (inclusa l'intelligenza artificiale) senza citarne la fonte. Temi, saggi, tesine, test e altri requisiti simili devono essere opera dello Studente che li presenta. Quando si utilizzano citazioni dirette o parafrasi, queste devono essere indicate, e quando le idee di un altro sono incorporate nel documento devono essere adeguatamente riconosciute. Tutto il lavoro di uno Studente deve essere originale o citato secondo i requisiti dell'istruttore altrimenti è considerato plagio. Il plagio include, ma non è limitato a, l'uso, mediante parafrasi o citazione diretta, dell'opera pubblicata o inedita di un'altra persona senza un riconoscimento completo e chiaro. Include anche l’uso non riconosciuto di materiali preparati da un’altra persona o agenzia nella vendita di tesine o altro materiale accademico”.

L’incidente solleva domande complesse su dove tracciare i limiti riguardo ai nuovi strumenti di intelligenza artificiale. Quando aiutano semplicemente in modi accettabili e quando il loro utilizzo implica una cattiva condotta accademica? Dopotutto, molte persone utilizzano funzionalità di correzione automatica grammaticale e ortografica in sistemi come Google Docs e altri programmi che suggeriscono una parola o una frase durante la digitazione degli utenti. È un imbroglio?

E poiché tali funzionalità grammaticali diventano più robuste man mano che gli strumenti di intelligenza artificiale generativa diventano più diffusi, gli strumenti di rilevamento dell’intelligenza artificiale possono forse distinguere tra un uso accettabile dell’intelligenza artificiale e un imbroglio?

"Altri insegnanti di questa stessa università mi hanno consigliato di usare [Grammarly] per gli elaborati", ha detto Stevens in un altro video. “Quindi stanno cercando di dirci che non possiamo usare la correzione automatica, il controllo ortografico o altro? Cosa vogliono che facciamo, che lo digitiamo in un'app Notes e lo trasformiamo in questo modo?"

In un'intervista con EdSurge, lo studente si è espresso in questo modo:

"La mia opinione è che i rilevatori di intelligenza artificiale sono spazzatura e non c'è molto che noi studenti possiamo fare al riguardo", afferma. "E questo non è giusto perché facciamo tutto questo lavoro e paghiamo tutti questi soldi per andare al college, e poi un rilevatore di intelligenza artificiale può praticamente rovinare tutta la tua carriera universitaria."

Colpi di scena

Lungo il percorso, la storia di questo studente dell'Università della Georgia del Nord ha preso delle svolte sorprendenti.

Per prima cosa, l’università ha inviato un’e-mail a tutti gli studenti sull’intelligenza artificiale non molto tempo dopo che Stevens ha pubblicato il suo primo video virale.

Quell'e-mail ricordava agli studenti di seguire il codice di condotta accademica dell'università e conteneva anche un avvertimento insolito: "Si prega di tenere presente che alcuni strumenti online utilizzati per assistere gli studenti con la grammatica, la punteggiatura, la struttura delle frasi, ecc., utilizzano l'intelligenza artificiale generativa (AI) ); che può essere segnalato da Turnitin. Uno dei siti Web di intelligenza artificiale generativa più comunemente utilizzati segnalati da Turnitin.com è Grammarly. Si prega di prestare attenzione quando si considerano questi siti Web. "

Il professore in seguito ha detto alla studentessa di aver controllato il suo foglio anche con un altro strumento, Copyleaks, e di aver anche contrassegnato il suo foglio come scritto da un bot. E dice che quando ha passato di recente il suo articolo su Copyleaks, ha ritenuto che il lavoro fosse scritto da esseri umani. Ha inviato a questo giornalista uno screenshot di quel processo, in cui lo strumento conclude, in testo verde, "Questo è testo umano".

"Se lo eseguo adesso e ottengo un risultato diverso, ciò dimostra semplicemente che queste cose non sono sempre accurate", dice dei rilevatori di intelligenza artificiale.

I funzionari di Copyleaks non hanno risposto alle richieste di commento. Stevens ha rifiutato di condividere il testo completo del suo articolo, spiegando che non voleva che finisse su Internet dove altri studenti potessero copiarlo e forse metterla nei guai con la sua università. "Sono già in prova accademica", dice.

Stevens afferma di aver sentito studenti di tutto il paese che affermano di essere stati anche falsamente accusati di imbroglio a causa del software di rilevamento dell'intelligenza artificiale.

"Una studentessa ha detto che voleva diventare medico ma è stata accusata e nessuna delle scuole l'ha accettata a causa della sua accusa di cattiva condotta", dice Stevens.

Stevens afferma di essere rimasta sorpresa dalla quantità di sostegno che ha ricevuto dalle persone che guardano i suoi video. I suoi follower sui social media l'hanno incoraggiata a creare un Campagna GoFundMe, cosa che ha fatto per coprire la perdita della borsa di studio e per pagare un avvocato che potesse eventualmente intraprendere un'azione legale contro l'università. Finora ha raccolto più di 6,100 dollari da più di 90 persone.

È stata anche sorpresa di essere contattata dai funzionari di Grammarly, che hanno donato 4,000 dollari al suo GoFundMe e l'hanno assunta come ambasciatrice degli studenti. Di conseguenza, Stevens ora prevede di realizzare tre video promozionali per Grammarly, per i quali le verrà pagata una piccola somma per ciascuno.

"A questo punto stiamo cercando di lavorare insieme per convincere le università a ripensare le loro politiche sull'intelligenza artificiale", afferma Stevens.

Per Grammarly, sembra chiaro che l'obiettivo è cambiare la narrazione rispetto al primo video di Stevens, in cui diceva: "Se hai un articolo, un saggio, un post di discussione, qualsiasi cosa che viene inviata a TurnItIn, disinstalla Grammarly adesso." .”

La responsabile dell'istruzione di Grammarly, Jenny Maxwell, afferma che spera di diffondere il messaggio su quanto siano imprecisi i rilevatori di intelligenza artificiale.

"Molte istituzioni a livello di facoltà non sono consapevoli di quanto spesso questi servizi di rilevamento dell'intelligenza artificiale siano sbagliati", afferma. “Vogliamo assicurarci che le istituzioni siano consapevoli di quanto possa essere pericoloso avere questi rilevatori di intelligenza artificiale come unica fonte di verità”.

Tali difetti sono stati Ben documentatoe diversi ricercatori hanno affermato che i professori non dovrebbero utilizzare questi strumenti. Anche Turnitin ha dichiarato pubblicamente che il suo strumento di rilevamento dell'intelligenza artificiale non è sempre affidabile.

Annie Chechitelli, Chief Product Officer di Turnitin, afferma che i suoi strumenti di rilevamento dell'intelligenza artificiale hanno un tasso di falsi positivi di circa l'1% secondo i test dell'azienda e che sta lavorando per ridurlo il più basso possibile.

"Probabilmente lasciamo che circa il 15% [del testo scritto dai bot] non venga segnalato", afferma. “Preferiremmo ridurre la nostra precisione piuttosto che aumentare il nostro tasso di falsi positivi”.

Chechitelli sottolinea che gli insegnanti dovrebbero utilizzare il sistema di rilevamento di Turnitin come punto di partenza per una conversazione con uno studente, non come una sentenza definitiva sull'integrità accademica del lavoro dello studente. E dice che questo è stato anche il consiglio dell'azienda per il suo sistema di rilevamento del plagio.

"Abbiamo dovuto insegnare agli insegnanti che questa non è una prova che lo studente ha imbrogliato", afferma. "Abbiamo sempre detto che l'insegnante deve prendere una decisione."

Tuttavia, l’intelligenza artificiale mette gli educatori in una posizione più impegnativa per tale conversazione, riconosce Chechitelli. Nei casi in cui lo strumento Turnitin rileva un plagio, il sistema punta al materiale originale che lo studente potrebbe aver copiato. Nel caso del rilevamento dell'intelligenza artificiale, non c'è materiale di origine chiaro a cui rivolgersi, poiché strumenti come ChatGPT forniscono risposte diverse ogni volta che un utente inserisce un messaggio, rendendo molto più difficile dimostrare che la fonte è un bot.

Il funzionario di Turnitin afferma che nei test interni dell'azienda, i tradizionali strumenti di controllo grammaticale non fanno scattare gli allarmi.

Maxwell, di Grammarly, sottolinea che anche se un sistema di rilevamento tramite intelligenza artificiale ha ragione nel 98% dei casi, ciò significa che contrassegna erroneamente, diciamo, il 2% dei documenti. E poiché una singola università può consegnare 50,000 documenti studenteschi ogni anno, ciò significa che se tutti i professori utilizzassero un sistema di rilevamento basato sull’intelligenza artificiale, 1,000 documenti sarebbero falsamente chiamati casi di imbroglio.

Maxwell teme che le università possano scoraggiare l'uso del suo prodotto? Dopotutto, l'Università della Georgia del Nord ha recentemente rimosso Grammarly da un elenco di risorse consigliate dopo che i video TikTok di Stevens sono diventati virali, anche se in seguito lo hanno aggiunto di nuovo.

"Ci siamo incontrati con l'Università della Georgia del Nord e hanno detto che questo non ha nulla a che fare con Grammarly", afferma Maxwell. "Siamo lieti di vedere quanti altri professori e studenti sono inclini alla direzione opposta, dicendo: 'Questo è il nuovo mondo del lavoro e dobbiamo capire l'uso appropriato di questi strumenti.' Non puoi rimettere il dentifricio nel tubetto."

Per Tricia Bertram Gallant, direttrice dell'Academic Integrity Office presso l'Università della California a San Diego ed esperta nazionale in materia di imbrogli, la questione più importante nel caso di questo studente non riguarda la tecnologia. Secondo lei, la domanda più grande riguarda se le università dispongano di sistemi efficaci per gestire le accuse di cattiva condotta accademica.

"Sarei molto dubbiosa che uno studente venga accusato di imbrogliare solo da un correttore di grammatica e ortografia", dice, "ma se questo è vero, i chatbot di intelligenza artificiale non sono il problema, il problema sono la politica e il processo."

"Se un membro della facoltà può utilizzare uno strumento, accusare uno studente e dargli uno zero e il gioco è fatto, questo è un problema", afferma. "Non è un problema di strumento."

Dice che concettualmente gli strumenti di intelligenza artificiale non sono diversi dagli altri modi in cui gli studenti hanno imbrogliato per anni, ad esempio assumere altri studenti per scrivere i loro documenti per loro.

"Per me è strano che le università stiano elaborando una politica completamente separata per l'uso dell'intelligenza artificiale", afferma. "Tutto quello che abbiamo fatto nella nostra politica è stato aggiungere la parola 'macchina'", aggiunge, sottolineando che ora la politica di integrità accademica vieta esplicitamente di usare una macchina per svolgere un lavoro destinato allo studente.

Suggerisce che gli studenti dovrebbero assicurarsi di tenere traccia di come utilizzano gli strumenti che li assistono, anche se un professore consente l'uso dell'intelligenza artificiale durante il compito. "Dovrebbero assicurarsi di conservare la cronologia chat" in ChatGPT, afferma, "in modo da poter avere una conversazione sul loro processo" se in seguito vengono sollevate domande.

Un panorama in rapido cambiamento

Sebbene i correttori grammaticali e ortografici siano in circolazione da anni, molti di loro ora stanno aggiungendo nuove funzionalità di intelligenza artificiale che complicano le cose per i professori che cercano di capire se gli studenti hanno pensato bene dietro al lavoro che consegnano.

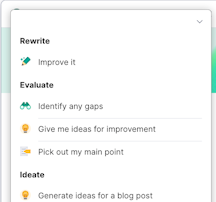

Ad esempio, Grammarly ora ha nuove opzioni, la maggior parte delle quali in una versione a pagamento a cui Stevens non è abbonato, che utilizzano l'intelligenza artificiale generativa per fare cose come "aiutare a fare brainstorming sugli argomenti per un compito" o "costruire un piano di ricerca", come un recente comunicato stampa dalla compagnia lo ha detto.

Maxwell, di Grammarly, afferma che l'azienda sta cercando di implementare attentamente queste nuove funzionalità e di creare misure di sicurezza per impedire agli studenti di chiedere semplicemente al bot di svolgere il proprio lavoro per loro. E dice che quando le scuole adotteranno il suo strumento, potranno disattivare le funzionalità dell’intelligenza artificiale generativa. "Sono genitore di una quattordicenne", afferma, aggiungendo che gli studenti più giovani che stanno ancora imparando le basi hanno esigenze diverse rispetto a quelli più grandi.

Chechitelli, di Turnitin, afferma che è un problema per gli studenti il fatto che Grammarly e altri strumenti di produttività ora integrino ChatGPT e facciano molto di più che semplicemente correggere la sintassi della scrittura. Questo perché, secondo lei, gli studenti potrebbero non comprendere le nuove funzionalità e le loro implicazioni.

"Un giorno accedono e hanno nuove scelte e scelte diverse", afferma. "Penso davvero che sia fonte di confusione."

Per il leader di Turnitin, il messaggio più importante per gli educatori oggi è la trasparenza nell’eventuale aiuto fornito dall’intelligenza artificiale.

"Il mio consiglio è di prestare attenzione agli strumenti che utilizzi e di assicurarti di poter mostrare agli insegnanti l'evoluzione dei tuoi compiti o di essere in grado di rispondere alle domande", afferma.

Gallant, esperto nazionale di integrità accademica, afferma che i professori devono essere consapevoli del numero crescente di strumenti di intelligenza artificiale generativa a cui gli studenti hanno accesso.

"La grammatica va ben oltre la grammatica e il controllo ortografico", afferma. “La grammatica è come qualsiasi altro strumento: può essere utilizzata in modo etico o non etico. È il modo in cui vengono utilizzati o il modo in cui i loro usi vengono oscurati.

Gallant afferma che anche i professori si scontrano con questi limiti etici nei loro scritti e nelle loro pubblicazioni su riviste accademiche. Dice di aver sentito parlare di professori che usano ChatGPT per comporre articoli di giornale e poi "dimenticano di prendere parte alla parte in cui l'intelligenza artificiale suggerisce idee".

C'è qualcosa di seducente nella facilità con cui questi nuovi strumenti di intelligenza artificiale generativa possono produrre testi ben formattati, aggiunge, e che può far credere alle persone che stanno facendo un lavoro quando tutto ciò che stanno facendo è inserire un prompt in una macchina.

"C'è questa mancanza di autoregolamentazione - per tutti gli esseri umani ma in particolare per i principianti e i giovani - tra quando mi assiste e quando fa il lavoro per me", dice Gallant.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://www.edsurge.com/news/2024-04-04-can-using-a-grammar-checker-set-off-ai-detection-software