Opera प्रकट आज इसकी पहल लगभग 150 विभिन्न मॉडल परिवारों से उत्पन्न 50 स्थानीय बड़े भाषा मॉडल (एलएलएम) वेरिएंट के लिए प्रयोगात्मक समर्थन को शामिल करने की है। यह सुविधा सबसे पहले डेवलपर स्ट्रीम पर ओपेरा वन में अपना रास्ता खोजेगी और इसे अपने साथ लाएगी 150 से अधिक परिवारों से 50 मॉडल जिसे उपयोगकर्ता चुन सकते हैं।

इनमें शामिल हैं विकग्ना और लामा क्रमशः गूगल और मेटा से। इसका मतलब यह है कि यह सुविधा उपभोक्ताओं के लिए ओपेरा के एआई फ़ीचर ड्रॉप्स प्रोग्राम के माध्यम से आ रही है और ऐसे कुछ एआई सुविधाओं तक शीघ्र पहुंच प्रदान करेगी। वे मॉडल आपके ब्राउज़र के माध्यम से आपके कंप्यूटर पर चलते हैं और ओलामा ओपन-सोर्स फ्रेमवर्क के साथ चलते हैं। अभी पेश किए जा रहे सभी मॉडल ओलामा लाइब्रेरी से चुने गए हैं, लेकिन कंपनी को उम्मीद है कि भविष्य में इसमें अन्य स्रोतों से भी कुछ शामिल होंगे।

इनमें से प्रत्येक को आपके स्थानीय पीसी पर 2GB से अधिक स्थान की आवश्यकता होगीकंपनी के मुताबिक. इस प्रकार, जगह की कमी से बचने के लिए, अपनी खाली जगह का बुद्धिमानी से उपयोग करें। दिलचस्प बात यह है कि यदि ओपेरा मॉडल रूप में डाउनलोड हो रहा है तो वह डेटा को सहेजने का प्रयास नहीं करता है।

आप अन्य मॉडलों को HuggingFace और PoE जैसी वेबसाइटों पर Quora पर भी ऑनलाइन देख सकते हैं, इसलिए यह वास्तव में आपकी स्थानीय मॉडल परीक्षण आवश्यकताओं के लिए है।

बड़े भाषा मॉडल अब सीधे उपयोगकर्ता के डिवाइस पर डेटा प्रोसेसिंग का समर्थन करते हैं, इस प्रकार जानकारी को निजी और किसी भी बाहरी सर्वर से दूर रखते हुए जेनरेटिव एआई के उपयोग को सक्षम करते हैं। ओपेरा ने अपने नए एआई फ़ीचर ड्रॉप्स प्रोग्राम के हिस्से के रूप में, ओपेरा वन डेवलपर चैनल के माध्यम से स्थानीय एलएलएम में इस अभिनव दृष्टिकोण को पेश करने की योजना की घोषणा की है। यह पहल शुरुआती उपयोगकर्ताओं को ब्राउज़र की AI सुविधाओं के अत्याधुनिक संस्करणों को तुरंत और नियमित रूप से आज़माने का मौका प्रदान करती है। आज से ओपेरा वन डेवलपर के उपयोगकर्ताओं को अपने डेटा को संसाधित करने के लिए पसंदीदा मॉडल का चयन करने की स्वतंत्रता होगी।

ओपेरा में बिल्ट-इन एलएलएम कैसे आज़माएँ?

इन मॉडलों के साथ जुड़ने के लिए, उपयोगकर्ताओं को चाहिए नवीनतम ओपेरा डेवलपर संस्करण में अपग्रेड करें और चरणों की एक श्रृंखला निष्पादित करें इस रोमांचक कार्यक्षमता को सक्षम करने के लिए:

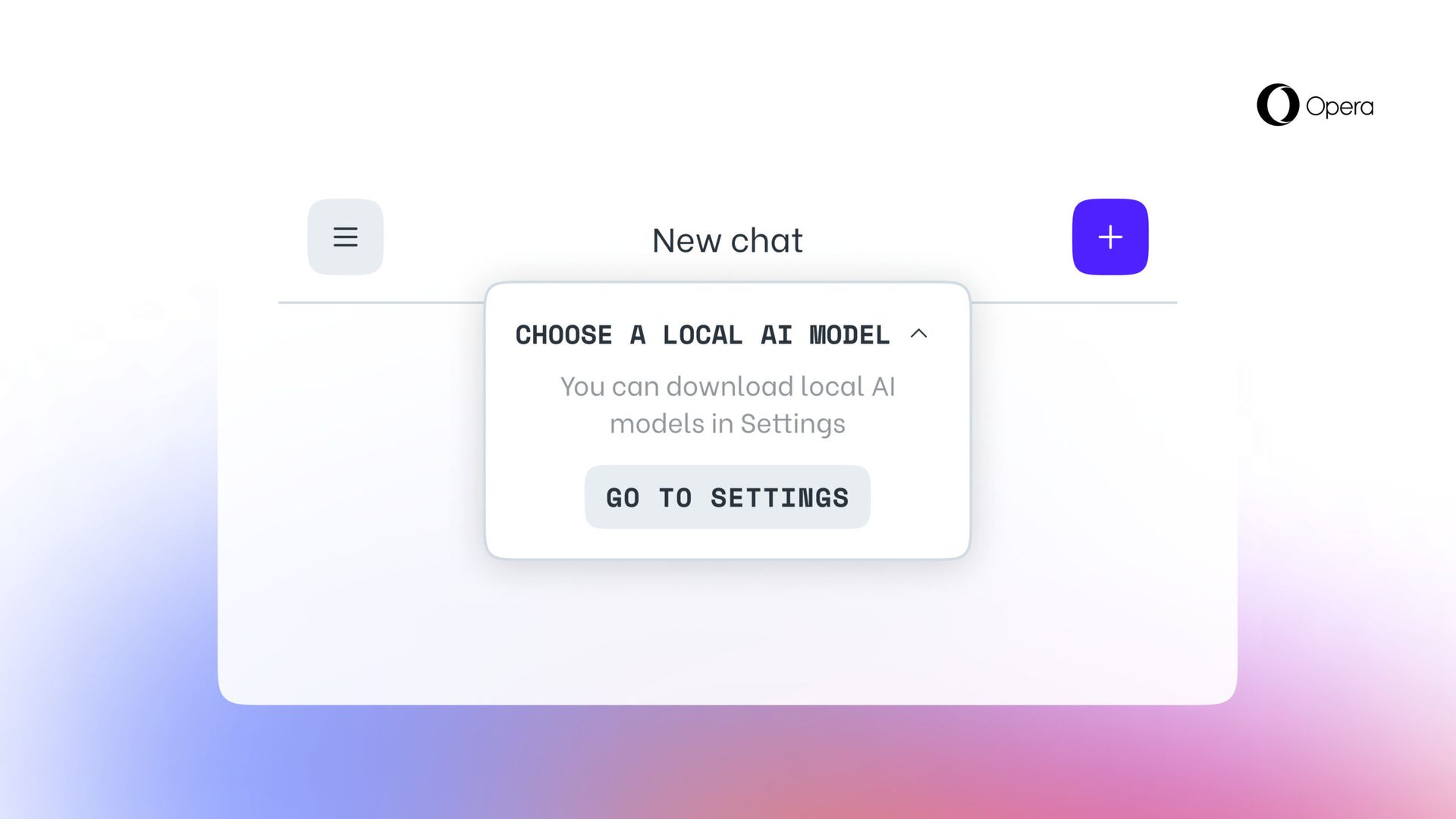

- एरिया चैट साइडबार तक पहुंचें जैसा कि आपने पहले किया है। चैट के शीर्ष पर, "लेबल वाला एक ड्रॉप-डाउन मेनू हैस्थानीय मोड चुनें."

- "का चयन करेंसेटिंग्स में जाओइस मेनू से.

- यह क्षेत्र आपको इसकी अनुमति देता है पता लगाएं और तय करें कि आप कौन सा मॉडल डाउनलोड करना चाहते हैं।

- छोटे और तेज़ विकल्प के लिए, नामित मॉडल को डाउनलोड करने पर विचार करें जेम्मा:2बी-इंस्ट्रक्ट-क्यू4_के_एम इसके दाईं ओर स्थित डाउनलोड आइकन पर क्लिक करके।

- एक बार डाउनलोड फाइनल हो जाने पर, नया चैट सत्र आरंभ करने के लिए ऊपरी बाएँ कोने में मेनू बटन पर क्लिक करें।

- फिर से, आपको चैट के शीर्ष पर एक ड्रॉप-डाउन मेनू दिखाई देगा "स्थानीय मोड चुनें” जहां आप उस मॉडल का चयन कर सकते हैं जिसे आपने अभी स्थापित किया है।

- चैट में अपना संकेत दर्ज करें, और स्थानीय रूप से होस्ट किया गया मॉडल जवाब देगा।

प्रतिभागी अपने डिवाइस पर डाउनलोड करने के लिए एक स्थानीय एलएलएम का चयन करेंगे। इस दृष्टिकोण के बीच की आवश्यकता है 2 से 10 जीबी स्टोरेज प्रत्येक संस्करण के लिए, एरिया, ओपेरा के अंतर्निहित ब्राउज़र एआई का उपयोग करने का विकल्प प्रदान करता है। यह सेटअप तब तक बना रहता है जब तक उपयोगकर्ता एआई के साथ एक नई बातचीत शुरू नहीं करता है या एरिया को फिर से सक्रिय करने का विकल्प नहीं चुनता है।

विशेष रुप से प्रदर्शित छवि क्रेडिट: Opera

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोडेटा.नेटवर्क वर्टिकल जेनरेटिव एआई। स्वयं को शक्तिवान बनाएं। यहां पहुंचें।

- प्लेटोआईस्ट्रीम। Web3 इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- प्लेटोईएसजी. कार्बन, क्लीनटेक, ऊर्जा, पर्यावरण, सौर, कचरा प्रबंधन। यहां पहुंचें।

- प्लेटोहेल्थ। बायोटेक और क्लिनिकल परीक्षण इंटेलिजेंस। यहां पहुंचें।

- स्रोत: https://dataconomy.com/2024/04/03/opera-unveils-built-in-llms-that-run-locally/