Introduction

Dans le domaine dynamique de l’intelligence artificielle, la fusion de la technologie et de la créativité a donné naissance à des outils innovants qui repoussent les limites de l’imagination humaine. Parmi ces avancées pionnières se trouve le monde sophistiqué des encodeurs et décodeurs dans l’IA générative. Cette évolution révolutionne la façon dont nous créons, interprétons et interagissons avec l’art, le langage et même la réalité.

Objectifs d'apprentissage

- Comprendre le rôle des encodeurs et des décodeurs dans l'IA générative et leur importance dans les applications créatives.

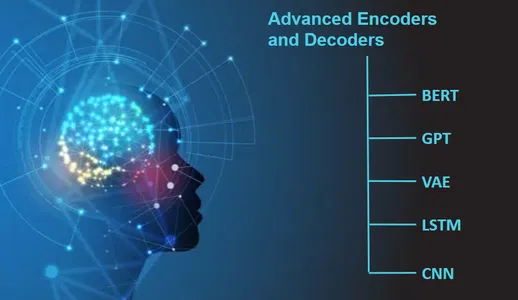

- Découvrez les modèles d'IA avancés tels que BERT, GPT, VAE, LSTM et CNN et leur utilisation pratique dans l'encodage et le décodage des données.

- Explorez les applications en temps réel des encodeurs et décodeurs dans divers domaines.

- Obtenez des informations sur les considérations éthiques et l’utilisation responsable du contenu généré par l’IA.

- Reconnaissez la collaboration créative et le potentiel d’innovation en appliquant des encodeurs et décodeurs avancés.

Cet article a été publié dans le cadre du Blogathon sur la science des données.

Table des matières

L’essor des encodeurs et décodeurs

Dans le monde technologique en constante évolution, les encodeurs et les décodeurs sont devenus des héros méconnus, apportant une touche créative à l’intelligence artificielle (IA) et à l’IA générative. Ils sont comme les baguettes magiques que l’IA utilise pour comprendre, interpréter et créer des choses comme de l’art, du texte, des sons et bien d’autres encore d’une manière qui nous éblouit tous.

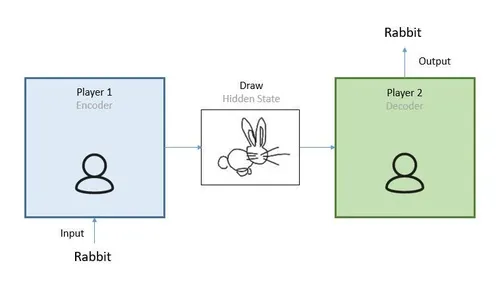

Voici le problème : les encodeurs sont comme des détectives super-observateurs. Ils examinent attentivement les choses, qu'il s'agisse d'images, de phrases ou de sons. Ils captent tous les petits détails et motifs comme un détective rassemblant des indices.

Désormais, les décodeurs sont les assistants créatifs. Ils prennent ce que Encoders a trouvé et le transforment en quelque chose de nouveau et d'excitant. C'est comme un sorcier transformant des indices en sorts magiques qui créent de l'art, des poèmes ou même des langues. Cette combinaison d'encodeurs et de décodeurs ouvre la porte à un monde de possibilités créatives.

En termes plus simples, les encodeurs et les décodeurs de l’IA sont comme des détectives et des sorciers travaillant ensemble. Les détectives comprennent le monde et les sorciers transforment cette compréhension en créations étonnantes. C’est ainsi qu’ils changent la donne en matière d’art, de langage et bien plus encore, rendant la technologie non seulement innovante mais brillamment créative.

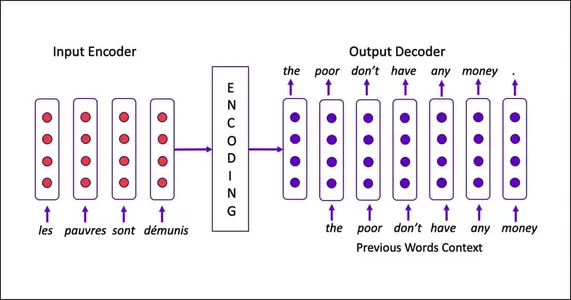

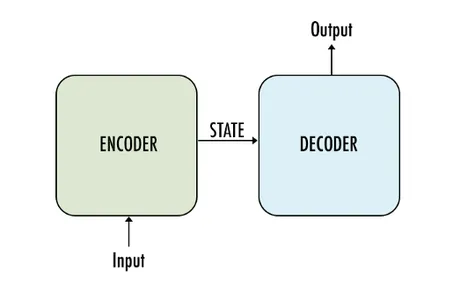

Les éléments de base : encodeurs et décodeurs

C’est au cœur de Lavaux, IA générative sont des encodeurs et des décodeurs, des composants fondamentaux qui transforment les données d'une forme à une autre, ce qui en fait un pilier essentiel de l'IA créative. Comprendre leurs rôles aide à saisir l’immense potentiel créatif qu’ils libèrent.

- L'encodeur : Ce composant est avant tout une question de compréhension. Il décompose les données d'entrée – une image, un texte ou un son – en ses composants principaux, capturant leur essence et extrayant des modèles complexes. Imaginez-le comme un artiste attentif qui observe attentivement les détails, les couleurs et les formes d'une scène.

- Le décodeur : C'est ici que la magie opère. Le décodeur traduit les informations extraites en quelque chose de nouveau : une œuvre d'art, un vers poétique ou même un langage totalement différent. Le génie créatif transforme l’essence de l’Encoder en un chef-d’œuvre.

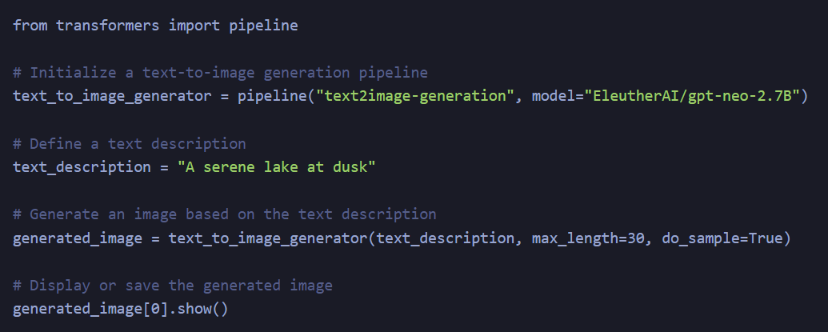

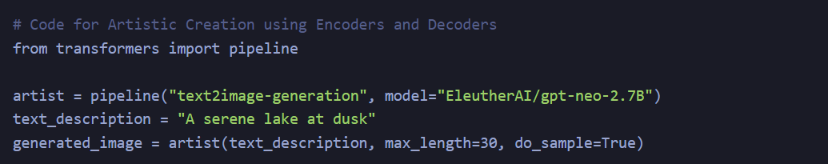

Exemple de code en temps réel

Pour mieux comprendre les concepts d'encodeurs et de décodeurs dans l'IA générative, considérons un exemple de code en temps réel pour la génération de texte en image. Nous utiliserons la bibliothèque Hugging Face Transformers, qui propose des modèles pré-entraînés pour diverses tâches génératives. Dans cet exemple, nous utiliserons un encodeur pour interpréter une description textuelle et un décodeur pour créer une image basée sur cette description.

Explication

- Nous commençons par importer la classe pipeline depuis la bibliothèque Hugging Face Transformers. La classe pipeline simplifie l'utilisation de modèles pré-entraînés pour diverses tâches PNL et génératives.

- Nous initialisons un pipeline text_to_image_generator, spécifiant que nous souhaitons effectuer une génération de texte en image. Nous spécifions également le modèle pré-entraîné à utiliser, dans ce cas, « EleutherAI/gpt-neo-2.7B ».

- Ensuite, nous définissons une text_description. Cette description textuelle sera l’entrée de notre encodeur. Dans cet exemple, il s'agit de « Un lac serein au crépuscule ».

- Nous utilisons text_to_image_generator pour générer une image basée sur la description fournie. Le paramètre max_length contrôle la longueur maximale de la description de l'image générée, et do_sample=True permet à l'échantillonnage de produire diverses images.

- Vous pouvez afficher ou enregistrer l'image générée. La fonction show() affiche l'image dans l'extrait de code ci-dessus.

Dans cet extrait de code, l'encodeur traite la description textuelle tandis que le décodeur génère une image basée sur le contenu de la description textuelle mentionnée. Cela nous montre comment les encodeurs et les décodeurs travaillent ensemble pour transformer les données d'une forme (texte) à une autre (image), libérant ainsi le potentiel créatif.

L'exemple simplifie le processus pour illustrer le concept, mais les applications du monde réel peuvent impliquer des modèles et un prétraitement de données plus complexes.

Capacités Avancées

Le charme naturel de ces AI systèmes réside dans leurs capacités avancées. Ils peuvent travailler avec différents types de données, ce qui en fait des outils polyvalents pour les efforts créatifs. Examinons quelques applications passionnantes :

- Langue et traduction : Les encodeurs avancés peuvent prendre une phrase dans une langue, comprendre sa signification, puis demander aux décodeurs de produire la même phrase dans une autre langue. C'est comme avoir un poète multilingue à votre disposition.

- Art et style : Les encodeurs peuvent déchiffrer l'essence de différents styles artistiques, du classique de la Renaissance à l'abstrait moderne, puis les décodeurs peuvent appliquer ces styles à de nouvelles œuvres d'art. C'est comme si un artiste pouvait peindre dans le style qu'il désire.

- Texte en image : Un encodeur peut comprendre une description textuelle et un décodeur peut lui donner vie en créant une image basée sur cette description. Considérez-le comme un illustrateur alimenté par l'IA.

- Voix et son : Ces composants avancés ne se limitent pas au domaine visuel ou textuel. Les encodeurs peuvent comprendre les émotions d'une voix et les décodeurs peuvent générer de la musique ou de la parole qui transmettent ces émotions. C'est comme avoir un compositeur qui comprend les sentiments.

Favoriser la collaboration créative

L’un des aspects les plus intéressants des encodeurs et décodeurs dans l’IA générative est leur potentiel à faciliter la collaboration créative. Ces systèmes d'IA peuvent comprendre, traduire et transformer des œuvres créatives sur divers supports, comblant ainsi les fossés entre les artistes, les écrivains, les musiciens, etc.

Considérez la peinture d'un artiste transformée en poésie ou la mélodie d'un musicien transformée en art visuel. Ce ne sont plus des rêves tirés par les cheveux mais des possibilités tangibles grâce aux encodeurs et décodeurs avancés. Des collaborations qui semblaient auparavant improbables trouvent désormais leur chemin grâce au langage de l’IA.

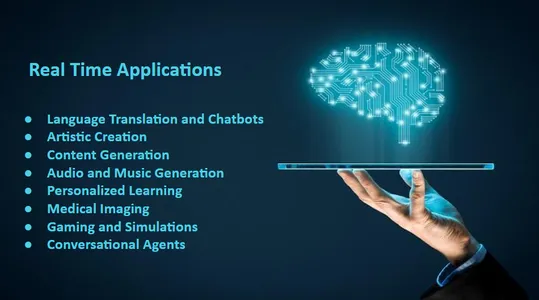

Application en temps réel des encodeurs et décodeurs dans l'IA générative

Les applications en temps réel des encodeurs et décodeurs dans l’IA générative recèlent un immense potentiel dans divers domaines. Ces composants avancés d’IA ne se limitent pas à des concepts théoriques mais transforment activement la façon dont nous interagissons avec la technologie. Examinons quelques cas d'utilisation réels :

Traduction linguistique et chatbots

Les encodeurs décodent et encodent une langue dans une autre, rendant possible la traduction linguistique en temps réel. Cette technologie sous-tend les chatbots qui peuvent converser de manière transparente dans plusieurs langues, facilitant ainsi la communication et le service client à l’échelle mondiale.

Ce code utilise la bibliothèque Hugging Face Transformers pour créer un modèle de traduction linguistique. Un encodeur traite le texte saisi (anglais) et un décodeur génère le texte traduit (français) en temps réel.

Création Artistique

Les artistes utilisent les encodeurs pour extraire l'essence d'un style ou d'un genre, et les décodeurs recréent des œuvres d'art dans ce style. Cette transformation en temps réel permet une production artistique rapide sous diverses formes, des peintures de la Renaissance aux œuvres abstraites modernes.

Ce code exploite un modèle de génération de texte en image de la bibliothèque Hugging Face Transformers. Un encodeur déchiffre la description textuelle et un décodeur génère une image qui correspond à la description, permettant une création artistique en temps réel.

Génération de contenu

Les encodeurs analysent les descriptions de texte et les décodeurs leur donnent vie grâce à des images, offrant des applications pratiques dans la publicité, le commerce électronique et la génération de contenu. Transformez les annonces immobilières en expériences visuelles immersives et les descriptions de produits peuvent générer les visuels correspondants.

Ce code utilise un modèle de génération texte à texte de Hugging Face Transformers. L'encodeur traite une description textuelle et le décodeur génère plusieurs descriptions alternatives pour la génération de contenu en temps réel.

Génération audio et musicale

Les encodeurs capturent les signaux émotionnels de la voix et les décodeurs génèrent des paroles ou de la musique expressives en temps réel. Cela trouve des applications dans les assistants vocaux, la création de contenu audio et même le soutien à la santé mentale, où l'IA peut fournir des conversations réconfortantes.

Ce code utilise un modèle de synthèse vocale pour convertir le texte en parole (audio). Bien que la génération audio en temps réel soit plus complexe, cet exemple simplifié montre l'utilisation d'un encodeur pour interpréter le texte saisi et d'un décodeur pour générer l'audio.

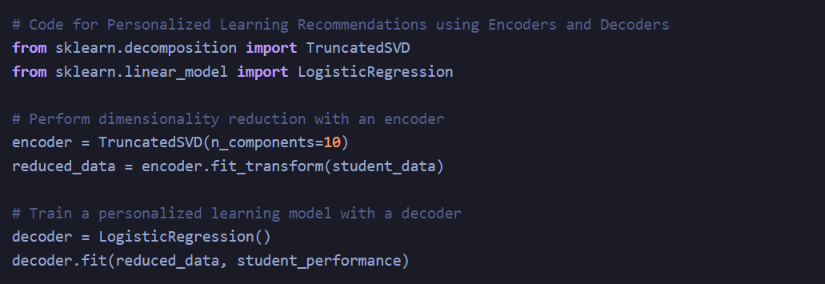

Apprentissage personnalisé

Dans le domaine de l'éducation, les encodeurs et décodeurs aident à créer du matériel d'apprentissage personnalisé. Les manuels peuvent être convertis en leçons interactives avec des éléments visuels, et les applications d'apprentissage des langues peuvent fournir une aide à la traduction et à la prononciation en temps réel.

Dans l'apprentissage personnalisé, un encodeur peut réduire la dimensionnalité des données des élèves, et un décodeur, dans ce cas, un modèle de régression logistique, peut prédire les performances des élèves sur la base des données réduites. Bien qu’il s’agisse d’un exemple simplifié, les systèmes d’apprentissage personnalisé sont généralement beaucoup plus complexes.

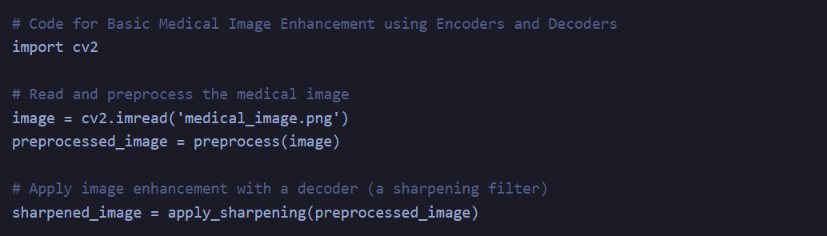

L'imagerie médicale

Les encodeurs peuvent analyser les images médicales et les décodeurs aident à améliorer les images ou à fournir un retour d'information en temps réel. Cela aide les médecins dans les diagnostics et les procédures chirurgicales, offrant des informations rapides et précises.

Ce code présente un exemple simple d'amélioration d'image médicale, dans lequel un encodeur traite et prétraite l'image, et un décodeur (filtre de netteté) améliore la qualité de l'image. Les véritables applications d’imagerie médicale impliquent des modèles spécialisés et un respect strict des normes de santé.

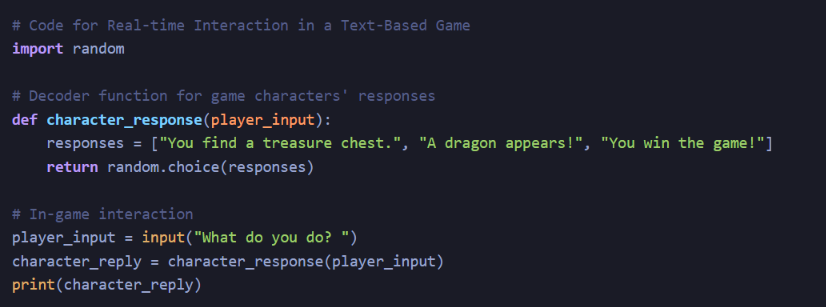

Jeux et simulations

L'interaction en temps réel avec les personnages pilotés par l'IA est possible grâce aux encodeurs et décodeurs. Ces personnages peuvent s'adapter, réagir et impliquer les joueurs de manière réaliste dans des jeux vidéo et des simulations d'entraînement.

Bien qu'il s'agisse d'un exemple très simplifié, dans les jeux et les simulations, les interactions en temps réel avec les personnages impliquent souvent des systèmes d'IA complexes et peuvent ne pas utiliser directement les encodeurs et décodeurs en tant que composants autonomes.

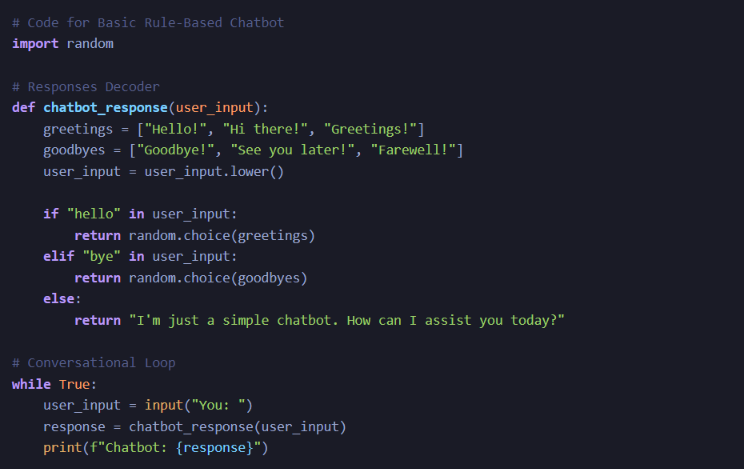

Agents conversationnels

Les encodeurs aident les machines à comprendre les émotions humaines et le contexte, tandis que les décodeurs leur permettent de réagir avec empathie. Ceci est inestimable dans les systèmes virtuels de soutien à la santé mentale et les compagnons d’IA pour les personnes âgées.

Il s'agit d'un chatbot basé sur des règles, et bien qu'il implique le codage des entrées de l'utilisateur et le décodage des réponses, les agents conversationnels complexes utilisent souvent des modèles sophistiqués de compréhension du langage naturel pour l'empathie et les réponses contextuelles.

Ces applications en temps réel mettent en évidence l'impact transformateur des encodeurs et des décodeurs dans l'IA générative, transcendant la simple théorie pour enrichir notre vie quotidienne de manière remarquable.

Explorer les encodeurs et décodeurs avancés

BERT (Représentations d'encodeur bidirectionnel à partir de transformateurs)

BERT est un modèle d'encodeur utilisé pour comprendre le langage. Il est bidirectionnel, ce qui signifie qu'il prend en compte à la fois le contexte gauche et droit des mots dans une phrase. Cette formation bidirectionnelle approfondie permet à BERT de comprendre le contexte des mots. Par exemple, on peut comprendre que « banque » fait référence à une institution financière dans la phrase « Je suis allé à la banque » et à une berge de rivière dans « Je me suis assis près de la banque ». Il est formé sur une quantité massive de données textuelles, apprenant à prédire les mots manquants dans les phrases.

- Encodeur : l'encodeur de BERT est bidirectionnel, ce qui signifie qu'il prend en compte à la fois le contexte gauche et droit d'un mot dans une phrase. Cette formation bidirectionnelle approfondie lui permet de comprendre le contexte des mots, ce qui le rend exceptionnellement apte à diverses tâches de compréhension du langage naturel.

- Décodeur : bien que BERT soit avant tout un encodeur, il est souvent combiné avec d'autres décodeurs dans des tâches telles que la génération de texte et la traduction de langues. Les décodeurs pour les modèles basés sur BERT peuvent être autorégressifs ou, dans certains cas, un autre décodeur de transformateur.

Ce code utilise la bibliothèque de transformateurs Hugging Face pour charger un modèle BERT pré-entraîné pour l'encodage du texte. Il tokenise le texte d'entrée, le convertit en identifiants d'entrée, puis le transmet via le modèle BERT. Le encoder_output contient les représentations codées du texte d’entrée.

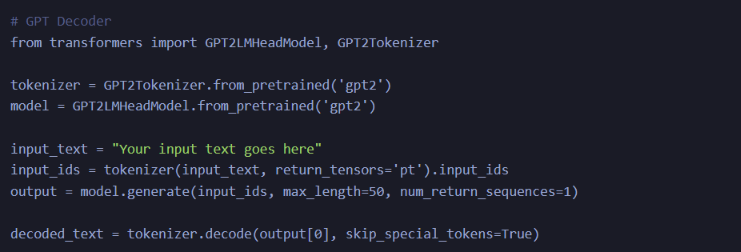

GPT (Transformateur Génératif Préformé)

Les modèles GPT sont des décodeurs qui génèrent du texte de type humain. Ils fonctionnent en prédisant le mot suivant dans une séquence en fonction du contexte des mots précédents. Par exemple, si les mots précédents sont « Le ciel est », GPT peut prédire que le mot suivant pourrait être « bleu ». Ils sont formés sur de grands corpus de textes pour apprendre la grammaire, le style et le contexte.

- Encodeur : les modèles GPT se concentrent sur l'aspect décodeur, générant un texte de type humain. Cependant, le décodeur de GPT peut également servir d'encodeur en inversant son modèle de langage, lui permettant ainsi d'extraire efficacement les informations du texte.

- Décodeur : L’aspect décodeur de GPT est ce qui le rend fascinant. Il génère du texte de manière autorégressive, prédisant le mot suivant en fonction du contexte des mots précédents. Le résultat est un texte cohérent et contextuellement pertinent.

Ce code utilise la bibliothèque de transformateurs de Hugging Face pour charger un modèle GPT-2 pré-entraîné pour la génération de texte. Il prend un texte d'entrée, le tokenise et génère du texte de manière autorégressive à l'aide du modèle GPT-2.

VAE (Autoencodeur variationnel)

Les VAE sont utilisés pour la génération d’images et de texte. L'encodeur mappe les données d'entrée dans un espace latent continu, une représentation de dimension inférieure. Par exemple, il peut mapper des images de chats en points dans cet espace. Le décodeur génère ensuite des images à partir de ces points. Lors de la formation, les VAE visent à rendre cet espace latent fluide et continu pour générer des images diversifiées et réalistes.

- Encoder: Les VAE sont couramment utilisés dans la génération d’images et de texte. L'encodeur mappe les données d'entrée dans un espace latent continu, particulièrement utile pour générer des images et des textes diversifiés et réalistes.

- Décodeur: Le décodeur mappe les points de l'espace latent dans l'espace de données. Il génère des images ou du texte à partir de points échantillonnés dans l'espace latent.

Ce code définit un auto-encodeur variationnel (VAE) dans TensorFlow/Keras. L'encodeur prend une image d'entrée, l'aplatit et la mappe à un espace latent avec une variance moyenne et logarithmique. Le décodeur prend un point de l'espace latent et reconstruit l'image.

LSTM (mémoire à long court terme)

Les LSTM sont des réseaux de neurones récurrents utilisés pour les données séquentielles. Ils codent des données séquentielles comme des phrases en considérant le contexte des éléments précédents de la séquence. Ils apprennent des modèles par séquences, ce qui les rend adaptés à des tâches telles que le traitement du langage naturel. Dans les auto-encodeurs, les LSTM réduisent les séquences en représentations de dimension inférieure et les décodent.

- Encoder: LSTM est un type de réseau neuronal récurrent (RNN) largement utilisé pour diverses tâches de données séquentielles, telles que le traitement du langage naturel. La cellule LSTM code les données séquentielles en considérant le contexte des éléments précédents de la séquence.

- Décodeur: Bien que les LSTM soient plus souvent utilisés comme encodeurs, ils peuvent également être associés à un autre LSTM ou à des couches entièrement connectées pour fonctionner comme un décodeur pour générer des séquences.

Ce code configure un simple auto-encodeur LSTM. Le codeur traite les séquences et les réduit à une représentation de dimension inférieure tandis que le décodeur reconstruit les séquences à partir de la représentation codée.

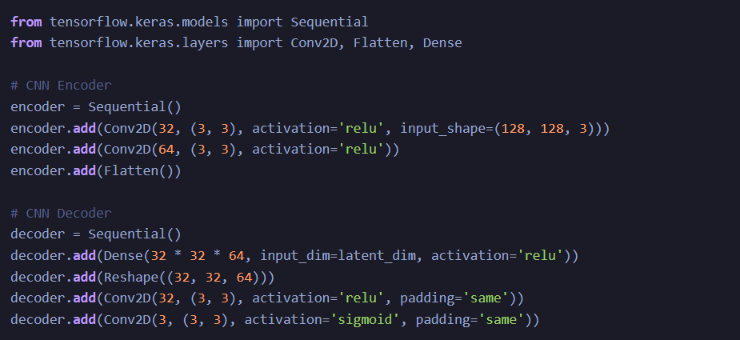

CNN (réseau neuronal convolutif)

Les CNN sont principalement utilisés pour l’analyse d’images. Ils fonctionnent comme des encodeurs en analysant les images à travers des couches convolutives, capturant des caractéristiques telles que les bords, les formes et les textures. Ces fonctionnalités peuvent être envoyées à un décodeur, comme un GAN, pour générer de nouvelles images. Les CNN sont formés pour reconnaître les modèles et les caractéristiques des images.

- Encoder: Les CNN sont principalement utilisés dans les tâches de vision par ordinateur en tant qu'encodeurs. Ils analysent les images en faisant évoluer des filtres sur l'entrée, capturant des caractéristiques à différentes échelles. Les fonctionnalités extraites peuvent être transmises à un décodeur pour des tâches telles que la génération d’images.

- Décodeur: Dans la génération d'images, les CNN peuvent être suivis par un décodeur, tel qu'un décodeur de réseau contradictoire génératif (GAN), pour synthétiser des images basées sur des fonctionnalités apprises.

Ces modèles avancés d’encodeur et de décodeur représentent l’épine dorsale de nombreuses applications d’IA générative. Leur flexibilité et leur adaptabilité ont permis aux chercheurs et aux développeurs de repousser les limites de ce qui est réalisable dans le traitement du langage naturel, la vision par ordinateur et divers autres domaines. À mesure que l’IA continue d’évoluer, ces modèles resteront à la pointe de l’innovation.

Ces modèles subissent une formation approfondie sur de grands ensembles de données pour apprendre les nuances de leurs tâches respectives. Ils sont adaptés pour remplir des fonctions spécifiques et sont à la pointe de l’innovation en matière d’IA.

Études de cas d'encodeurs et décodeurs avancés

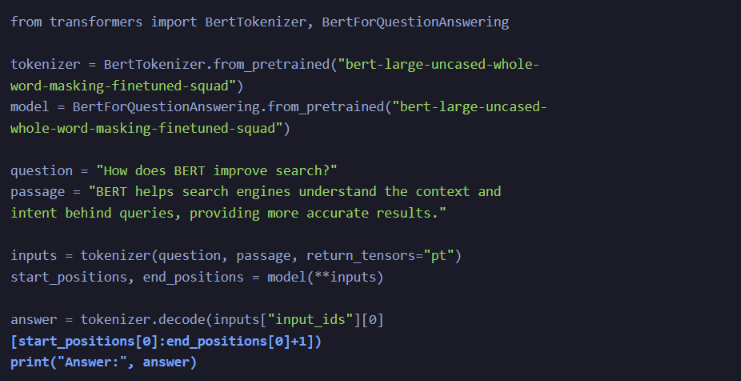

BERT dans les moteurs de recherche

- Google utilise BERT pour améliorer les résultats de ses moteurs de recherche. BERT aide à mieux comprendre le contexte et l'intention derrière les requêtes de recherche. Par exemple, si vous recherchez « Un voyageur brésilien aux États-Unis en 2019 a besoin d'un visa », les moteurs de recherche traditionnels se sont peut-être concentrés sur le mot-clé « visa ». Mais avec BERT, Google comprend que l'utilisateur recherche des informations sur un Brésilien voyageant aux États-Unis et sur ses exigences en matière de visa.

- Le modèle de recherche basé sur BERT de Google peut être démontré à l'aide de la bibliothèque Hugging Face Transformers. Ce code montre comment utiliser un modèle basé sur BERT pour améliorer la compréhension des requêtes de recherche :

Ce code utilise BERT pour améliorer les résultats de recherche en comprenant les requêtes des utilisateurs et le contexte du document, ce qui donne des réponses plus précises.

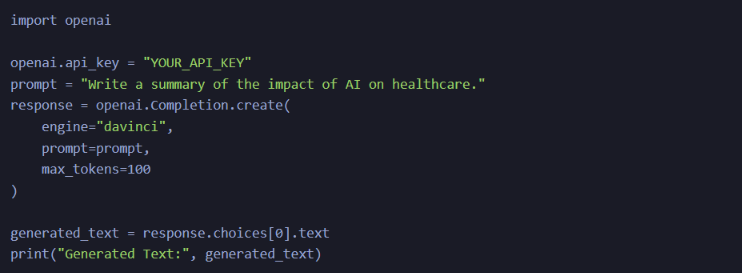

GPT-3 dans la génération de contenu

- Utilisez le GPT-3 d'OpenAI pour générer du contenu pour diverses applications. Il peut rédiger des articles, répondre à des questions et même créer des agents conversationnels. Les entreprises utilisent GPT-3 pour automatiser la génération de contenu, le support client et les assistants virtuels.

- Le GPT-3 d'OpenAI peut générer du texte pour diverses applications. Vous trouverez ci-dessous un exemple d'utilisation de l'API OpenAI GPT-3 pour la génération de contenu :

Avec GPT-3, vous pouvez générer du texte de type humain pour des tâches telles que la création de contenu ou les chatbots en utilisant l'API OpenAI.

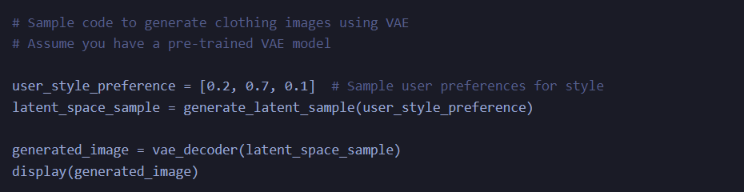

VAE dans la génération d'images

- Les VAE ont des applications dans la génération d’images pour la mode. Des entreprises comme Stitch Fix utilisent les VAE pour créer des recommandations vestimentaires personnalisées pour les utilisateurs. En connaissant les préférences de style des utilisateurs, ils peuvent générer des images de vêtements susceptibles de les intéresser.

- L'utilisation de VAE pour la génération d'images peut être présentée avec un code qui génère de nouvelles images en fonction des préférences de l'utilisateur, similaire à ce que fait Stitch Fix.

Cet extrait de code illustre comment les auto-encodeurs variationnels (VAE) peuvent créer des images basées sur les préférences de l'utilisateur, de la même manière que Stitch Fix suggère des vêtements en fonction des préférences de style.

LSTM dans la reconnaissance vocale

- Les systèmes de reconnaissance vocale, comme ceux utilisés par Alexa d'Amazon ou Siri d'Apple, utilisent souvent des LSTM. Ils traitent les données audio et les convertissent en texte. Ces modèles doivent prendre en compte le contexte des sons précédents pour transcrire la parole avec précision.

- Les LSTM sont couramment utilisés en reconnaissance vocale. Vous trouverez ci-dessous un exemple simplifié d'utilisation d'un modèle basé sur LSTM pour la reconnaissance vocale :

Ce code met en place un modèle de reconnaissance vocale basé sur LSTM, une technologie fondamentale d'assistants vocaux et de services de transcription.

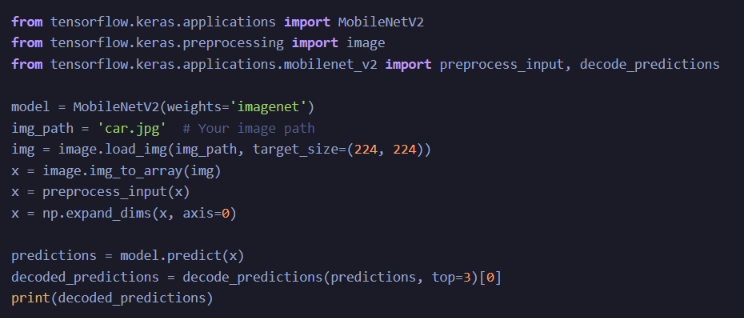

Les CNN dans les véhicules autonomes

- Les véhicules autonomes s'appuient sur les CNN pour l'analyse d'images en temps réel. Ils peuvent identifier des objets tels que des piétons, d'autres véhicules et des panneaux de signalisation. Ceci est essentiel pour prendre des décisions en une fraction de seconde en matière de conduite.

- Les véhicules autonomes s'appuient sur les CNN pour la détection d'objets. Voici un exemple simplifié d'utilisation d'un modèle CNN pré-entraîné pour la détection d'objets :

Dans le contexte des véhicules autonomes, les CNN, comme MobileNetV2, peuvent détecter des objets dans les images pour aider les voitures autonomes à prendre des décisions sur la route.

Ces extraits de code fournissent une démonstration pratique de la façon d’appliquer ces techniques d’IA dans divers scénarios du monde réel. Veuillez noter que les implémentations réelles sont souvent plus complexes et utilisent des ensembles de données étendus, mais ces exemples offrent une vue simplifiée de leur application.

Utilisation éthique et responsable

Comme pour tout outil puissant, l’utilisation éthique des encodeurs et décodeurs avancés est primordiale. Il est essentiel de garantir que le contenu généré par l’IA respecte les droits d’auteur, préserve la confidentialité et ne propage pas de matériel nuisible ou offensant. De plus, la responsabilité et la transparence dans le processus créatif sont essentielles, surtout lorsque l’IA joue un rôle important.

Conclusion

La fusion d'encodeurs et de décodeurs avancés dans l'IA générative marque une nouvelle ère de créativité, où les frontières entre les différentes formes d'art et de communication s'estompent. Qu'il s'agisse de traduire des langues, de recréer des styles artistiques ou de convertir du texte en images, ces composants d'IA sont les clés pour libérer une créativité innovante, collaborative et éthiquement responsable. Avec une utilisation responsable, ils peuvent remodeler la façon dont nous percevons et exprimons notre monde.

Faits marquants

- Les encodeurs et décodeurs de l’IA générative transforment la façon dont nous créons, interprétons et interagissons avec l’art, le langage et les données.

- Ces composants d'IA jouent un rôle essentiel dans la compréhension et la génération de diverses formes de données, notamment du texte, des images et de l'audio.

- Les applications en temps réel des encodeurs et décodeurs couvrent la traduction linguistique, la génération artistique, la création de contenu, la génération audio, l'apprentissage personnalisé, l'imagerie médicale, les jeux et les agents conversationnels.

- L’utilisation éthique et responsable du contenu généré par l’IA est cruciale, en mettant l’accent sur la confidentialité, la transparence et la responsabilité.

Foire aux Questions

T1. Que sont les encodeurs et les décodeurs dans l’IA générative ?

A. Les encodeurs sont des composants d'IA qui comprennent et extraient des informations essentielles à partir des données, tandis que les décodeurs génèrent des sorties créatives basées sur ces informations.

Q2. Comment les encodeurs et décodeurs profitent-ils au processus créatif ?

R. Ils permettent la traduction linguistique en temps réel, la création artistique, la génération de contenu, la génération audio et musicale, l'apprentissage personnalisé, et bien plus encore.

Q3. Quelles sont les applications en temps réel des encodeurs et décodeurs dans l’IA ?

R. Ces applications incluent la traduction linguistique, la génération artistique, la création de contenu, la génération audio, l'amélioration de l'imagerie médicale, les jeux interactifs et les agents conversationnels empathiques.

Q4. Comment les encodeurs et décodeurs favorisent-ils la collaboration créative ?

A. Ils comblent les écarts entre divers médiums de création, permettant aux artistes, écrivains et musiciens de collaborer sur des projets impliquant de multiples formes d'expression.

Les médias présentés dans cet article n'appartiennent pas à Analytics Vidhya et sont utilisés à la discrétion de l'auteur.

Services Connexes

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://www.analyticsvidhya.com/blog/2023/10/advanced-encoders-and-decoders-in-generative-ai/