See CAMBIO para conocer las últimas funciones y correcciones.

Probablemente haya experimentado el desafío de tomar notas durante una reunión mientras intenta prestar atención a la conversación. Probablemente también haya experimentado la necesidad de verificar rápidamente algo que se ha dicho o buscar información para responder una pregunta que se acaba de formular en la llamada. O tal vez tenga un miembro del equipo que siempre llega tarde a las reuniones y espera que le envíe un resumen rápido por chat para ponerse al día.

Luego, están las ocasiones en las que otras personas hablan en un idioma que no es su lengua materna y le encantaría tener una traducción en vivo de lo que la gente dice para asegurarse de que comprende correctamente.

Y una vez finalizada la llamada, normalmente desea capturar un resumen para sus registros, o enviarlo a los participantes, con una lista de todos los elementos de acción, propietarios y fechas de vencimiento.

Todo esto y más ahora es posible con nuestra solución de muestra más reciente, Live Meeting Assistant (LMA).

Consulte la siguiente demostración para ver cómo funciona.

En esta publicación, le mostramos cómo usar LMA con Amazon Transcribe, lecho rocoso del amazonasy Bases de conocimiento para Amazon Bedrock.

Resumen de la solución

La solución de muestra de LMA captura el audio y los metadatos del orador desde su aplicación de reuniones basada en navegador (al momento de escribir este artículo, Zoom y Chime son compatibles), o audio solo desde cualquier otra aplicación de reuniones, softphone o fuente de audio basada en navegador. Utiliza Amazon Transcribe para conversión de voz a texto, bases de conocimiento de Amazon Bedrock para consultas contextuales de los documentos y fuentes de conocimiento de su empresa, y modelos de Amazon Bedrock para obtener resúmenes e información de transcripción personalizable.

Todo lo que necesita se proporciona como código abierto en nuestro Repositorio GitHub. Es sencillo de implementar en su cuenta de AWS. Cuando hayas terminado, ¡te preguntarás cómo te las arreglaste sin él!

Las siguientes son algunas de las cosas que LMA puede hacer:

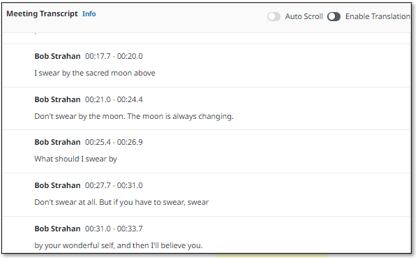

- Transcripción en vivo con atribución de orador – LMA funciona con modelos ASR de Amazon Transcribe para conversión de voz a texto de baja latencia y alta precisión. Puede enseñarle nombres de marcas y terminología específica de dominio si es necesario, utilizando vocabulario personalizado y características de modelos de lenguaje personalizados en Amazon Transcribe.

- Traducción en vivo – Utiliza Amazon Translate para mostrar opcionalmente cada segmento de la conversación traducido al idioma de su elección, entre una selección de 75 idiomas.

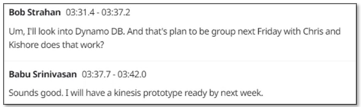

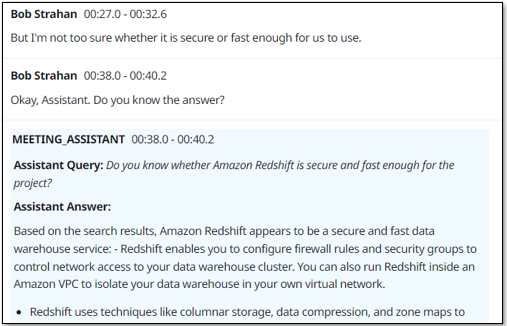

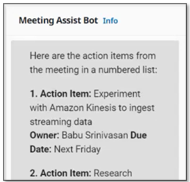

- Asistente de reuniones consciente del contexto – Utiliza las bases de conocimiento de Amazon Bedrock para brindar respuestas de sus fuentes confiables, utilizando la transcripción en vivo como contexto para la verificación de hechos y las preguntas de seguimiento. Para activar el asistente, simplemente diga "Está bien, Asistente", elija el ¡PREGUNTE AL ASISTENTE! o ingrese su propia pregunta en la interfaz de usuario.

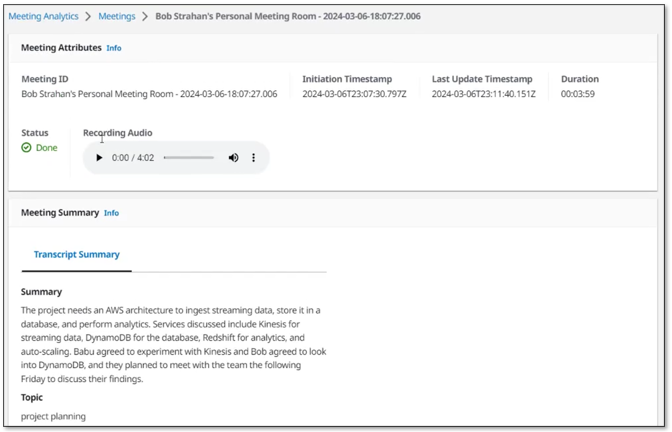

- Resúmenes de la reunión bajo demanda – Con solo hacer clic en un botón en la interfaz de usuario, puede generar un resumen, lo cual es útil cuando alguien se une tarde y necesita ponerse al día. Los resúmenes se generan a partir de la transcripción de Amazon Bedrock. LMA también ofrece opciones para identificar el tema de la reunión actual y para generar una lista de elementos de acción con propietarios y fechas de vencimiento. También puede crear sus propios mensajes personalizados y las opciones correspondientes.

- Resumen e información automatizados – Cuando finaliza la reunión, LMA ejecuta automáticamente un conjunto de mensajes de modelo de lenguaje grande (LLM) en Amazon Bedrock para resumir la transcripción de la reunión y extraer información. También puede personalizar estas indicaciones.

- Grabación de reuniones – El audio se almacena (opcionalmente) para que pueda reproducir secciones importantes de la reunión más adelante.

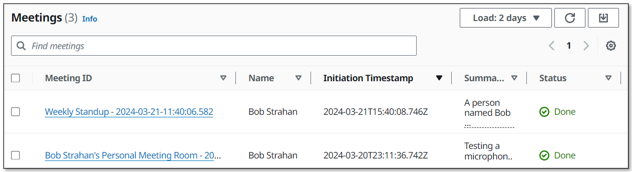

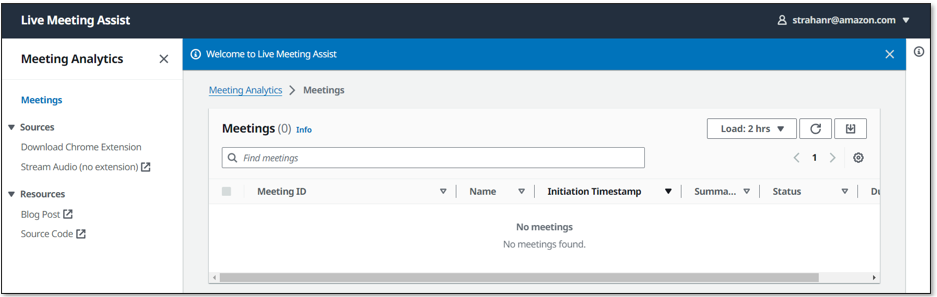

- Lista de inventario de reuniones. – LMA realiza un seguimiento de todas sus reuniones en una lista con capacidad de búsqueda.

- La extensión del navegador captura audio y metadatos de reuniones de aplicaciones de reuniones populares – La extensión del navegador captura los metadatos de la reunión (el título de la reunión y los nombres de los oradores activos) y el audio suyo (su micrófono) y de otras personas (desde la pestaña del navegador de la reunión). Al momento de escribir este artículo, LMA es compatible con Chrome para la extensión del navegador y Zoom y Chime para aplicaciones de reuniones (y próximamente Teams y WebEx). Las aplicaciones de reuniones independientes no funcionan con LMA; en su lugar, inicie sus reuniones en el navegador.

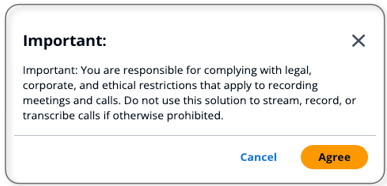

Usted es responsable de cumplir con las restricciones legales, corporativas y éticas que se aplican a la grabación de reuniones y llamadas. No utilice esta solución para transmitir, grabar o transcribir llamadas si está prohibido.

Requisitos previos

Necesita tener una cuenta de AWS y una Gestión de identidades y accesos de AWS (IAM) rol y usuario con permisos para crear y administrar los recursos y componentes necesarios para esta aplicación. Si no tiene una cuenta de AWS, consulte ¿Cómo creo y activo una nueva cuenta de Amazon Web Services?

También necesita una base de conocimientos existente en Amazon Bedrock. Si aún no ha configurado uno, consulte Crea una base de conocimiento. Complete su base de conocimientos con contenido para potenciar el asistente de reuniones contextual de LMA.

Finalmente, LMA utiliza Amazon Bedrock LLM para sus funciones de resumen de reuniones. Antes de proceder, si no lo has hecho previamente, deberás solicitar acceso a los siguientes modelos de Amazon Bedrock:

- Titan Embeddings G1 – Texto

- Antrópico: Todos los modelos Claude

Implemente la solución con AWS CloudFormation

Hemos proporcionado prediseñados Formación en la nube de AWS plantillas que implementan todo lo que necesita en su cuenta de AWS.

Si es desarrollador y desea crear, implementar o publicar la solución a partir del código, consulte la Léame del desarrollador.

Complete los siguientes pasos para iniciar la pila de CloudFormation:

- Inicie sesión en el Consola de administración de AWS.

- Elige Pila de lanzamiento para la región de AWS que desee para abrir la consola de AWS CloudFormation y crear una nueva pila.

| Provincia | Pila de lanzamiento |

|---|---|

| Este de los Estados Unidos (Virginia del Norte) | |

| Oeste de EE. UU. (Oregón) |

- Nombre de pila, utilice el valor predeterminado, LMA.

- Dirección de correo electrónico del administrador, utilice una dirección de correo electrónico válida: su contraseña temporal se envía por correo electrónico a esta dirección durante la implementación.

- Dominio de correo electrónico de la cuenta autorizada, utilice la parte del nombre de dominio de su dirección de correo electrónico corporativa para permitir que los usuarios con direcciones de correo electrónico en el mismo dominio creen sus propias cuentas de UI nuevas, o déjela en blanco para evitar que los usuarios creen directamente sus propias cuentas. Puede ingresar varios dominios como una lista separada por comas.

- Servicio de asistencia a reuniones, escoger

BEDROCK_KNOWLEDGE_BASE(la única opción disponible al momento de escribir este artículo). - ID de la base de conocimientos de Bedrock de asistencia para reuniones (existente), introduzca el ID de su base de conocimientos existente (por ejemplo,

JSXXXXX3D8). Puedes copiarlo desde la consola de Amazon Bedrock.

- Para todos los demás parámetros, utilice los valores predeterminados.

Si desea personalizar la configuración más adelante, por ejemplo, para agregar la suya propia AWS Lambda funciones, utilizar vocabularios personalizados y modelos de lenguaje para mejorar la precisión, habilitar la redacción de información de identificación personal (PII) y más, puede actualizar la pila para estos parámetros.

- Seleccione las casillas de verificación de reconocimiento y luego elija Crear pila.

La pila principal de CloudFormation utiliza pilas anidadas para crear los siguientes recursos en su cuenta de AWS:

- Servicio de almacenamiento simple de Amazon (Amazon S3) depósitos para almacenar artefactos de compilación y grabaciones de llamadas

- An AWS Fargate tarea con un Balanceador de carga de aplicaciones proporcionar un servidor WebSocket que ejecute código para consumir transmisiones de audio estéreo y transmitirlas a Amazon Transcribe, publicar segmentos de transcripción en Secuencias de datos de Amazon Kinesisy crear y almacenar grabaciones de llamadas estéreo

- Un flujo de datos de Kinesis para transmitir eventos de llamadas y segmentos de transcripción a la función de procesamiento de enriquecimiento

- Recursos de la LMA, incluido el Solución QnABot en AWS pila, que interactúa con Servicio Amazon OpenSearch y lecho de roca amazónica

- El Sincronización de aplicaciones de AWS API, que proporciona un punto final de GraphQL para admitir consultas y actualizaciones en tiempo real

- Componentes del sitio web, incluido un depósito S3, Amazon CloudFront distribución, y Cognito Amazonas grupo de usuarios

- Una aplicación de extensión de navegador preconfigurada descargable para navegadores Chrome

- Otros recursos de apoyo, incluidas las funciones y políticas de IAM (utilizando las mejores prácticas de privilegios mínimos), Nube privada virtual de Amazon (Amazon VPC) recursos, Puente de eventos de Amazon reglas del evento y Reloj en la nube de Amazon grupos de registro.

Las pilas tardan entre 35 y 40 minutos en implementarse. El estado de la pila principal muestra CREAR_COMPLETO cuando todo esté desplegado.

Establece tu contraseña

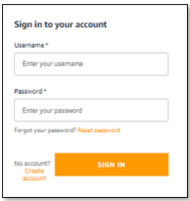

Después de implementar la pila, abra la interfaz de usuario web de LMA y establezca su contraseña completando los siguientes pasos:

- Abra el correo electrónico que recibió, en la dirección de correo electrónico que proporcionó, con el asunto "¡Bienvenido a Live Meeting Assistant!".

- Abra su navegador web en la URL que se muestra en el correo electrónico. Se le dirigirá a la página de inicio de sesión.

- El correo electrónico contiene una contraseña temporal generada que utiliza para iniciar sesión y crear su propia contraseña. Tu nombre de usuario es tu dirección de correo.

- Establecer una nueva contraseña.

Su nueva contraseña debe tener una longitud de al menos ocho caracteres y contener caracteres en mayúsculas y minúsculas, además de números y caracteres especiales.

- Siga las instrucciones para verificar su dirección de correo electrónico o elija omitir para hacerlo más tarde.

Ahora ha iniciado sesión en LMA.

También recibió un correo electrónico similar con el asunto "Código de verificación de registro de QnABot". Este correo electrónico contiene una contraseña temporal generada que utiliza para iniciar sesión y crear su propia contraseña en el diseñador QnABot. Utilice el diseñador QnABot solo si desea personalizar las opciones y mensajes de LMA. Su nombre de usuario para QnABot es Administrador. Puede configurar su contraseña permanente de administrador de QnABot ahora o mantener este correo electrónico seguro en caso de que desee personalizar las cosas más adelante.

Descargue e instale la extensión del navegador Chrome

Para obtener la mejor experiencia de transmisión de reuniones, instale el complemento del navegador LMA (actualmente disponible para Chrome):

- Elige Descargar la extensión de Chrome para descargar el archivo .zip de extensión del navegador (

lma-chrome-extension.zip).

- Elija (haga clic derecho) y expanda el archivo .zip (

lma-chrome-extension.zip) para crear una carpeta local llamadalma-chrome-extension. - Abre Chrome e ingresa el enlace

chrome://extensionsen la barra de direcciones.

- permitir modo desarrollador.

- Elige Carga desempaquetada, navega hacia el

lma-chrome-extensioncarpeta (que descomprimiste de la descarga) y elige Seleccione. Esto carga tu extensión. - Fije la nueva extensión LMA a la barra de herramientas del navegador para acceder fácilmente. ¡La usará con frecuencia para transmitir sus reuniones!

Comience a usar LMA

LMA ofrece dos opciones de transmisión:

- Extensión del navegador Chrome – Utilice esto para transmitir metadatos de audio y oradores desde la aplicación del navegador de reuniones. Actualmente funciona con Zoom y Chime, pero esperamos agregar más aplicaciones para reuniones.

- Pestaña Transmisión de audio LMA – Úselo para transmitir audio desde su micrófono y cualquier aplicación de reuniones, softphone o aplicación de audio basada en el navegador Chrome.

Le mostramos cómo utilizar ambas opciones en las siguientes secciones.

Utilice la extensión del navegador Chrome para transmitir una llamada de Zoom

Complete los siguientes pasos para utilizar la extensión del navegador:

- Abra la extensión LMA e inicie sesión con sus credenciales de LMA.

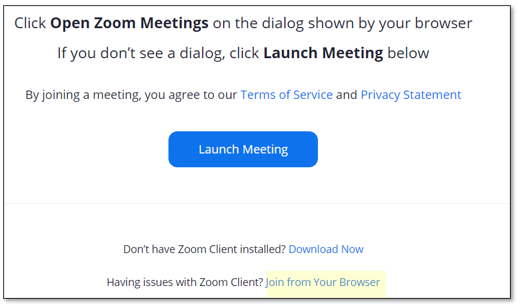

- Únase o inicie una reunión de Zoom en su navegador web (no utilice el cliente Zoom independiente).

Si ya tiene cargada la página de la reunión de Zoom, vuelva a cargarla.

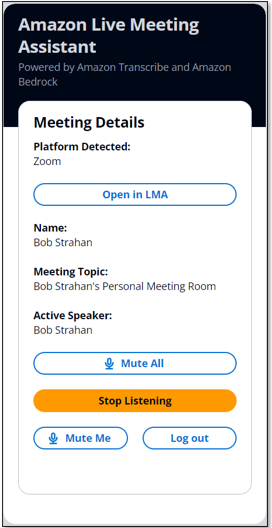

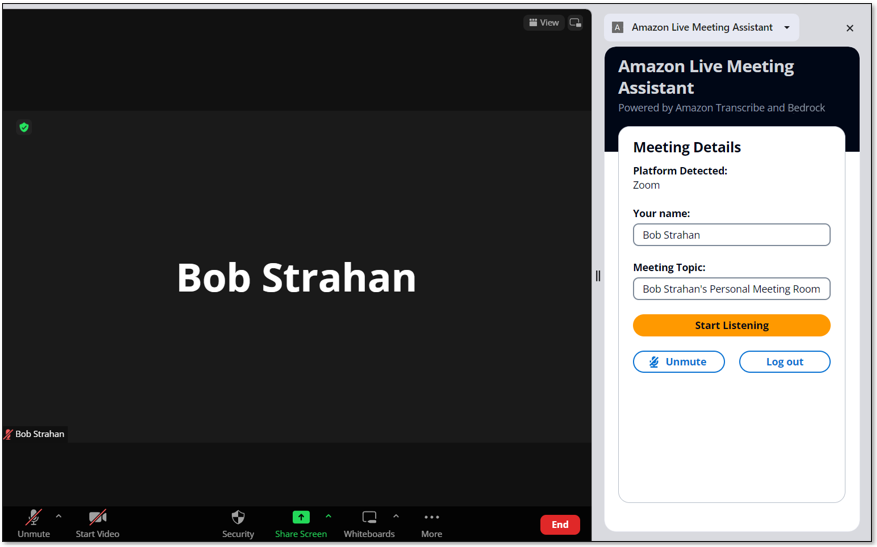

La extensión LMA detecta automáticamente que Zoom se está ejecutando en la pestaña del navegador y completa su nombre y el nombre de la reunión.

- Dígales a los demás participantes de la llamada que está a punto de comenzar a grabar la llamada usando LMA y obtenga su permiso. No continúe si los participantes se oponen.

- Elige Empieza a escuchar.

- Lea y acepte el descargo de responsabilidad y elija Permitir para compartir la pestaña del navegador.

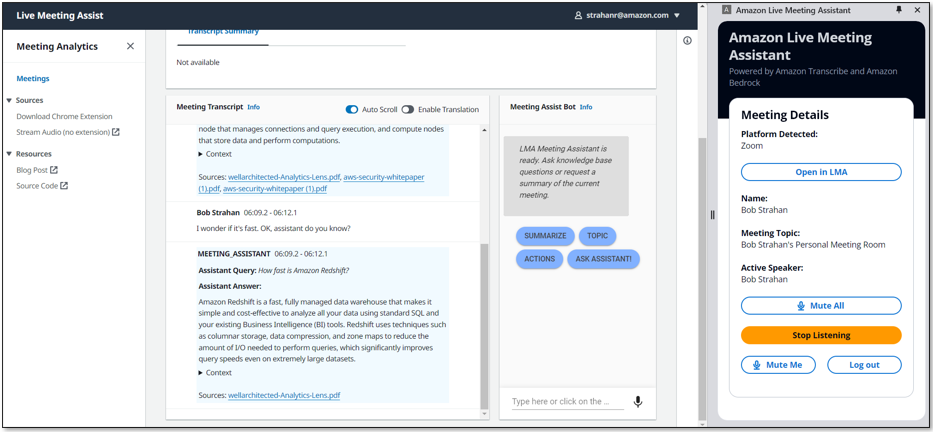

La extensión LMA detecta y muestra automáticamente el hablante activo en la llamada. Si está solo en la reunión, invite a algunos amigos a unirse y observe que los nombres que usaron para unirse a la llamada se muestran en la extensión cuando hablan y se atribuyen a sus palabras en la transcripción de LMA.

- Elige Abierto en LMA para ver su transcripción en vivo en una nueva pestaña.

- Elija su idioma de transcripción preferido e interactúe con el asistente de la reunión usando la frase de activación "¡OK Asistente!" o el Bot de asistencia para reuniones cristal.

El PREGUNTE AL ASISTENTE El botón solicita al servicio de asistente de reuniones (base de conocimientos de Amazon Bedrock) que sugiera una buena respuesta basada en la transcripción de las interacciones recientes en la reunión. Su kilometraje puede variar, ¡así que experimente!

- Cuando hayas terminado, elige Detener transmisión para finalizar la reunión en LMA.

En unos segundos, aparecen los resúmenes automatizados de fin de reunión y la grabación de audio estará disponible. Puede continuar usando el bot una vez finalizada la llamada.

Utilice la pestaña LMA UI Stream Audio para transmitir desde su micrófono y cualquier aplicación de audio basada en navegador

La extensión del navegador es la forma más conveniente de transmitir metadatos y audio desde aplicaciones web para reuniones compatibles. Sin embargo, también puede usar LMA para transmitir solo el audio desde cualquier softphone basado en navegador, aplicación para reuniones u otra fuente de audio que se reproduzca en su navegador Chrome, usando el conveniente Transmisión de audio pestaña que está integrada en la interfaz de usuario de LMA.

- Abra cualquier fuente de audio en una pestaña del navegador.

Por ejemplo, podría ser un softphone (como voz de Google), otra aplicación de reunión o, para fines de demostración, simplemente puede reproducir una grabación de audio local o un vídeo de YouTube en su navegador para emular a otro participante de la reunión. Si solo quieres probarlo, abre lo siguiente. Video de Youtube en una nueva pestaña.

- En la interfaz de usuario de la aplicación LMA, elija Transmitir audio (sin extensión) para abrir la pestaña Transmitir audio.

- ID de la reunión, ingrese una ID de reunión.

- Nombre, ingresa un nombre para ti (aplicado al audio de tu micrófono).

- Nombre del participante, ingrese los nombres de los participantes (aplicados a la fuente de audio entrante).

- Elige Comenzar a transmitir.

- Elija la pestaña del navegador que abrió anteriormente y elija Permitir compartir.

- Elija la pestaña UI de LMA nuevamente para ver su nueva ID de reunión en la lista, mostrando la reunión como En curso.

- Elija el ID de la reunión para abrir la página de detalles y mire la transcripción del audio entrante, atribuido a los nombres de los participantes que ingresó. Si hablas, verás la transcripción de tu propia voz.

Ingrese al Transmisión de audio función para transmitir desde cualquier aplicación de softphone, aplicación de reuniones o cualquier otra transmisión de audio que se reproduzca en el navegador, junto con su propio audio capturado desde el micrófono seleccionado. Obtenga siempre el permiso de otras personas antes de grabarlas utilizando LMA o cualquier otra aplicación de grabación.

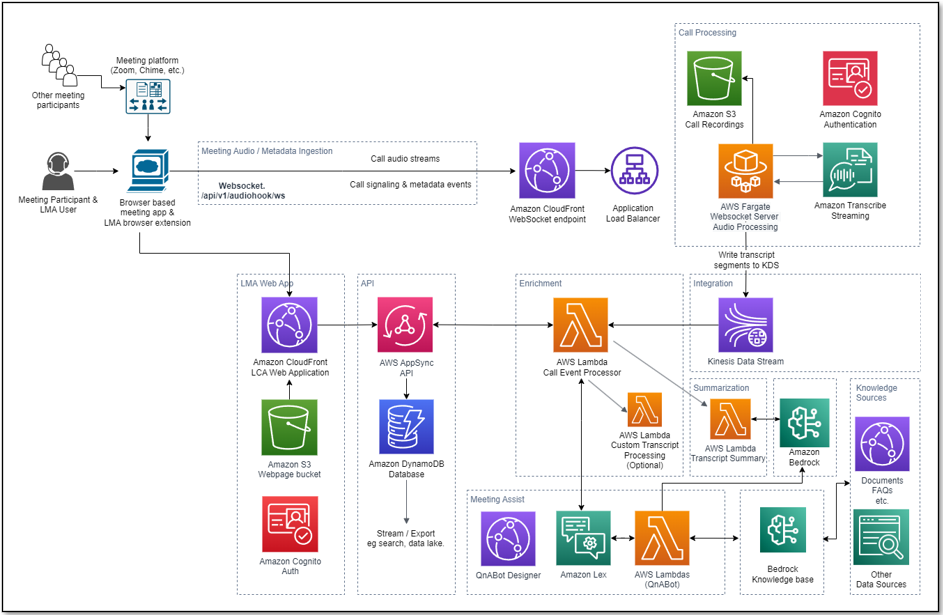

Descripción general del flujo de procesamiento

¿Cómo transcribió y analizó LMA su reunión? Veamos cómo funciona. El siguiente diagrama muestra los principales componentes arquitectónicos y cómo encajan entre sí a un alto nivel.

El usuario de LMA se une a una reunión en su navegador, habilita la extensión del navegador de LMA y se autentica utilizando sus credenciales de LMA. Si la aplicación de reuniones (por ejemplo, Zoom.us) es compatible con la extensión LMA, la extensión detecta automáticamente el nombre del usuario, el nombre de la reunión y los nombres de los oradores activos. Si la aplicación de la reunión no es compatible con la extensión, entonces el usuario de LMA puede ingresar manualmente su nombre y el tema de la reunión; no se detectarán los nombres de los oradores activos.

Después de obtener el permiso de otros participantes, el usuario de LMA elige Comenzar a escuchar en el panel de extensión de LMA. Se establece una conexión WebSocket segura con la URL de WebSocket de la pila LMA preconfigurada y se valida el token de autenticación del usuario. La extensión del navegador LMA envía un mensaje de INICIO al WebSocket que contiene los metadatos de la reunión (nombre, tema, etc.) y comienza a transmitir audio de dos canales desde el micrófono del usuario y el canal de audio entrante que contiene las voces de los demás participantes de la reunión. La extensión monitorea la aplicación de reuniones para detectar cambios de oradores activos durante la llamada y envía esos metadatos al WebSocket, lo que permite a LMA etiquetar segmentos de voz con el nombre del orador.

El servidor WebSocket que se ejecuta en Fargate consume los fragmentos de audio de dos canales en tiempo real de la transmisión WebSocket entrante. El audio se transmite a Amazon Transcribe y los resultados de la transcripción se escriben en tiempo real en Kinesis Data Streams.

Cada sesión de procesamiento de reuniones se ejecuta hasta que el usuario elige Dejar de escuchar en el panel de extensión de LMA o finaliza la reunión y cierra la pestaña. Al final de la llamada, la función crea un archivo de grabación estéreo en Amazon S3 (si la grabación estaba habilitada cuando se implementó la pila).

Una función Lambda llamada Procesador de eventos de llamada, alimentada por Kinesis Data Streams, procesa y, opcionalmente, enriquece los metadatos de reuniones y los segmentos de transcripción. El procesador de eventos de llamada se integra con los servicios de asistencia a reuniones. LMA funciona con Amazon lex, bases de conocimientos para Amazon Bedrock y LLM de Amazon Bedrock que utilizan el código abierto Solución QnABot en AWS para obtener respuestas basadas en preguntas frecuentes y como orquestador para el enrutamiento de solicitudes al servicio de inteligencia artificial adecuado. El procesador de eventos de llamada también invoca la función Lambda de resumen de transcripción cuando finaliza la llamada, para generar un resumen de la llamada a partir de la transcripción completa.

La función Call Event Processor interactúa con AWS AppSync para persistir los cambios (mutaciones) en Amazon DynamoDB y enviar actualizaciones en tiempo real a los clientes web conectados del usuario de LMA (que se abren convenientemente eligiendo la opción Abrir en LMA en la extensión del navegador).

Los activos de la interfaz de usuario web de LMA están alojados en Amazon S3 y se ofrecen a través de CloudFront. La autenticación la proporciona Amazon Cognito.

Cuando el usuario se autentica, la aplicación web establece una conexión GraphQL segura con la API de AWS AppSync y se suscribe para recibir eventos en tiempo real, como nuevas llamadas y cambios de estado de llamadas para la página de lista de reuniones, y segmentos de transcripción nuevos o actualizados y calculados. análisis para la página de detalles de la reunión. Cuando la traducción está habilitada, la aplicación web también interactúa de forma segura con Amazon Translate para traducir la transcripción de la reunión al idioma seleccionado.

Todo el flujo de procesamiento, desde la voz ingerida hasta las actualizaciones de páginas web en vivo, está impulsado por eventos y la latencia de un extremo a otro es corta, generalmente de solo unos segundos.

Supervisión y solución de problemas

AWS CloudFormation informa errores de implementación y causas en la pila relevante Eventos pestaña. Ver Solución de problemas de CloudFormation para obtener ayuda con problemas de implementación comunes. Esté atento a las fallas de implementación causadas por errores de límite excedido; Las pilas de LMA crean recursos que están sujetos a cuotas de servicio de región y cuenta predeterminadas, como direcciones IP elásticas y puertas de enlace NAT. Al solucionar problemas de fallas de la pila de CloudFormation, navegue siempre hacia las pilas anidadas fallidas para encontrar la primera falla de recurso anidada reportada; esta es casi siempre la causa principal.

Amazon Transcribe tiene un límite predeterminado de 25 transmisiones de transcripción simultáneas, lo que limita LMA a 25 reuniones simultáneas en una cuenta o región de AWS determinada. Solicite un aumento en la cantidad de transmisiones HTTP/2 simultáneas para la transcripción de transmisiones si tiene muchos usuarios y necesita manejar una mayor cantidad de reuniones simultáneas en su cuenta.

LMA proporciona monitoreo y registros del tiempo de ejecución para cada componente mediante CloudWatch:

- Procesamiento de WebSocket y transcripción de tareas de Fargate - Sobre el Servicio de contenedor elástico de Amazon (Amazon ECS), navegue hasta la Clusters página y abra el LMA-

WEBSOCKETSTACK-xxxx-TranscribingClusterfunción. Elegir la tareas y abra la página de tareas. Elegir Troncos y Ver en CloudWatch para inspeccionar los registros de tareas del transcriptor de WebSocket. - Llamar a la función Lambda del procesador de eventos – En la consola Lambda, abra el

LMA-AISTACK-CallEventProcessorfunción. Elegir la Monitorear pestaña para ver las métricas de la función. Elegir Ver registros en CloudWatch para inspeccionar los registros de funciones. - API de sincronización de aplicaciones de AWS – En la consola de AWS AppSync, abra el

CallAnalytics-LMAAPI. Elegir Monitoreo en el panel de navegación para ver las métricas de la API. Elegir Ver registros en CloudWatch para inspeccionar los registros de la API de AWS AppSync.

Para QnABot en AWS para Meeting Assist, consulte la Asistente para reuniones README, y la Guía de implementación de la solución QnABot para obtener información adicional.

Evaluación de costos

LMA proporciona un servidor WebSocket que utiliza Fargate (2vCPU) y recursos de red VPC que cuestan alrededor de $0.10 por hora (aproximadamente $72 por mes). Para más detalles, ver Precios de AWS Fargate.

LMA se habilita mediante QnABot y Knowledge Bases para Amazon Bedrock. Usted crea su propia base de conocimientos, que utiliza para LMA y potencialmente para otros casos de uso. Para más detalles, ver Precios de Amazon Bedrock. Los servicios adicionales de AWS utilizados por la solución QnABot cuestan alrededor de 0.77 dólares por hora. Para obtener más detalles, consulte la lista de Costos de la solución QnABot en AWS.

Los costos restantes de la solución se basan en el uso.

Los costos de uso suman aproximadamente $0.17 por una llamada de 5 minutos, aunque esto puede variar según las opciones seleccionadas (como traducción), la cantidad de resúmenes de LLM y el uso total porque el uso afecta la elegibilidad para la capa gratuita y los precios escalonados por volumen para muchos servicios. . Para obtener más información sobre los servicios que generan costos de uso, consulte lo siguiente:

Para explorar los costos de LMA usted mismo, utilice Explorador de costos de AWS o elegir Detalles de la factura en el Panel de facturación de AWS para ver su gasto mensual por servicio.

Personaliza tu implementación

Utilice los siguientes parámetros de plantilla de CloudFormation cuando cree o actualice su pila para personalizar su implementación de LCA:

- Para usar su propio depósito S3 para grabaciones de reuniones, use Nombre del depósito de grabaciones de audio de llamadas y Prefijo de archivo de audio.

- Para redactar PII de las transcripciones, configure Habilitar la redacción de contenido para transcripciones a verdadero y ajustar Tipos de entidades de redacción de PII de transcripción según sea necesario. Para más información, ver Redactar o identificar PII en un flujo en tiempo real.

- Para mejorar la precisión de la transcripción de la jerga y los acrónimos técnicos y específicos del dominio, configure Nombre de vocabulario personalizado de transcripción al nombre de un vocabulario personalizado que ya creó en Amazon Transcribe o configuró Nombre del modelo de idioma personalizado de transcripción al nombre de un modelo de lenguaje personalizado creado previamente. Para más información, ver Mejora de la precisión de la transcripción.

- Para transcribir reuniones en un idioma admitido que no sea inglés de EE. UU., elija el valor deseado para Idioma para la transcripción.

- Para personalizar el procesamiento de transcripciones, configure opcionalmente ARN de la función Lambda Hook para el procesamiento de segmentos de transcripción personalizados al ARN de su propia función Lambda. Para más información, ver Uso de una función Lambda para proporcionar opcionalmente lógica personalizada para el procesamiento de transcripciones.

- Para personalizar las capacidades de asistencia a reuniones basadas en la solución QnABot en AWS, Amazon Lex, Amazon Bedrock y Knowledge Bases para la integración de Amazon Bedrock, consulte la Asistente para reuniones README.

- Para personalizar el resumen de la transcripción configurando LMA para llamar a su propia función Lambda, consulte Opción LAMBDA de resumen de transcripción.

- Para personalizar el resumen de la transcripción modificando las indicaciones predeterminadas o agregando otras nuevas, consulte Resumen de transcripciones.

- Para cambiar el período de retención, establezca Caducidad récord en días al valor deseado. Todos los datos de las llamadas se eliminan permanentemente del almacenamiento de LMA DynamoDB después de este período. Los cambios a esta configuración se aplican solo a las nuevas llamadas recibidas después de la actualización.

LMA es un proyecto de código abierto. ¡Puede bifurcar el repositorio LMA GitHub, mejorar el código y enviarnos solicitudes de extracción para que podamos incorporar y compartir sus mejoras!

Actualizar una pila LMA existente

Puede actualizar su pila LMA existente a la última versión. Para más detalles, ver Actualizar una pila existente.

Limpiar

¡Felicidades! Ha completado todos los pasos para configurar su solución de muestra de análisis de llamadas en vivo utilizando los servicios de AWS.

Cuando haya terminado de experimentar con esta solución de muestra, limpie sus recursos utilizando la consola de AWS CloudFormation para eliminar las pilas de LMA que implementó. Esto elimina los recursos que se crearon al implementar la solución. Los depósitos de grabación de S3, la tabla de DynamoDB y los grupos de registros de CloudWatch se conservan después de eliminar la pila para evitar la eliminación de sus datos.

Live Call Analytics: solución complementaria

Nuestra solución complementaria, Análisis de llamadas en vivo y asistencia de agentes (LCA), ofrece transcripción y análisis en tiempo real para centros de contacto (llamadas telefónicas) en lugar de reuniones. Hay muchas similitudes; de hecho, LMA se construyó utilizando una arquitectura y muchos componentes derivados de LCA.

Conclusión

La solución de muestra Live Meeting Assistant ofrece un enfoque flexible, rico en funciones y personalizable para brindar asistencia en reuniones en vivo para mejorar su productividad durante y después de las reuniones. Utiliza servicios de Amazon AI/ML como Amazon Transcribe, Amazon Lex, Knowledge Bases for Amazon Bedrock y Amazon Bedrock LLM para transcribir y extraer información en tiempo real del audio de su reunión.

La aplicación LMA de muestra se proporciona como código abierto; úsela como punto de partida para su propia solución y ayúdenos a mejorarla aportando correcciones y funciones a través de solicitudes de extracción de GitHub. Navega hasta el Repositorio LMA GitHub para explorar el código, elija Ver ahora para recibir notificaciones sobre nuevos lanzamientos y consultar el README para obtener las últimas actualizaciones de la documentación.

Para obtener ayuda de expertos, Servicios profesionales de AWS así como de otros Socios de AWS Están aquí para ayudar.

Nos encantaría saber de usted. Háganos saber lo que piensa en la sección de comentarios, o use el foro de problemas en el Repositorio LMA GitHub.

Sobre los autores

Bob Strahan es arquitecto principal de soluciones en el equipo de AWS Language AI Services.

Bob Strahan es arquitecto principal de soluciones en el equipo de AWS Language AI Services.

chris lott es arquitecto principal de soluciones en el equipo de servicios lingüísticos de IA de AWS. Tiene 20 años de experiencia en desarrollo de software empresarial. Chris vive en Sacramento, California y disfruta de la jardinería, el sector aeroespacial y viajar por el mundo.

chris lott es arquitecto principal de soluciones en el equipo de servicios lingüísticos de IA de AWS. Tiene 20 años de experiencia en desarrollo de software empresarial. Chris vive en Sacramento, California y disfruta de la jardinería, el sector aeroespacial y viajar por el mundo.

Babu Srinivasan es un Sr. Specialist SA - Language AI services en la organización World Wide Specialist en AWS, con más de 24 años de experiencia en TI y los últimos 6 años enfocados en la nube de AWS. Es un apasionado de AI/ML. Fuera del trabajo, disfruta de la carpintería y entretiene a amigos y familiares (a veces extraños) con la magia de las cartas.

Babu Srinivasan es un Sr. Specialist SA - Language AI services en la organización World Wide Specialist en AWS, con más de 24 años de experiencia en TI y los últimos 6 años enfocados en la nube de AWS. Es un apasionado de AI/ML. Fuera del trabajo, disfruta de la carpintería y entretiene a amigos y familiares (a veces extraños) con la magia de las cartas.

Kishore Dhamodarán es arquitecto sénior de soluciones en AWS.

Kishore Dhamodarán es arquitecto sénior de soluciones en AWS.

Gillian Armstrong es un arquitecto de soluciones de construcción. Está entusiasmada con la forma en que la nube está abriendo oportunidades para que más personas utilicen la tecnología para resolver problemas, y está especialmente entusiasmada con la forma en que las tecnologías cognitivas, como la IA conversacional, nos permiten interactuar con las computadoras de formas más humanas.

Gillian Armstrong es un arquitecto de soluciones de construcción. Está entusiasmada con la forma en que la nube está abriendo oportunidades para que más personas utilicen la tecnología para resolver problemas, y está especialmente entusiasmada con la forma en que las tecnologías cognitivas, como la IA conversacional, nos permiten interactuar con las computadoras de formas más humanas.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/live-meeting-assistant-with-amazon-transcribe-amazon-bedrock-and-knowledge-bases-for-amazon-bedrock/