Εισαγωγή

Τα τελευταία χρόνια, ο τομέας της τεχνητής νοημοσύνης (AI) έχει γνωρίσει μια αξιοσημείωτη αύξηση στην ανάπτυξη μοντέλων τεχνητής νοημοσύνης. Αυτά τα μοντέλα μπορούν δημιουργούν κείμενο που μοιάζει με άνθρωπο, εικόνες, ακόμη και ήχος, που ξεπερνούν τα όρια αυτού που κάποτε θεωρούνταν αδύνατο. Μεταξύ αυτών των μοντέλων, ο Generative Pre-trained Transformer (GPT) ξεχωρίζει ως μια πρωτοποριακή ανακάλυψη στην επεξεργασία φυσικής γλώσσας (NLP). Ας εξερευνήσουμε την περίπλοκη αρχιτεκτονική των GPT και ας μάθουμε πώς χειρίζονται με ευκολία τις παραγωγικές εργασίες AI και NLP.

Πίνακας περιεχομένων

The Rise of Generative AI Models

Τα Generative AI μοντέλα είναι μια κατηγορία μάθηση μηχανής μοντέλα που μπορούν να δημιουργήσουν νέα δεδομένα, όπως κείμενο, εικόνες ή ήχο, από την αρχή. Αυτά τα μοντέλα εκπαιδεύονται σε τεράστιες ποσότητες υπαρχόντων δεδομένων, επιτρέποντάς τους να μάθουν τα υποκείμενα μοτίβα και δομές. Μόλις εκπαιδευτούν, μπορούν να δημιουργήσουν νέο, πρωτότυπο περιεχόμενο που μιμείται τα χαρακτηριστικά των δεδομένων εκπαίδευσης.

Η άνοδος των παραγωγικών μοντέλων τεχνητής νοημοσύνης έχει τροφοδοτηθεί από τις εξελίξεις στις τεχνικές βαθιάς μάθησης, ιδιαίτερα στα νευρωνικά δίκτυα. Βαθιά μάθηση Οι αλγόριθμοι έχουν αποδειχθεί εξαιρετικά αποτελεσματικοί στην καταγραφή σύνθετων μοτίβων σε δεδομένα, καθιστώντας τα κατάλληλα για παραγωγικές εργασίες. Καθώς η υπολογιστική ισχύς και η πρόσβαση σε μεγάλα σύνολα δεδομένων έχουν αυξηθεί, οι ερευνητές μπόρεσαν να εκπαιδεύσουν όλο και πιο εξελιγμένα μοντέλα παραγωγής.

Τα μυστήρια του GPT

Τα μοντέλα GPT είναι ένας τύπος μοντέλου μεγάλων γλωσσών (LLM) που αξιοποιεί τη δύναμη του νευρωνικά δίκτυα να κατανοήσουν και να δημιουργήσουν κείμενο που μοιάζει με άνθρωπο. Αυτά τα μοντέλα είναι «δημιουργικά» επειδή μπορούν να παράγουν νέο, συνεκτικό κείμενο με βάση τα μοτίβα που μαθαίνονται από τεράστια σύνολα δεδομένων. Είναι «προεκπαιδευμένοι» επειδή υποβάλλονται σε μια αρχική φάση εκπαίδευσης σε τεράστιες ποσότητες δεδομένων κειμένου. Αυτό τους επιτρέπει να αποκτήσουν μια ευρεία βάση γνώσεων πριν τελειοποιηθούν για συγκεκριμένες εργασίες.

Η αρχιτεκτονική «μετασχηματιστή» είναι η βασική καινοτομία που έχει ωθήσει τα μοντέλα GPT σε πρωτοφανή επίπεδα απόδοσης. transformers είναι ένας τύπος νευρωνικού δικτύου που έχει σχεδιαστεί για να χειρίζεται διαδοχικά δεδομένα, όπως κείμενο, πιο αποτελεσματικά από τα παραδοσιακά μοντέλα. Χρησιμοποιούν έναν νέο μηχανισμό προσοχής που επιτρέπει στο μοντέλο να σταθμίζει τη σημασία διαφορετικών τμημάτων της εισόδου κατά την παραγωγή εξόδου. Αυτό του δίνει τη δυνατότητα να καταγράφει εξαρτήσεις μεγάλης εμβέλειας και να παράγει πιο συνεκτικό και σχετικό με τα συμφραζόμενα κείμενο.

Ανατομή της αρχιτεκτονικής GPT

Η αρχιτεκτονική GPT είναι ένας ισχυρός συνδυασμός τριών βασικών στοιχείων: των δυνατοτήτων παραγωγής, της προσέγγισης προεκπαίδευσης και του νευρωνικού δικτύου μετασχηματιστή. Καθένας από αυτούς τους πυλώνες παίζει καθοριστικό ρόλο στο να επιτρέψει στα μοντέλα GPT να επιτύχουν την αξιοσημείωτη απόδοσή τους σε εργασίες NLP.

The Three Pillars: Generative, Pre-trained, and Transformer

Η «δημιουργική» πτυχή των μοντέλων GPT αναφέρεται στην ικανότητά τους να δημιουργούν νέο, συνεκτικό κείμενο με βάση τα μοτίβα που έχουν μάθει από τεράστιες ποσότητες δεδομένων εκπαίδευσης. Τα παραδοσιακά γλωσσικά μοντέλα επικεντρώνονται κυρίως στην κατανόηση και την ανάλυση κειμένου. Σε αντίθεση με αυτά, τα μοντέλα GPT έχουν σχεδιαστεί για να παράγουν εξόδους κειμένου που μοιάζει με άνθρωπο, καθιστώντας τα εξαιρετικά ευέλικτα για μια ποικιλία εφαρμογών.

Το "προεκπαιδευμένο" στοιχείο των μοντέλων GPT περιλαμβάνει μια αρχική φάση εκπαίδευσης όπου το μοντέλο εκτίθεται σε ένα τεράστιο σύνολο δεδομένων κειμένου. Κατά τη διάρκεια αυτού του προεκπαιδευτικού σταδίου, το μοντέλο μαθαίνει να συλλαμβάνει τα υποκείμενα μοτίβα, δομές και σχέσεις μέσα στα δεδομένα. Αυτό το βοηθά να δημιουργήσει αποτελεσματικά μια ευρεία βάση γνώσεων. Η φάση της προεκπαίδευσης είναι κρίσιμη, καθώς επιτρέπει στο μοντέλο να αποκτήσει μια γενική κατανόηση της γλώσσας πριν τελειοποιηθεί.

Η αρχιτεκτονική «μετασχηματιστή» είναι η ραχοκοκαλιά του νευρωνικού δικτύου των μοντέλων GPT. Οι μετασχηματιστές είναι μοντέλα βαθιάς εκμάθησης που έχουν σχεδιαστεί ειδικά για να χειρίζονται διαδοχικά δεδομένα, όπως κείμενο, πιο αποτελεσματικά από τα παραδοσιακά μοντέλα. Χρησιμοποιούν έναν νέο μηχανισμό προσοχής που επιτρέπει στο μοντέλο να σταθμίζει τη σημασία διαφορετικών τμημάτων της εισόδου κατά την παραγωγή εξόδου. Αυτό του δίνει τη δυνατότητα να καταγράφει εξαρτήσεις μεγάλης εμβέλειας και να παράγει πιο συνεκτικό και σχετικό με τα συμφραζόμενα κείμενο.

Πώς τα GPT παράγουν συνεκτικές προτάσεις

Τα μοντέλα GPT δημιουργούν κείμενο προβλέποντας την επόμενη λέξη ή διακριτικό σε μια ακολουθία με βάση το πλαίσιο που παρέχεται από τις προηγούμενες λέξεις ή διακριτικά. Αυτή η διαδικασία επιτυγχάνεται μέσω μιας σειράς υπολογισμών εντός της αρχιτεκτονικής του μετασχηματιστή. Ξεκινά με το tokenizing του κειμένου εισόδου και τη μετατροπή του σε αριθμητικές αναπαραστάσεις (ενσωματώσεις). Αυτές οι ενσωματώσεις στη συνέχεια περνούν μέσα από πολλαπλά στρώματα του μετασχηματιστή. Εδώ, ο μηχανισμός προσοχής επιτρέπει στο μοντέλο να συλλάβει τις σχέσεις μεταξύ διαφορετικών τμημάτων της εισόδου και να παράγει εξόδους σχετικούς με τα συμφραζόμενα.

Η έξοδος του μοντέλου είναι α κατανομή πιθανότητας σε ολόκληρο το λεξιλόγιο, υποδεικνύοντας την πιθανότητα κάθε λέξης ή διακριτικού να είναι η επόμενη στη σειρά. Κατά την εξαγωγή συμπερασμάτων, το μοντέλο λαμβάνει δείγματα από αυτήν την κατανομή για να δημιουργήσει το επόμενο διακριτικό, το οποίο προσαρτάται στην ακολουθία εισόδου. Αυτή η διαδικασία επαναλαμβάνεται μέχρι να επιτευχθεί το επιθυμητό μήκος εξόδου ή να εκπληρωθεί μια συνθήκη διακοπής.

Αξιοποίηση μαζικών συνόλων δεδομένων για καλύτερη απόδοση

Ένα από τα βασικά πλεονεκτήματα των μοντέλων GPT είναι η ικανότητά τους να αξιοποιούν μαζικά σύνολα δεδομένων κατά τη φάση της προεκπαίδευσης. Αυτά τα σύνολα δεδομένων μπορεί να αποτελούνται από δισεκατομμύρια λέξεις από διάφορες πηγές, όπως βιβλία, άρθρα, ιστότοπους και μέσα κοινωνικής δικτύωσης. Αυτό παρέχει στο μοντέλο μια ποικιλόμορφη και ολοκληρωμένη έκθεση στη φυσική γλώσσα.

Κατά τη διάρκεια της προεκπαίδευσης, το μοντέλο πρέπει να προβλέψει την επόμενη λέξη ή διακριτικό στη σειρά, παρόμοια με τη διαδικασία δημιουργίας κειμένου. Ωστόσο, αντί να δημιουργεί νέο κείμενο, το μοντέλο μαθαίνει να αποτυπώνει τα υποκείμενα μοτίβα και τις σχέσεις μέσα στα δεδομένα εκπαίδευσης. Αυτή η προεκπαιδευτική φάση είναι υπολογιστικά εντατική αλλά κρίσιμη. Επιτρέπει στο μοντέλο να αναπτύξει μια ευρεία κατανόηση της γλώσσας, η οποία στη συνέχεια μπορεί να προσαρμοστεί με ακρίβεια για συγκεκριμένες εργασίες.

Αξιοποιώντας τεράστια σύνολα δεδομένων κατά τη διάρκεια της προεκπαίδευσης, τα μοντέλα GPT μπορούν να αποκτήσουν μια τεράστια βάση γνώσεων. Μπορούν επίσης να αναπτύξουν μια βαθιά κατανόηση των γλωσσικών δομών, των ιδιωματικών εκφράσεων και των συμφραζόμενων αποχρώσεων. Αυτή η εκτεταμένη προ-εκπαίδευση παρέχει μια ισχυρή βάση για το μοντέλο. Επιτρέπει στο μοντέλο να έχει καλή απόδοση σε ένα ευρύ φάσμα εργασιών κατάντη με σχετικά μικρή λεπτομέρεια για συγκεκριμένες εργασίες.

Το νευρωνικό δίκτυο πίσω από τη μαγεία

Η αρχιτεκτονική του μετασχηματιστή είναι η βασική καινοτομία που τροφοδοτεί τα μοντέλα GPT και έχει φέρει επανάσταση στον τομέα του NLP. Σε αντίθεση με τα παραδοσιακά επαναλαμβανόμενα νευρωνικά δίκτυα (RNN), οι οποίοι επεξεργάζονται διαδοχικά διαδοχικά δεδομένα, οι μετασχηματιστές χρησιμοποιούν έναν νέο μηχανισμό προσοχής που τους επιτρέπει να συλλαμβάνουν εξαρτήσεις μεγάλης εμβέλειας και να επεξεργάζονται αποτελεσματικά τις ακολουθίες εισόδου παράλληλα.

Η αρχιτεκτονική του μετασχηματιστή αποτελείται από πολλαπλά στρώματα, το καθένα από τα οποία περιλαμβάνει δύο κύρια στοιχεία: τον μηχανισμό προσοχής πολλαπλών κεφαλών και το νευρωνικό δίκτυο τροφοδοσίας προς τα εμπρός. Ο μηχανισμός προσοχής είναι υπεύθυνος για τη στάθμιση της σημασίας διαφορετικών τμημάτων της ακολουθίας εισόδου κατά τη δημιουργία εξόδου, επιτρέποντας στο μοντέλο να συλλαμβάνει το πλαίσιο και τις σχέσεις μεταξύ απομακρυσμένων στοιχείων στην ακολουθία.

Τα στρώματα νευρωνικού δικτύου τροφοδοσίας είναι υπεύθυνα για την περαιτέρω επεξεργασία και τη βελτίωση της εξόδου του μηχανισμού προσοχής, επιτρέποντας στο μοντέλο να μάθει πιο σύνθετες αναπαραστάσεις των δεδομένων εισόδου.

Ο παραλληλισμένος μηχανισμός επεξεργασίας και προσοχής της αρχιτεκτονικής του μετασχηματιστή έχει αποδειχθεί εξαιρετικά αποτελεσματικός στον χειρισμό μεγάλων ακολουθιών και στην καταγραφή εξαρτήσεων μεγάλης εμβέλειας, οι οποίες είναι ζωτικής σημασίας για εργασίες NLP. Αυτή η αρχιτεκτονική έχει επιτρέψει στα μοντέλα GPT να επιτυγχάνουν κορυφαίες επιδόσεις. Έχει επίσης επηρεάσει την ανάπτυξη άλλων μοντέλων που βασίζονται σε μετασχηματιστές σε διάφορους τομείς, όπως η όραση υπολογιστή και η αναγνώριση ομιλίας.

Μέσα στο Transformer

Η αρχιτεκτονική του μετασχηματιστή είναι το βασικό στοιχείο που επιτρέπει στα μοντέλα GPT να επιτύχουν την αξιοσημείωτη απόδοσή τους σε εργασίες NLP. Ας ρίξουμε μια πιο προσεκτική ματιά στα βασικά βήματα που εμπλέκονται στην επεξεργασία δεδομένων κειμένου από τον μετασχηματιστή.

Tokenization: Ανάλυση κειμένου σε εύπεπτα κομμάτια

Για να μπορέσει ο μετασχηματιστής να επεξεργαστεί κείμενο, τα δεδομένα εισόδου πρέπει να αναλυθούν σε μικρότερες μονάδες που ονομάζονται tokens. Τεκμηρίωση είναι η διαδικασία διαχωρισμού του κειμένου σε αυτά τα διακριτικά, τα οποία μπορεί να είναι λέξεις, υπολέξεις ή ακόμη και μεμονωμένοι χαρακτήρες. Αυτό το βήμα είναι κρίσιμο γιατί επιτρέπει στον μετασχηματιστή να χειρίζεται ακολουθίες διαφορετικού μήκους και να αναπαριστά αποτελεσματικά σπάνιες ή εκτός λεξιλογίου λέξεις. Η διαδικασία του tokenization συνήθως περιλαμβάνει τεχνικές όπως η κατάτμηση λέξεων, ο χειρισμός των σημείων στίξης και η αντιμετώπιση ειδικών χαρακτήρων.

Ενσωματώσεις λέξεων: Αντιστοίχιση λέξεων σε αριθμητικά διανύσματα

Μόλις το κείμενο γίνει διακριτικό, κάθε διακριτικό αντιστοιχίζεται σε μια αριθμητική διανυσματική αναπαράσταση που ονομάζεται ενσωμάτωση λέξης. Αυτές οι ενσωματώσεις λέξεων είναι πυκνά διανύσματα που συλλαμβάνουν σημασιολογικές και συντακτικές πληροφορίες σχετικά με τις λέξεις που αντιπροσωπεύουν. Ο μετασχηματιστής χρησιμοποιεί αυτές τις ενσωματώσεις ως είσοδο, επιτρέποντάς του να επεξεργάζεται δεδομένα κειμένου σε αριθμητική μορφή που μπορεί να χειριστεί αποτελεσματικά από την αρχιτεκτονική του νευρωνικού δικτύου. Οι ενσωματώσεις λέξεων μαθαίνονται κατά τη διάρκεια της εκπαιδευτικής διαδικασίας, όπου οι λέξεις με παρόμοια σημασία τείνουν να έχουν παρόμοιες διανυσματικές αναπαραστάσεις, επιτρέποντας στο μοντέλο να συλλαμβάνει σημασιολογικές σχέσεις και πλαίσιο.

Ο Μηχανισμός Προσοχής: Η Καρδιά του Μετασχηματιστή

Ο μηχανισμός προσοχής είναι η βασική καινοτομία που ξεχωρίζει τους μετασχηματιστές από τις παραδοσιακές αρχιτεκτονικές νευρωνικών δικτύων. Επιτρέπει στο μοντέλο να εστιάζει επιλεκτικά σε σχετικά μέρη της ακολουθίας εισόδου κατά τη δημιουργία εξόδου, αποτυπώνοντας αποτελεσματικά εξαρτήσεις και περιβάλλον μεγάλης εμβέλειας. ο μηχανισμός προσοχής λειτουργεί με τον υπολογισμό των βαθμολογιών προσοχής που αντιπροσωπεύουν τη σημασία κάθε στοιχείου εισόδου για ένα δεδομένο στοιχείο εξόδου και στη συνέχεια χρησιμοποιώντας αυτές τις βαθμολογίες για να σταθμίσει τις αντίστοιχες αναπαραστάσεις εισόδου. Αυτός ο μηχανισμός επιτρέπει στον μετασχηματιστή να επεξεργάζεται αποτελεσματικά ακολουθίες διαφορετικού μήκους και να καταγράφει σχέσεις μεταξύ απομακρυσμένων στοιχείων στην είσοδο, κάτι που είναι κρίσιμο για εργασίες όπως η μηχανική μετάφραση και η παραγωγή γλώσσας.

Perceptrons πολλαπλών στρωμάτων: Ενίσχυση διανυσματικών αναπαραστάσεων

Εκτός από τον μηχανισμό προσοχής, ενσωματώνουν και μετασχηματιστές πολυστρωματικά perceptrons (MLPs), τα οποία είναι τροφοδοτικά νευρωνικά δίκτυα. Αυτά τα MLP χρησιμοποιούνται για την περαιτέρω επεξεργασία και τη βελτίωση των διανυσματικών αναπαραστάσεων που παράγονται από τον μηχανισμό προσοχής, επιτρέποντας στο μοντέλο να συλλαμβάνει πιο πολύπλοκα μοτίβα και σχέσεις στα δεδομένα. Τα MLP λαμβάνουν την έξοδο του μηχανισμού προσοχής ως είσοδο και εφαρμόζουν μια σειρά γραμμικών μετασχηματισμών και μη γραμμικών συναρτήσεων ενεργοποίησης για να βελτιώσουν τις διανυσματικές αναπαραστάσεις. Αυτό το βήμα είναι ζωτικής σημασίας για το μοντέλο να μάθει χαρακτηριστικά και αναπαραστάσεις υψηλότερου επιπέδου που είναι χρήσιμες για την κατάντη εργασία.

Εκπαίδευση μοντέλου GPT

Η εκπαίδευση ενός μοντέλου GPT είναι μια πολύπλοκη και υπολογιστικά εντατική διαδικασία που περιλαμβάνει πολλά βασικά στοιχεία και τεχνικές.

Backpropagation: Ο αλγόριθμος που κάνει τα GPT πιο έξυπνα

Στον πυρήνα των μοντέλων εκπαίδευσης GPT είναι ο αλγόριθμος backpropagation, ο οποίος είναι μια ευρέως χρησιμοποιούμενη τεχνική στη βαθιά εκμάθηση για την ενημέρωση των βαρών και των παραμέτρων του μοντέλου με βάση τα σφάλματα που κάνει κατά τη διάρκεια της εκπαίδευσης. Στη διάρκεια οπίσθιο πολλαπλασιασμό, οι προβλέψεις του μοντέλου συγκρίνονται με τις ετικέτες αληθείας εδάφους και τα σφάλματα διαδίδονται προς τα πίσω μέσω του δικτύου για την προσαρμογή των βαρών και την ελαχιστοποίηση του συνολικού σφάλματος. Αυτή η διαδικασία περιλαμβάνει τον υπολογισμό των κλίσεων της συνάρτησης απώλειας σε σχέση με τις παραμέτρους του μοντέλου και την ενημέρωση των παραμέτρων προς την κατεύθυνση που ελαχιστοποιεί την απώλεια. Η backpropagation είναι ένα ουσιαστικό συστατικό της εκπαιδευτικής διαδικασίας, καθώς επιτρέπει στο μοντέλο να μάθει από τα λάθη του και να βελτιώσει σταδιακά την απόδοσή του.

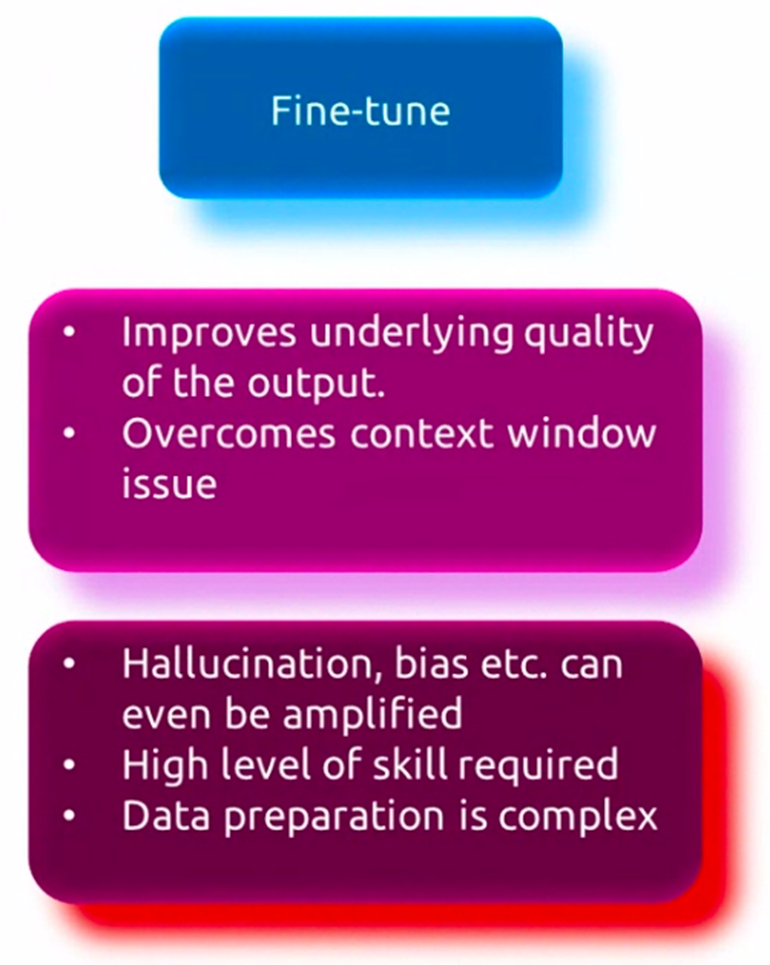

Εποπτευόμενος συντονισμός

Ενώ τα μοντέλα GPT είναι προεκπαιδευμένα σε ογκώδη σύνολα δεδομένων για να αποκτήσουν ευρεία κατανόηση της γλώσσας, συχνά χρειάζεται να ρυθμιστούν με ακρίβεια σε δεδομένα για συγκεκριμένες εργασίες για να έχουν καλή απόδοση σε συγκεκριμένες εφαρμογές. Αυτή η διαδικασία, γνωστή ως εποπτευόμενη λεπτομέρεια, περιλαμβάνει περαιτέρω εκπαίδευση του προεκπαιδευμένου μοντέλου σε ένα μικρότερο σύνολο δεδομένων που σχετίζεται με την εργασία-στόχο, όπως η απάντηση σε ερωτήσεις, η σύνοψη κειμένου ή η αυτόματη μετάφραση. Στη διάρκεια τελειοποίηση, τα βάρη του μοντέλου προσαρμόζονται για να αποτυπώνουν καλύτερα τα μοτίβα και τις αποχρώσεις που αφορούν την εκάστοτε εργασία, διατηρώντας παράλληλα τις γενικές γλωσσικές γνώσεις που αποκτήθηκαν κατά την προεκπαίδευση. Αυτή η διαδικασία λεπτομέρειας επιτρέπει στο μοντέλο να εξειδικεύεται και να προσαρμόζεται στις συγκεκριμένες απαιτήσεις της εργασίας στόχου, με αποτέλεσμα βελτιωμένη απόδοση.

Προ-προπόνηση χωρίς επίβλεψη

Πριν από τη λεπτομερή ρύθμιση, τα μοντέλα GPT υποβάλλονται σε μια αρχική φάση προεκπαίδευσης χωρίς επίβλεψη, όπου εκτίθενται σε τεράστιο όγκο δεδομένων κειμένου από διάφορες πηγές, όπως βιβλία, άρθρα και ιστότοπους. Κατά τη διάρκεια αυτής της φάσης, το μοντέλο μαθαίνει να αποτυπώνει τα υποκείμενα μοτίβα και τις σχέσεις στα δεδομένα προβλέποντας την επόμενη λέξη ή διακριτικό σε μια ακολουθία, μια διαδικασία γνωστή ως μοντελοποίηση γλώσσας. Αυτή η προεκπαίδευση χωρίς επίβλεψη επιτρέπει στο μοντέλο να αναπτύξει μια ευρεία κατανόηση της γλώσσας, συμπεριλαμβανομένης της σύνταξης, της σημασιολογίας και του πλαισίου. Το μοντέλο εκπαιδεύεται σε ένα τεράστιο σύνολο δεδομένων κειμένου, επιτρέποντάς του να μαθαίνει από μια ποικιλία θεμάτων, στυλ και τομέων. Αυτή η φάση προεκπαίδευσης χωρίς επίβλεψη είναι υπολογιστικά εντατική αλλά κρίσιμη, καθώς παρέχει στο μοντέλο μια ισχυρή βάση για μετέπειτα τελειοποίηση σε συγκεκριμένες εργασίες.

Εφαρμογές GPT και περιπτώσεις χρήσης

Τα μοντέλα GPT έχουν δείξει αξιοσημείωτη ευελιξία και έχουν εφαρμοστεί σε ένα ευρύ φάσμα εργασιών και εφαρμογών NLP. Ας εξερευνήσουμε μερικές από τις βασικές περιπτώσεις χρήσης αυτών των ισχυρών γλωσσικών μοντέλων.

Σπάζοντας τα γλωσσικά εμπόδια

Μία από τις πρώτες και πιο εμφανείς εφαρμογές των μοντέλων GPT είναι στον τομέα της αυτόματης μετάφρασης. Αξιοποιώντας την ικανότητά τους να κατανοούν και να δημιουργούν κείμενο που μοιάζει με άνθρωπο, τα μοντέλα GPT μπορούν να εκπαιδευτούν να μεταφράζουν μεταξύ διαφορετικών γλωσσών με υψηλή ακρίβεια και ευχέρεια. Αυτά τα μοντέλα μπορούν να συλλάβουν τις αποχρώσεις και την πολυπλοκότητα της γλώσσας, επιτρέποντάς τους να παράγουν μεταφράσεις που όχι μόνο είναι ακριβείς αλλά και διατηρούν το επιδιωκόμενο νόημα και το πλαίσιο του αρχικού κειμένου.

Σύνοψη κειμένου

Με τον ολοένα αυξανόμενο όγκο των διαθέσιμων δεδομένων κειμένου, η δυνατότητα να συνοψίζω μακροσκελή έγγραφα ή άρθρα σε συνοπτικές και ουσιαστικές περιλήψεις έχει γίνει όλο και πιο σημαντική. Τα μοντέλα GPT έχουν αποδειχθεί αποτελεσματικά σε αυτήν την εργασία, καθώς μπορούν να αναλύσουν και να κατανοήσουν το πλαίσιο και τα βασικά σημεία ενός δεδομένου κειμένου και στη συνέχεια να δημιουργήσουν μια συνοπτική περίληψη που αποτυπώνει την ουσία του αρχικού περιεχομένου. Αυτή η εφαρμογή έχει πολλές περιπτώσεις χρήσης, που κυμαίνονται από τη σύνοψη ειδήσεων και ερευνητικών άρθρων έως τη δημιουργία συνοπτικών αναφορών και εκτελεστικών περιλήψεων.

Chatbots και Conversational AI

Μία από τις πιο ορατές και ευρέως διαδεδομένες εφαρμογές των μοντέλων GPT είναι η ανάπτυξη chatbot και συνομιλία AI συστήματα. Αυτά τα μοντέλα μπορούν να συμμετάσχουν σε ανθρωποειδείς διαλόγους, να κατανοήσουν και να ανταποκριθούν σε ερωτήματα και εισροές χρηστών με φυσικό και κατάλληλο τρόπο. Τα chatbot που υποστηρίζονται από GPT χρησιμοποιούνται σε διάφορους κλάδους, όπως η εξυπηρέτηση πελατών, το ηλεκτρονικό εμπόριο και η υγειονομική περίθαλψη, για την παροχή εξατομικευμένης και αποτελεσματικής βοήθειας στους χρήστες.

Το φανταστικό δυναμικό των GPT

Ενώ τα μοντέλα GPT σχεδιάστηκαν αρχικά για εργασίες κατανόησης γλώσσας και δημιουργίας, η ικανότητά τους να παράγουν συνεκτικό και ευφάνταστο κείμενο έχει ανοίξει νέες δυνατότητες στη σφαίρα της δημιουργικής γραφής. Αυτά τα μοντέλα μπορούν να ρυθμιστούν με ακρίβεια για να δημιουργήσουν ιστορίες, ποιήματα, σενάρια, ακόμη και στίχους τραγουδιών, προσφέροντας ένα ισχυρό εργαλείο για τους συγγραφείς και τους καλλιτέχνες για να εξερευνήσουν νέους δημιουργικούς δρόμους. Επιπλέον, τα μοντέλα GPT μπορούν να βοηθήσουν στη διαδικασία γραφής προτείνοντας εξελίξεις πλοκής και περιγραφές χαρακτήρων, ακόμη και δημιουργώντας ολόκληρα αποσπάσματα με βάση προτροπές ή περιγράμματα.

Το μέλλον των GPT και του Generative AI

Όσο ελπιδοφόρα κι αν ήταν τα μοντέλα GPT, εξακολουθούν να υπάρχουν περιορισμοί και προκλήσεις που πρέπει να ξεπεραστούν, καθώς και ηθικά ζητήματα που πρέπει να αντιμετωπιστούν. Επιπλέον, ο τομέας της γενετικής τεχνητής νοημοσύνης εξελίσσεται ταχέως, με τις νέες τάσεις και την έρευνα αιχμής να διαμορφώνουν το μέλλον αυτών των μοντέλων.

Περιορισμοί και προκλήσεις των τρεχόντων μοντέλων GPT

Παρά τις εντυπωσιακές δυνατότητές τους, τα τρέχοντα μοντέλα GPT έχουν ορισμένους περιορισμούς. Μία από τις κύριες προκλήσεις είναι η αδυναμία τους να κατανοήσουν πραγματικά το υποκείμενο νόημα και το πλαίσιο του κειμένου που δημιουργούν. Παρόλο που μπορούν να παράγουν συνεκτικό και ρέον κείμενο, μπορεί μερικές φορές να παράγουν ανόητες ή ανακριβείς πληροφορίες, ειδικά όταν ασχολούνται με πολύπλοκα ή εξειδικευμένα θέματα. Επιπλέον, αυτά τα μοντέλα μπορούν να παρουσιάσουν προκαταλήψεις που υπάρχουν στα δεδομένα εκπαίδευσής τους, εγείροντας ανησυχίες σχετικά με τη δικαιοσύνη και τα δυνητικά επιβλαβή αποτελέσματα.

Ηθικές Θεωρήσεις και Υπεύθυνη Ανάπτυξη AI

Καθώς τα μοντέλα GPT γίνονται πιο ισχυρά και διαδεδομένα, είναι σημαντικό να ληφθούν υπόψη ηθικά ζητήματα και να διασφαλιστεί η υπεύθυνη ανάπτυξη και ανάπτυξη αυτών των τεχνολογιών. Ζητήματα όπως το απόρρητο, η ασφάλεια και η πιθανότητα κακής χρήσης ή κακόβουλων εφαρμογών πρέπει να εξετάζονται προσεκτικά. Οι ερευνητές και οι προγραμματιστές πρέπει να εργαστούν για την ανάπτυξη δεοντολογικών οδηγιών, πλαισίων διακυβέρνησης και ισχυρών διασφαλίσεων για τον μετριασμό των πιθανών κινδύνων και τη διασφάλιση της ασφαλούς και επωφελούς χρήσης των μοντέλων GPT.

Αναδυόμενες τάσεις και έρευνα αιχμής

Ο τομέας της γενετικής τεχνητής νοημοσύνης εξελίσσεται ταχέως, με τους ερευνητές να εξερευνούν νέες αρχιτεκτονικές, μεθόδους εκπαίδευσης και εφαρμογές. Μία από τις αναδυόμενες τάσεις είναι πολυτροπικά μοντέλα που μπορεί να επεξεργάζεται και να παράγει δεδομένα σε διαφορετικούς τρόπους (κείμενο, εικόνες, ήχος κ.λπ.). Οι προσεγγίσεις ενίσχυσης μάθησης για τη δημιουργία γλωσσών είναι μια άλλη. Η ενοποίηση μοντέλων GPT με άλλες τεχνολογίες AI, όπως π.χ όραση υπολογιστή και ρομποτική είναι μια ακόμη τάση. Επιπλέον, διεξάγεται έρευνα για τη βελτίωση της ερμηνευσιμότητας, της δυνατότητας ελέγχου και της ευρωστίας αυτών των μοντέλων. Οι ερευνητές διερευνούν επίσης τις δυνατότητές τους σε τομείς όπως η επιστημονική ανακάλυψη, η εκπαίδευση και η υγειονομική περίθαλψη.

Συμπέρασμα

Τα μοντέλα GPT έχουν φέρει επανάσταση στον τομέα του NLP. Έχουν επιδείξει αξιοσημείωτες ικανότητες σε εργασίες όπως η μετάφραση γλώσσας, η σύνοψη κειμένου, η τεχνητή νοημοσύνη συνομιλίας και η δημιουργική γραφή. Στον πυρήνα αυτών των μοντέλων βρίσκεται η αρχιτεκτονική του μετασχηματιστή. Αυτό χρησιμοποιεί έναν νέο μηχανισμό προσοχής για την αποτύπωση εξαρτήσεων και πλαισίου μεγάλης εμβέλειας στα δεδομένα κειμένου. Η εκπαίδευση μοντέλων GPT περιλαμβάνει μια πολύπλοκη διαδικασία προεκπαίδευσης χωρίς επίβλεψη σε τεράστια σύνολα δεδομένων, ακολουθούμενη από εποπτευόμενη λεπτομέρεια για συγκεκριμένες εργασίες.

Ενώ τα μοντέλα GPT έχουν επιτύχει εντυπωσιακά αποτελέσματα, εξακολουθούν να υπάρχουν περιορισμοί και προκλήσεις που πρέπει να ξεπεραστούν. Αυτό περιλαμβάνει την έλλειψη αληθινής κατανόησης, πιθανές προκαταλήψεις και ηθικές ανησυχίες. Επιπλέον, ο τομέας της γενετικής τεχνητής νοημοσύνης εξελίσσεται ταχέως, με τους ερευνητές να εξερευνούν νέες αρχιτεκτονικές, εφαρμογές και τεχνικές για να ωθήσουν τα όρια αυτών των μοντέλων.

Καθώς τα μοντέλα GPT συνεχίζουν να εξελίσσονται, είναι σημαντικό να ληφθούν υπόψη ηθικά ζητήματα και να αναπτυχθούν υπεύθυνες πρακτικές τεχνητής νοημοσύνης. Είναι επίσης σημαντικό να εξερευνήσετε τις αναδυόμενες τάσεις και την έρευνα αιχμής για να αξιοποιήσετε πλήρως τις δυνατότητες αυτών των ισχυρών μοντέλων. Εν τω μεταξύ, πρέπει να διασφαλίσουμε την ασφαλή και ωφέλιμη χρήση τους μετριάζοντας πιθανούς κινδύνους.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- PlatoHealth. Ευφυΐα βιοτεχνολογίας και κλινικών δοκιμών. Πρόσβαση εδώ.

- πηγή: https://www.analyticsvidhya.com/blog/2024/04/what-is-gpt-you-wont-believe-whats-inside/